La caja de resonancia del violín

Sabemos muy bien cómo empujar a una criatura en el columpio del parque: podemos aumentar la amplitud de oscilación de la barquilla sincronizando nuestros empujones con la frecuencia natural de este péndulo. En física se puede fácilmente modelar esta dinámica mediante una sencilla ecuación diferencial y predecir cuál es la frecuencia de resonancia del columpio cargado. Dicho de otra manera: deducimos con exactitud a qué ritmo debemos empujar para que la oscilación del columpio se amplifique; y además sabemos que intentar empujar por encima o por debajo de la frecuencia de resonancia que hemos deducido es inútil, porque la oscilación del péndulo se atenuará. La caja de resonancia de un violín no es más que un columpio algo más complejo que el que acabamos de describir. Debido a sus características constructivas y mecánicas, la caja contiene decenas de frecuencias de resonancia en el rango de las vibraciones sonoras.

Foto: Roberto Delfanti / Unsplash

Foto: Roberto Delfanti / UnsplashSin una caja de resonancia en un violín, las vibraciones de sus cuerdas apenas son audibles. Así, la transmisión de las vibraciones de las cuerdas al cuerpo hace que tanto la caja como el volumen de aire de su interior empiecen a vibrar también. Debido a las frecuencias naturales de cada uno de los elementos del instrumento y a la unión de todos ellos en el violín, ciertas frecuencias y armónicos superiores de las ondas acústicas se amplifican o se atenúan en mayor o menor medida. De esta manera, se crea el carácter tonal individual de cada violín, que incluye el volumen y el timbre del sonido musical que este consigue.

La invención del violín modernoLa caja de resonancia de los violines fue mejorando a lo largo de los siglos. La lutería es tanto un arte como una ciencia, y todos los maestros artesanos constructores de instrumentos fueron desde sus inicios también científicos empíricos, capaces de aprender y avanzar en su área de conocimiento mediante continuos métodos experimentales de ciencia acústica, prueba y error.

El violín moderno fue construido en Europa a principios del siglo XVI. Entre las principales regiones europeas aspirantes al título de invención del violín están Füssen, en Algovia (hoy parte de Alemania), Sklenařice en la República Checa, Cracovia en Polonia, y, en Italia, Venecia, Brescia y Cremona. De todas ellas, fue Lombardía la cuna de los mejores lutieres, y más en concreto Brescia, con las violas encabezadas por Gasparo da Salò, y Cremona, con los violines representados por Andrea Amati. Este último es quien quizás pueda ser considerado el inventor del violín moderno, si debemos ceder semejante mérito a una única persona.

Árbol «genealógico» de la escuela de lutería de Cremona. Fuente Wikimedia Commons

Árbol «genealógico» de la escuela de lutería de Cremona. Fuente Wikimedia CommonsCómo medir el carácter tonal del violín

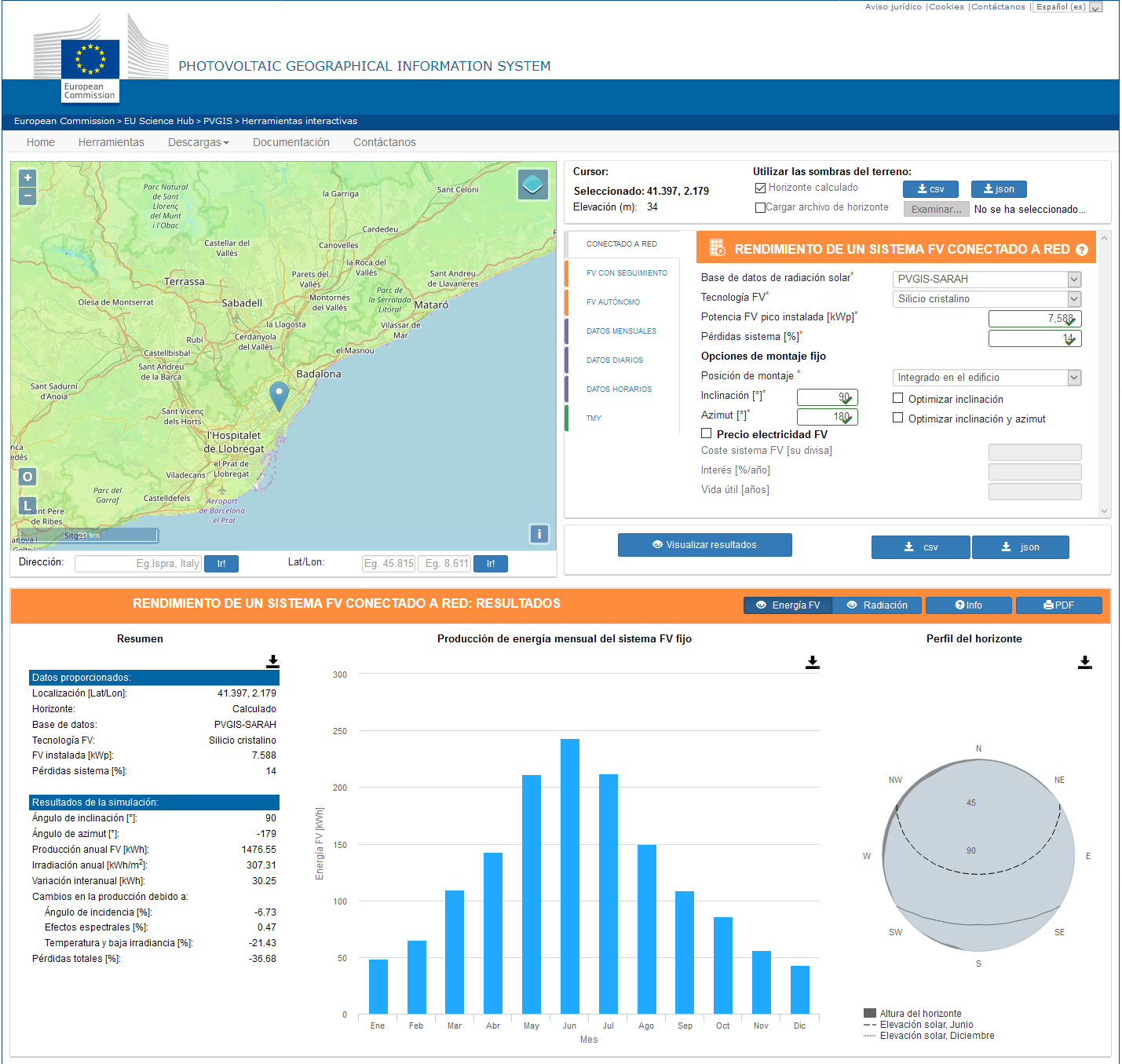

La acústica musical puede modelar el carácter tonal de un violín midiendo distintos parámetros importantes en la caja de resonancia. La forma más completa de caracterizar la calidad de un instrumento es medir la movilidad de su caja al recibir vibraciones de las cuerdas a través del puente.

La movilidad de la caja se denomina también admitancia mecánica (inverso de la impedancia mecánica) que se define como el cociente entre la velocidad que se produce y la fuerza que se aplica en un sistema mecánico. Para medir la respuesta en frecuencia de la movilidad de un violín, debemos ejercer sobre la caja una fuerza oscilante barriendo todas las frecuencias audibles, y medir las velocidades con las que responde dicha caja para cada una de estas frecuencias.

Con un computador se puede emitir un ruido blanco a través de una bobina que induce oscilaciones mecánicas a todas las frecuencias en el cuerpo del violín. A su vez, puede medirse con un acelerómetro la respuesta mecánica de la caja a todas estas frecuencias, y efectuar un cálculo de la transformada de Fourier y un gráfico en el dominio de la frecuencia de todo el mapa de resonancias del instrumento [1].

Método sencillo de medida del carácter tonal de un violín. Fuente: UPV/EHU, Dept Electricidad y Electrónica

Método sencillo de medida del carácter tonal de un violín. Fuente: UPV/EHU, Dept Electricidad y Electrónica

Las resonancias del cuerpo de los violines pueden caracterizar la acústica de todo tipo de instrumentos, incluyendo piezas históricas de gran calidad musical fabricadas hace siglos por los grandes lutieres [2].

Ejemplo del espectro sonoro medido en un violín Fuente: Referencia [2]

Ejemplo del espectro sonoro medido en un violín Fuente: Referencia [2]

Las medidas acústicas de la caja de un violín pueden distinguir varias resonancias de esencial importancia para el sonido que podemos extraer del instrumento. La cavidad del aire de la caja vibra a una frecuencia propia que podemos excitar fácilmente soplando por una de las aberturas acústicas en forma de f del violín y escuchar la nota que surge de la otra f. Otras resonancias de la caja debidas a la madera, espesores, curvas, geometría y construcción nos permiten completar el espectro sonoro del instrumento, así como su firma y carácter tonal.

Referencias:

[1] Victor Etxebarria and Iratxe Riera (2002) Measuring the frequency response of musical instruments with a PC-based system. Catgut Acoustical Society Journal, vol 4, n. 6, (Series II), pp. 26-30.

[2] F Leccese, G Salvadori, G Bernardini and P Bernardini (2018) The bowed string instruments: acoustic characterization of unique pieces from the Italian lutherie. IOP Conf. Series: Materials Science and Engineering vol. 364 pp: 012022

Sobre el autor: Victor Etxebarria Ecenarro está diplomado como lutier por el Conservatorio Juan Crisóstomo de Arriaga (Bilbao) y es Catedrático de Ingeniería de Sistemas y Automática en la Universidad del País Vasco (UPV/EHU)

El artículo La caja de resonancia del violín se ha escrito en Cuaderno de Cultura Científica.

Naukas Bilbao 2022: La maravillosa labor investigadora de las moscas

¿Consideras que las moscas son criaturas “maravillosas”? ¿O que puedan tener un papel protagonista en la investigación contra enfermedades como el cáncer? ¿Alguna vez has llegado a reflexionar sobre la virginidad de estos insectos?

El investigador, doctor en Biología y profesor del departamento de Biología Celular de la Universidad de Sevilla Luis M. Escudero Cuadrado abordó estas cuestiones en su charla en Naukas Bilbao para responder que sí, que las tres son ciertas. ¿Por qué?

En primer lugar porque, aunque cueste trabajo creerlo, la mosca conocida como Drosophila melanogaster es muy parecida al ser humano. Tanto, que se utiliza para estudiar los procesos que llevan a la formación de nuestros órganos, hacer experimentos genéticos e intentar extraer conclusiones que resulten provechosas para la Humanidad. Para llevar a cabo estos experimentos los investigadores utilizan las moscas por varias razones: “Son pequeñas, manejables y tienen un ciclo de vida corto. En 10 días las moscas pasan del embrión a la larva y a la pupa; se produce la metamorfosis y tenemos nuevas moscas, y con una alta descendencia. Además, trabajar con ellas es barato”, explicó el científico.

Y es precisamente en este punto donde entra en juego la virtud de las hembras. Las moscas de este sexo tienen un órgano llamado espermateca que conserva un poco del esperma de cada uno de los machos con los que copula. Por eso, a la hora de garantizar que la información genética de las moscas no se vea alterada con el esperma de varios machos, es necesario que la hembra sea virgen e inducir la copulación en tubos de ensayo.

“Lo que hacemos es coger el tubo, dejar solo las pupas y esperar unas horas para que emerjan las nuevas moscas y tengamos así una guardería de vírgenes”, ilustró el investigador en lo que él mismo denominó “un curso completo de mamporrerismo de moscas en cuatro minutos”.

La finalidad de este “mamporrerismo” es encontrar genes que ayuden a descubrir aspectos que contribuyan a mejorar la vida del ser humano. ¿De qué manera? Luis M. Escudero se remontó a principios del siglo pasado, a los tiempos de Thomas H. Morgan, un genetista experto en investigación con moscas para responder a esta pregunta. Morgan quería resolver el enigma de la transmisión de la herencia genética entre generaciones cuando comenzó a cruzar una mosca con ojos blancos con otras con ojos rojos y se dio cuenta de que la información genética se hallaba en los cromosomas. Un hallazgo que le valió el Nobel de Medicina y Fisiología en 1933.

Morgan denominó white (blanco en inglés) a ese gen que daba la coloración blanca a los ojos de estos insectos, e inauguró la tradición de poner nombre a sus genes, hasta el punto de que hoy en día hay cientos de ellos. Por ejemplo, el gen tinman, que significa “hombre de hojalata”, es el que hace que se forme el corazón de forma correcta. Este gen tiene muchas similitudes con los genes humanos que participan en el proceso de formación del corazón.

Esta introducción permitió al investigador andaluz afirmar que la Drosophila es “maravillosa” ya que “las moscas han servido para investigar un montón de cosas que nos afectan, y para elaborar modelos de Alzheimer, Parkinson y cáncer”. ¿Cómo?

En concreto, el biólogo mencionó el ejemplo de un paciente con cáncer de colon a quien los tratamientos de cirugía, radioterapia y quimioterapia no le sirvieron para controlar la enfermedad e incluso comenzó a sufrir metástasis. Los investigadores identificaron los genes que estaban alterados en los tumores del paciente y crearon una serie de moscas con hasta ocho mutaciones diferentes que producían tumores muy parecidos a los suyos. Para intentar combatir estos tumores probaron en los insectos infinidad de combinaciones de compuestos hasta que dieron con una que conseguía que las moscas sobrevivieran. El resultado fue que después de 27 semanas de tratamiento el tamaño de las lesiones del paciente se redujo un 45%. Lamentablemente, el tratamiento se tuvo que suspender debido a un problema de efectos secundarios, pero abrió la puerta a nuevas investigaciones similares a las que se han desarrollado durante los últimos años.

Investigaciones como la que arrancó en La India hace 50 años con el descubrimiento de un gen, denominado wingless, que posibilita el crecimiento de las alas de una mosca han hecho que se avance muchísimo en la investigación biomédica. En aquella época la tasa de supervivencia en casos de cáncer de colon no superaba el 50%. “Ahora sabemos que los genes de esa familia están mutados en su gran mayoría de los tumores de colon”, explicó Escudero.

Los estudios de este tipo de genes en moscas, ratones y humanos han llevado a que hoy en día tengamos una tasa de supervivencia superior al 90% en este tipo de cáncer. El investigador concluyó su charla con un alegato optimista. “Trabajos como el que os acabo de comentar van a seguir aumentando esta estadística de cara a futuro. Seguro que sí”.

Si no ve correctamente el vídeo use este enlace.

Para saber más:

La inevitable ciencia de los bichos raros

Crónica de Roberto de la Calle / GUK

El artículo Naukas Bilbao 2022: La maravillosa labor investigadora de las moscas se ha escrito en Cuaderno de Cultura Científica.

Los usos terapéuticos de la psilocibina de los hongos alucinógenos

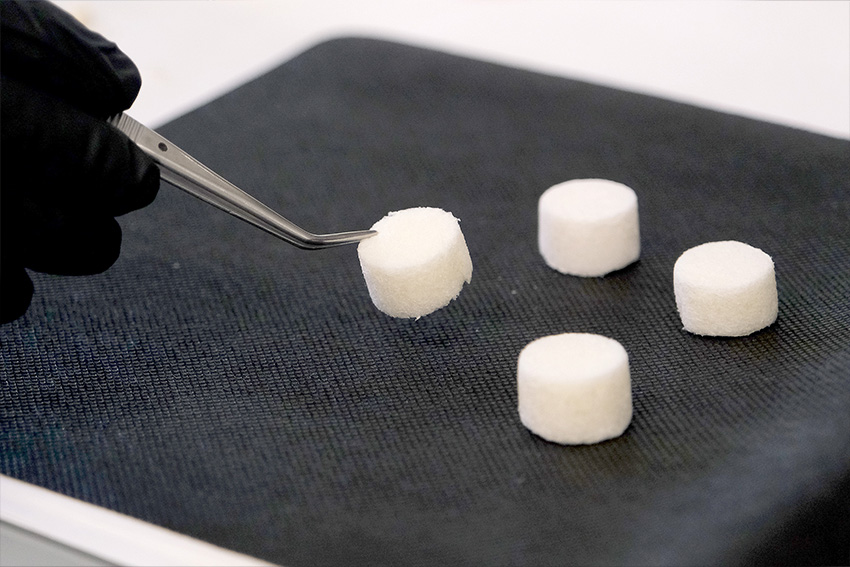

La psilocibina es un alcaloide que una vez ingerido en el cuerpo se convierte en psilocina, un compuesto alucinógeno responsable del efecto psicoactivo de ciertos hongos comestibles. La psilocibina se encuentra en fases avanzadas de ensayos clínicos dirigidos al tratamiento de diferentes patologías psiquiátricas, tales como la depresión o las adicciones. Investigadores del grupo de neuropsicofarmacología de la UPV/EHU han estudiado en profundidad el mecanismo de acción de la psilocibina en ratones.

Psilocybe semilanceata. Fuente: Wikimedia Commons

Psilocybe semilanceata. Fuente: Wikimedia CommonsLa psilocibina se ha convertido en un fármaco potencialmente útil para varias enfermedades neuropsiquiátricas, presentando un inicio rápido de la actividad terapéutica. Sin embargo, los mecanismos responsables de tales efectos siguen siendo poco conocidos. El trabajo del grupo es relevante para comprender tanto el mecanismo de acción subyacente a los efectos terapéuticos como los potenciales efectos secundarios no deseados de esa sustancia psicodélica.

La psilocibina, naturalmente presente en algunas especies de hongos alucinógenos (hongos del género ‘Psilocybe’, entre otros), fue estudiada durante la década de los 60 para el tratamiento de diversos trastornos mentales, pero su uso y distribución quedaron prohibidos a partir de 1972. No obstante, en los últimos años, la comunidad científica ha retomado las investigaciones relacionadas con esa y otras sustancias de características similares, como el MDMA o el LSD.

Los ensayos clínicos desarrollados tanto en Europa como en América están dando resultados prometedores. “Esos estudios han sido el desencadenante para la descriminalización de la psilocibina y otros alucinógenos con potencial terapéutico en los Estados Unidos, lo que supone un avance para una futura aprobación para su uso clínico por las diferentes agencias reguladoras, principalmente la Food & Drug Administration (FDA) y la European Medicines Agency (EMA)”, explica Ines Erkizia, investigadora predoctoral del grupo y primera autora del artículo.

Los efectos agudos de la psilocibina y de su metabolito activo, psilocina, han sido ampliamente descritos tanto en entornos clínicos como por parte de usuarios en ambientes recreativos. Estos incluyen cambios en la percepción, como alucinaciones auditivas o visuales, y experiencias místicas o espirituales. Entre los efectos a largo plazo, los usuarios perciben cambios positivos en el humor y el estado de ánimo, lo cual podría suponer una mejora en la sintomatología de ciertas enfermedades psiquátricas. Los mecanismos que subyacen a esos efectos no son del todo conocidos, pero se han relacionado con incrementos de la plasticidad neuronal que parecen conllevar alteraciones en la conectividad de la corteza cerebral.

“Hemos confirmado un perfil farmacológico similar de psilocina en humanos y roedores -comenta la investigadora-. Además, se realizó un estudio farmacológico exhaustivo para identificar las dosis óptimas a utilizar en futuros estudios científicos de investigación básica y clínica. Nuestros hallazgos aportan datos valiosos sobre la implicación del sistema serotonérgico en los efectos de la psilocibina”, recalca Ines Erkizia.

Los resultados de esta investigación pueden proporcionar una nueva perspectiva sobre las dianas terapéuticas del fármaco para futuros estudios clínicos.

Para saber más:

Consumo de cannabis y desarrollo de esquizofrenia

Del metabolismo (y II)

Referencia:

I. Erkizia-Santamaría, R. Alles-Pascual, I. Horrillo, J.J. Meana, J.E. Ortega (2022) Serotonin 5-HT2A, 5-HT2C and 5-HT1A receptor involvement in the acute effects of psilocybin in mice. In vitro pharmacological profile and modulation of thermoregulation and head-twitch response Biomedicine & Pharmacotherapy doi: 10.1016/j.biopha.2022.113612

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo Los usos terapéuticos de la psilocibina de los hongos alucinógenos se ha escrito en Cuaderno de Cultura Científica.

El piano que surgió de los restos de la guerra

Saltó a la fama gracias a The Doors y su sonido conquistó la música de finales de los 60 y principios de los 70. Se podía oír en todo tipo de música funk, rock y pop. Fue fundamental para el desarrollo del jazz-rock y de artistas como Miles Davis, Joe Zawinul, Chick Corea y Herbie Hancock. El piano Rhodes es ya un símbolo de toda una época. Lo que quizás no sabías es que en sus entrañas se encuentra la magia acústica del diapasón, y en sus orígenes, el horror de la guerra y bombarderos reciclados. Hoy te cuento su historia.

Viajemos hasta 1942. Europa se desangra bajo el peso de la Segunda Guerra Mundial, y han pasado pocos meses desde que Estados Unidos decidió enviar a sus soldados a la contienda. Entre las filas de estos recién llegados se encuentra un curioso personaje. Harold Rhodes ha sido reclutado para entrenarse como piloto de las fuerzas aéreas del ejército estadounidense1. Aunque todos le llaman oficial, él se define a sí mismo como profesor de piano —lo seguiría haciendo durante el resto de su vida—. Por eso, entre vuelo y vuelo, se dedica a dar clases de música a sus compañeros. Pronto, estas lecciones se vuelven tan populares, que el personal médico del ejército solicita su ayuda y Harold no se lo tiene que pensar dos veces. Equipado con su mejor arma, decide que su misión en medio del horror de la guerra será traer rehabilitación y consuelo a los soldados heridos, a través de la música.

Sin embargo, su tarea no era nada fácil. Para empezar, porque conseguir un piano para hacer musicoterapia de vanguardia no era precisamente una prioridad médica en medio de la Segunda Guerra Mundial —por lo que sea—. Pero además, muchos de los soldados que llegaban a sus manos se encontraban postrados en sus camas, sin posibilidad de moverse. Rhodes se vio forzado a inventar una nueva manera de impartir sus clases. En tiempos más felices, antes de la guerra, había puesto mucho empeño en enseñar a sus alumnos la mecánica de su instrumento, convencido de que entender el lenguaje de la música y cómo se produce el sonido era clave en su formación. Ahora, todo ese bagaje le ayudaría en su nuevo reto.

Rhodes se dispuso a crear un nuevo instrumento, un teclado portable y ligero, que los soldados pudieran tocar desde sus camillas, o sobre su regazo. Y ¿de dónde podía sacar el material necesario para construirlo? ¡De la propia guerra! Haciendo uso de su ingenio, decidió recurrir a una fuente insospechada de piezas de metal: aviones B-17 averiados. Las alas de estos bombarderos tenían unos tubos de aluminio que se podían cortar para crear láminas vibrantes de diferentes tonos. El “Xylette” —como llamó a su instrumento— tenía 29 teclas y era parecido a un xilófono, solo que con teclas. Una especie de piano de juguete. Y a pesar de ser bastante rudimentario, a los soldados les encantó. De hecho, el instrumento tuvo tanto éxito que Rhodes fue puesto a cargo del programa de rehabilitación de instrucción musical en todos los hospitales de la fuerza aérea. Se estima que el Xylette fue utilizado en hospitales de la Fuerza Aérea por miles de soldados.

El prepiano Rhodes (1950) es uno de los más antiguos, un modelo muy anterior al famoso piano eléctrico Fender Rhodes (1965). Fuente: Wikimedia Commons

El prepiano Rhodes (1950) es uno de los más antiguos, un modelo muy anterior al famoso piano eléctrico Fender Rhodes (1965). Fuente: Wikimedia Commons

Después de la guerra, Rhodes siguió trabajando en su idea. Como buen profesor de piano, su objetivo era llevar su nuevo teclado a las aulas, para seguir enseñando música. Así que se le ocurrió amplificar su sonido electrónicamente y adaptarlo para estudiantes. El “Pre-Piano” contaba incluso con un asiento adjunto, como una especie de pupitre sonoro. Una década más tarde, Rhodes se asoció con Leo Fender para desarrollar y fabricar el piano Fender Rhodes que hoy conocemos. El primer modelo fue lanzado en 1959 y contaba solo con el registro más grave. Fue el modelo que popularizó The Doors. Raymond Manzarek, el teclista, lo utilizaba en sustitución del tradicional bajo eléctrico. Poco más tarde, salió al mercado el primer teclado completo de 73 notas: el Fender Rhodes Mk1.

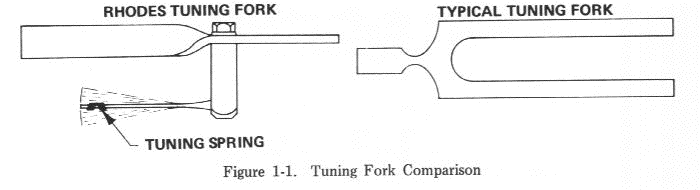

¿Pero cómo funciona exactamente este piano eléctrico? Bien, el mecanismo no es muy diferente al de un piano real, solo que, en lugar de cuerdas, tiene unas piezas de metal que vibran a distinta frecuencia. Cuando el martillo las golpea, su vibración es capturada por un transductor que convierte su energía acústica en una señal eléctrica, como sucede en una guitarra eléctrica.

Pues bien, esas piezas de metal que sustituyen a las cuerdas son diapasones. ¡Sí, diapasones! Bueno, quizás un tipo de diapasón un tanto más asimétrico que el que solemos imaginar, pero instrumentos perfectamente equivalentes desde un punto de vista físico. En este caso, las patas de las varillas tienen distinta forma, masa y tamaño, pero son iguales en el tono. Y al igual que los diapasones, su sonido tiene propiedades especialmente interesantes para los músicos.

Piano Rhodes sin la tapa de forma que las piezas de metal (diapasones) quedan visibles. Fuente: Wikimedia Commons

Piano Rhodes sin la tapa de forma que las piezas de metal (diapasones) quedan visibles. Fuente: Wikimedia CommonsDe hecho, el piano de Rhodes resultó revolucionario en su época. Por primera vez en la historia, los teclistas podían llevar su propio piano portátil de viaje. Bueno, todo lo “portátil” que puede ser un piano, entiéndase. Nadie les libraba de cargarlo en una camioneta cada noche. Pero gracias a las propiedades del diapasón, el Rhodes apenas se desafinaba. Y como alternativa era mucho mejor, que el piano destartalado de turno que pudieran encontrarse en los clubes donde tocaban.

Pronto este instrumento conquistó el mundo del rock y de la música. A mí me cuesta oír su sonido sin que me venga a la cabeza de inmediato The Doors. Pero muchos otros artistas recurrieron a este piano electrónico, desde Herbie Hancock a los Beatles o Michael Jackson. No está nada mal para un piano de juguete fabricado con aviones reciclados.

Referencia:

1Elaine Woo, 2001. “Harold B. Rhodes; Inventor of Electric Piano”. Los Angeles Times. Consultado el 1 de noviembre de 2022.

Sobre la autora: Almudena M. Castro es pianista, licenciada en bellas artes, graduada en física y divulgadora científica

El artículo El piano que surgió de los restos de la guerra se ha escrito en Cuaderno de Cultura Científica.

¿Existen recorridos mágicos del caballo en el tablero de ajedrez?

Mis dos últimas entradas del Cuaderno de Cultura Científica han estado dedicadas a un problema clásico que relaciona matemáticas y ajedrez, el conocido problema del recorrido del caballo sobre el tablero de este juego. La primera de esas entradas, titulada El problema del recorrido del caballo en el tablero de ajedrez la dedicábamos a explicar el problema y a analizar la existencia de recorridos sobre tableros de ajedrez generales, no solo el clásico tablero cuadrado 8 x 8, sino tableros cuadrados o rectangulares de diferentes tamaños. Mientras que la segunda entrada, titulada El problema del recorrido del caballo en el tablero de ajedrez (II), se centraba en algunos métodos (algoritmos) históricos (de matemáticos como los franceses Abraham de Moivre (1667-1754) y Pierre Rémond de Montmort (1678-1719), o el suizo Leonhard Euler (1707-1783), entre otros) para construir dichos recorridos.

Jaque mate (alrededor de 2010), del artista canadiense Paul Ygartua. Véase la obra en su página web, Imagen de su página web: Paul Ygartua

Jaque mate (alrededor de 2010), del artista canadiense Paul Ygartua. Véase la obra en su página web, Imagen de su página web: Paul YgartuaEn esta entrada, vamos a relacionar el rompecabezas del recorrido del caballo con la construcción de cuadrados mágicos, dos cuestiones que no tienen aparentemente ninguna conexión.

El problema del recorrido del caballoLo primero, como no puede ser de otra manera, es recordar el rompecabezas del que estamos hablando.

Problema del recorrido del caballo: Buscar un recorrido de la figura del caballo sobre el tablero de ajedrez (considerado este en un sentido general, es decir, tableros de diferentes formas y tamaños, principalmente cuadrados y rectangulares) que consista en mover esta pieza del juego, desde una casilla inicial, de forma sucesiva a través de todas las casillas del tablero, pasando una sola vez por cada una de ellas, y terminando en la casilla inicial (recorrido cerrado) o en otra casilla distinta (recorrido abierto).

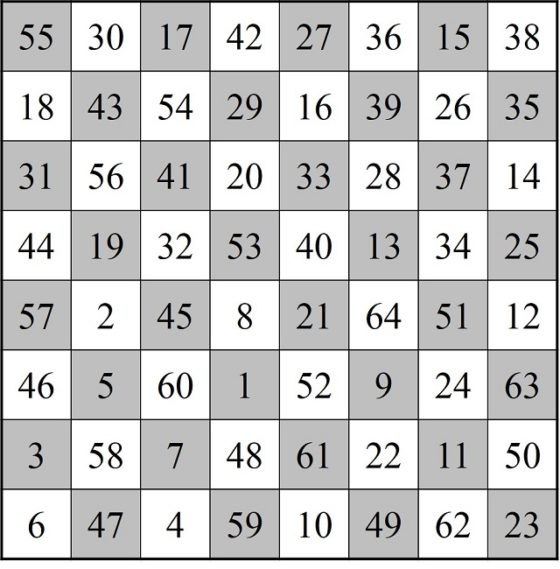

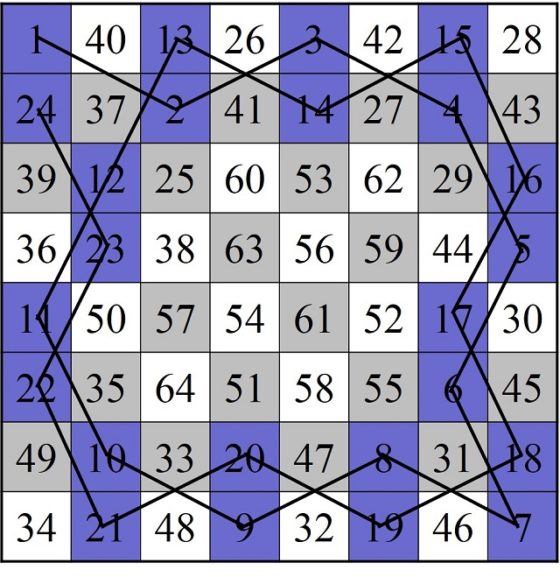

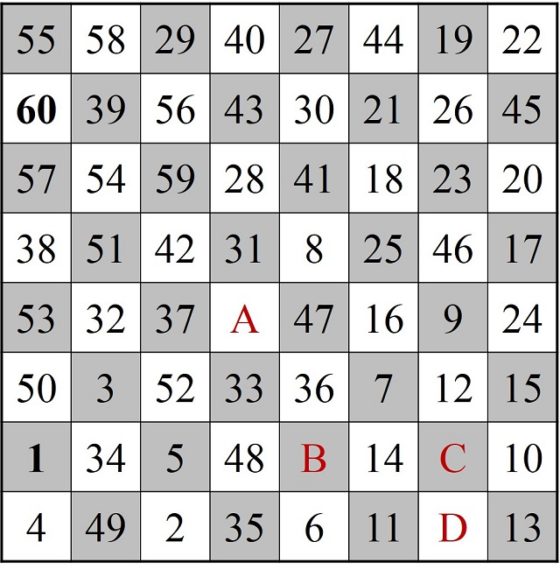

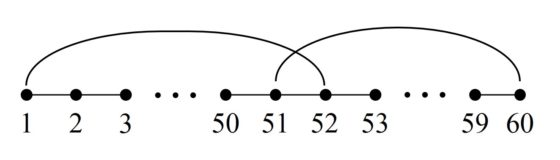

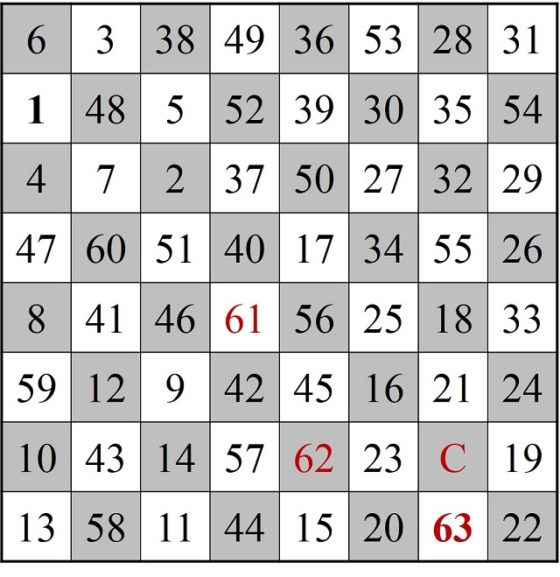

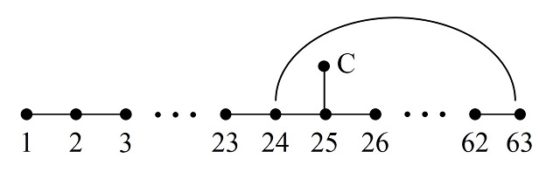

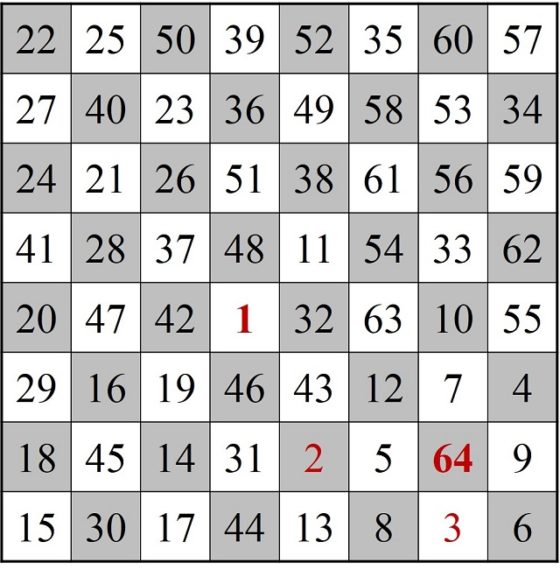

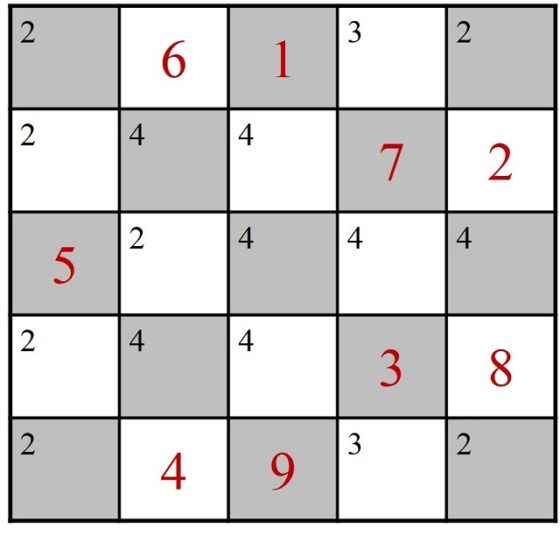

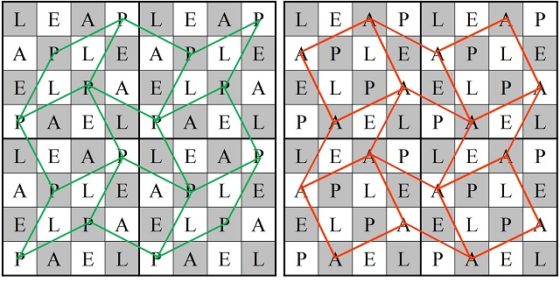

Por ejemplo, en la siguiente imagen mostramos dos soluciones de este juego, una con un recorrido abierto y otra con un recorrido cerrado, que obtuvimos en la anterior entrada con la técnica de De Moivre y De Montmort.

Recorridos abierto y cerrado obtenidos con el algoritmo de De Moivre-De Montmort

Recorridos abierto y cerrado obtenidos con el algoritmo de De Moivre-De Montmort

Además, recordemos que hemos numerado las casillas del tablero de ajedrez generalizado según el orden del recorrido del caballo, es decir, la casilla inicial esta numerada como 1, la siguiente sobre la que salta el caballo 2, después 3, y así hasta la casilla 64. De forma que, al resolver el problema del recorrido del caballo, hemos generado una retícula cuadrada con los números del 1 al 64, en general, del 1 al número de casillas del tablero.

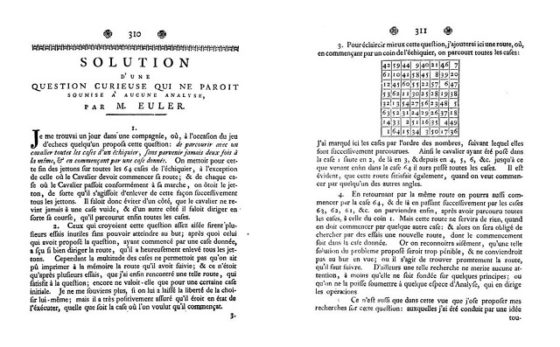

Ya el matemático más prolífico de todos los tiempos, Leonhard Euler (1707-1783), que, como comentamos en la anterior entrada, fue el primero en realizar un análisis matemático riguroso del juego del recorrido del caballo en su artículo Solución a una cuestión ingeniosa que parece que no ha sido analizada (Memoria de la Academia de Ciencias de Berlín, escrito en 1759 y publicado en 1766), observó que los números pares e impares se distribuyen de forma alternada sobre el tablero de ajedrez. Si tenemos pintadas de blanco y negro las casillas del tablero con su típica distribución alternada, cada color alberga a todos los números pares o impares.

Los cuadrados mágicosLos cuadrados mágicos son unos objetos matemáticos que han cautivado a matemáticos y no matemáticos a lo largo de la historia. Se pueden encontrar, normalmente, en libros de divulgación de las matemáticas, de matemática recreativa o incluso de magia, pero también, como mostraremos hoy, en libros de ajedrez. Sobre ellos investigaron grandes matemáticos como el francés Pierre de Fermat (1607-1665) o Leonhard Euler, y hasta personalidades como el político, científico e inventor Benjamin Franklin (1706-1790), se atrevieron con ellos. Los cuadrados mágicos ya se conocían desde la antigüedad (quizás más allá del año 2.200 a.n.e.), y se les relacionaba con los planetas y con la alquimia, con la magia y la astrología, con la numerología, y también se utilizaban para sanar o como amuletos.

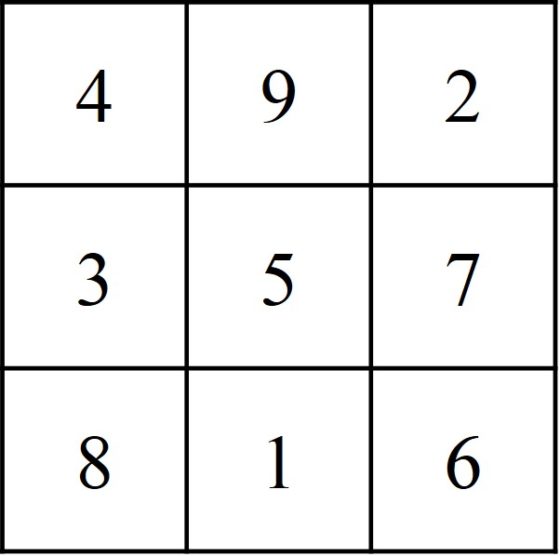

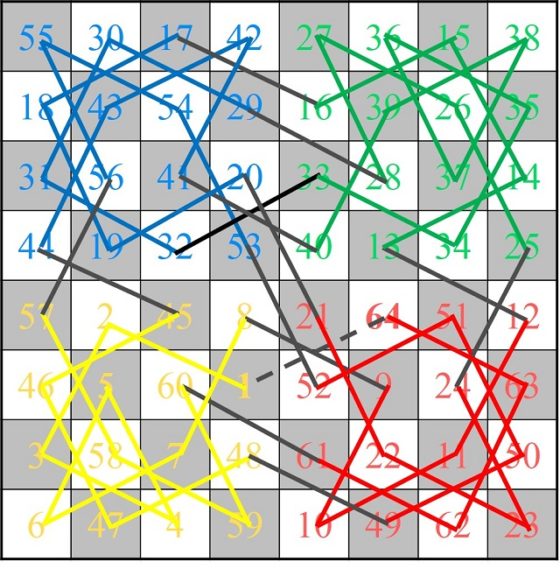

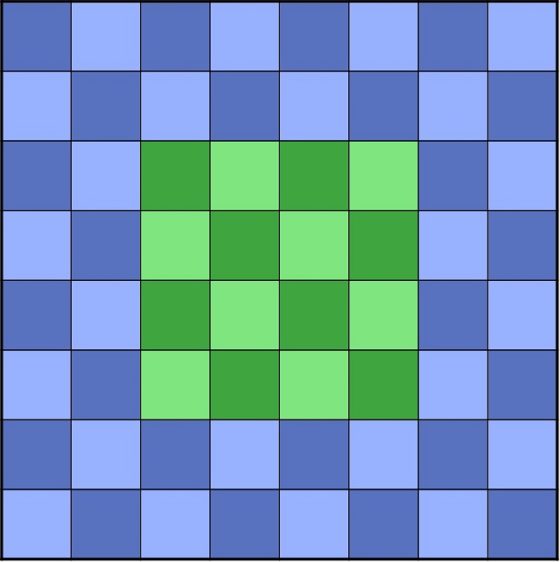

Pero vayamos con la definición de cuadrado mágico. Primero empecemos con un ejemplo, el cuadrado mágico más sencillo, que es el cuadrado mágico de orden 3. Se trata de un retículo cuadrado de tamaño 3 x 3, en el que se han colocado los números del 1 al 9, por ejemplo, como se muestra en la siguiente imagen.

Cuadrado mágico de orden 3, conocido como Lo-Shu

Cuadrado mágico de orden 3, conocido como Lo-Shu

Como se puede observar la primera fila 4 – 9 – 2, la segunda fila 3 – 5 – 7 y la tercera 8 – 1 – 6 están formadas, cada una de ellas, por tres números cuya suma es la misma en los tres casos, en concreto, 15. Efectivamente, 4 + 9 + 2 = 3 + 5 + 7 = 8 + 1 + 6 = 15. Por otra parte, si sumamos los números de cada columna, suman de nuevo 15. La primera columna 4 + 3 + 8 = 15, la segunda 9 + 5 + 1 = 15 y la tercera 2 + 7 + 6 = 15. Más aún, la suma de los números de las dos diagonales principales suma de nuevo 15, como se comprueba fácilmente, 4 + 5 + 6 = 8 + 5 + 2 = 15. ¡Esto es exactamente un cuadrado mágico de orden 3!

Este cuadrado mágico 3 × 3, conocido como Lo-Shu, aparece por primera vez en uno de los cinco libros clásicos de la Antigua China, el I-Ching o Libro de las permutaciones (sobre el siglo 1.200 a.n.e), aunque una leyenda afirma que es mucho más antiguo, que fue visto por el emperador chino Yu, hacia el 2.200 a.n.e., en el caparazón de una gran tortuga. Sobre esta leyenda y algunas otras cuestiones relacionadas con los cuadrados mágicos las podéis leer en la serie de entradas del Cuaderno de Cultura Científica titulada Habibi y los cuadrados mágicos (primera parte, segunda parte y tercera parte).

En general, un cuadrado mágico de orden n (en el caso anterior, n = 3), es una distribución de los n2 primeros números (para orden 3, los 9 primeros números, 1, 2, 3, 4, 5, 6, 7, 8, 9), sobre las casillas de una retícula cuadrada n x n, (en el ejemplo anterior, 3 x 3), de forma que la suma de cada fila, cada columna y cada diagonal sea siempre la misma (para orden 3 es 15) y a ese número se le llama constante del cuadrado mágico.

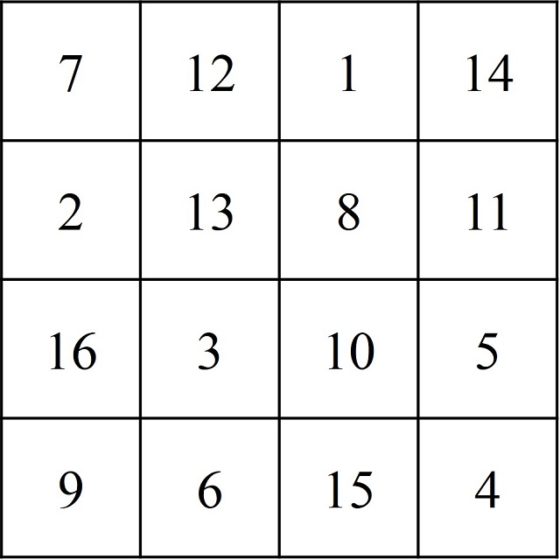

Un ejemplo de cuadrado mágico de orden 4 lo vemos en la siguiente imagen. En el mismo la suma de cada fila, cada columna y cada diagonal es 34.

Cuadrado mágico de orden 4 que aparece en un pilar de un templo de Khajurado (India), y que es la primera representación gráfica de la que se tiene constancia en la que aparece un cuadrado mágico de orden 4

Cuadrado mágico de orden 4 que aparece en un pilar de un templo de Khajurado (India), y que es la primera representación gráfica de la que se tiene constancia en la que aparece un cuadrado mágico de orden 4Los cuadrados mágicos y el recorrido del caballo

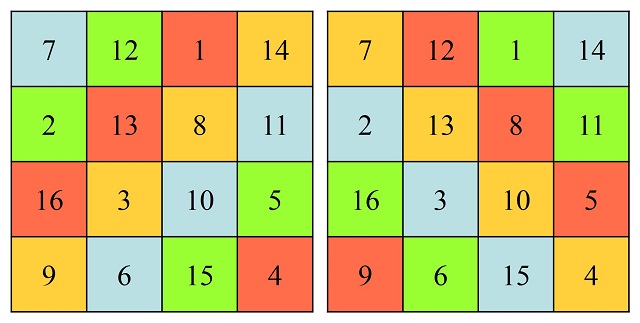

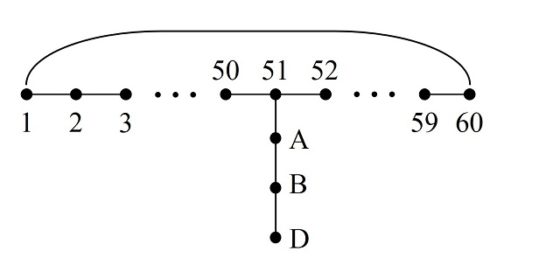

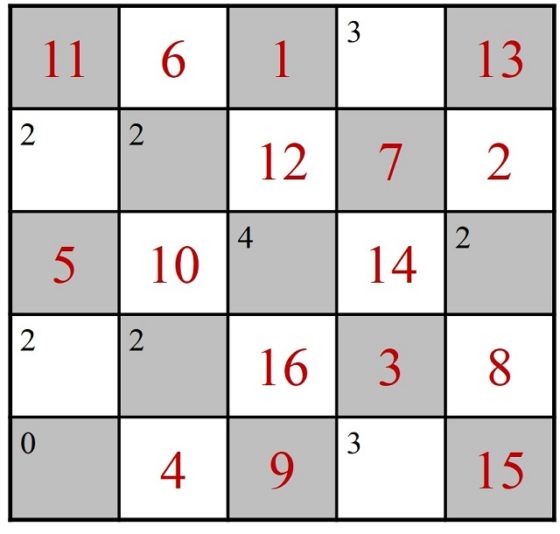

Teniendo en cuenta que cada recorrido del caballo sobre el tablero de ajedrez genera una retícula de números, que en el caso de tableros cuadrados de tamaño n x n es una retícula cuadrada, es posible plantearse si esta podría ser un cuadrado mágico.

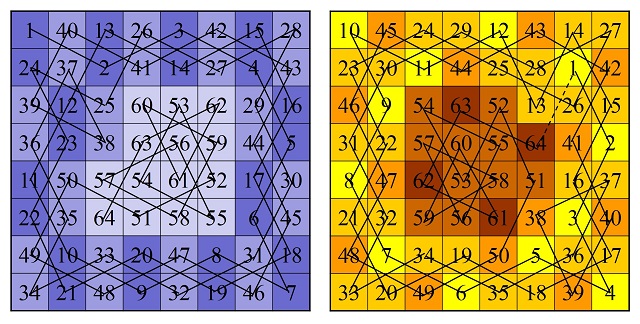

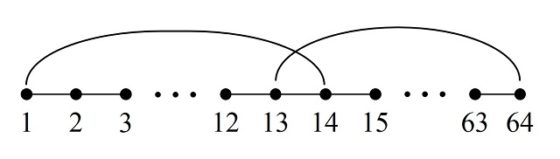

La primera persona que se planteó esta cuestión, que tengamos constancia de ello, sobre el tablero de ajedrez clásico fue William Beverly (no está clara la identidad de William Beverly, pero se cree que podría ser el pintor William Roxby Beverley (aprox. 1814-1889)) en el artículo On the Magic Square of the Knight’s March (Sobre el cuadrado mágico del camino del caballo), publicado en la revista The London, Edinburgh, and Dublin Philosophical Magazine and Journal of Science (vol. 33, no. 220, pp. 101–105, 1848). En el mismo presentaba el siguiente retículo cuadrado numérico generado por un recorrido abierto del caballo sobre el tablero de ajedrez.

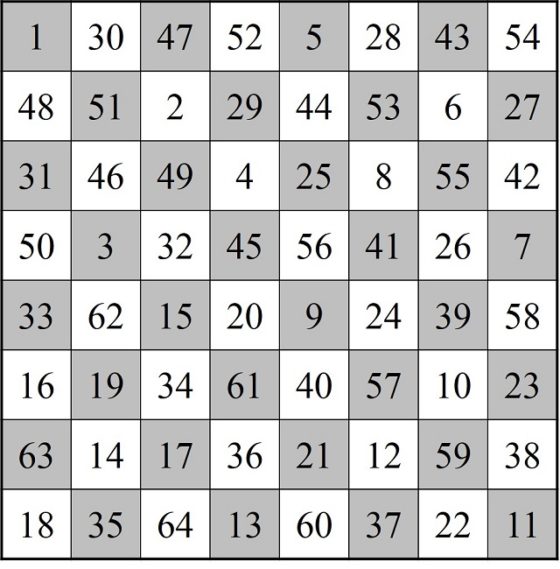

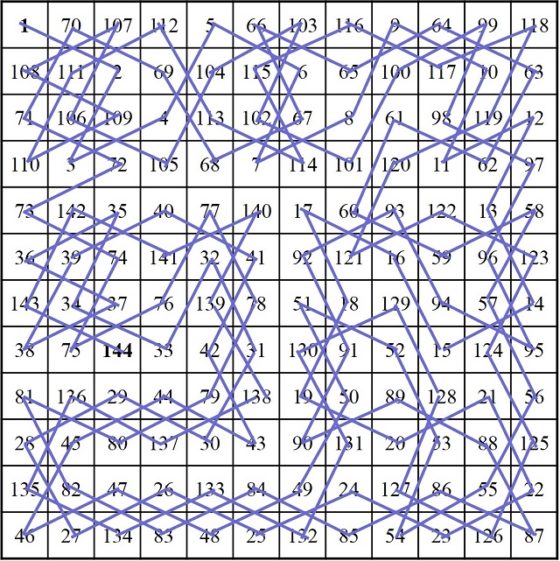

Recorrido abierto del caballo sobre el tablero de ajedrez, con curiosas propiedades numéricas, publicado por William Beverley en 1848

Recorrido abierto del caballo sobre el tablero de ajedrez, con curiosas propiedades numéricas, publicado por William Beverley en 1848

Este cuadrado numérico, en ocasiones erróneamente atribuido a Leonhard Euler, cumple la propiedad de que la suma de los números de cada fila y de cada columna es la misma, en concreto, 260. Es lo que se conoce como cuadrado semi-mágico de orden 8, ya que la suma de los números de las diagonales no es 260, sino 210 y 282.

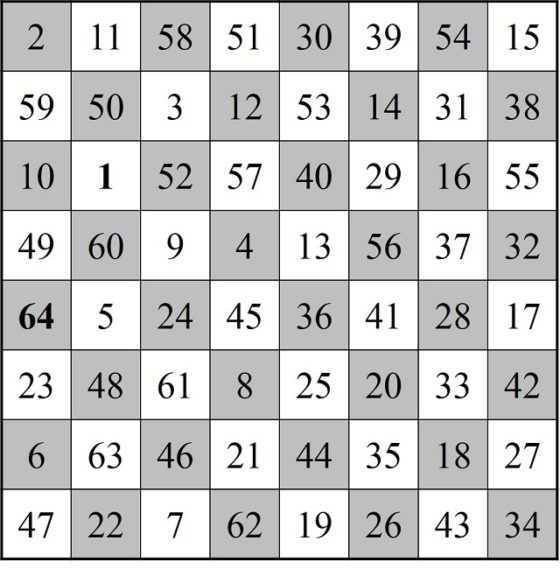

La constante mágica para orden 8 es 260, como ocurre con el ejemplo de Beverley, ya que en general, la constante de un cuadrado semi-mágico de orden n es igual, como se puede deducir fácilmente, a:

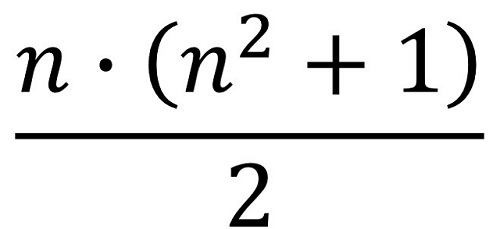

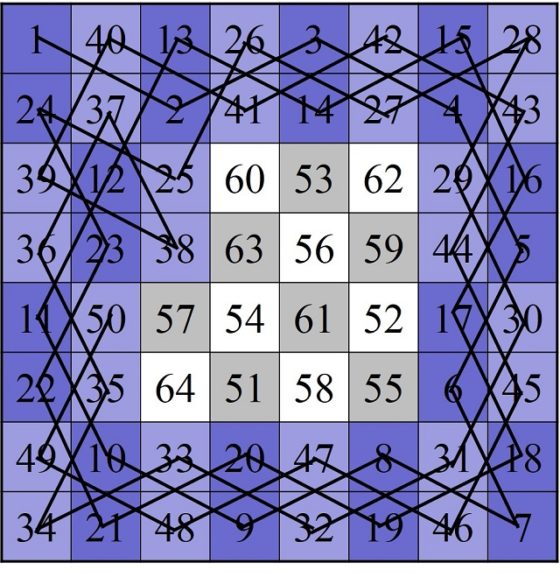

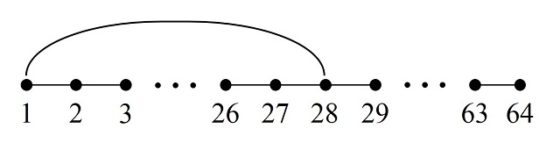

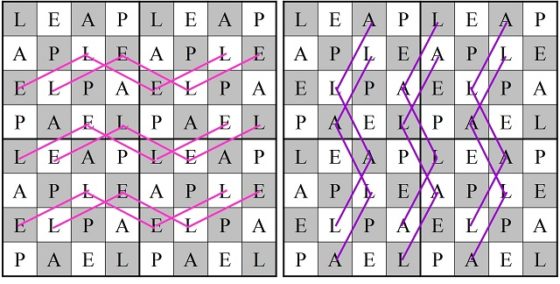

Una sencilla propiedad de los cuadrados semi-mágicos obtenidos mediante el recorrido del caballo es que el recorrido inverso, es decir, que empieza por el final y termina en el principio, también es un cuadrado semi-mágico. El propio William Beverley pone de manifiesto este hecho en su ejemplo, como se puede ver en su publicación (siguiente imagen).

Las dos primeras páginas del artículo On the Magic Square of the Knight’s March, publicado en la revista The London, Edinburgh, and Dublin Philosophical Magazine and Journal of Science, con la introducción del matemático amateur Henry Perigal, Junior (1801–1898) y el recorrido del caballo, y su reverso, cuyas filas y columnas suman 260

Las dos primeras páginas del artículo On the Magic Square of the Knight’s March, publicado en la revista The London, Edinburgh, and Dublin Philosophical Magazine and Journal of Science, con la introducción del matemático amateur Henry Perigal, Junior (1801–1898) y el recorrido del caballo, y su reverso, cuyas filas y columnas suman 260

Aunque este cuadrado semi-mágico cumple algunas propiedades más (puede verse el artículo original de William Beverley), sigamos con el problema de la relación de los recorridos del caballo con los cuadrados mágicos.

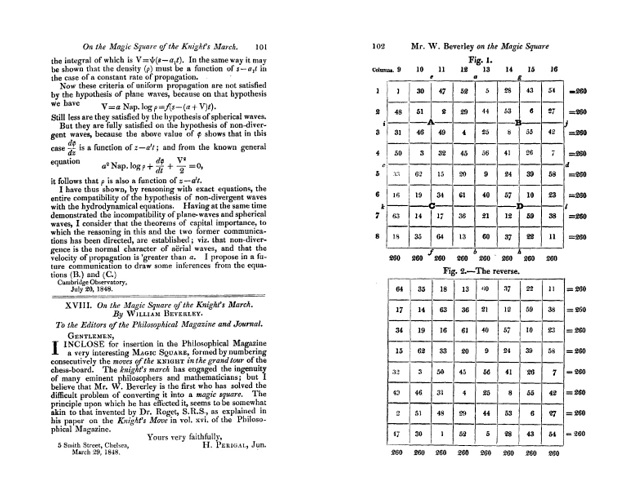

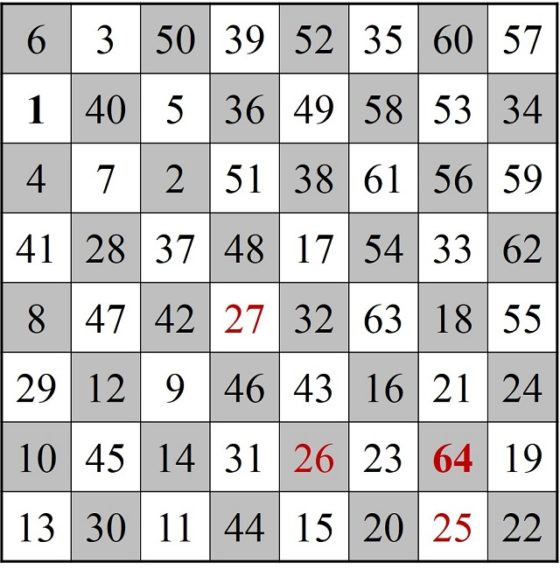

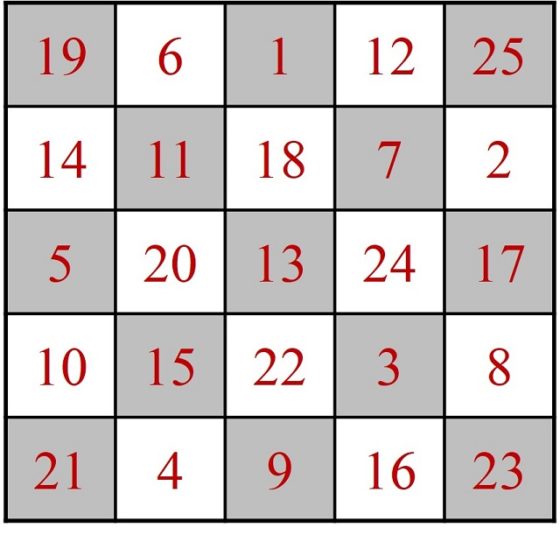

El primer cuadrado semi-mágico generado por un recorrido cerrado del caballo se debe al húngaro Carl Wenzelides (tampoco está clara su identidad, según el matemático y experto en ciencias de la computación Donald Knuth (1938) sería un historiador, que además escribió sobre poesía y música, y vivió entre los años 1770 y 1852) y apareció en el artículo Bemerkungen über den Rösselsprung (Observaciones sobre el salto del caballo), publicado en 1849 en la revista de ajedrez Schachzeitung.

Cuadrado semi-mágico de Carl Wenzelides generado por un recorrido cerrado del caballo

Cuadrado semi-mágico de Carl Wenzelides generado por un recorrido cerrado del caballo

En este cuadrado numérico, las sumas de cada una de las diagonales no es 260, luego tampoco es un cuadrado mágico, pero cumple una curiosa propiedad, que la suma de los números de las dos diagonales es el doble de 260, 304 + 216 = 520.

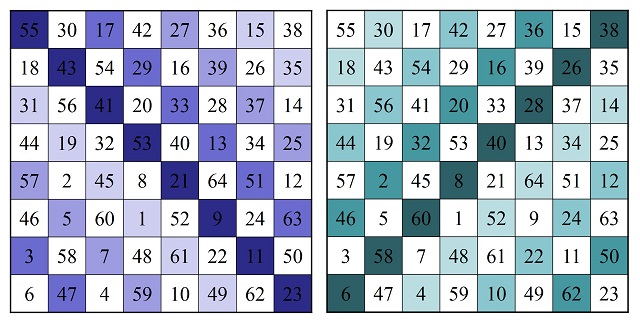

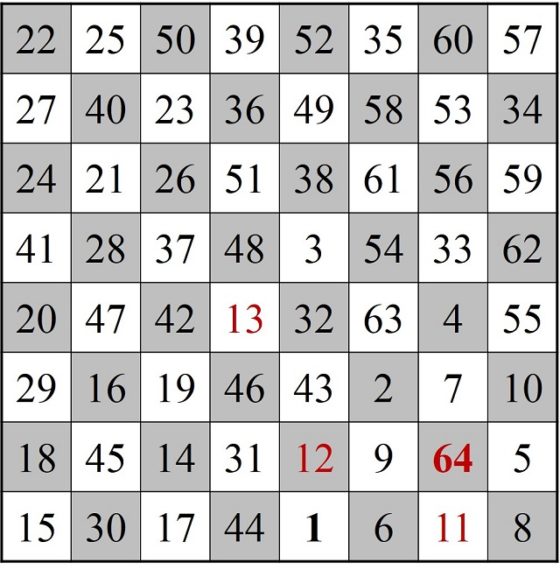

En los siguientes años fueron apareciendo algunos ejemplos más de cuadrados semi-mágicos generados mediante recorridos del caballo sobre el tablero de ajedrez. Entre otros, el siguiente debido al jugador y teórico del ajedrez ruso-finlandés Carl Ferdinand Jaenisch (1813–1872), que aparecía en el artículo De la solution la plus parfaite du problème du cavalier (Sobre la solución más perfecta del problema del caballo), publicado en 1859 en la revista de ajedrez The Chess Monthly.

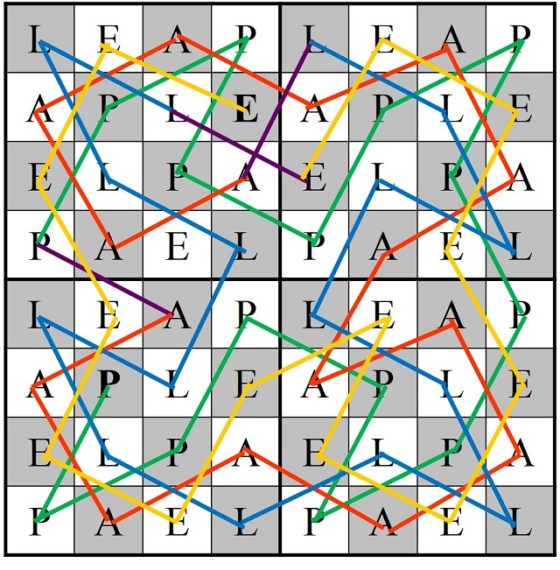

La perfección viene por dos motivos. El primero es que, si dibujamos, con segmentos, el camino realizado por el caballo, este tiene simetría rotacional (180 grados), como se observa en la imagen.

El otro motivo es que, aunque los números de las diagonales no son 260, sino 256 y 264, la suma da de nuevo 520, el doble de 260, pero además se verifica otra curiosa propiedad relacionada con las diagonales no principales, las diagonales fragmentadas. Para explicarlo mejor, vayamos de nuevo al ejemplo del cuadrado mágico de orden 4 que habíamos mostrado anteriormente, cuyas filas, columnas y diagonales principales sumaban 34. Pero, además, ese cuadrado mágico, cumple otra propiedad, que las diagonales fragmentadas descendentes y ascendentes (que mostramos con el mismo color en la siguiente imagen, también suman 34).

En el cuadrado semi-mágico de Jaenisch ocurre algo similar, pero solo parcialmente. Los números de la diagonal principal descendente (azul oscuro en la siguiente imagen) suman 256, así como las diagonales fragmentadas paralelas (diferentes tonos de azul). Por otra parte, la suma de la diagonal principal ascendente (verde oscuro en la siguiente imagen) es 264, así como las diagonales fragmentadas paralelas (diferentes tonos de verde).

Siguieron encontrándose ejemplos de cuadrados semi-mágicos obtenidos mediante el recorrido del caballo (recorridos semi-mágicos). En 1951, el pedagogo, inspector de educación e historiador del ajedrez británico Harold J. R. Murray (1868 – 1955), autor del libro Historia del ajedrez, escribió la monografía The Magic Knight’s Tours. A Mathematical Recreation (Los recorridos del caballo mágicos, una recreación matemática), que recogía los 126 semi-mágicos obtenidos mediante recorridos del caballo, 59 de ellos cerrados, que se conocían hasta ese momento. Pero esta monografía se quedó en el cajón, por lo que el listado de estos cuadrados semi-mágicos no fue publicado hasta 1986. Apareció en el artículo Catalogue of 8 x 8 magic knight’s tours (Chessics 26, pp. 122-128), del matemático y editor británico George P. Jelliss, quien es el autor de una página web muy exhaustiva sobre el problema del recorrido del caballo.

A raíz de la publicación de este catálogo de 126 cuadrados semi-mágicos, se descubrió que aún había más recorridos semi-mágicos. Entre 1987 y 1988, el aficionado a las matemáticas británico Thomas W. Marlow (1927-2011) encontró, utilizando métodos computacionales, 5 cuadrados semi-mágicos más. A los que se les añadió 2 más, en 2003, por parte del australiano Timothy S. Roberts, profesor del Departamento de Informática y Comunicación de la Central Queensland University.

Sin embargo, ninguno de ellos era un cuadrado mágico, por lo que aún seguía abierto, tras más de 150 años, el problema de si existían recorridos (abiertos o cerrados) del caballo en el tablero de ajedrez que generaran un cuadrado mágico.

Finalmente, Hugues Mackay (Canada), Jean-Charles Meyrignac (Francia) y Günther Stertenbrink (Alemania) decidieron unir sus fuerzas y desarrollar un software que analizara computacionalmente todos los posibles recorridos del caballo en el tablero 8 x 8. El resultado, obtenido en 2003, fue que:

¡no hay recorridos del caballo que generen cuadrados mágicos!

Además, obtuvieron 7 nuevos cuadrados semi-mágicos, tres abiertos y cuatro cerrados, que no se habían obtenido antes. De esta forma, se cerró el catálogo de recorridos del caballo que generan cuadrados semi-mágicos, con una extensión de 140, de los cuales 63 son cerrados.

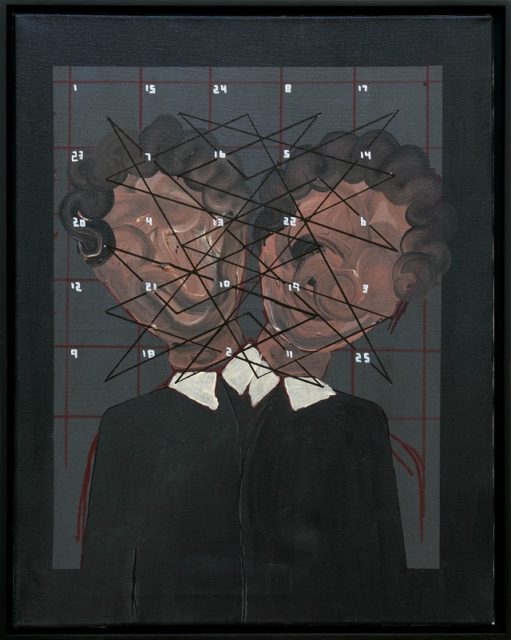

A. O. Magic Square Face #B2 (2019), del artista alemán Thomas Zipp (1966), que forma parte de la instalación The Church of the Magic Square (2020), para la galería Blank Projects [blankprojects.com] de Sudáfrica

A. O. Magic Square Face #B2 (2019), del artista alemán Thomas Zipp (1966), que forma parte de la instalación The Church of the Magic Square (2020), para la galería Blank Projects [blankprojects.com] de Sudáfrica

Los recorridos del caballo mágicos en tableros de cualquier tamaño

Puesto que se pueden obtener retículos cuadrados numéricos para recorridos del caballo sobre tableros cuadrados de cualquier tamaño n x n, es lógico preguntarse si sería posible construir cuadrados mágicos con recorridos del caballo para grados distintos de 8.

La primera reflexión que podemos realizar es que no van a existir tales cuadrados mágicos, ni semi-mágicos, para ordenes n impares. El motivo es muy simple.

Si tomamos el tablero de ajedrez cuadrado, de tamaño n x n, y pintamos sus casillas de blanco y negro, de forma alterna, como es habitual, el caballo en su salto va a pasar de una casilla negra a una blanca, y viceversa, pero cuando contamos las casillas del recorrido después de un número par viene uno impar, y viceversa, luego todos los números pares estarán en las casillas de un mismo color y los impares en las casillas del otro, como podéis comprobar además en los ejemplos mostrados más arriba para el tablero 8 x 8. Por lo tanto, si nuestro tablero n x n es tal que n es impar (n = 2k + 1), tendremos que dos columnas cualesquiera, respectivamente filas, contiguas tendrán una de ellas k casillas negras y k + 1 blancas, mientras que la otra tendrá k casillas blancas y k + 1 negras. Como la paridad está asociada al color, entonces la suma de los números de una de esas dos columnas (resp. filas) será par, mientras que la suma de la otra será impar. Por lo tanto, no pueden coincidir.

¡No existen recorridos (semi-)mágicos en los tableros de tamaño n x n, con n impar!

Magic Square of Five (Twins) (2020), del artista alemán Thomas Zipp (1966), que forma parte de la instalación The Church of the Magic Square (2020), para la galería Blank Projects [blankprojects.com] de Sudáfrica

Magic Square of Five (Twins) (2020), del artista alemán Thomas Zipp (1966), que forma parte de la instalación The Church of the Magic Square (2020), para la galería Blank Projects [blankprojects.com] de Sudáfrica

La cuestión es ahora qué pasa para el resto de los tamaños de los tableros, para aquellos tales que n es par. Se pueden considerar dos tipos de tamaños distintos, aquellos para los que n = 4k y aquellos para los que n = 4k + 2, que son todos. Los hemos separado así porque G. P. Jelliss demostró, en 2003, que no existen recorridos del caballo mágicos para tableros n x n, con n = 4k + 2. Por lo tanto, solo hay que considerar aquellos tamaños para los que n = 4 k (siendo k mayor que 1, ya que recordemos que no existen recorridos sobre el tablero 4 x 4, como se comentó en la entrada El problema del recorrido del caballo en el tablero de ajedrez).

¡No existen recorridos (semi-)mágicos en los tableros de tamaño n x n, con n = 4k + 2!

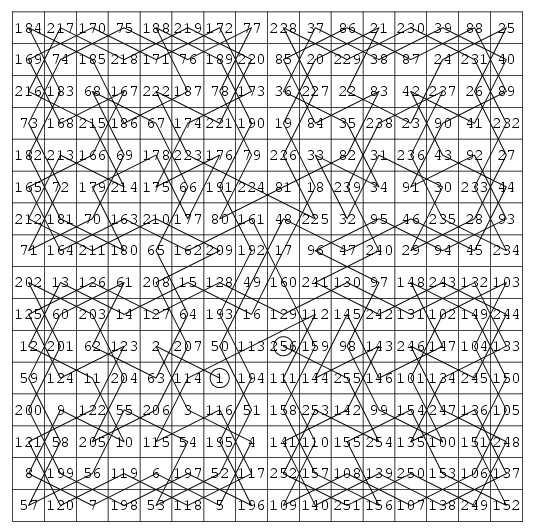

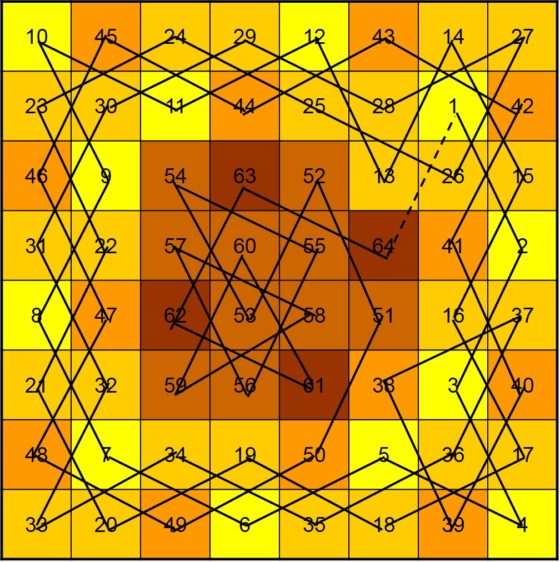

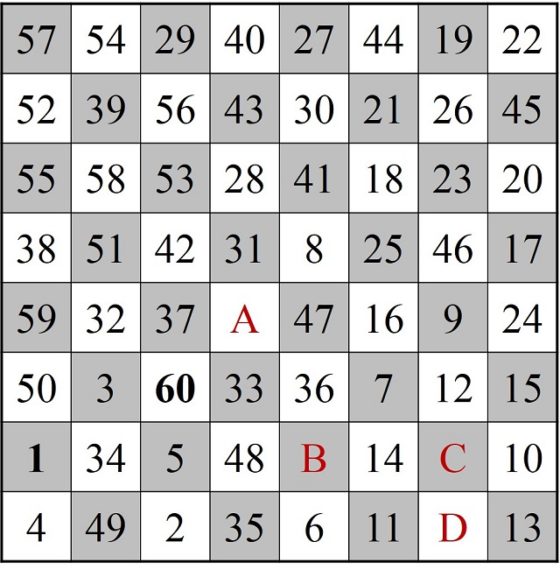

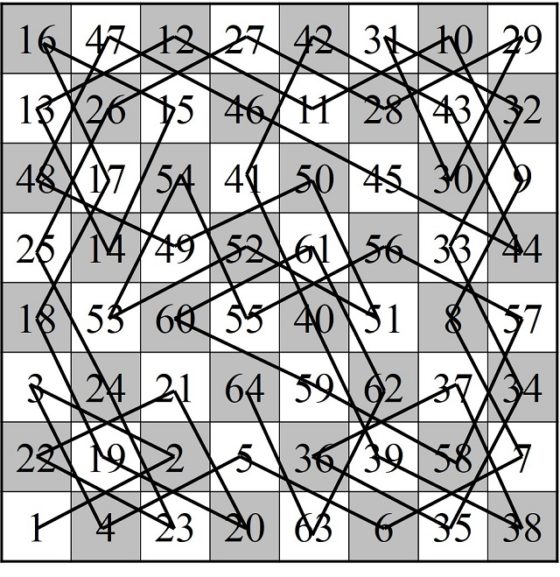

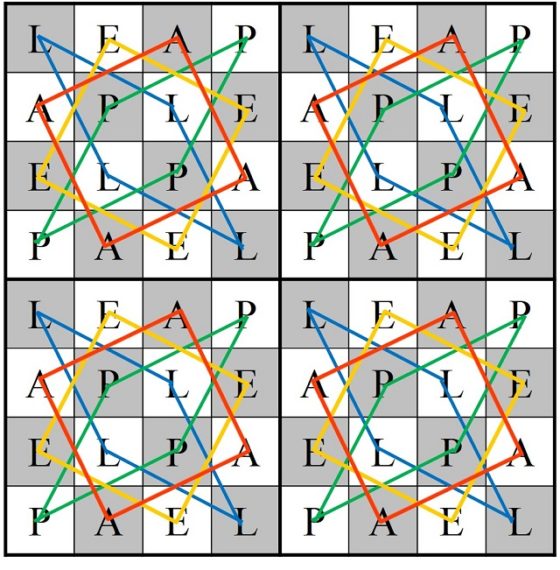

A pesar de todos los resultados negativos que hemos mostrado sobre la obtención de recorridos del caballo que generen cuadrados mágicos, sí existen resultados positivos. El orden más pequeño para el que pueden existir recorridos mágicos es n = 12 (cuya constante es 870) y en 2003, el jugador de ajedrez y aficionado a las matemáticas Awani Kumar encontró finalmente cuatro recorridos abiertos del caballo que generan un cuadrado mágico (véase uno de ellos en la siguiente imagen).

Recorrido mágico abierto del tablero 12 x 12, obtenido por Awani Kumar en 2003

Recorrido mágico abierto del tablero 12 x 12, obtenido por Awani Kumar en 2003

Aunque sigue abierto el problema de encontrar recorridos mágicos cerrados sobre el tablero de tamaño 12 x 12.

Curiosamente para el siguiente tamaño posible, 16 x 16 (cuya constante es 2056), se encontraron antes ejemplos. Además, algunos de ellos son de recorridos cerrados. En 1956, utilizando un método desarrollo por Harold J. R. Murray, Helge Emanuel de Vasa (de quien no tengo ninguna referencia) y el empleado de banca aficionado a las matemáticas y al ajedrez británico Theophilus H. Willcocks (1912-2014), obtuvieron los primeros ejemplos de recorridos mágicos para el tablero 16 x 16. Los dos ejemplos de H. E. de Vasa, que son recorridos cerrados, se publicaron en 1962, en el libro Les secrets du cavalier, le problème d’Euler (Los secretos del caballo, el problema de Euler) de G. D’Hooghe, y en 1968, en un artículo de T. H. Willcocks en Recreational Mathematics Magazine. El ejemplo de T. H. Willcocks, que es un recorrido abierto, fue publicado en 1968 en un artículo en Journal of Recreational Mathematics.

Recorrido mágico cerrado sobre el tablero 16 x 16, obtenido por H. E. de Vasa en 1956 y publicado en 1968. Imagen de la Concise Encyclopedia of Mathematics de Eric W. Weisstein

Recorrido mágico cerrado sobre el tablero 16 x 16, obtenido por H. E. de Vasa en 1956 y publicado en 1968. Imagen de la Concise Encyclopedia of Mathematics de Eric W. Weisstein

Se han obtenido recorridos mágicos para tableros de tamaños 20 x 20, 24 x 24, 32 x 32 y 48 x 48, como puede verse en las notas sobre el recorrido del caballo de George Jelliss: Knight’s Tour Notes.

Super-ajedrez (1937), del artista suizo-alemán Paul Klee (1879-1940)

Super-ajedrez (1937), del artista suizo-alemán Paul Klee (1879-1940)

Bibliografía:

1.- Raúl Ibáñez, Del ajedrez a los grafos, la seriedad matemática de los juegos, El mundo es matemático, RBA, 2015.

2.- Édouard Lucas, Recreaciones Matemáticas, vol. 1 – 4, Nivola, 2007, 2008.

3.- Miodrag S. Petrovic, Famous Puzzles of Great Mathematicians, AMS, 2009.

4.- Harold J. R. Murray, A History of Chess (Historia del ajedrez), Oxford University Press, 1913.

5.- W. W. Rouse Ball, H. S. M. Coxeter, Mathematical Recreations and Essays, Dover Publications, 1987 (originalmente publicada por W. W. R. Ball en 1892 –la versión original puede encontrarse en el Proyecto Gutenberg – y extendida por el geómetra H. S. M. Coxeter en 1974)

6.- John J. Watkins, Across the Board: The Mathematics of Chessboard Problems, Princeton University Press, 2004.

7.- John D. Beasley, Magic Knight`s Tours, The College Mathematical Journal, vol. 43, no. 1, pp. 72 – 75, 2012.

8.- George Jelliss, Knight’s Tour Notes, 2019.

Sobre el autor: Raúl Ibáñez es profesor del Departamento de Matemáticas de la UPV/EHU y colaborador de la Cátedra de Cultura Científica

El artículo ¿Existen recorridos mágicos del caballo en el tablero de ajedrez? se ha escrito en Cuaderno de Cultura Científica.

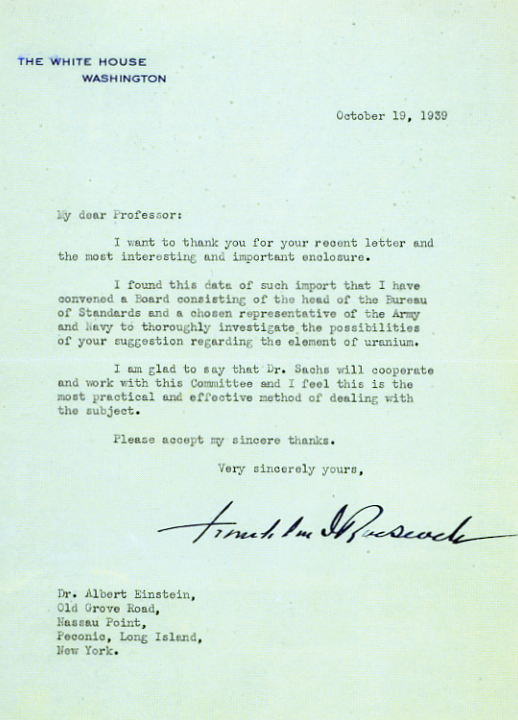

Einstein y Franklin D. Roosevelt

El ya mundialmente famoso Albert Einstein emigró a Estados Unidos en el otoño de 1933. Poco después, él y su mujer fueron invitados a cenar por el presidente Roosevelt. El 24 de enero de 1934 tuvo lugar la cena, y el matrimonio Einstein pasó la noche la Casa Blanca. Años después, la relación establecida aquella velada animó a Einstein a escribir una carta a Roosevelt que contribuiría a cambiar el curso de la historia.

La respuesta de Roosevelt a la carta de Einstein. Fuente: Wikimedia Commons

La respuesta de Roosevelt a la carta de Einstein. Fuente: Wikimedia CommonsLa invitación inicial a cenar en la Casa Blanca vino tras la insistencia del rabino Stephen Wise. Alarmado por las políticas racistas de Alemania y ante lo que él creía inacción de Roosevelt, Wise usó sus contactos para convencer a un asesor del presidente para que el presidente recibiera a Albert Einstein, argumentando que, de no hacerlo, sería un desprecio hacia los judíos. La esperanza de Wise era que Einstein pudiera explicarle de primera mano la situación que estaba viviendo su pueblo en Alemania. La invitación fue enviada por la Casa Blanca sólo dos semanas después de la llegada de Einstein; sin embargo, esa primera invitación fue, increíblemente, rechazada.

En 1930 se había fundado el Instituto de Estudios Avanzados en Princeton, del que se había hecho cargo su primer director, Abraham Flexner. Contratar a Einstein había sido una maniobra genial (y de suerte) por parte de Flexner, y una que algunas veces el mismo Flexner valoró con satisfacción y otras con arrepentimiento. Einstein, el científico más famoso del mundo, le proporcionó al recién fundado Instituto prestigio inmediato, esta era la parte buena para Flexner. Pero Einstein era también el judío vivo más famoso, y esto era malo o, al menos, preocupante para Flexner, él mismo judío. Cuando Albert y Elsa Einstein llegaron al puerto de Nueva York el 17 de octubre de 1933, recibieron una nota de Flexner antes de desembarcar. Decía: “Hay bandas organizadas de nazis irresponsables en este país […] su seguridad en Estados Unidos depende del silencio y de abstenerse de aparecer en actos públicos”. Flexner había sido advertido por el subsecretario de estado Phillipps de que Einstein debía mantener un perfil bajo, pero Einstein sospechaba que lo que estaba en juego no era tanto su seguridad como la tranquilidad de Flexner.

Flexner abría todo el correo que llegaba al Instituto para Einstein. Fue Flexner el que telefoneó al secretario de prensa de la Casa Blanca para declinar la invitación alegando que el profesor Einstein había venido para investigar, no para dedicarse a la política. Cuando Einstein se enteró, accidentalmente, de lo que había pasado, a la vergüenza que sintió por lo que el presidente de la nación que le acogía podía haber pensado, se unió la furia contra Flexner. Finalmente, se decidió a escribir a Eleanor Roosevelt, explicando lo sucedido, y poco después llegaba una segunda invitación.

El encuentro entre los Einstein y los Roosevelt es evidente que fue agradable. Sin embargo, ninguna de las partes comentaría demasiado qué había sucedido o de qué se había hablado. Eleanor Roosevelt escribiría a una amiga: “los Einstein llegaron […] y son únicos, tan alemanes y tan sencillos, con muchas sabias y delicadas cualidades alemanas”. Parece ser, por un comentario posterior que habría hecho Elsa, que Roosevelt propuso a Einstein que aceptara una ciudadanía honorífica, tal y como proponían dos miembros del Congreso, pero Einstein habría declinado el trato especial. Einstein sí parece que llegó a conectar a nivel personal con Roosevelt pues, según su amiga Frieda Bucky, habría dicho: “Lamento que Roosevelt sea presidente, de otro modo le visitaría a menudo”.

Si bien este encuentro no tuvo demasiadas consecuencias, el siguiente contacto de Einstein con Roosevelt puso al físico a la vanguardia de la era atómica. Los descubrimientos realizados en 1938 tenían a los físicos alborotados con las posibilidades que podía tener el estudio del uranio. Algunos comentarios de científicos alemanes a sus colegas americanos sobre las nuevas técnicas para romper átomos de uranio, y emplear la enorme energía que se liberaría, alarmaban a los que estaban preocupados con la posibilidad de que la Alemania de Hitler consiguiese una ventaja tecnológica de ese calibre, con usos militares tan evidentes. Siendo conocedor de estos nuevos desarrollos y temeroso de la destructividad de la Alemania nacionalsocialista, Einstein firmó el 2 de agosto de 1939, un mes antes de la invasión de Polonia, una de las cartas más famosas de la historia [se puede leer aquí]. Escrita en su mayor parte por Leó Szilárd, con la colaboración de Edward Teller y Eugene Wigner, en ella Einstein alertaba a Roosevelt del peligro y lo animaba a actuar primero, proveyendo fondos gubernamentales para la investigación. Si bien la carta no llevó a la acción inmediata, ciertamente fue la primera vez que Roosevelt fue consciente de lo que la nueva física podía significar para el desarrollo armamentístico. Roosevelt respondió el 19 de octubre.

Años después, en 1942, con Estados Unidos en guerra tras el ataque japonés a Pearl Harbour en diciembre de 1941, se puso en marcha el proyecto Manhattan, que terminaría con la construcción y detonación de la primera bomba atómica. Aquella carta fue la única contribución, indirecta, al proyecto por parte de Einstein. Su pacifismo y sus “sentimientos filocomunistas” impidieron que el F.B.I. emitiese la autorización para que se le invitase a participar plenamente. Pero esta es otra historia.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

Una versión anterior de este artículo se publicó en Experientia Docet el 16 de mayo de 2010.

El artículo Einstein y Franklin D. Roosevelt se ha escrito en Cuaderno de Cultura Científica.

¿Cuándo acabó el vulcanismo lunar?

A pesar de que la Luna es nuestro vecino planetario más cercano, todavía nos quedan muchísimas dudas por resolver sobre su evolución a nivel geológico y cuál ha sido el grado de actividad geológica a nivel interno, incluyendo el vulcanismo lunar, que ha mantenido a lo largo del tiempo. Conocer estos detalles nos ayudaría a hacer nuevos modelos sobre la estructura y composición del interior de nuestro satélite y a comprender mejor su historia.

Para poder resolver todas estas dudas, tenemos que hacer uso de distintas técnicas: desde las observaciones de satélite que nos permiten conocer a grandes rasgos las edades de las unidades rocosas de la superficie lunar a través de las imágenes, a la instalación de sismómetros en la superficie lunar que nos permitan, mediante el cambio en las propiedades de las ondas sísmicas, conocer mejor las distintas capas que conforman su estructura interna.

No podemos olvidar que también necesitamos analizar rocas lunares en nuestros laboratorios, que a través de las técnicas modernas de datación y análisis nos pueden aportar una gran cantidad de información. Disponemos de una gran cantidad de rocas lunares traídas en su mayoría durante la década de los 60 y 70 por misiones como las norteamericanas Apollo o las soviéticas Luna.

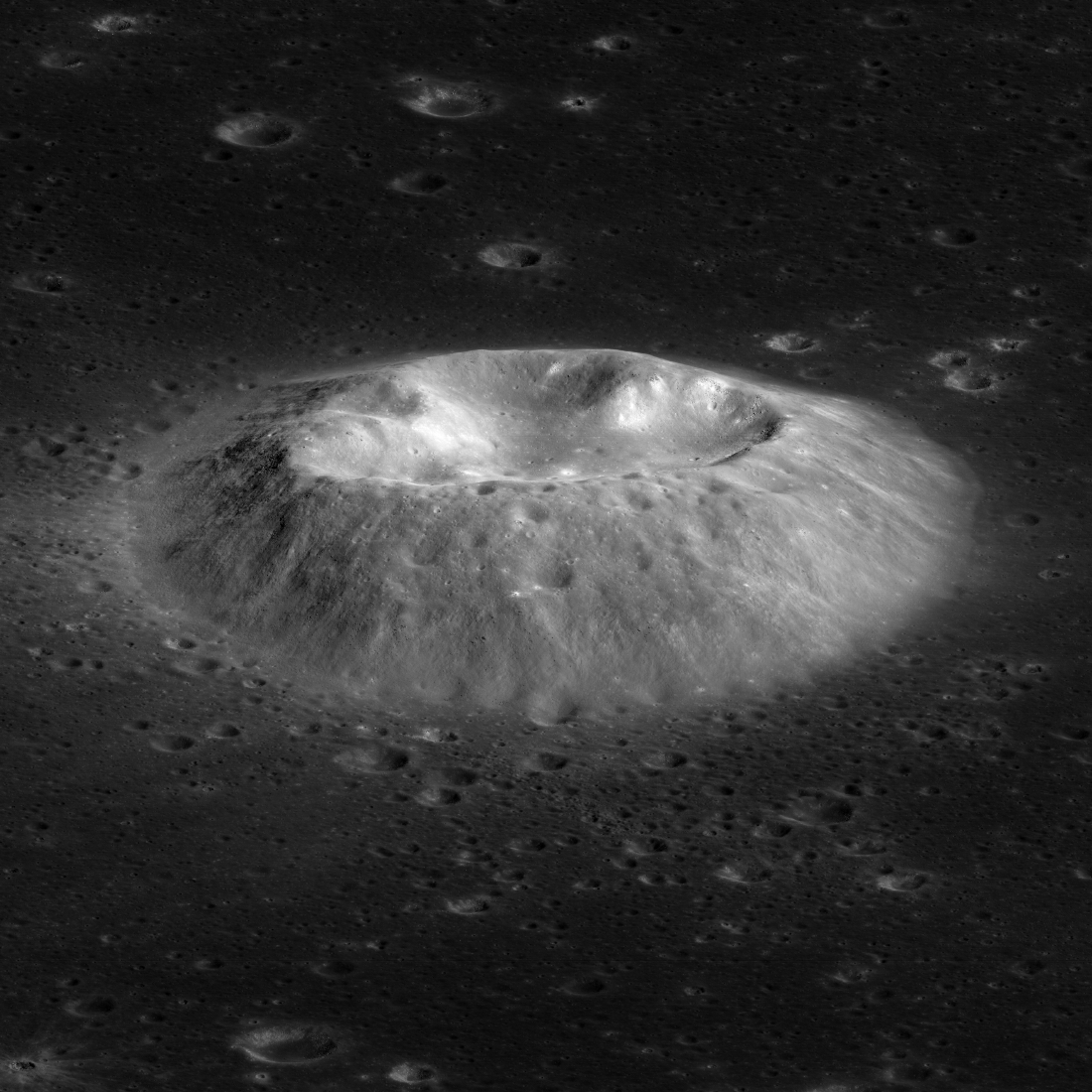

Imagen oblicua de un posible volcán en Oceanus Procellarum. Cortesía de NASA/GSFC/Arizona State University.

Imagen oblicua de un posible volcán en Oceanus Procellarum. Cortesía de NASA/GSFC/Arizona State University.La gran cantidad de muestras retornadas arrojan una edad cercana o superior a los 3000 millones de años, actividad concentrada especialmente entre los 3800 y los 3100 millones de años, lo que hacía a los científicos pensar que la Luna había perdido una gran parte -si no toda- de su actividad volcánica hace muchísimo tiempo.

Cuatro décadas -y algunos años después- de la última misión de retorno de muestras lunares, el 16 de diciembre de 2020 llegaban a la Tierra algo más de un kilo y setecientos gramos de nuevos materiales rocosos traídos por la sonda de la agencia espacial china Chang’e 5 que son los responsables de empezar a cambiar nuestra visión sobre la edad del vulcanismo lunar.

La Chang’e 5 aterrizó en Oceanus Procellarum, uno de los grandes mares lunares formados por la acumulación de lava fruto de erupciones continuadas en la superficie lunar. Precisamente en este lugar los científicos habían observado la existencia de formas volcánicas más jóvenes -en apariencia- de lo esperado.

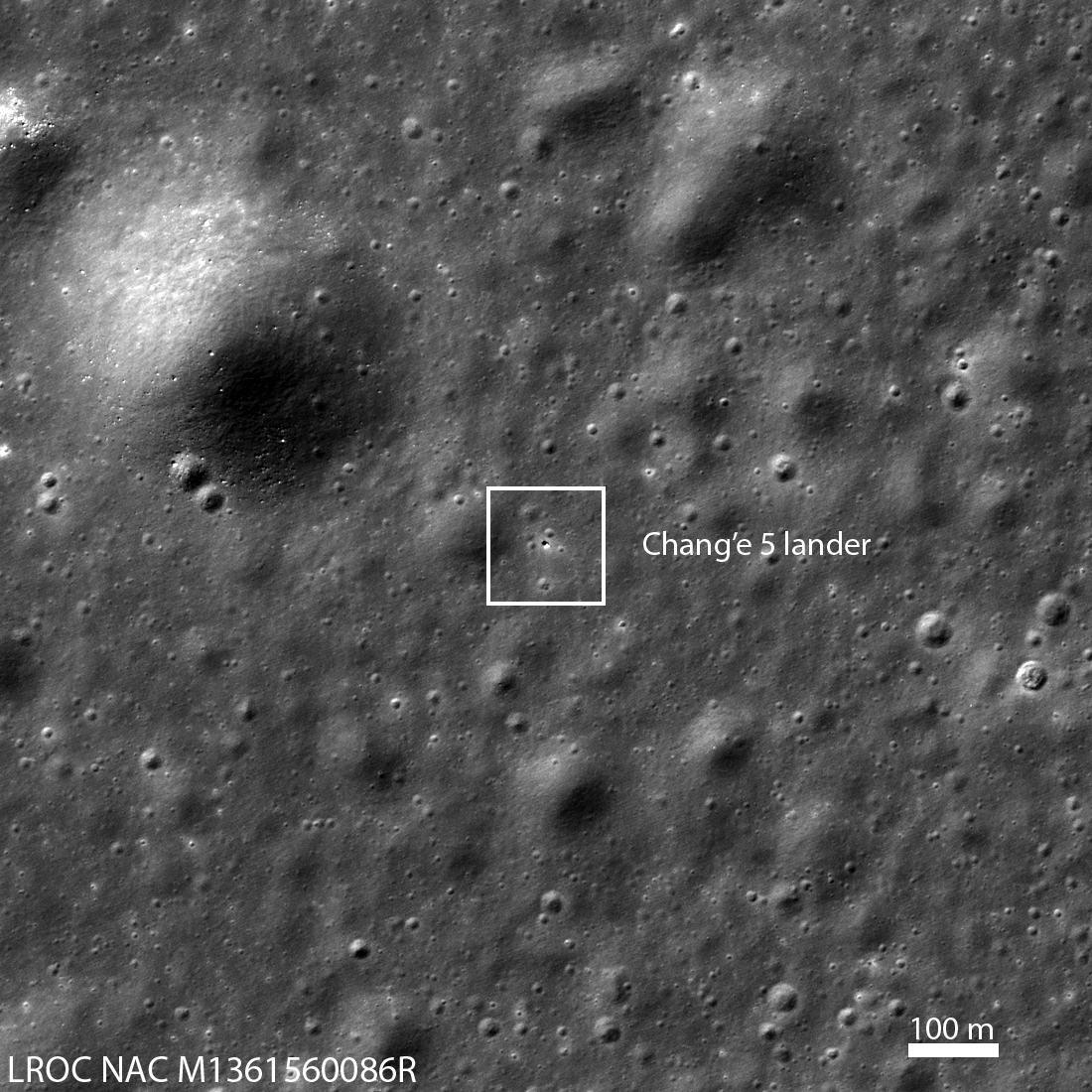

Lugar de aterrizaje de la Chang’e 5. Cortesía de NASA/GSFC/Arizona State University.

Lugar de aterrizaje de la Chang’e 5. Cortesía de NASA/GSFC/Arizona State University.¿Cómo podemos calcular aproximadamente la edad de las superficies planetarias? Pues lo hacemos a través de las imágenes: Cuanto más tiempo permanece una superficie expuesta a la colisión de otros cuerpos, más cráteres acumulará y, por lo tanto, más antigua será. Hoy día, mediante las técnicas de contaje de cráteres, se puede calcular una edad aproximada.

Pero también los impactos más pequeños y otros procesos pueden ir erosionando su forma original, haciendo que vaya difuminándose o suavizándose con el tiempo, algo parecido a como ocurre en nuestro planeta con los procesos atmosféricos.

¿Qué mecanismos podrían haber alimentado un vulcanismo que aparentemente era más tardío -y reciente- en la Luna? Al principio, los científicos se preguntaron si la presencia de elementos radioactivos -que al desintegrarse generan calor- era la responsable de esta anomalía, pero las muestras tomadas por la Chang’e 5 mostraban una cantidad de estos muy inferior a la esperada como para que fuese suficiente para generar este calor adicional capaz de provocar la fusión de las rocas y la formación de magmas.

Otra de las posibilidades era que las rocas tuviesen un mayor contenido en agua, lo que hubiese permitido bajar la temperatura de fusión y, por lo tanto, facilitar la formación de los magmas, pero tampoco era así.

Entonces, ¿qué fenómenos podrían estar ocasionando estos episodios de vulcanismo más reciente? Los autores de un nuevo estudio sugieren que la clave se encuentra en la mineralogía de las rocas, ya que han encontrado minerales ricos en calcio y titanio como los clinopiroxenos y la ilmenita.

Fotografía de un basalto con ilmenita traído por la misión Apollo XVII. Cortesía de JSC/NASA.

Fotografía de un basalto con ilmenita traído por la misión Apollo XVII. Cortesía de JSC/NASA.Esta asociación de minerales se habría empezado a formar poco después del origen de la Luna, pero habrían continuado formándose y acumulándose durante la fase de enfriamiento gradual del satélite, probablemente en la base de la corteza. Debido a su mayor densidad -más que la del manto- habrían ido hundiéndose gradualmente hacia el núcleo, bajando la temperatura de fusión del manto, promoviendo su circulación, y permitiendo que el vulcanismo continuase hasta hace unos 2.000 millones de años.

Los autores, además, concluyen que el magma responsable de la formación de estas rocas apareció a unas profundidades similares a las que lo hizo el que dio lugar a las rocas que trajeron los astronautas de las misiones Apollo, pero que aproximadamente tenía una temperatura de unos 80 °C menos, por lo que además se puede observar como ha existido un enfriamiento lento y gradual del manto en los mil millones de años que separan las muestras traídas por las misiones Apollo y la Chang’e 5.

Sin duda, este estudio abre la posibilidad de crear nuevos modelos geoquímicos y geodinámicos que nos permitirán conocer un poco mejor la historia de nuestro satélite, pero también a decidir que lugares pueden ser los más interesantes de cara a traer nuevas muestras que puedan ayudarnos a desvelar los secretos del vulcanismo lunar.

Bibliografía:

Li, Q.-L., Zhou, Q., Liu, Y., Xiao, Z., Lin, Y., Li, J.-H., Ma, H.-X., Tang, G.-Q., Guo, S., Tang, X., Yuan, J.-Y., Li, J., Wu, F.-Y., Ouyang, Z., Li, C., & Li, X.-H. (2021). Two-billion-year-old volcanism on the Moon from chang’e-5 basalts. Nature, 600 (7887), 54–58. doi: 10.1038/s41586-021-04100-2

Su, B., Yuan, J., Chen, Y., Yang, W., Mitchell, R. N., Hui, H., Wang, H., Tian, H., Li, X.-H., & Wu, F.-Y. (2022). Fusible mantle cumulates trigger young mare volcanism on the Cooling Moon. Science Advances, 8 (42). doi: 10.1126/sciadv.abn2103

Sobre el autor: Nahúm Méndez Chazarra es geólogo planetario y divulgador científico.

El artículo ¿Cuándo acabó el vulcanismo lunar? se ha escrito en Cuaderno de Cultura Científica.

La gota y la fruta

Foto: Naveed Pervaiz / Unsplash

Foto: Naveed Pervaiz / UnsplashSi le hacen análisis de sangre con frecuencia, es posible que recuerde cuál suele ser su concentración de ácido úrico. No es aconsejable que tenga usted más de 7 mg por decilitro (mg/dL); los valores normales se encuentran entre 3,6 y 6,5 mg/dL y entre 2,5 y 6,5 mg/dL, en hombres y mujeres respectivamente. El ácido úrico es muy insoluble, por lo que tiene la mala costumbre de formar cristales y acumularse en lugares donde puede hacer mucho daño.

Lo que quizás no sepa es que la mayoría de los mamíferos tienen concentraciones de ácido úrico mucho más bajas que las nuestras, entre 1 y 2 mg/dL. No se trata de una excepción exclusivamente humana. El fenómeno es común a dos familias de primates, Hylobatidae (gibones) y Hominidae (grandes simios), esto es, orangutanes, gorilas, chimpancés, bonobos y seres humanos. Todos nosotros carecemos de uricasa, la enzima que permite que se degrade el ácido úrico a sustancias más solubles, que son después eliminadas en la orina.

Ya hace unos 60 Ma (millones de años), cuando los primates divergieron del resto de mamíferos, se empezaron a producir cambios en la uricasa que provocaron una pérdida progresiva de su capacidad catalítica. Pero para las dos familias antedichas las cosas cambiaron de forma mucho más drástica hace cerca de 20 Ma. Desde entonces, en los dos linajes -gibones, por un lado, y grandes simios, por el otro- y de forma paralela, se ha producido lo que, en jerga genética, se denomina una pseudogenización. En otras palabras: el gen del que depende la producción de uricasa está averiado, no produce la enzima y, como consecuencia de ello, nuestros niveles de úrico en sangre son muy altos, entre 3 y 10 veces más que los de los demás mamíferos.

Lo sorprendente es que los cambios que averiaron el gen de la uricasa se extendieran y hayan perdurado en el tiempo. Si los efectos de la pseudogenización, por no limitar las posibilidades de dejar descendencia a los individuos afectados, fuesen simplemente neutros, podría ocurrir que hubiese individuos con el gen averiado y otros con el gen funcional. Pero si todos los individuos de las especies afectadas carecen de la capacidad para degradar ácido úrico, es posible que de ello se derive alguna ventaja.

Hay evidencias empíricas, observacionales y experimentales, de que el ácido úrico facilita la conversión de la fructosa -el azúcar característico de la fruta- en grasas. Esto es una mala noticia para quienes tenemos alto el ácido úrico y comida abundante a diario. Pero quizás sea buena para quienes tienen acceso a abundante fruta en ciertos periodos del año, pero sufren privación durante largos periodos de tiempo, probablemente en invierno.

Cabe especular, por tanto, con la posibilidad de que hace entre 15 y 20 Ma, al comienzo del Mioceno, cuando se enfrió el planeta, el entorno en el que vivía el ancestro común de los grandes simios, y también el de los gibones, se hiciese más estacional de lo que era, con inviernos más severos. De ese modo, los frutos, uno de los principales sustentos de nuestros antepasados, pudieron desaparecer o escasear mucho durante el invierno, de manera que habría resultado de gran valor contar con un mecanismo mediante el que la fruta disponible en periodos de abundancia pudiese transformarse en reservas de energía que ayudasen a superar el invierno hasta la llegada de la siguiente estación de bonanza.

Si tiene el úrico alto o, incluso, padece de episodios de gota, esta hipótesis seguramente no le dará ningún consuelo, pero al menos le ayudará a entender mejor la causa última de su infortunio.

Para saber más:

Un gen ahorrador

El caso de la dieta de los esquimales

Fuentes:

Richard J. Johnson, Peter Andrews (2010): Fructose, Uricase, and the Back-to-Africa Hypothesis, Evolutionary Anthropology 19:250–257.

James T. Kratzer et al. (2014): Evolutionary history and metabolic insights of ancient mammalian uricases. PNAS 111 (10) 3763-3768. doi: 10.1073/pnas.1320393111

El artículo La gota y la fruta se ha escrito en Cuaderno de Cultura Científica.

Naukas Bilbao 2022: La señora de los anillos

Son fascinantes, relativamente desconocidos y rodean a más de cuatro planetas, aunque también visten a los llamados “enanos” y a los “centauros”. Son los extraordinarios anillos del Sistema Solar -y más allá-, formaciones que hasta hace poco creíamos formadas de partículas muy finas y de las que cada día conocemos más detalles.

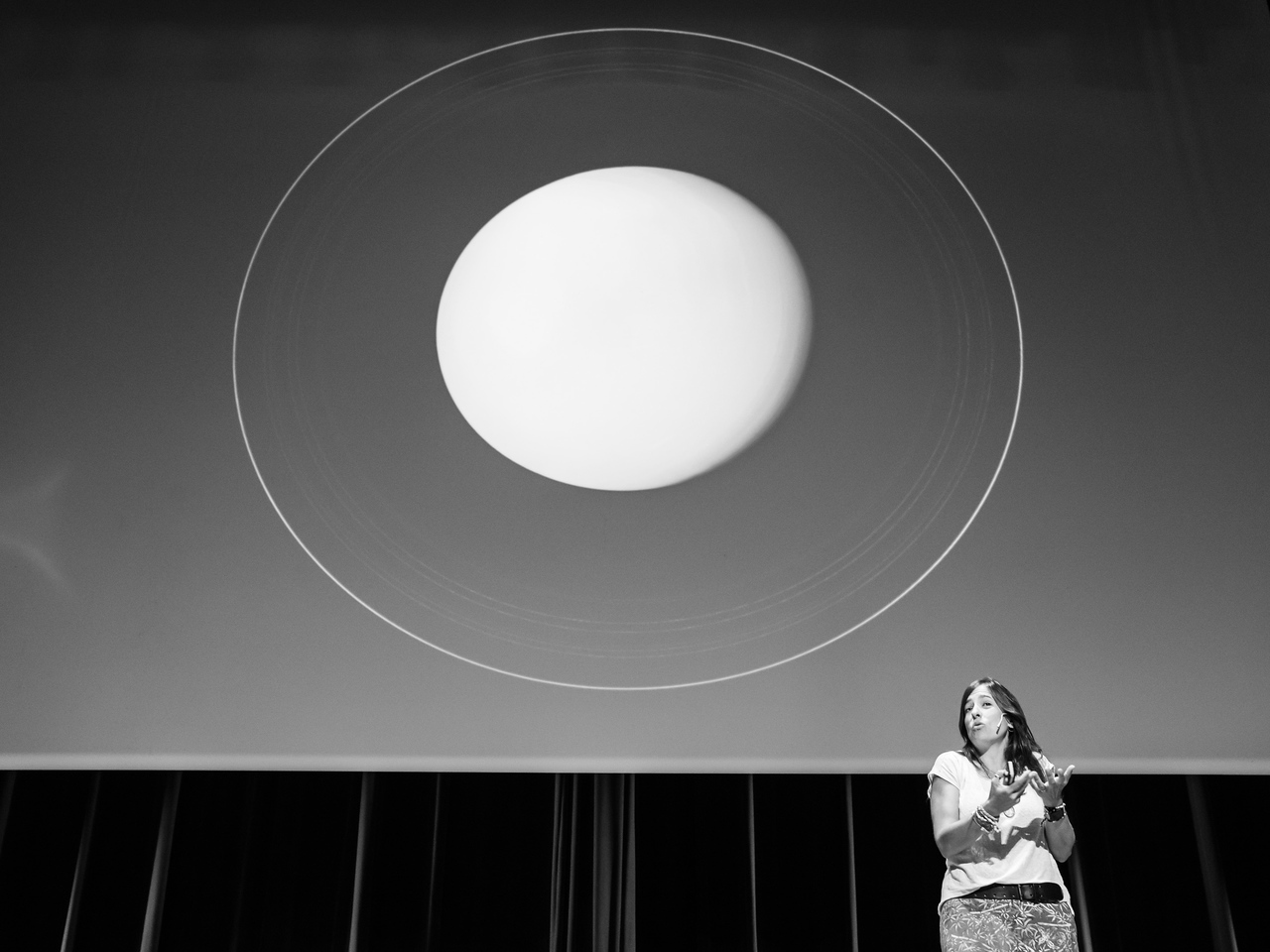

La astrónoma y doctora en Física de la UPV-EHU Naiara Barrado-Izagirre participó en la pasada edición de Naukas Bilbao para ofrecer datos significativos, aportar imágenes inéditas sobre estas fantásticas y enigmáticas formaciones, y sobre todo, para responder a muchas dudas sobre este universo. Su exposición arrancó con el que ella misma denominó “el señor de los anillos” del Sistema Solar, Saturno, un planeta plagado de curiosidades. Sus siete anillos “no siempre estuvieron ahí”, sino que fue la misión Cassini la que descubrió que estas formaciones eran coetáneas de los dinosaurios en la tierra, es decir, que se formaron hace alrededor de 100 millones de años.

Tras esta presentación, la astrónoma respondió a dos cuestiones: ¿De qué están compuestos estos siete gigantescos anillos? Y ¿Son formaciones gaseosas, tal y como la propia investigadora sospechaba? Pues no: Naiara Barrado-Izagirre admitió que a pesar de lo que ella misma creía estas formaciones están compuestas de trozos de hielo de diferentes tamaños, que pueden oscilar entre las dimensiones de un autobús y de una mota de polvo.

Y continuó: ¿Cómo se formaron? La experta recordó que un día antes de su exposición se hizo pública una información que revelaba que el origen de estos increíbles anillos pudo ser la fragmentación de una luna en multitud de trozos de cristal, producida por el efecto de la gravedad al aproximarse demasiado al planeta.

Finalmente explicó que las espectaculares formaciones del “señor de los anillos” del Sistema Solar no serán eternas: de hecho, cada día llueven sobre la superficie de Saturno infinidad de trozos de estas formaciones, alrededor de una tonelada por segundo, algo que ha llevado a los científicos a calcular que los anillos de Saturno desaparecerán en unos 300 millones de años.

Las explicaciones sobre Saturno le llevaron a realizar varios apuntes sobre el resto de los cuatro planetas del Sistema Solar que están rodeados por anillos. La científica mencionó el caso de Júpiter e incluso aportó una imagen exclusiva procesada por su compañero Ricardo Hueso unos días antes: explicó que estos anillos, que son mucho más “tenues” que los de Saturno y muy difíciles de observar desde la Tierra, fueron descubiertos por las sondas espaciales Voyager hace 45 años y están integradas por partículas de tierra minúsculas, del diámetro de un cabello humano.

El caso de Urano es diferente: su sistema es “mucho más desconocido” porque se trata de un planeta del que apenas se tienen datos. Lo que sí se sabe es que cuenta con un sistema de 13 aros mucho más finos, que también están integrados por cristales de hielo y por componentes orgánicos probablemente oscurecidos a causa de la radiación. Su repaso a los planetas anillados del Sistema Solar concluyó con Neptuno, del que dijo que sus cinco anillos son más parecidos a los de Júpiter y su composición es orgánica aunque con una proporción mayor de polvo, de entre un 20 y un 70%.

Pero, ¿son los planetas los únicos astros con anillos? ¿Solo se han descubierto estas formaciones en el Sistema Solar? Naiara Barrado-Izagirre respondió con un “no” a ambas preguntas: algunos planetas enanos y centauros son también anillados, mientras que fuera de nuestro Sistema Solar se ha descubierto un planeta con “el sistema más impresionante del Universo”. Se trata del planeta extrasolar J1407B, del que se cree que tiene 37 anillos 200 veces más grandes que los de Saturno.

Y los planetas enanos, ¿qué son y por qué se llaman así? Aunque su nombre apunte a una cuestión de tamaño, los planetas enanos, entre los que se encuentran Plutón, Makemake, Haumea, Eris y Ceres, se denominan así porque incumplen una de las condiciones que deben tener los planetas: además de girar directamente alrededor del sol y de ser lo suficientemente esféricos, los astros convencionales deben haber limpiado la órbita en la que son dominantes o, al menos, ser las formaciones dominantes en ella. Y ninguno de los cuatro cumple esta condición. En el caso de Haumea, miembros del Observatorio de Andalucía observaron su anillo mientras comprobaban sus características, si tenía atmósfera, etc. De esta forma, descubrieron también su forma elipsoidal.

¿Y los centauros? Al margen de su consideración de criatura mitológica, son cuerpos considerados “menores” que se encuentran a caballo entre los asteroides y los planetas, y cuyos anillos son “más densos de lo que se podría esperar”.

Estos ejemplos nos muestran cómo los anillos, a pesar de encontrarse muy lejanos, se encuentran, al mismo tiempo, cada vez más y más cerca de nosotros.

Si no ve correctamente el vídeo use este enlace.

Para saber más:

¿Por qué Júpiter no tiene unos anillos tan espectaculares como Saturno?

¿Y si los dinosaurios se hubieran extinguido antes de que se formaran los anillos de Saturno?

Crónica de Roberto de la Calle / GUK

El artículo Naukas Bilbao 2022: La señora de los anillos se ha escrito en Cuaderno de Cultura Científica.

Diferencias en la metilación del ARN según el tipo de cáncer de mama

El equipo de investigación BIOMICS de la UPV/EHU ha investigado las variaciones que se aprecian en las moléculas de ARN —que se encargan de transferir la información del genoma a las proteínas— entre las personas que padecen cáncer de mama y entre las que no lo padecen, así como los cambios que se advierten en función de cada subtipo de cáncer. Los resultados del estudio muestran que la metilación del ARN en los tejidos tumorales es menor que en los tejidos sanos. Además, se observan diferencias según el tipo de cáncer de mama.

El cáncer es una enfermedad que depende de muchos factores y, además, hay muchos tipos de cánceres. Es importante identificar cuáles son los factores de riesgo de padecer cáncer: para ello, se analizan los grupos de población y se comparan las características de quienes padecen cáncer con las de quienes no lo padecen; de ese modo, se ve si las personas que lo padecen tienen una mayor o menor probabilidad de contar con una determinada característica.

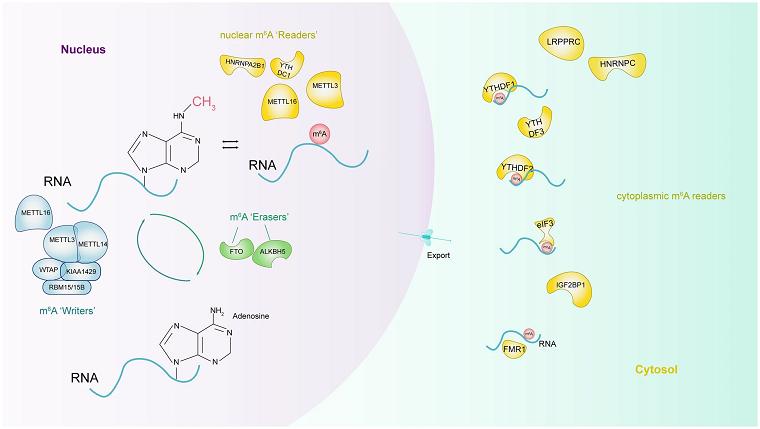

Biología molecular de la metilación del ARN m6A. Fuente: Chen, XY., Zhang, J. & Zhu, JS. (2019) The role of m6A RNA methylation in human cancer. Mol Cancer doi: 10.1186/s12943-019-1033-z

Biología molecular de la metilación del ARN m6A. Fuente: Chen, XY., Zhang, J. & Zhu, JS. (2019) The role of m6A RNA methylation in human cancer. Mol Cancer doi: 10.1186/s12943-019-1033-zEl equipo ha analizado uno de los cambios más frecuentes que se produce en el ARN mensajero: la metilación (adición de un grupo formado por un carbono y tres hidrógenos, en una posición determinada de la molécula de ARN). Un determinado tipo de metilación da como resultado la N6-metiladenosina (m6A). Numerosos estudios han demostrado que la m6A participa en la regulación de la mayoría de los procesos del metabolismo del ARN. Pero aún no se conoce el impacto de este cambio en la regulación de la expresión génica, su función en los procesos celulares y su posible influencia en el desarrollo y avance de enfermedades como, por ejemplo, el cáncer de mama.

Los investigadores han medido la cantidad de m6A presente en el cáncer de mama con el fin de encontrar nuevas dianas terapéuticas en el futuro. “Las metilaciones de m6A son muy frecuentes, ya que se producen para regular la función del ARN. Pero en el cáncer dicha regulación se pierde, y hemos querido observar el papel que juega la metilación del ARN en ese trastorno”, explica Felix Olasagasti, investigador del grupo BIOMICs.

Los resultados muestran que “el porcentaje global de metilación del ARN en los tejidos tumorales es menor que en los tejidos sanos, y la diferencia es significativa”, señala Olasagasti. Además, este es el primer estudio que describe el perfil de metilación de m6A en los diferentes subtipos de cáncer de mama: “Hemos visto que la diferencia detectada en la metilación de las células cancerosas aparece con distinto perfil en función de cada tipo de cáncer de mama. Los cánceres de mama se clasifican según determinadas características. Nosotros hemos visto que, además de las características que se utilizan para dicha clasificación, también hay diferencias en la metilación del ARN en los distintos subtipos de cánceres”.

El investigador subraya la importancia de este hallazgo: “Cuanto mejor conozcamos cómo es o cómo debemos caracterizar cada subtipo de cáncer, más posibilidades tendremos de obtener un tratamiento para combatirlo”. En cualquier caso, el investigador señala que aún queda mucho camino por recorrer. “De este estudio se deduce que la alteración de la metilación podría afectar a las proteínas derivadas de dichos ARN, lo que podría afectar finalmente al carácter canceroso de la célula”. Esa es la hipótesis que manejan los investigadores.

En el estudio han empleado una técnica de secuenciación masiva. “Hemos conseguido un montón de datos. Debemos analizarlos con más detalle para ver en qué genes se producen los cambios. Una vez bien determinados los genes, el siguiente paso sería observar en qué medida afecta eso a las proteínas y ver luego el efecto que eso puede tener. Viendo que el porcentaje de metilación es menor en las células cancerosas, podríamos pensar que aumentar dicho porcentaje podría ayudar a regenerar esas células”. Según Olasagasti, cada uno de esos pasos constituiría un proyecto de investigación.

Para saber más:

¿De dónde viene el cáncer y por qué no ha desaparecido con la evolución?

El cáncer en la nueva era genómica

Referencia:

Tamara Kleinbielen, Felix Olasagasti, Daniel Azcarate, Elena Beristain, Amparo Viguri-Díaz, Isabel Guerra-Merino, África García-Orad, Marian Martínez de Pancorbo (2022) In silico identification and in vitro expression analysis of breast cancer-related m6A-SNPs Epigenetics doi: 10.1080/15592294.2022.2111137

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo Diferencias en la metilación del ARN según el tipo de cáncer de mama se ha escrito en Cuaderno de Cultura Científica.

La Geología según Heracles

Heracles es uno de los héroes de la mitología griega más conocido en la actualidad. Sobre todo, con su nombre latinizado, Hércules. Hijo del dios Zeus y de una mortal, Alcmena, su principal característica era su inconmensurable fuerza y el mal rollo que arrastraba con su madrasta olímpica, Hera. Hasta tal punto llegó el odio que le tenía la diosa, que un día volvió loco al héroe forzándolo a matar, con sus propias manos, a su mujer e hijos. Arrepentido, descubrió que la única manera de vivir de nuevo en paz era ponerse al servicio de otro semidiós, el rey Euristeo, con el que tampoco se llevaba demasiado bien. Así que, buscando fastidiar a Heracles, Euristeo le obligó a cumplir doce trabajos, a cuál más complicado, que le llevaron a patearse el mundo conocido enfrentándose a todo mortal, semidiós o monstruo que se le pusiese por delante. Y parece que uno de esos trabajos trajo a Heracles hasta la Península Ibérica.

Escultura de bronce de Heracles separando las columnas, obra de Ginés Serrán Pagán, erigida en la ciudad de Ceuta. Fuente: Ceuta es turística

Escultura de bronce de Heracles separando las columnas, obra de Ginés Serrán Pagán, erigida en la ciudad de Ceuta. Fuente: Ceuta es turísticaSu décimo trabajo consistía en robar el ganado de Gerión, un monstruo que habitaba en lo que actualmente es Cádiz. Pues según una versión no muy conocida de la historia, en su viaje Heracles atravesó los bosques del norte de la Península y allí se encontró con la ninfa Pyrene, de la que se enamoró perdidamente. Pero el padre de la muchacha no estaba muy de acuerdo con esa relación, por lo que expulsó al héroe de sus tierras y prohibió a la pareja volver a verse. Entonces, Gerión se encontró con la joven y también se enamoró de ella, pero Pyrene no le hizo ni caso porque aún pensaba en Heracles. Gerión, un abusador en toda regla, persiguió a la muchacha hasta lo profundo del bosque con la intención de raptarla, llegando a prenderle fuego para hacerla salir de su escondite. Aunque consiguió todo lo contrario, ya que Pyrene prefirió morir abrasada a caer en sus manos. Cuando Heracles se enteró de lo que pasaba corrió a salvarla, pero llegó tarde. Roto de dolor, decidió hacerle un túmulo funerario como nunca antes se había visto, por lo que se puso a apilar rocas sin cesar. Pero se le fue un poco la mano, llegando a crear un enorme mausoleo rocoso al que llamó Pirineos en honor a la joven.

Volviendo a la versión más conocida de la historia, Heracles cruzó el Mediterráneo para llegar hasta los dominios de Gerión, pero se encontró con que una masa de tierra separaba el mar del océano Atlántico y no le permitía avanzar. Como dar un rodeo no era una opción y haciendo honor a lo bruto que era, separó la cordillera que estaba unida dejando un estrecho pasillo de agua, el estrecho de Gibraltar. Y para conmemorar su hazaña, levantó dos montes uno a cada lado del estrecho, uno en el actual Gibraltar y otro en la actual Ceuta, que pasaron a la posteridad con el nombre de “las Columnas de Hércules”.

Dejando de lado la mitología y acudiendo a la ciencia, lo más llamativo de estas leyendas es que se le da un mismo origen a la cordillera de los Pirineos y las montañas del Arco de Gibraltar. Incluso, se cuenta que el estrecho estuvo cerrado y surcado por una cordillera continua entre el sur de la Península Ibérica y el norte de África que luego se separó, permitiendo así la conexión entre el Mediterráneo y el Atlántico. Y digo que es llamativo porque, con algunos matices, geológicamente hablando todo esto es cierto.

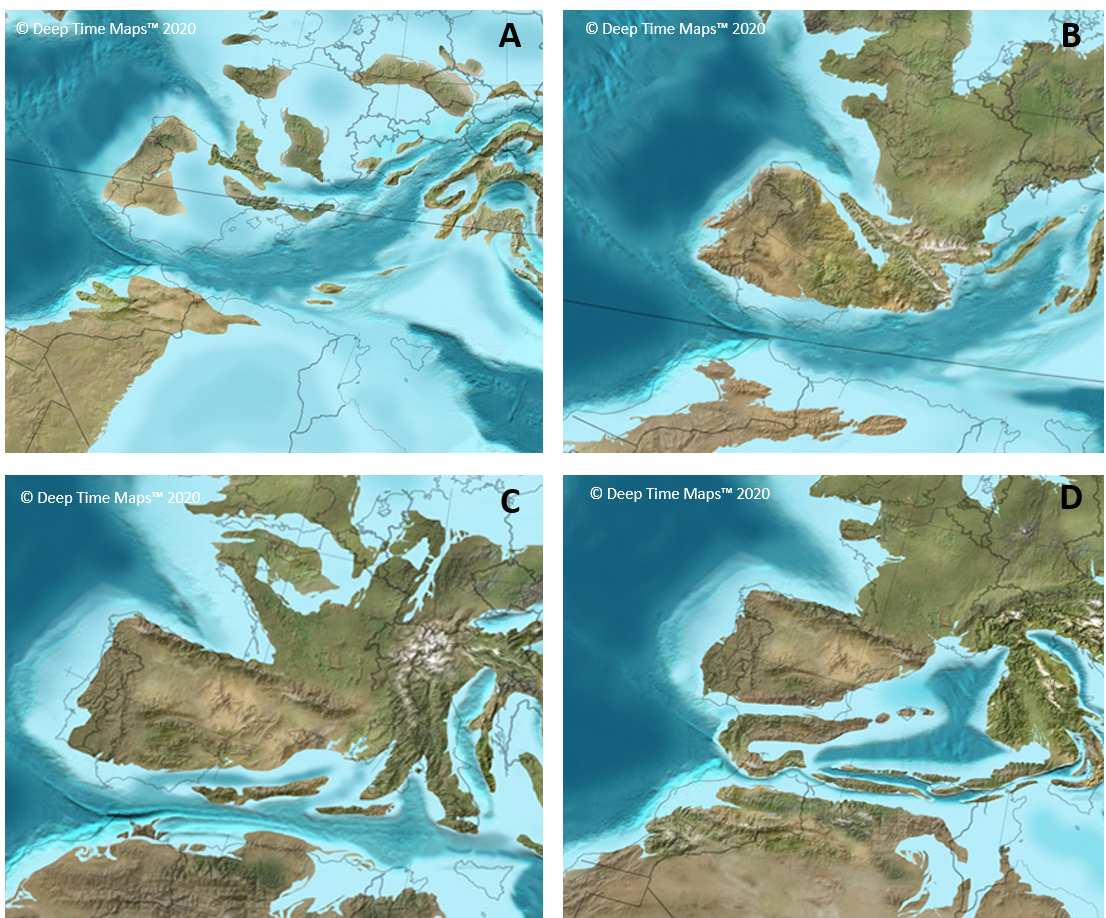

Reconstrucciones paleogeográficas de la Península Ibérica durante diversas fases de la Orogenia Alpina. A) Cretácico, hace 75 millones de años; B) Eoceno, hace 50 millones de años; C) Oligoceno, hace 25 millones de años; y D) Mioceno, hace 13 millones de años. Fuente: Deep Time Maps

Reconstrucciones paleogeográficas de la Península Ibérica durante diversas fases de la Orogenia Alpina. A) Cretácico, hace 75 millones de años; B) Eoceno, hace 50 millones de años; C) Oligoceno, hace 25 millones de años; y D) Mioceno, hace 13 millones de años. Fuente: Deep Time MapsSi cambiamos el nombre Heracles por Orogenia Alpina, ya tenemos la explicación científica. Una orogenia es el proceso de formación de sistemas montañosos por la colisión de dos placas con litosfera continental y la Orogenia Alpina es el último de estos procesos, que comenzó hace unos 80 millones de años y continúa en la actualidad. En este periodo, la placa Africana y la placa Euroasiática se han ido acercando una a la otra, quedando la microplaca Ibérica aprisionada entre ambas. De esta manera, el choque de Iberia con Eurasia en el norte dio lugar al levantamiento de los Pirineos, mientras que el choque de Iberia con África en el sur generó la Cordillera Bética y su continuación por las montañas del Rift en una disposición más o menos arqueada. Es decir, que ambas cordilleras se formaron por el mismo proceso geológico.

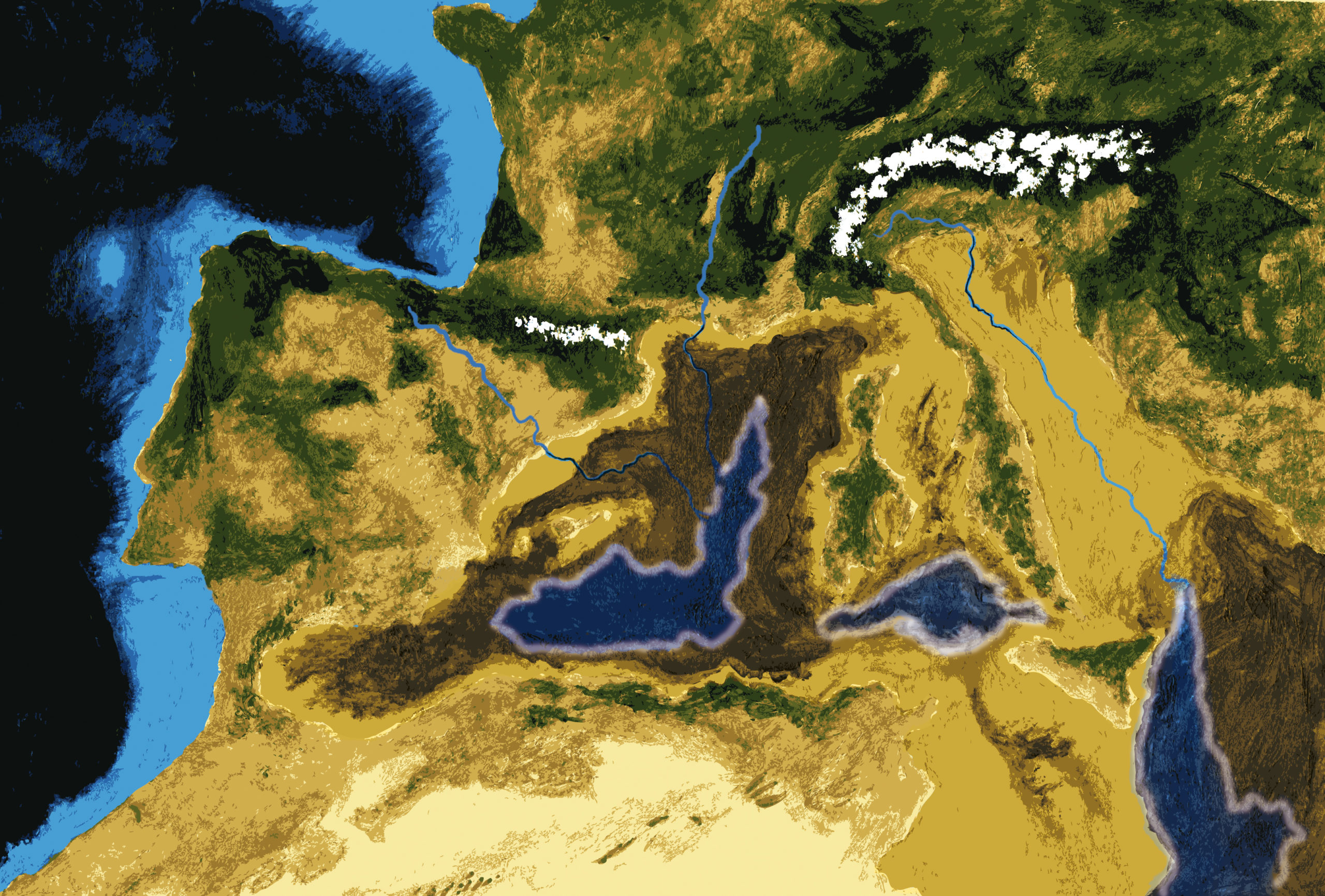

Aspecto del Mediterráneo hace unos 5,5 millones de años, tras el cierre de la conexión con el océano Atlántico. Fuente: Paubahi / Wikimedia Commons.

Aspecto del Mediterráneo hace unos 5,5 millones de años, tras el cierre de la conexión con el océano Atlántico. Fuente: Paubahi / Wikimedia Commons.Pero hay más. Hace casi 6 millones de años, la comunicación entre el Mediterráneo y el Atlántico se vio interrumpida por el continuo acercamiento de las placas Africana e Ibérica, dando lugar al aislamiento y la desecación del Mediterráneo, cuyo nivel llegó a bajar hasta mil metros con respecto a la actualidad. Sin embargo, hace poco más de 5 millones de años, los pulsos tectónicos, combinados con ascensos del nivel del mar, provocaron que el Estrecho de Gibraltar se abriera, dando lugar a un enorme cañón submarino de varios cientos de metros de altura por el que se precipitaba una cascada de agua desde el Atlántico. Así, el Mediterráneo volvió a llenarse rápidamente de agua hasta mostrar el aspecto con el que le conocemos actualmente. A este proceso se le conoce como “Crisis de Salinidad del Messiniense”.

Sé que no he entrado demasiado en detalle con la explicación científica, pero es porque esta vez quería centrarme más en la curiosidad mitológica. Los mitos y leyendas siempre han pretendido dar una explicación más o menos racional a procesos naturales que no éramos capaces de comprender antes del nacimiento de la ciencia. Aunque a veces nos sorprende lo cerca que se encontraban de la verdadera explicación, como suponer que el Mediterráneo quedó aislado del Atlántico por una masa de tierra y que volvió a abrirse por la fuerza de un protagonista que, a su vez, dio lugar a una enorme cordillera en el norte de la Península y a los relieves montañosos del sur de Iberia y el norte de África. Ahora, simplemente, le hemos dado otro nombre a ese protagonista.

Agradecimientos: Quería dar las gracias a mi compañera y amiga Ana Ruiz Constán, científica titular del Instituto Geológico y Minero de España (IGME-CSIC), por recordarme estas leyendas en una agradable conversación geológica.

Sobre la autora: Blanca María Martínez es doctora en geología, investigadora de la Sociedad de Ciencias Aranzadi y colaboradora externa del departamento de Geología de la Facultad de Ciencia y Tecnología de la UPV/EHU

El artículo La Geología según Heracles se ha escrito en Cuaderno de Cultura Científica.

Gloria Conyers Hewitt, la clase de profesora que todo estudiante debería tener

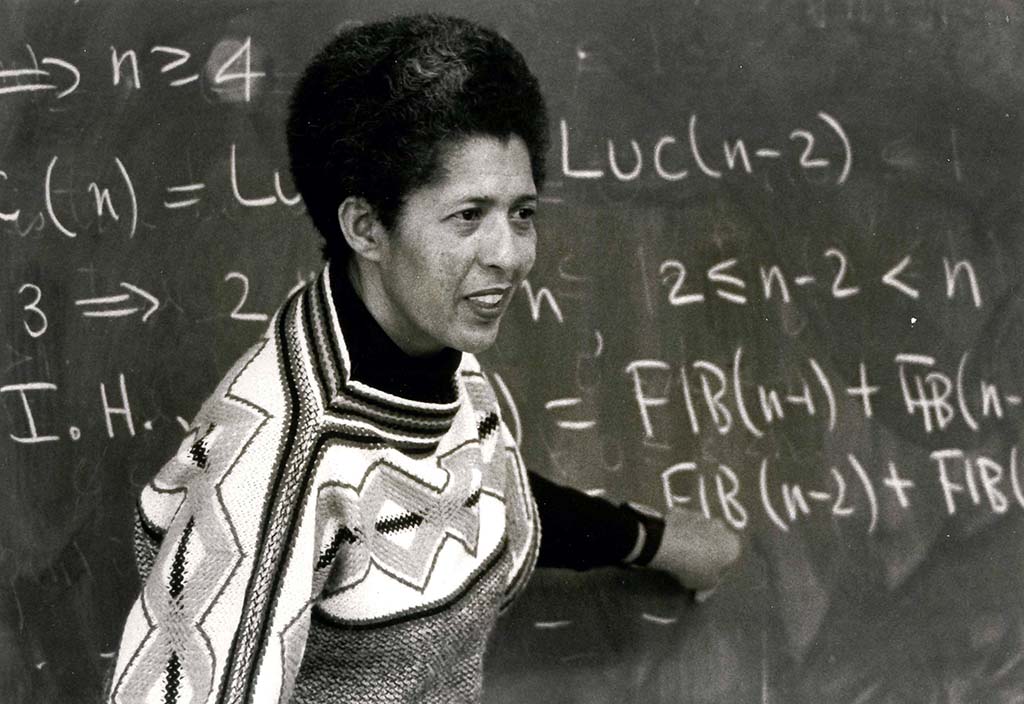

Gloria [Conyers Hewitt] exigía trabajar a sus estudiantes y estaba dispuesta a pasar la cantidad de tiempo necesario para ayudarlos a tener éxito. Era la clase de profesora que todo estudiante debería tener.

Gloria Conyers Hewitt. Fuente: BlackPast.

Gloria Conyers Hewitt. Fuente: BlackPast.

Gloria Conyers nació en Sumter (Carolina del Sur) el 26 de octubre de 1935. Su padre, Emmett C. Conyers, era impresor y su madre, Crenella Clinkscales, maestra. Gloria era la cuarta de los hijos del matrimonio. Sus padres estaban convencidos de que la educación era la única manera de progresar para un afroamericano; por ello animaron a sus tres hijos y a su hija a estudiar.