Ziurgabetasunaren ziurtasuna IPCCren txostenetan

Munduko klimaren bilakaera –kezkaturik– jarraitzen dugunok ikusi dugu nola Munduko Meteorologia Erakundeak (WMO, ingelesez) azaldu duen batez besteko tenperaturaren hogei errekor hautsi direla azken 22 urteetan. Eta joera hori goraka doala: Lurrak laurehun hilabete jarraian izan ditu batezbesteko historikoa gainditu duten tenperaturak; horrela, XX. mendeko erreferentziaren gainetik egon da 33 urtez jarraian.

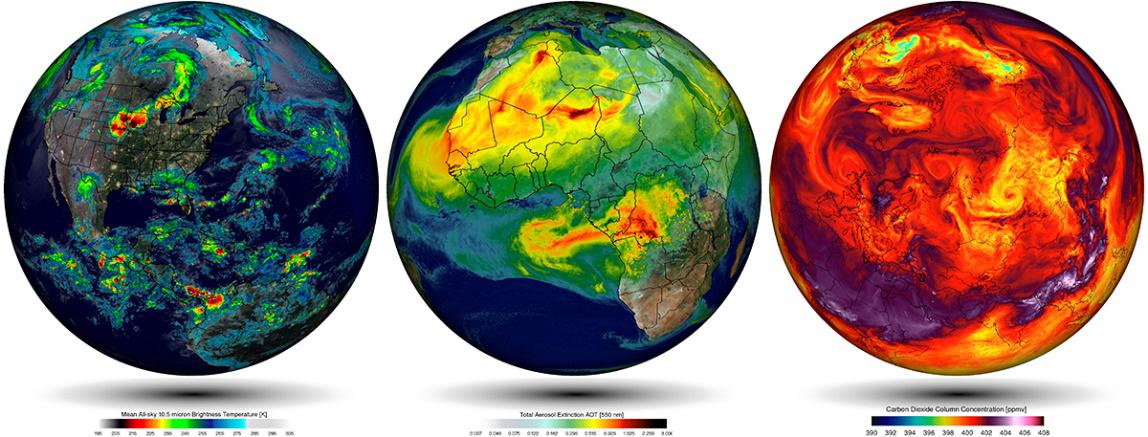

1. irudia: 2017. urteak munduko batez besteko tenperaturaren errekorra hautsi zuen; hala, lehenengo postua kendu zion 2016. urteari, zeinak aurreko bi urteetako marka harrigarria gainditu zuen. (Argazkia: Gerd Altmann / Pixabay)

Klima-aldaketa gertatzen ari dela ziurta dezakegu, eta horrek benetako mehatxua ekarriko du ezagutzen dugun munduarentzat. Gainera, mehatxu hori nagusiki gizakiaren industria jardueragatik sortu dela adierazten dute datu guztiek. IPCCren “Global Warming of 1,5 ºC” txosten bereziak, 2018. urte amaieran argitaratua, argi uzten du: jarduera horrek planetaren tenperatura gutxi gorabehera 1 ºC igo duela uste da, industria garaiaren aurreko mailak kontuan hartzen badira. Hamarkada gutxi batzuetan, atmosferako CO2 kontzentrazioa % 30 igo da, 400 ppm gaindituta, eta orain dela hiru milioi urte datatutako errekorra hautsita. Ez da klimaren bilakaera naturala: ikaragarri nabarmena da, eta ia komunitate zientifiko osoa iritzi berekoa da.

Tresna matematikoak etorkizuna iragartzekoIraganeko klima-aldaketa azken mendean jasotako datuen historikoari esker ziurta daiteke, baina etorkizuna ezagutzeko ez dago behaketa posiblerik. Gure planetak aurre egin beharko dien egoera posibleak aztertu nahi baditugu, simulazio konplexuko ereduen mendean gaude ia esklusiboki, eta horiek azpiereduz osatuta daude, zeinak NASA, UK Met Office, Beijing Climate Center eta halako taldeek etengabe garatzen dituzten.

2. irudia: NASAren Goddard Earth Observing System (GEOS-5) eredu klimatikoa erabiliz lortutako simulazioak. (Iturria: William Putman/NASA/Goddard)

Simulazio horiek lehenago sartutako corpus teoriko baten arabera egiten dira. Adibidez, atmosferako simulazioen kasuan, corpus hori honela osatuta dago: (i) elementu jariakor finituetan aplikatutako Newtonen higidura legeak; (ii) masaren kontserbazio legea; eta (iii) ekuazio termodinamikoak, aire zati bakoitzean beroaren efektua kalkulatzea ahalbidetzen dutenak eguzki izpien balio parametrizatuen bitartez. Hiru osagai horiek soluzio analitiko askaezineko ekuazio diferentzial partzial ez-lineal bihurtzen dira. Hori dela eta, ekuazio jarraituak diskretizatzen dituzten eta horien ebazpenaren hurbilketa bat zehaztea ahalbidetzen duten zenbakizko metodoak aplikatzen dira, modelizazio eta konputagailu simulazio tekniken bitartez.

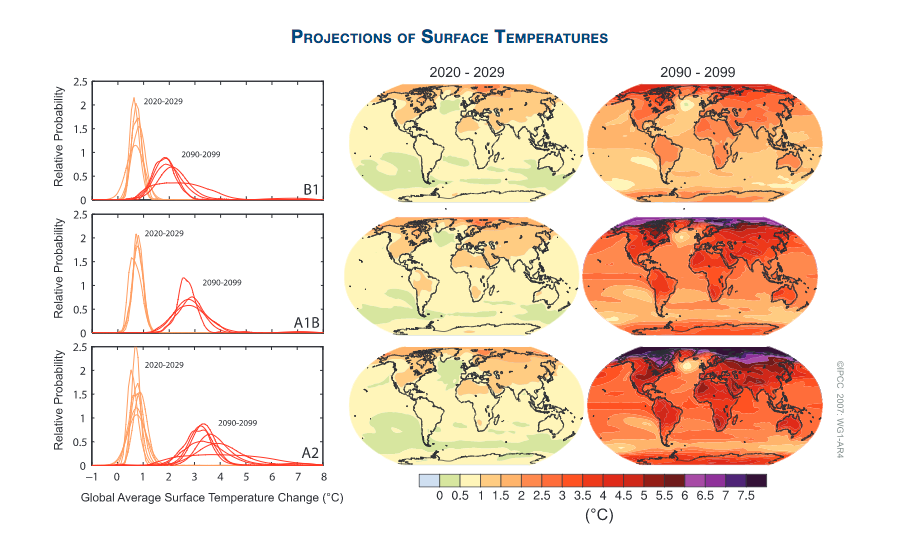

Beste azpieredu batzuekin batera, karbonoaren zikloaren simulazioa edo mugimendu tektonikoa, esaterako, simulazio horiek etorkizuneko egoera posibleak eraikitzeko erabiltzen dira, eta horiek ondorioak arintzeko politikan edo ingurumen-egokitzapenerako politikan –ikatzaren monetizazioa edo geoingeniariatza estrategien aplikazioa, adibidez– erabakiak hartzeko tresnak dira. Hala ere, klima-aldaketa antropogenikoa gidatzen duten mekanismoak ondo ulertzen diren arren, proiekzio horiek ziurgabetasuna adierazten dute emaitzen zehaztasunean. Horien kuantifikazioa da, hain zuzen, adituek politikariei (ez)jakintasuna komunikatzeko erreminta nagusia.

Ziurgabetasunaren iturriakLiteratura espezializatuak ziurgabetasun maila zehazten duten ziurgabetasun epistemikoaren zazpi iturri ere ezartzen ditu:

- Osagaien eta dauden interakzioen azpimultzo bat deskribatzea bakarrik ahalbidetzen duten ereduen egitura.

- Zenbakizko hurbilketak.

- Ebazpen mugatua, mikroeskalako prozesuak parametrizatuak izatea eta, ondorioz, beren efektua –prozesua benetan konpondu gabe– eskala handiko kuantifikazio eskuragarrien arabera deskribatu behar izatea eragiten duena.

- Barne aldakortasun naturala.

- Datuen behaketa.

- Hasierako eta inguruko baldintzak.

- Etorkizuneko egoera ekonomikoa.

Ziurgabetasunaren iturri horiek guztiak eredu bakoitzerako dauden klimaren hainbat irudikapenetatik datoz. Ziurgabetasun horrek oro har jendearengan sortzen duen lehenengo inpresioa da klima-aldaketaren hipotesia, nolabait, zalantzazkoa dela. IPCCren I Taldearen ondorengo txostenetan aurkeztutako ziurgabetasun ereduak ez dira, ordea, klima-aldaketa zalantzazkoa den ala ez argitzeko aurkezten, baizik eta lortutako ereduen kalitatea jakinarazteko eta milaka eta milaka zientzialarik eskuratutako emaitzen prozesutik kanpo hartutako erabaki politikoak helarazteko.

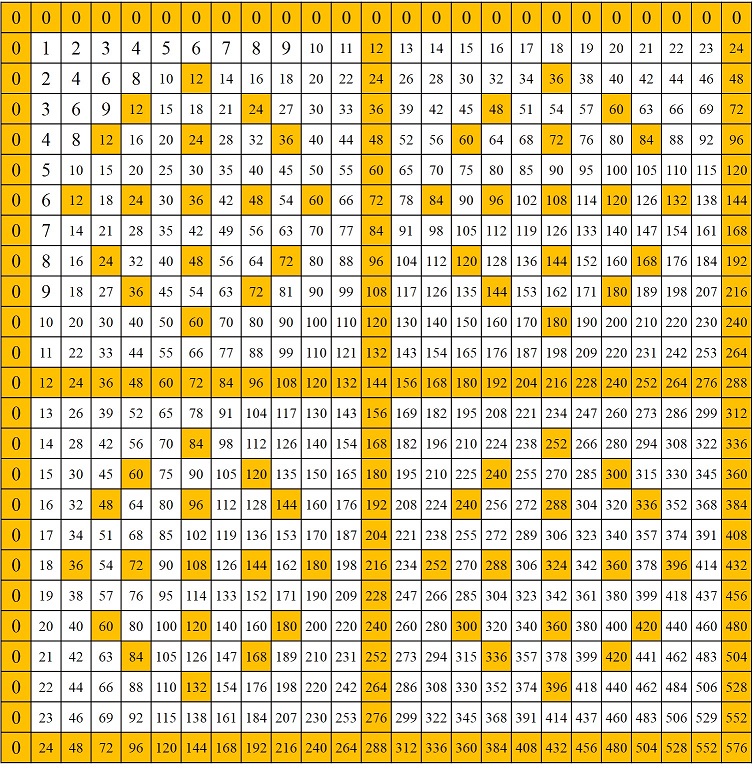

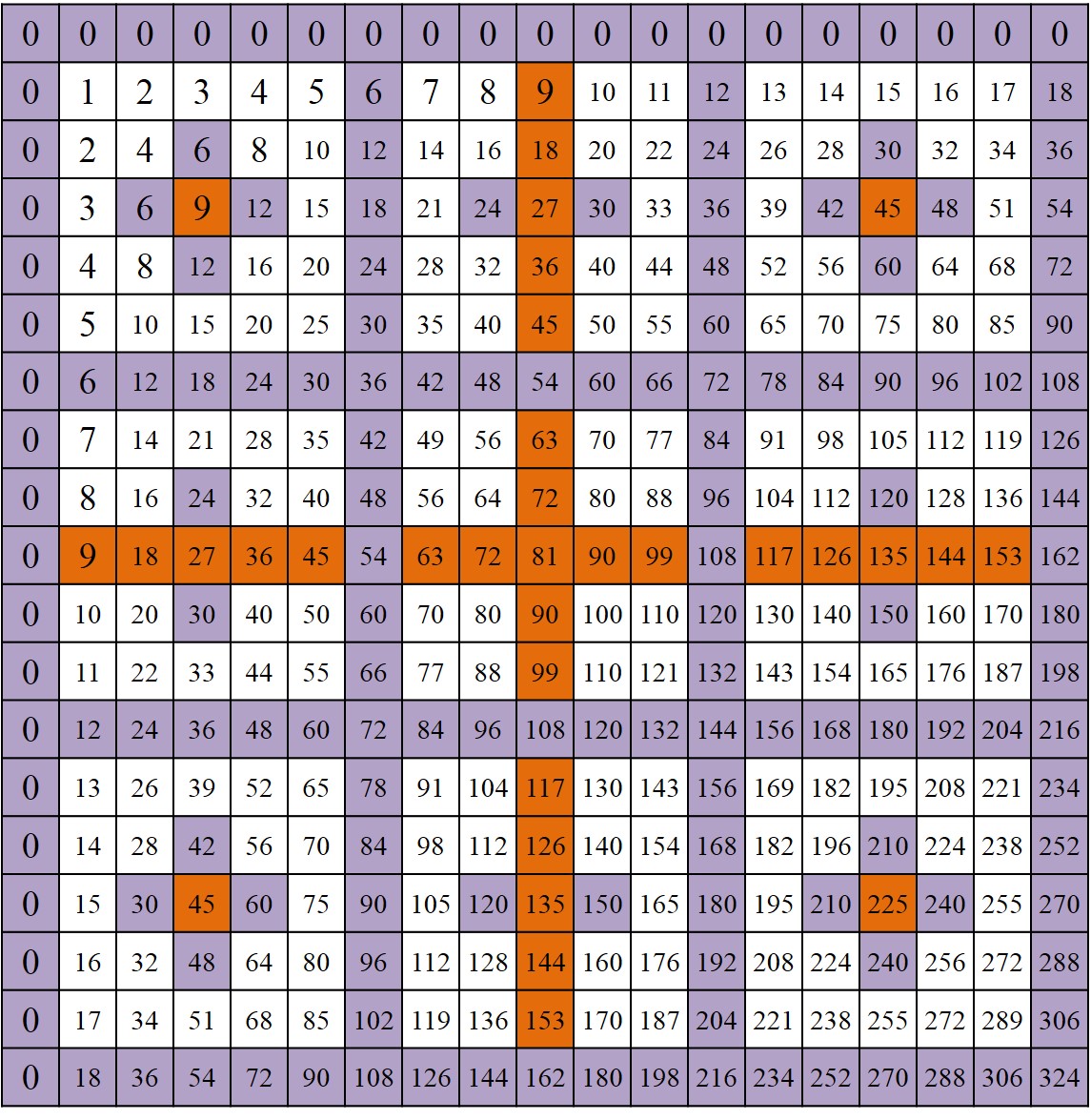

3. irudia: Lurreko gainazal-tenperaturaren proiekzioak. (Iturria: Policymaker Summary of The Phisical Science Basis – 4th IPCC Report).

Badirudi argi dagoela ezin dugula etorkizuna ziurtasun osoz ezagutu eta, Zygmunt Baumanek esango lukeen moduan, daukagun ziurtasun bakarra ziurgabetasuna dela. Hala ere, horrek ez du galarazten modu nahiko sendoan aurreikustea izango dugun etorkizun gertagarria. Horregatik, simulazioen emaitzak ziurgabetasunaren eredu gertagarriekin aurkeztea ez da ahultasun zeinua, baizik eta balioespen horiek modu garden batean azaltzeko tresna, ikerketa zientifikoa politika, gizarte eta etika kontuekin nahastu gabe. Jarduera hori zorroztasun eredutzat hartzen dute zientzialariek eta IPCCk, nahiz eta badiren zalantzaren merkatariak ahultasuntzat jotzen dutenak. Izan ere, IPCCko txostenetako ziurgabetasunaren ziurtasuna, paradoxikoki, eskuragarri dagoen modu bakarra da etortzekoa den klimaren proiekzio ahalik eta ziurrenak egiteko.

Gehiago jakiteko:

Winsberg, Eric (2018), Philosophy and Climate Science, New York: Cambridge University Press.

———————————————————————————-

Egileaz: José Luis Granados Mateo UPV/EHUko Historia eta Filosofiako doktorego aurreko ikertzailea da.

———————————————————————————-

Oharra: Jatorrizko artikulua Cuaderno de Cultura Científica blogean argitaratu zen 2019ko uztailaren 15ean: La certeza de la incertidumbre en los informes del IPCC. Eta bigarren bertsio bat The Conversation gunean abuztuaren 13an: La incertidumbre en los informes sobre el cambio climático: ¿un motivo para dudar?

The post Ziurgabetasunaren ziurtasuna IPCCren txostenetan appeared first on Zientzia Kaiera.

Sobre gustos……¿no hay nada escrito?

Juan Felipe Castro

Foto: Natema Drummond / Unsplash

Foto: Natema Drummond / UnsplashDesde hace mucho tiempo y en diversas culturas se acuñó la expresión “sobre gustos no hay nada escrito”. Parece ser que desde un punto de vista genético, fisiológico y cultural, ésta frase ya ha pasado de moda.

Según Nicholas Archer de la Organización de Investigación Científica e Industrial de la Commonwealth (CSIRO), nuestras preferencias a la hora de los gustos por las comidas varía según la persona y se crean a partir de una combinación de 3 factores: el entorno (la salud de cada uno en particular, dieta e influencias culturales), las experiencias previas y los genes.

Actualmente reconocemos los siguientes sabores en nuestra lengua y parte superior del esófago: amargo, dulce, salado, ácido, umami y también hay una nueva tendencia a reconocer el sabor “graso” como un sabor diferente de los otros.

El sabor como tal es en sí un concepto diferente del gusto, ya que implica una experiencia sensorial, donde se incluyen los olores, texturas y experiencias previas de los alimentos. Siempre decimos que cada alimento tiene su sello de olor propio. De hecho una misma comida preparada por dos personas distintas puede llegar a tener un sabor diferente, -“nadie hace la sopa de gallina como mi abuela”.

Fuente: elgourmet.com

Fuente: elgourmet.comCon respecto a los factores de la salud que influencian los gustos, tenemos que tener en cuenta que los sabores que percibimos en la lengua y los olores que registramos en la mucosa pituitaria de la nariz, están regidos por receptores específicos. Esos receptores se conocen a nivel genético como lo demuestran Keller et al (2002). Variaciones en esos genes hacen que tengamos preferencias por determinadas comidas, como también que tengamos aprehensión por otras. Si por ejemplo no nos gustan los vegetales y no los integramos en nuestra dieta, es probable que tengamos alguna deficiencia en algunas de las vitaminas o fibras que aportan esos vegetales. Hay una tendencia a padecer enfermedades relacionadas a la alimentación cuando dejamos de tener una dieta variada y sólo ingerimos alimentos que son exclusivamente de nuestro agrado. De hecho se conoce desde hace mucho tiempo que los sabores dulces evolutivamente se relacionan con los alimentos y por eso disfrutamos de frutas dulces que nos aportan energía en forma de azúcares. Por otro lado, los sabores amargos se relacionan con la presencia de algunas sustancias tóxicas en vegetales, por eso somos reticentes a algunas verduras que persisten en sabores amargos, ¿acaso el café sin azúcar o la cerveza son bien recibidos en nuestra dieta desde un primer instante?.

Según el portal “Nutrición personalizada” la percepción del gusto amargo es un rasgo variable y su base genética fue identificada hace más de 70 años mediante una serie de estudios en respuestas individuales a la feniltiocarbamida (PTC). PTC y el compuesto relacionado 6-n-propiltiouracilo (PROP) son miembros de las tioureas y contienen una fracción tiocianato (N-C=S).

De acuerdo a la presencia de estos genes se puede decir que algunas personas son catadores, semi catadores y no catadores de los sabores amargos. Eso explicaría cómo habemos personas que odiamos profundamente la rúcula y cómo hay otras que les gusta, porque no perciben con fuerza el sabor amargo, incluso poniéndose de moda como un ingrediente gourmet.

Sin lugar a duda un componente fundamental en nuestra elección de diferentes gustos es la experiencia previa. En cada una de nuestras culturas (incluso algunas no muy distintas) desde pequeños probamos y nos amigamos con sabores ancestrales, a tal punto que en nuestra memora emotiva esos sabores nunca dejan de conmovernos. Recordamos lugares, paisajes, fiestas familiares o fiestas populares. Existen comidas especiales en algunas regiones (cada lector puede recordar en su caso particular) que mantienen sus recetas originales centenarias que han sufrido muy pocas modificaciones.

¿O sea que conociendo los antecedentes genéticos y culturales de una zona determinada podemos llegar a predecir cuáles serán los gustos de las personas de esa región? Esto es muy cierto. Muchas empresas de marketing se encargan de predecir los gustos de una población determinada para poder instalar productos de comercio. Esta realidad excede a los gustos culinarios y se hace extensible a todos los gustos para cualquier bien de consumo.

Volviendo a nuestra frase inicial, cuando hablamos de los gustos tendemos a pensar que los gustos son algo muy subjetivo, que es propio de cada persona en particular. No caemos en cuenta que sobre ese tema de verdad ya hay mucho escrito y a diario se usa para bombardearnos con publicidades para que compremos tal o cual producto, o que accedamos a promociones de “el producto que estamos buscando”. En fin, como vimos, sobre gustos ya hay mucho escrito.

Referencias:

Keller KL et al. (2002) Genetic taste sensitivity to 6-n-propylthiouracil influences food preference and reported intake in preschool children. Appetite 2002;38:3-12.

Variación genética en la percepción del gusto (2012) Nutrición personalizada

Archer, N. (2017) Curious Kids: why do some people find some foods yummy but others find the same foods yucky? The Conversation

Sobre el autor: Juan Felipe Castro es licenciado en ciencias biológicas y trabaja en el Instituto de Fisiología animal de la Fundación Miguel Lillo (Argentina) donde investiga en productos vegetales para el control de la glucemia.

El artículo Sobre gustos……¿no hay nada escrito? se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Dudas sobre las vacunas: problemas y soluciones

- Sobre la predisposición genética a padecer enfermedades

- Sobre el origen del uso de herramientas en aves

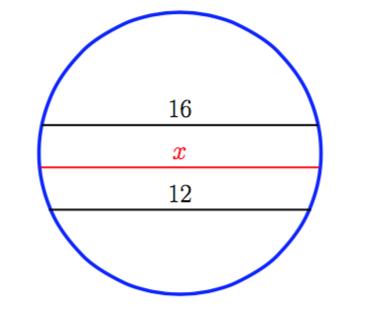

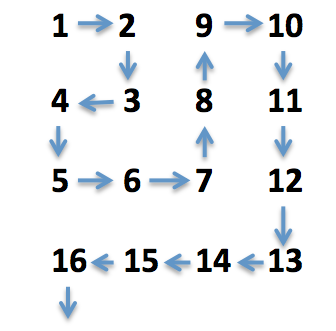

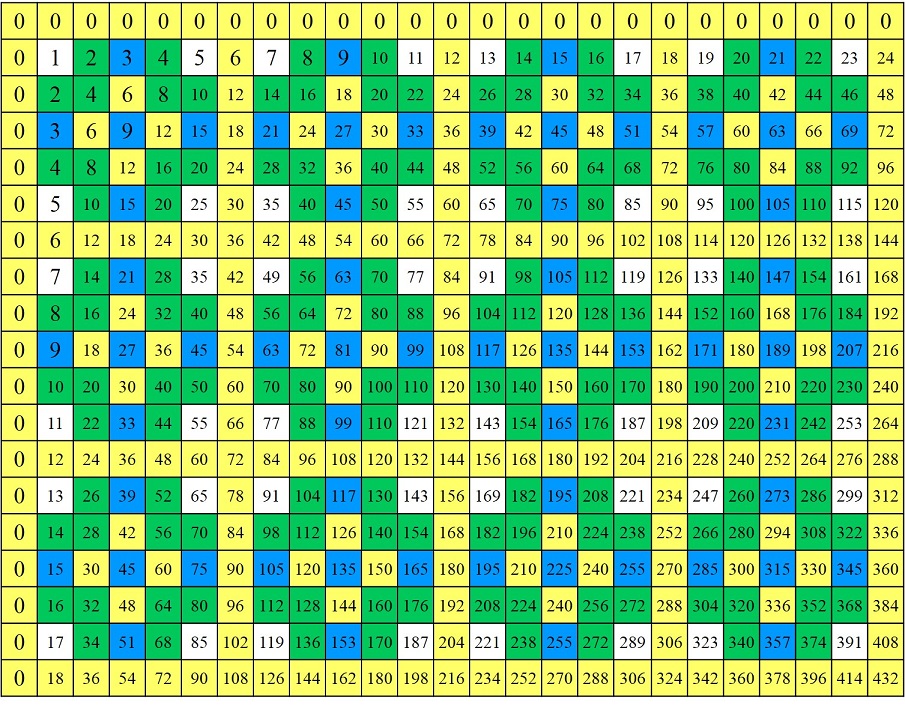

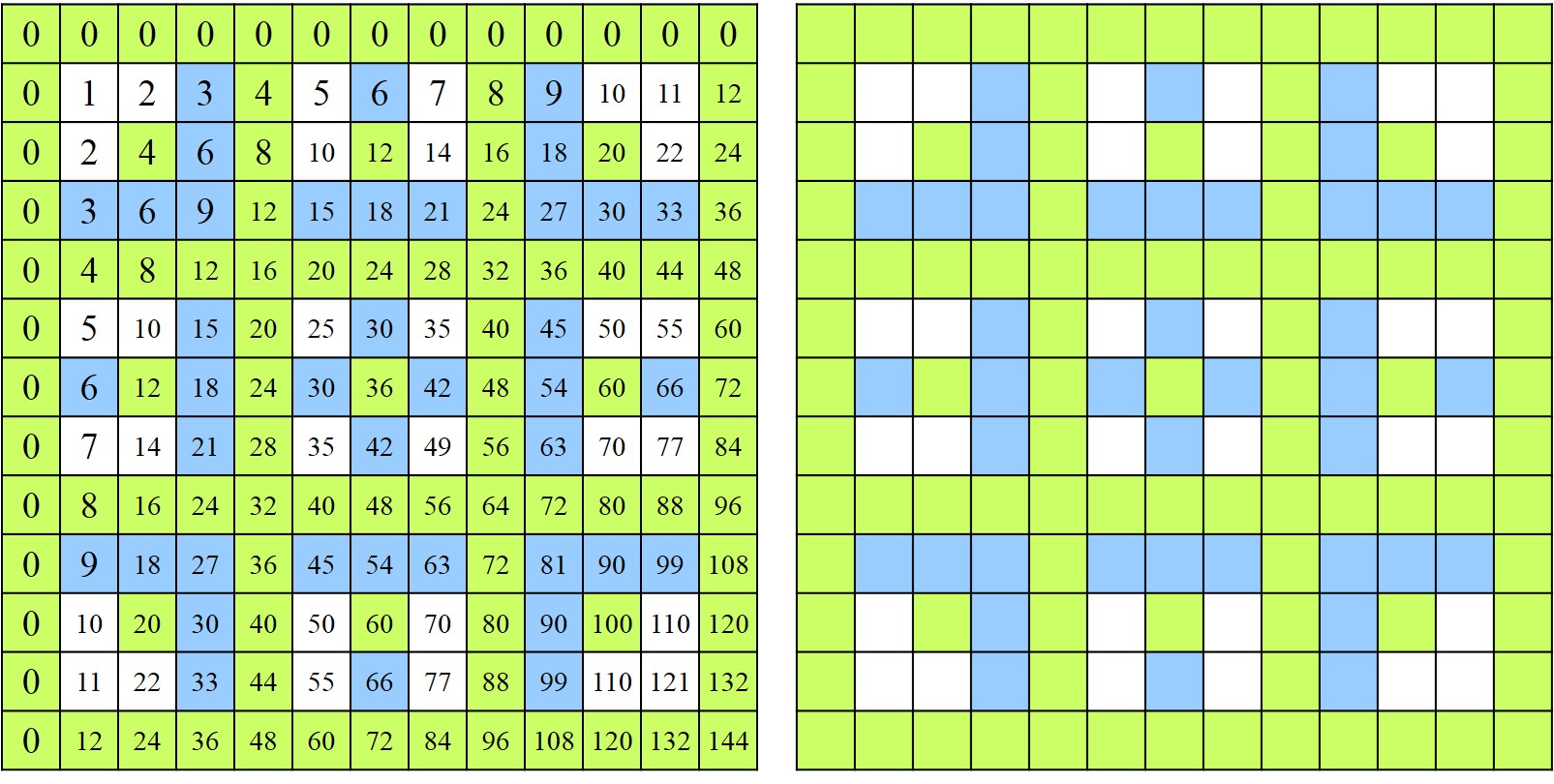

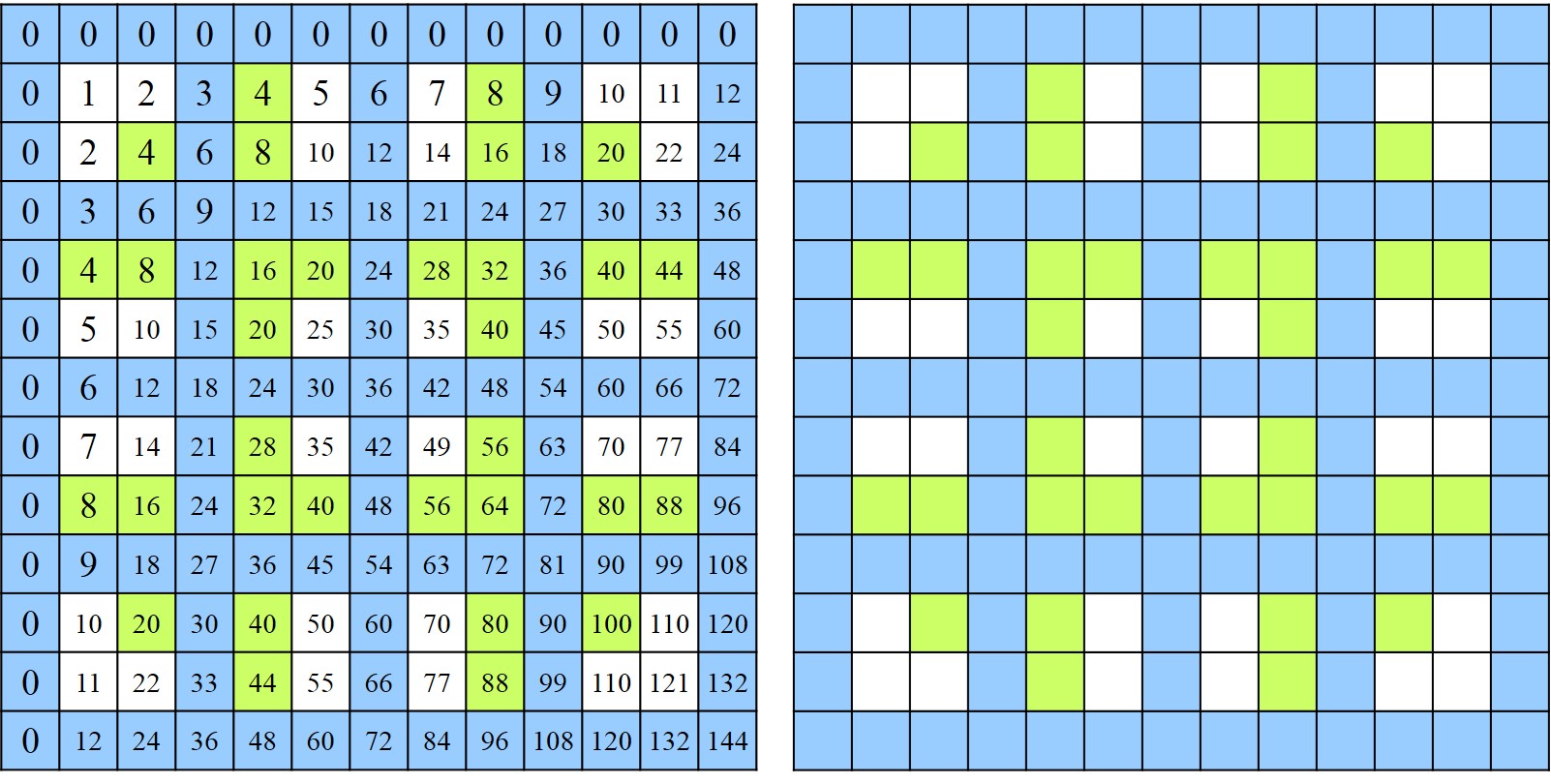

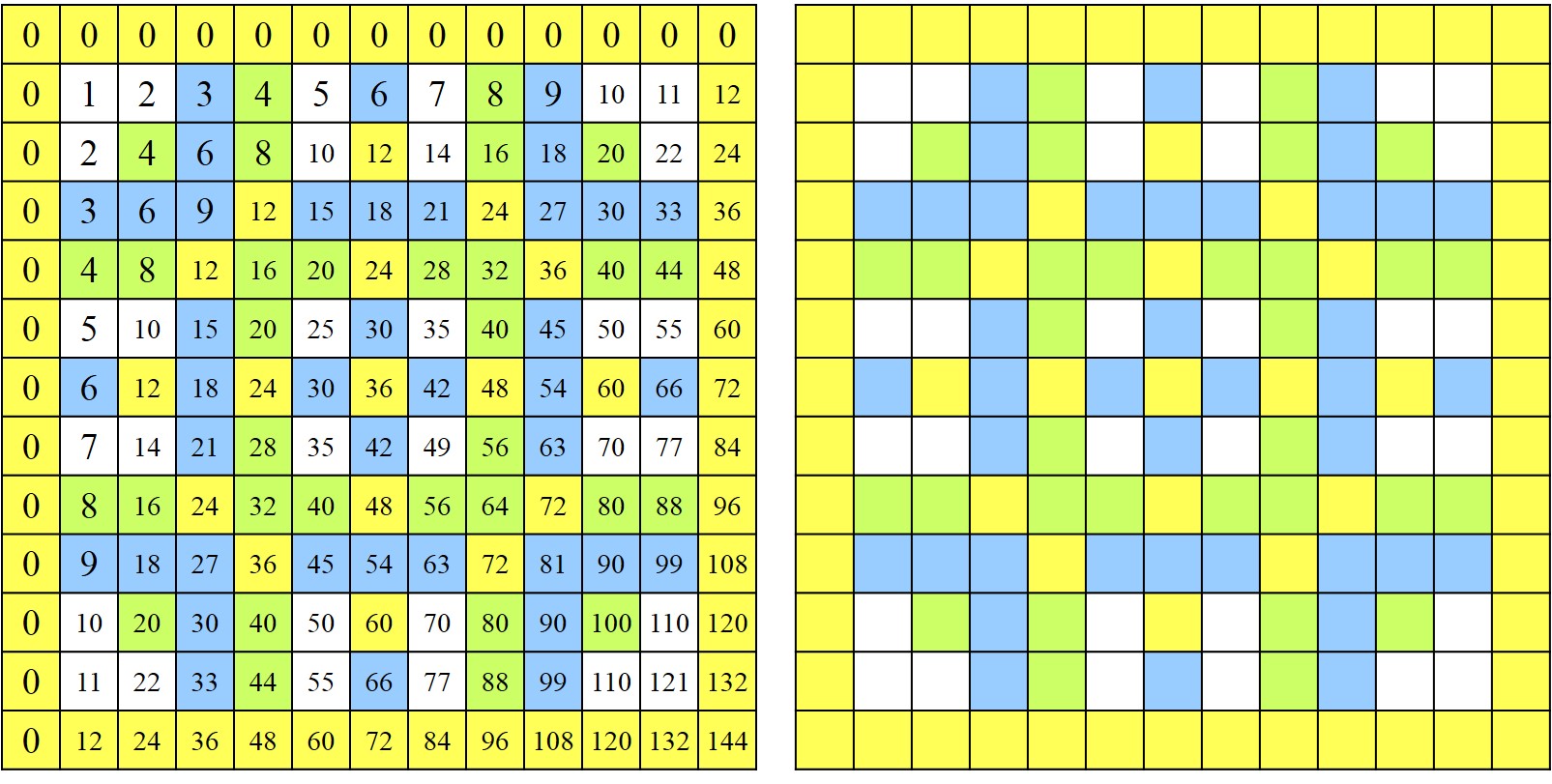

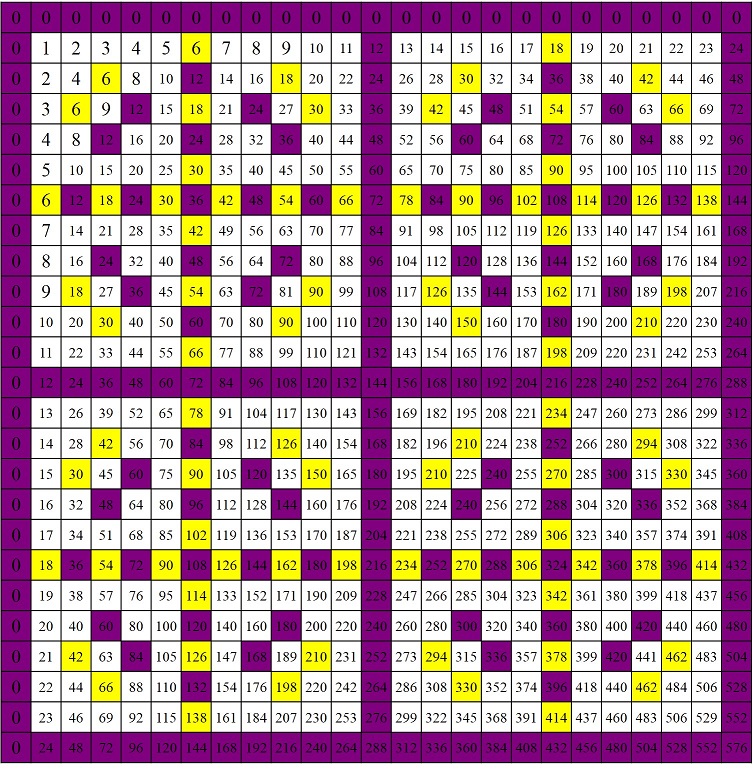

Dozena erdi ariketa 2019ko udarako (5): Korda neurtzen

Gogoan izan ahalegina bera –bidea bilatzea– badela ariketa. Horrez gain, tontorra (emaitza) lortzen baduzu, poz handiagoa. Ahalegina egin eta emaitza gurekin partekatzera gonbidatzen zaitugu. Ariketaren emaitza –eta jarraitu duzun ebazpidea, nahi baduzu– idatzi iruzkinen atalean (artikuluaren behealdean daukazu) eta irailean emaitza zuzenaren berri emango dizugu.

Hona hemen gure bosgarren ariketa: Korda neurtzen.

———————————————————————————-

Ariketak “Calendrier Mathématique 2019. Un défi quotidien” egutegitik hartuta daude. Astelehenetik ostiralera, egun bakoitzean ariketa bat proposatzen du egutegiak. Ostiralero CNRS blogeko Défis du Calendrier Mathématique atalean aste horretako ariketa bat aurki daiteke.

———————————————————————————-

The post Dozena erdi ariketa 2019ko udarako (5): Korda neurtzen appeared first on Zientzia Kaiera.

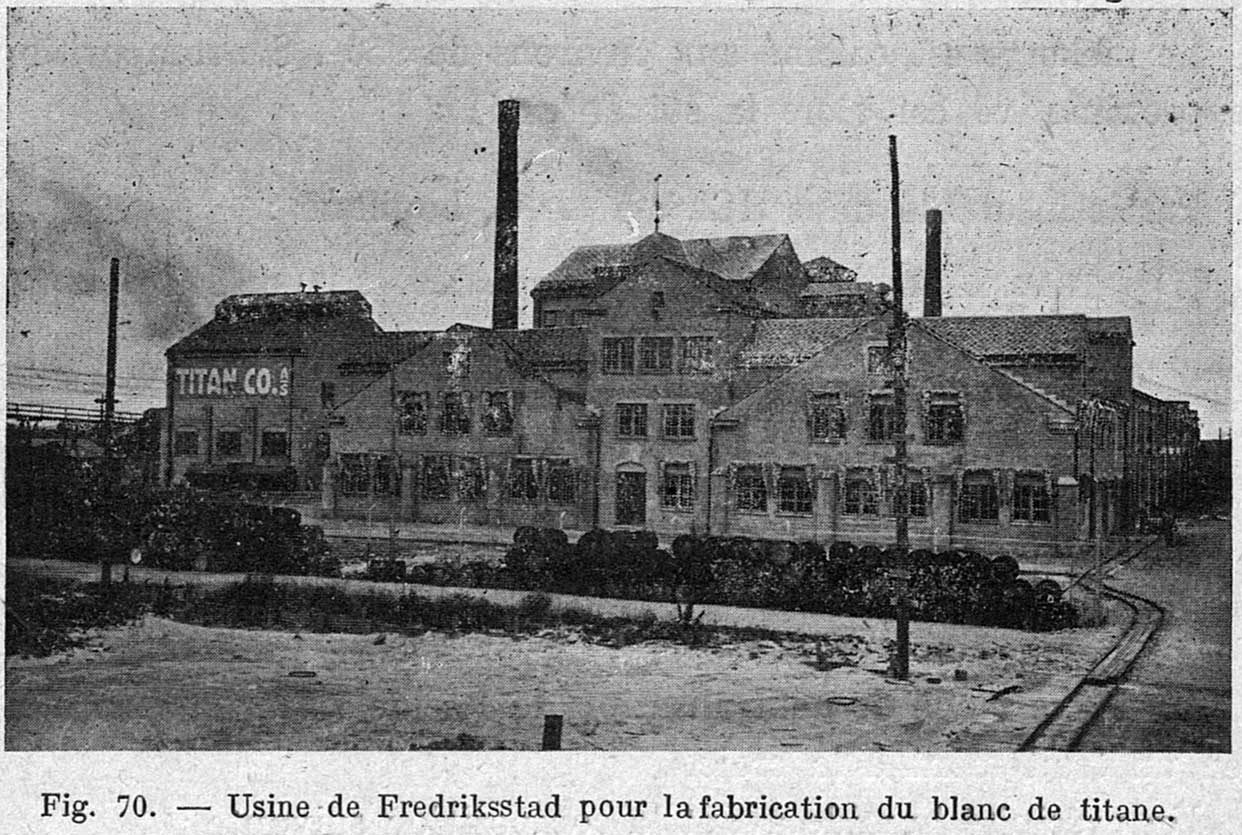

El legado de Carlomagno

Si visitas la catedral de Aquisgrán (Alemania) y tienes ascendencia europea puedes señalar a quien quiera oirte que aquí yacen los restos de un abuelo tuyo. Karlsschrein / Wikimedia Commons

Si visitas la catedral de Aquisgrán (Alemania) y tienes ascendencia europea puedes señalar a quien quiera oirte que aquí yacen los restos de un abuelo tuyo. Karlsschrein / Wikimedia CommonsTodos hemos tenido un padre y una madre biológicos. Ellos, a su vez, tuvieron los suyos, de manera que todos hemos tenido dos abuelos y dos abuelas; si seguimos la secuencia hacia atrás, ocho bisabuelos, dieciséis tatarabuelos, etc. Si cada generación está separada de la anterior por 30 años, podríamos haber llegado a tener unos 16 000 ascendientes al comienzo del siglo XVII, unos 16 millones a principios del XIV y unos 16 000 millones en los albores del XI, hace unos mil años. A estas alturas ya se ha dado usted cuenta de que eso, sencillamente, es imposible.

En efecto, sin tener que retrotraernos tanto, el número real de nuestros ascendientes es muy inferior al que se calcula haciendo esas operaciones. La razón es clara: muchos de nuestros ancestros lo son por varias líneas genealógicas. Esa eventualidad es más improbable cuanto más cercanos en el tiempo son los ascendientes, pero aumenta conforme vamos hacia atrás.

A comienzos del siglo XIV había unas 450 millones de personas en el Mundo (alrededor de 70 en Europa), por lo que bien pudieron haber vivido unos 16 millones de ancestros de cada uno de nosotros entonces. Pero hace mil años sólo vivían 400 millones (unos 50 en Europa). Por lo tanto, es matemáticamente imposible que viviesen 16 000 millones de antepasados nuestros en aquella época.

Hablamos con naturalidad de “árbol genealógico” porque visualizamos nuestros ancestros como un árbol que se ramifica poco a poco hacia atrás. Pero la realidad es muy diferente. Ya desde generaciones no tan lejanas algunas de las ramas confluyen, y si nos retrotraemos a tiempos remotos, ni siquiera cabe hablar de ramas. Las líneas genealógicas configuran una especie de maraña o, si se quiere, de malla con múltiples cruzamientos. Por otro lado, muchas líneas no dejan descendencia ninguna en cada generación. Conforme retrocedemos en el tiempo, la red va haciéndose más y más estrecha: se calcula que en los albores del Neolítico, hace unos 12 000 años, vivían en el mundo menos de 4 millones de personas, unos 60 millones en la época homérica, y mil millones al comienzo del siglo XIX.

Adam Rutherford cuenta, en su “Breve historia de todos los que han vivido”, que todos los que tenemos ascendencia europea procedemos, por una vía u otra, de Carlomagno. Todos pertenecemos, por lo tanto, a un linaje real. No es broma, aunque sea del todo irrelevante. Quienes tenemos algún ancestro europeo no solo descendemos de Carlomagno, también procedemos de todos los europeos de su época –alrededor del año 800– que dejaron descendencia y ha llegado hasta el siglo XXI. Se estima que la de un 20% no ha llegado.

No hace falta ir tan atrás en el tiempo para localizar el momento en que confluyen nuestras líneas genealógicas. Todos los europeos compartimos un antepasado común que vivió hace, aproximadamente, unos 600 años. Y si los mismos cálculos que han permitido obtener esa cifra se hacen para toda la humanidad, se estima que todos los seres humanos compartimos un antepasado común que vivió hace unos 3 400 años. Porque aunque cueste creerlo, no se sabe de ninguna población que haya permanecido completamente aislada durante los últimos siglos.

Estas cosas resultan desconcertantes. Piénselo si ha depositado una muestra de saliva en un tubito y le han dicho que en su linaje confluyen ascendientes de las tribus guerreras de las estepas rusas, de los bravos vikingos que sembraron el caos y la destrucción en Europa, y de los egipcios que levantaron las pirámides. Lo más probable es que usted tenga esa ascendencia. También la tengo yo.

Sobre el autor: Juan Ignacio Pérez (@Uhandrea) es catedrático de Fisiología y coordinador de la Cátedra de Cultura Científica de la UPV/EHU

El artículo El legado de Carlomagno se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:Zientzia begi-bistan #266: Udako bilduma

Argazkia: Steve Bidmead / Pixabay

GenetikaEz dago erlazio garbirik sexu bereko pertsonekin sexu-harremanak izatearen eta geneen artean, ikerketa batean ondorioztatu denez. Ikusi dute DNAk dituen milioika markatzaileren artean, bostek badutela lotura jokabide ez-heterosexualarekin, baina haien eragina oso txikia dela. Horrez gain, ikertzaileek berretsi dute sexu-zaletasunak eta jokabideak eredu bitarra eta heterosexuala gainditzen duela. Baduzue informazio gehiago Elhuyar aldizkarian

IngurumenaSuteak arriskuan jartzen ari dira baso borealen karbonoa biltegiratzeko funtzioa. Baso hauek funtsezkoak dira karbonoaren zikloan, lurreko karbonoaren % 30-40 biltegiratzen baitute. Ondorioztatu dute, suteetan, zuhaizti zaharrek ehunka urtetan metatutako karbonoari eusten diotela, azalean izaten duten lur-geruzaren babesari esker baina ez da hori bera gertatzen 60 urtetik beherako zuhaiztietan

Medikuntza eta OsasunaIkerketa batek aditzera eman du azido foliko gehiegi hartzeak (1000 mikrogramo edo gehiago egunero), pisuari dagokionez, umeak adin gestazionalerako txikiak izatearen arriskua handitzen duela. Hala ere, erreplikazio beharra azpimarratzen dute ikertzaileek.

Zer dira konposatu fenolikoak? Egitura kimiko ezberdinak dituzten sustantziez osatutako multzo zabal bat dira. Polifenolak berez landareetan egoten dira eta ondorioz landare jatorriko elikagaietan (barazki, ortuari, fruta, fruitu lehor, ardo…) topa daitezke. Konposatu hauek gure gorputzera sartzen direnetik, hainbat eraldaketa jasaten dituzte. Ondorioz, odolera eta ehunetara iristen den kantitatea oso txikia izan ohi da. Konposatu hauek oxidazioaren aurka jarduteko ahalmena erakutsi dute.

Munduko Osasun Erakundeak (MOE) erabaki du Britainia Handia dagoeneko ez dela elgorririk gabeko lurraldea. 2017an elgorria ezabatu zuela adierazi zuen MOEk baina orain jakin denez ez da maila horri eusteko gai izan. Elhuyar aldizkariak azaldu digu berria.

Ariketa fisikoak bizitza osoan zehar hezur-indarraren hobekuntzan eta hezur-mineralaren metaketa eta mantentzean eragiten du. Halere, kontuan hartu behar da ariketa mota guztiek ez dutela modu berean eragiten hezur-osasunean. Ariketa fisikoaren bitartez hezur mineralaren metaketa nola sustatu eta mantentzeko irakur ezazu osorik artikulu hau.

BiologiaErleak arriskuan daude eta horiek salbatzeko dei orokorra egin da. Polena garraiatzen landareen ugalketa ahalbidetzen dituzten animaliak dira polinizatzaileak. Ezagunenak dira ezti-erleak baina ez dira polinizatzaile bakarra. Badira beste intsektu batzuk: tximeletak, liztorrak, inurriak, kakalardoak, euliak… baita zenbait ornodun, hala nola, saguzarrak, kolibriak, zenbait karraskari eta baita sugandilak ere. Polinizazioen %14aren arduradunak baino ez dira ezti-erleak.

Eta zein da polinizatzaileen egoera? Horien neurketak egitea oso zaila da. 2014.urtean publikatu zen horri buruzko artikulua. Bertan, polinizatzaile ornodunen %16.5 eta polinizatzaile ornogabeen %40 baino gehiago desagertze arriskuan daude IPBES txostenaren arabera. Erleei dagokienez, erle espezieen %9 inguru dago arriskuan, IUCN lista gorriaren arabera.

Txinako laborategi batean gizaki-tximino kimerak sortu dituzte. Tximino baten enbrioian giza zelulak txertatu dituzte, transplanteetarako organoak sortzeko bideak ikertzeko asmoz.

Ikerketa batek aditzera eman du gizakion plazentan ez dagoela mikrobiorik. Orain arte egin den ikerketarik zabalena egin dute: 537 emakumeren plazenta-lagin. Elhuyar aldizkaria azaldu digunez, ondorioztatu dute haurdunaldi osasuntsuetan plazentan ez dagoela mikroorganismorik, eta kontaminazio-arazoek azaltzen dituztela aurretik egindako detekzioak.

CRISPR bidez aktibatzen den material adimentsu bat sortu dute Massachussets Teknologia Institutuan. Materiala diagnostikoak egiteko (ebolarekin probatu dute), edo terapian, botikak modu adimentsua askatuz (minbizian edo infekzioetan) baliagarria izan daiteke.

KimikaArma kimikoek substantzia kimikoen propietate toxikoak erabiltzen dituzte. Horiek erabili ziren lehenengo aldiz Lehen Mundu Gerran; alemaniarrek kloro gasa erabili zuten frantses eta kanadarren aurka Ypresen (Belgika). Arma kimikoen arriskua dela eta, 1971.urtean Arma Kimikoen Hitzarmena jarri zen indarrean. Ziape-gasa, adibidez, 1822an sortu zen eta 1917an erabili zen lehen aldiz. Gorputzean eragiten duen kaltea zein den ez da ezagutzen oraindik.

Artikulu honetan, molekula-egiturak BODIPY (BOron DIPYrromethene) deritzen koloratzaileen propietate fotofisikoetan duen eragina aztertzen da. Eremu espektral ikusgai osoa betetzen duten BODIPY koloratzaile berriak garatu dira lan honetan eta hauek aproposak dira bai zuntza fluoreszente bezala prozesu biokimikoak behatzeko mikroskopia fluoreszentea bitartez (bioirudia), bai ingurune aktibo moduan erabiltzeko igorpen sintonizagarria duten laserrak lortuz.

Merkatuan oso hedatuak dauden bi polimeroren azterketa ikusmiran: polipropilenoa eta poliamida 6. Bi polimero horien nahasteak prestatu dira eta kopolimero- konpatibilizatzailea eta nanosilika gehitzeak nahaste horietan duen eragina aztertu da. Neurketa biskoelastikoen bidez lortzen diren erlaxazio-espektroen azterketak morfologian gertatutako aldaketak detektatzeko gai direla frogatzen da.

Biomedikuntzan inplante moduan erabiltzeko material berrien eskaera handia dago. Polimeroek eta material ez-organikoek errefus arazoak sortzen dituzte baina batzuetan aproposenak dira. Sortzen duten arazoetako bat da bakterioak pilatzen direla, biofilmak sortuz (bakterio komunitate bat). Hauek inplante artifizialetan eratzen dira gure ehun zelularrak hazi baino lehen. Lan honetan azaltzen da nola eraldatu duten bi substratu motaren gainazala; bata ezorganikoa eta bestea polimerikoa. Egindako lanari esker, materialaren hidrofilitatea areagotzea, eta horrela, bakterioen aurkako gainazala lortu da.

AstronomiaOso zaila da FRB seinaleak (ingelesezko fast radio burst), hau da, irrati eztanda azkarrak, ikertzea, eta haien jatorria misterio bat da oraindik. 2007. urtean detektatu zen lehenengoa, geroztik dozenaka jaso dira. Joan den ekainean jakin genuen aurrenekoz aurkitu zutela errepikatu ez den halako seinale baten jatorria. FRB 180924 seinalea 3.600 milioi argi-urtera dagoen galaxia baten kanpoko aldean kokatu dute.

2019ko apirilaren 11n Beresheet zunda israeldarrak talka egin zuen Ilargiaren aurka. Kolpearen ondorioz, zunda suntsituta geratu zen, eta zeraman zama Ilargiaren azalean sakabanatu zen. Zama horren artean, milaka tardigrado zeuden. Hauek izaki mikroskopikoak dira, eta ezagunak dira egoera gogorrenetan irauteko gaitasun harrigarria dutelako. Kezkagarriena auzi honetan hainbat adituren ustez da informazio hori ezkutatu izana. Tardigradoekin gertatu denak agerian utzi du badela garaia zehazteko zer bidali daitekeen eta zer ez espaziora.

FisikaMunduko urrerik finena sortu dute: bi atomoko lodiera baino ez dute! Leeds Unibertsitateko ikertzaileek adierazi dute hamaika aplikazio izan ditzaketela: medikuntzan, elektronikan eta baita hainbat prozesu industrialetako erreakzio kimikoen katalizatzaile gisa ere.

ElkarrizketakAmaia Arranz arkeobotanikaria eta Ana Galarraga zientzia komunikatzailea izan dira protagonistak elkarrizketa honetan. Bertan, gai oso interesgarriak izan dituzte mintzagai, hala nola, zientzia gizartean zabaltzearen garrantzia, ikerketak abian jartzeko beharrezko finantzaketa, sexismoa zientzian etab. Arranzek ere bere ikerketa lanaz hitz egin du, izan ere, orain arte uste zenaren kontra, demostratu du ehiztari biltzaileek ere egiten zutela ogia. Ez galdu!

Itziar Aretxaga astrofisikaria eta Alvaro Arrizabalaga arkeologoa mintzatu dira zientziaren inguruan. Biek txikitatik izan zuten zientzia jomuga; batak zeruari egin zion so, eta besteak, lurrari. Biak ikerlariak dira. Egun, Aretxaga, adibidez, galaxien sorrera eta bilakaera ikertzen ari da. Arrizabalagaren kasuan, Paleolitoarekin ari dela dio, “Euskal Herriko lehen gizakiak” ikertzen. Horretaz gain, ikerketa-lanaren garrantzia aipatu dute biek. Honen harira, Aretxagak esan du: “Zientziak, edozein zientziak, gu geure lekuan jartzeko balio du. Gure aurkikuntzekin kultura aldatzen da, eta aurre egin behar diegu aurrejuzguei“. Irakurri elkarrizketa osorik hemen!

–——————————————————————–

Asteon zientzia begi-bistan igandeetako atala da. Astean zehar sarean zientzia euskaraz jorratu duten artikuluak biltzen ditugu. Begi-bistan duguna erreparatuz, Interneteko “zientzia” antzeman, jaso eta laburbiltzea da gure helburua.

———————————————————————–

Egileaz: Uxue Razkin kazetaria da.

——————————————————————

The post Zientzia begi-bistan #266: Udako bilduma appeared first on Zientzia Kaiera.

Ana Aguirre – Naukas Bilbao 2018: Somos binarios…. ¿o no?

Foto: Mario Purisic / Unsplash

Foto: Mario Purisic / Unsplash¿Cuántos sexos, géneros, si así lo prefieres, diferentes tiene nuestra especie?¿Dos o más de dos? Tanto si tienes clara la respuesta como si no esta charla de Ana Aguirre te resultará extremadamente útil y esclarecedora… salvo si estás en el grupo de los negacionistas de la ciencia, claro. La charla solo tiene un problema: el volumen del sonido; aun así la publicamos debido a su excepcional calidad de fondo y forma.

Ana Aguirre es profesora titular de Genética en el departamento de Genética, Antropología Física y Fisiología Animal de la UPV/EHU. Su trayectoria profesional incluye la participación en investigaciones sobre la caracterización genética de poblaciones humanas, la detección de productos genotóxicos o la identificación de factores genéticos en la enfermedad de Huntington, entre otros temas.

Ana Aguirre: ''Somos binarios, ¿o no?''Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Ana Aguirre – Naukas Bilbao 2018: Somos binarios…. ¿o no? se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Francisco R. Villatoro – Naukas Bilbao 2018: El ángulo mágico del grafeno

- Carlos Briones – Naukas Bilbao 2018: Os voy a contar una historia (en imágenes)

- Naukas Bilbao 2017 – Guillermo Peris: Los trapecistas del genoma

Detección e identificación de residuos de disparos a contrarreloj

Servicio Central de Análisis de Araba (SGIker – UPV/EHU)

Foto: Sofia Sforza / Unsplash

Foto: Sofia Sforza / UnsplashHoy en día, la detección e identificación de residuos de disparos con arma de fuego (GSR, por sus siglas en inglés) proporciona información forense valiosa que generalmente se utiliza para determinar si una persona ha disparado un arma de fuego, confirmar una coartada, determinar orificios de entrada y salida de la bala, estimar de la distancia de disparo, establecer el tipo de munición utilizada, diferenciar entre suicidio u homicidio y en general, para relacionar a un individuo con una situación en la que se vea implicada el uso de un arma de fuego.

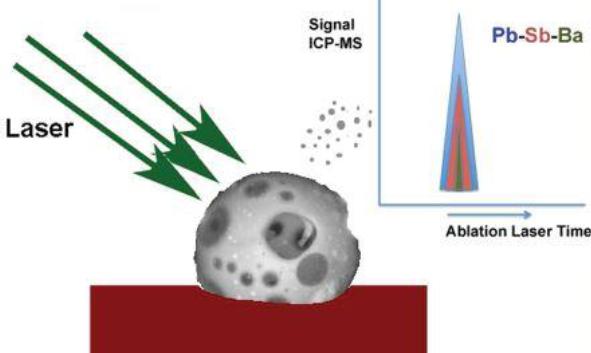

En el Servicio Central de Análisis de Álava (SGIker) se ha desarrollado un método basado en la ablación láser de barrido y espectrometría de masas con plasma de acoplamiento inductivo (SLA-ICPMS), cuya combinación instrumental ha sido aplicada para la caracterización de partículas GSR [1].

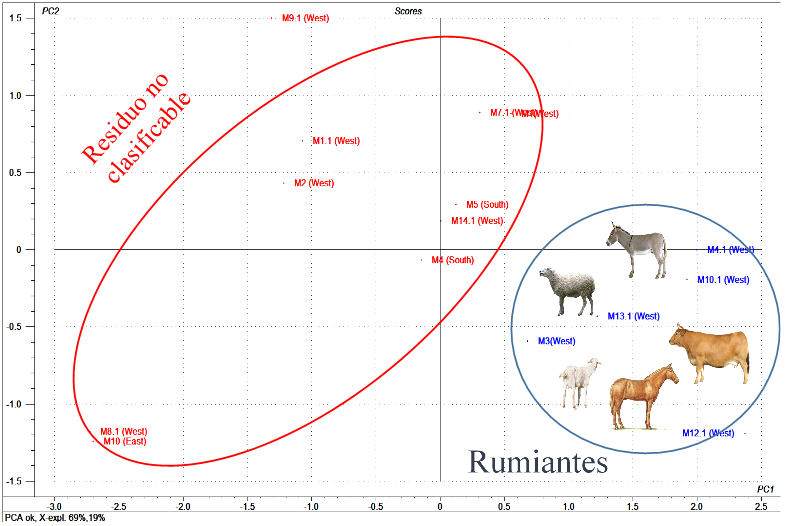

Este método ha permitido desarrollar un enfoque alternativo para la identificación inequívoca de GSR, lo que proporciona información precisa sobre la composición química de partículas GSR individuales de diferentes tipos de municiones.

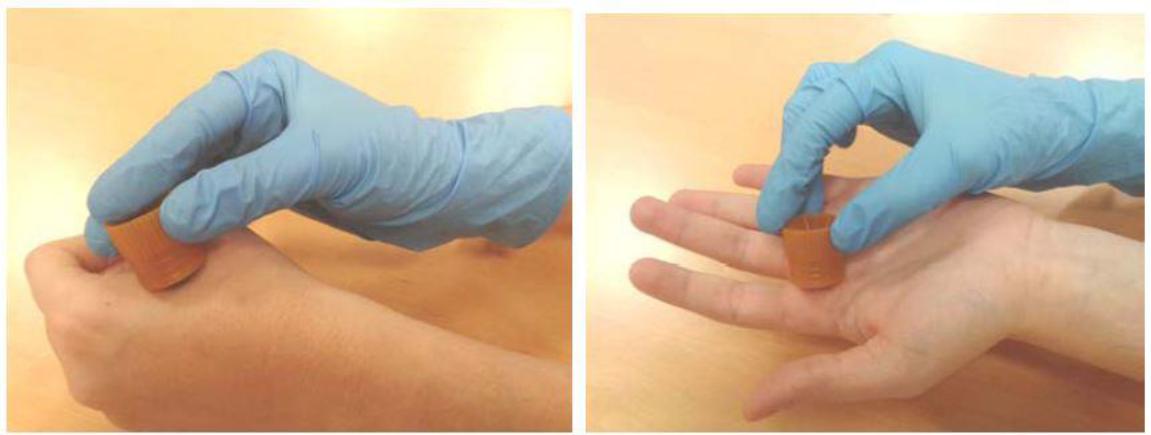

El procedimiento más frecuentemente usado para el muestreo de residuos inorgánicos de la mano es una superficie de adhesivo de carbono como la que se muestra en la figura (muestreo de tape-lifting).

Imagen 1. Muestreo de GSR en manos con tape lifts comerciales. Fuente: Zuriñe Abrego, Characterization of gunshot residues by surface analysis techniques, UPV/EHU (2014) 1-313.

Imagen 1. Muestreo de GSR en manos con tape lifts comerciales. Fuente: Zuriñe Abrego, Characterization of gunshot residues by surface analysis techniques, UPV/EHU (2014) 1-313.La mayor parte de los residuos químicos que se producen en el disparo de un arma de fuego se depositan sobre las manos del tirador en forma de partículas metálicas de 0.5 a 5 µm de diámetro, que se deben recogen en un tiempo limitado ya que desaparecen por el contacto de las manos con diversas superficies o mediante su lavado.

El patrón de ablación láser y las condiciones de ICPMS se optimizaron para la identificación del perfil elemental de partículas GSR. Se seleccionaron 15 isótopos 121Sb, 137Ba, 208Pb,27Al, 29Si, 31P, 33S, 35Cl, 39K, 44Ca, 57Fe, 60Ni, 63Cu, 66Zn y 118Sn, que fueron monitoreados para obtener información sobre la composición de las partículas GSR y para clasificarlas como características de GSR o consistente con GSR.

Una vez que se verificó la validez del método, se realizó un estudio sobre muestras reales, muestreadas en campo de tiro (Academia de Policía de la Ertzainta, Arkaute, Álava). Se realizaron más de 1400 disparos, utilizando diferentes armas de fuego, calibres y municiones, que permitieron validar el estudio.

En posteriores trabajos se extendió esta metodología para la determinación de GSR de munición libre de plomo, en la que se monitorizaron otros metales característicos de este tipo de munición (Gd-Ti-Zn y Ga-Cu-Sn). Se desarrolló además un método de muestreo conjunto de GRS orgánicos e inorgánicos, que permitió determinar en la misma muestra ambos tipos de residuos: los primeros determinados mediante espectrometría de masas de tiempo de vuelo (LC-QTOF) y los segundos mediante SLA-ICPMS [2,3].

Figura 2. Esquema del proceso de ablación para la identificación de GSR por LA-ICP-MS. Fuente: Analytical Chemistry . 84 (2012) 2402–2409.

Figura 2. Esquema del proceso de ablación para la identificación de GSR por LA-ICP-MS. Fuente: Analytical Chemistry . 84 (2012) 2402–2409.Pero sin lugar a dudas, la principal ventaja de la metodología desarrollada, es que se puede usar como una alternativa a la técnica estándar de microscopía electrónica de barrido – espectroscopia de energía dispersiva (SEM-EDS), reduciendo drásticamente el tiempo de análisis a menos de 60 min. El hecho de que se tarde aproximadamente 1 hora en obtener resultados, frente a las 6-8 h de las técnicas habituales, aumenta la fiabilidad los procedimientos de cadena de custodia de las muestras, fundamentales en análisis forense.

Estos trabajos de investigación forman parte de la Tesis Doctoral de Zuriñe Abrego, “Characterization of gunshot residues by surface analysis techniques”, que mereció el premio extraordinario de doctorado.

Referencias:

[1] Z. Abrego, A. Ugarte, N. Unceta, A. Fernández-Isla, M. A. Goicolea, and R. J. Barrio*. Unambiguous Characterization of Gunshot Residue Particles Using Scanning Laser Ablation and Inductively Coupled Plasma-MassSpectrometry. Analytical Chemistry, 84 (2012) 2402–2409.

[2]. S. Benito, Z. Abrego, A.Sanchez, N. Unceta, M. A. Goicolea, R.J. Barrio. Characterization of organic gunshot residues in lead-free ammunition using a new sample collection device for liquid chromatography–quadrupole time-of-flight mass spectrometry Forensic Science International 246 (2015) 79–85

[3] Z. Abrego, N. Grijalba, N. Unceta, M. Maguregui, A. Sanchez, A. Fernandez-Isla, M. A. Goicolea and .R J. Barrio*A novel method for the identification of inorganic and organic gunshot residue particles of lead-free ammunitions from the hands of shooters using scanning laser ablation-ICPMS and Raman microspectroscopy. Analyst, 2014, 139, 6232

El artículo Detección e identificación de residuos de disparos a contrarreloj se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Bioóleo a partir de residuos cítricos

- Los residuos nucleares y la memoria de las arcillas

- La variedad de residuos madereros y la riqueza ecológica de los hayedos

Multigeruza polimerikoak: mediku-protesietarako materialen ezaugarriak hobetzeko bidea

Irudia: Azken hamarkadetan asmatutako material mota ezberdinei esker, moldagarritasun handia daukagu inplanteak diseinatzeko

Kateter baskularrak, bihotz balbulak edota gernu-kateterrak lortzeko berriz, aproposagoak dira polimeroekin egindako inplanteak, elastikotasun handiagoa eta propietate mekaniko onak aurkezten baitute. Hauen artean polietilen tereftalatoak (PET) arreta handia bereganatu du azken urteetan, biobateragarritasun moderatua aurkezten duelako, propietate mekaniko oso onak eta egonkortasun termikoaz gainera.

Hala ere, polimeroek eta material ez-organikoek, errefus arazoak sortzen dituzte askotan. Nahiz eta hau gertatzeko arrazoi ugari egon, jatorri nagusia bakterioak pilatzeagatik sortzen diren biofilmak dira. Biofilmak bakterio komunitate bat dira, organismo bakar baten moduan jokatzen dutena. Hauek inplante artifizialetan eratzen dira gure ehun zelularrak hazi baino lehen, eta behin eratuta, antibiotikoekin konpontzea zaila da, biofilmak bakterioak babesten dituelako.

Beraz, biofilmen eraketa ekiditzeko, bakterioen hasierako itsaspena sahiestu behar da inplanteetan. Hau lortzeko, jatorrizko materialaren propietateak aldatu gabe, gainazalaren eraldaketa irtenbide ona da. Izan ere, molekula edo konposatu ezberdinak gure gainazalean txertatuz propietate ezberdinak lortu ahal ditugu. Adibidez, materialaren hidrofilitatea handitzeak biobateragarritasuna handitzeaz gain, bakterioen itsaspena zaildu egiten du. Bestalde, konposatu kimiko batzuek bakterioak kontaktuan hiltzeko gaitasuna dutela frogatu da. Polisakarido batzuek lehen aipatutako propietate hauek erakusten dituzte. Azido hialuronikoa esaterako, naturako konposaturik hidrofilikoenetarikoa da, biobateragarria eta biodegradagarria izateaz gainera. Beste aldetik, kitosanoak bakterioak hiltzen ditu kontaktuan, haien mintzak apurtu egiten dituelako.

Bi polisakarido hauek polielektrolitoak dira, hau da, pH espezifikoetan karga daukate. Azido hialuronikoak karga negatiboa dauka eta kitosanoak karga positiboa. Honi esker bien multigeruzak eraikitzeko oso egokiak dira, geruz-geruzeko metodologia erabiliz. Metodologia honetan, gure inplantea karga positiboa eta karga negatiboa duten disoluzio ezberdinetan sartzen da, eta disoluzioan dauden konposatuak itsatsita geratzen dira gainazalean indar elektrostatikoei esker. Hortaz, gure materiala azido hialuronikoan eta ondoren kitosanoan sartzen badugu, prozesua nahi bezain beste errepikatuz, hialuroniko eta kitosano multigeruzak lortu ditugu gainazalean, haien bien propietate interesgarriak dauzkan gainazal berri bat lortuz.

Metodologia honen moldakortasuna frogatzeko, lan honetan azido hialuroniko/kitosano multigeruzak inplanteetarako bi substratu ezberdinetan eraiki dira; titanioa substratu ez-organiko gisa eta polietilen tereftalatoa substratu polimeriko gisa; etorkizun handiko inplanteak egiteko material bereziak lortzeko asmotan.

Artikuluaren fitxa:- Aldizkaria: Ekaia

- Zenbakia: Ekaia 33

- Artikuluaren izena: Multigeruza polimerikoak: mediku-protesietarako materialen ezaugarriak hobetzeko bidea.

- Laburpena: Biomedikuntza arloan inplante moduan erabiltzeko material berrien eskaera handia dago, baina errefus arazoak sortzen dituzte biobateragarritasun kontuak direla eta. Lan honetan azalduko dugu nola eraldatu dugun bi substratu motaren gainazala. Bat ezorganikoa izango da eta bestea polimerikoa. Geruzaz geruzako («layer by layer») estrategiaz baliatuta, azido hialuroniko eta kitosanozko multigeruzak sortuko dira. Kitosanoa fluoreszenteki markatu eta mikroskopio konfokalean fluoreszentzia- hazkundea behatu ondoren, ondorioztatu da geruzak modu arrakastatsu batean sortu direla. Honi esker, materialaren hidrofilitatea areagotzea lortu da, eta horrela, bakterioen aurkako gainazala lortzeaz gainera materialaren biobateragarritasuna handituko da modu merke eta sinple batean.

- Egileak: Ainara Valverde, Leyre Pérez.

- Argitaletxea: UPV/EHUko argitalpen zerbitzua.

- ISSN: 0214-9001

- Orrialdeak: 81-95

- DOI: 10.1387/ekaia.17856

————————————————–

Egileez:

Ainara Valverde eta Leyre Pérez POLYMAT eta UPV/EHUko Zientzia eta Teknologia Fakultateko Kimika Fisikoa saileko Kimika Makromolekularreko Laborategian dabiltza.

———————————————–

Ekaia aldizkariarekin lankidetzan egindako atala.

The post Multigeruza polimerikoak: mediku-protesietarako materialen ezaugarriak hobetzeko bidea appeared first on Zientzia Kaiera.

Hay que ser más extenso y menos intenso…

Foto: Lautaro Andreani / Unsplash

Foto: Lautaro Andreani / UnsplashSeguro que todos habéis tenido en vuestras manos alguna bengala encendida. Son una cosa casi mágica: fuego, chispas… follón. Lo que le gusta a cualquier crío.

Es posible que también hayáis dado un salto al ver que una chispa caía en vuestra piel o en vuestra ropa… con el consiguiente alivio y sorpresa al ver que no pasaba nada (a no se que, en lugar de una chispa, fuera un “trocito” de la bengala”).

¿Cómo es esto posible si la chispa de la bengala está a más de mil grados y ya chillamos si el agua de la ducha sale un poco caliente?

Quizá la culpa la tengamos los propios profesores, solemos decir que la temperatura de una idea de la energía térmica que hay en un sistema, y quizá dimos a entender que la temperatura y la energía térmica eran la misma cosa. Y no lo son.

Usemos un símil. Si te digo que tengo un conjunto de personas que con bastante dinero en sus bolsillos, ¿qué puedes decirme sobre la cantidad de dinero total de ese conjunto? Espera, otra pregunta, y si te digo que también tengo otro conjunto de personas con no demasiado dinero en sus bolsillos, ¿puedes saber si la cantidad de dinero total del primer conjunto es superior a la del segundo?

Efectivamente, no se puede afirmar absolutamente nada. Si el segundo conjunto es mucho más numeroso que el primero, podría tener un montante total muy superior. La medida “dinero por persona” no es suficiente para saber la “energía total” del conjunto. Bien, pues la temperatura se parece un poco a eso, a una variable que puede estimar la energía “promedio” de las partículas elementales que vibran o se mueven en un sistema.

Volviendo a nuestra bengala, podríamos decir que hay mucha “densidad de energía” en esa chispa tan pequeña, lo que no implica que la cantidad total de energía sea mucha, precisamente por lo pequeña que es. De esta forma, la chispa no tiene energía suficiente para quemarme.

En física llamamos variables intensivas a aquellas que no dependen del tamaño del sistema, como la temperatura o la densidad. Ya sabéis que la densidad del agua es, aproximadamente un kilogramo por litro, ya tengas un vaso o una piscina. La densidad nos da “cuánta masa hay en un volumen dado” no la cantidad global (como si habláramos de personas por metro cuadrado en una manifestación). Por eso bromas como “mira, estamos a dos grados centígrados, no tocamos ni a uno cada uno”, no tienen ningún sentido. Cada punto de la estancia estará a dos grados.

Hay otras variables que llamamos extensivas que sí que aumentan o disminuyen al cambiar el tamaño del sistema, como la masa, el volumen o la energía térmica. Una curiosidad, a veces al operar con variables extensivas nos da una variable intensiva. Por ejemplo, el volumen o la masa de un objeto son variables extensivas, si hago el objeto el objeto el doble de grande, tendrá dos veces el volumen, claro, y dos veces la masa. Pero si pienso en la densidad, que es la masa dividida por el volumen, esos dos factores “2” se simplifican y la densidad seguirá siendo la misma, sin variar por el tamaño del sistema, por lo tanto una variable intensiva.

Pero hablemos con un poco más de detalle de cómo se da la transferencia de energía entre los cuerpos calientes y los fríos (si no hay cambio de estado).

Primero, aclarar que la temperatura es una variable macroscópica, no tiene sentido decir que una molécula está a tantos grados centígrados, diremos que los sistemas macroscópicos están a cierta temperatura, y podremos relacionar esta magnitud con asuntos microscópicos como la velocidad a la que se mueven las partículas.

Digamos entonces que tenemos dos sistemas de distinta masa y de distinto material que están a distinta temperatura.

De nuestro símil de antes, sabemos que estos dos sistemas difieren tanto en la temperatura, como en la energía total que tienen, pudiendo suceder que tenga más energía térmica global aquel que tiene menor temperatura.

¿Qué pasa cuando los ponemos en contacto térmico?

Pues, antes de que empecéis a soltar hipótesis, os diré que pasa exactamente lo que le da la gana a la naturaleza. Nunca está de más recordar que la ciencia se basa en el empirísmo, en ver qué sucede y dar cuenta de ello intentando buscar patrones y regularidades.

Podría ser que la energía pasase del que tiene más energía al que tiene menos hasta igualarse las energías globales en ambos sistemas. Podría ser. Pero no es. Lo que ocurre es que la energía pasa de uno a otro hasta que las temperaturas se equilibran, quedando ambos sistemas con energías distintas, y a este “estado de vibración similar” es lo que llamamos equilibrio térmico y es de lo que habla la Ley Cero de la Termodinámica.

De esta forma, si el cuerpo frío tiene menos materia, con una fracción pequeña de energía proveniente del cuerpo grande, sería suficiente para agitar sus “pocas partículas” hasta tener “un estado de vibración similar” entre ambos sistemas, una misma temperatura.

Pero aún falta otro factor a tener en cuenta. La distinta naturaleza de los materiales entre ambos sistemas. Si un kilo de material absorbe una unidad de energía, ¿elevará su temperatura los mismos grados, sea cual sea el material? Podría ser, ya sabéis, no depende de lo que os apetezca u os parezca razonable. Podría ser… pero no.

Algunos materiales necesitan absorber mucha energía para que un kilo de sustancia incremente su temperatura un grado y otros, bastante menos. A esta característica le llamamos calor específico.

Así, hay sustancias que cuesta mucho calentar. Tú aportas y aportas energía, y aquello no sube la temperatura. Fíjate que también hay otra manera de ver este efecto: estos materiales funcionan como una “reserva de energía” porque al enfriarse, cederán un montón de energía cada grado que vayan bajando su temperatura.

Una sustancia común con una capacidad calorífica bastante relevante es el agua líquida y, por esa razón, funciona como un regulador de temperatura en la costa. Absorbiendo el calor cuando la temperatura es alta y cediéndolo cuando baja.

Esto se resume en una fórmula que quizá ahora os parezca muy sencilla de entender.

Q = m C (T2-T1)

La pondríamos en palabras así: El calor que un material absorbe o cede* al cambiar su temperatura de T1 a T2 es proporcional a cuánta materia hay y a cual es su calor específico.

Si volvemos a pensar en nuestra chispa, aunque la diferencia de temperatura con nuestra piel es elevada, debido a la poca masa, cuando iguale su temperatura con nosotros, el calor que nos cederá será una cantidad muy pequeña.

La idea de este artículo nace al ver un tuit en el que se hablaba de la influencia en el calentamiento global de las pruebas nucleares y detonaciones que se llevaron a cabo en la segunda mitad del siglo XX y argumentaban la enorme temperatura de esas explosiones.

Ya estáis en condiciones de buscar vuestra propia información (o hacer vuestros propios cálculos), lo que está claro es que esa afirmación no puede sostenerse exclusivamente argumentado la temperatura de las explosiones, hay que estimar qué energía total se disipó y cuánto aumento de temperatura sería capaz de producir en la atmósfera como conjunto.

Aquí tenéis un interesante hilo de Pedro J. Hernandez (@ecosdelfuturo) donde hace las cuentas… los números os sorprenderán. Agradecemos a Pedro, como siempre, su incansable labor en la información y el detalle.

Como suelo decir: El que mide, sabe. El que no, sólo opina.

Sobre el autor: Javier Fernández Panadero es físico y profesor de secundaria además de escritor de libros de divulgación.

[*] Nota del editor: Esto es una forma coloquial de hablar. En puridad lo que se absorbe o cede es energía y la forma en la que se transfiere es calor. El calor, recordemos, es una forma de transferencia de energía, no un fluido o cosa similar. Más aquí.

El artículo Hay que ser más extenso y menos intenso… se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Menos felices y menos insatisfechos a medida que envejecemos

- Una fórmula para dominarlos a todos: La conservación de la energía y la ley de la palanca

- No era tan fácil: wifi y cáncer

Shizuo Kakutani y sus teoremas

El matemático Shizuo Kakutani (1911-2004) nació tal día como hoy, hace 108i años.

Shizuo Kakutani. Imagen: Wikimedia Commons.

Shizuo Kakutani. Imagen: Wikimedia Commons.

Es sobre todo conocido por haber demostrado el teorema del punto fijo que lleva su nombre y que generaliza el teorema del punto fijo de Brouwer:

Consideremos S un subconjunto no vacío, compacto y convexo del espacio euclidiano de dimensión n. Sea φ una función de S en el conjunto potencia de S, semicontinua superiormente, convexa y tal que φ(x) es un conjunto cerrado y no vacío para todo x en S. Entonces φ tiene un punto fijo.

Este teorema posee aplicaciones en economía y teoría de juegos. Por ejemplo John Nash lo utilizó para demostrar la existencia de equilibrios de Nash en estrategias mixtas.

Otras de sus contribuciones matemáticas son el teorema de Kakutani (todo cuerpo convexo en un espacio tridimensional tiene un cubo circunscrito, es decir, un cubo tal que todas sus caras tocan al cuerpo), el concepto de descomposición en rascacielos de Kakutani en teoría ergódica o su solución de la ecuación de Poisson usando métodos de análisis estocástico.

Kakutani ayudó a difundir la conjetura de Collatz, que a veces se nombra también “conjetura de Kakutani”. ¿Y qué dice la conjetura de Collatz? Lo vamos a recordar a través de un fragmento de la obra de teatro Incendios del dramaturgo Wajdi Mouawad. La siguiente es una conversación entre Jeanne, matemática, y su hermano gemelo Simon:

Jeanne (J): ¡De acuerdo! Hay una conjetura muy extraña en matemáticas. Una conjetura que nunca se ha demostrado. Me vas a dar un número, cualquiera. Si el número es par, se divide por dos. Si es impar, se multiplica por tres y se suma uno. Haremos lo mismo con el número que se obtiene. Esta conjetura afirma que cualquiera que sea el número de partida, por este procedimiento se llega siempre a uno. Di un número.

Simon (S): Siete.

J: Bueno siete es impar. Lo multiplicamos por tres y le añadimos uno, da…

S: Veintidós.

J: Veintidós es par, se divide por dos.

S: Once.

J: Once es impar, se multiplica por tres, y se añade uno:

S: Treinta y cuatro.

J: Treinta y cuatro es par. Se divide por dos, diecisiete. Diecisiete es impar, se multiplica por tres, y se suma uno, cincuenta y dos. Cincuenta y dos es par, se divide por dos, veintiséis. Veintiséis es par, se divide por dos, trece. Trece es impar. Se multiplica por tres y se suma uno cuarenta. Cuarenta es par, se divide por dos, veinte. Veinte es par, se divide por dos, diez, diez es par, se divide por dos, cinco. Cinco es impar, se multiplica por tres y se suma uno. Dieciséis. Dieciséis es par, se divide por dos, ocho, ocho es par, se divide por dos, cuatro, cuatro es par, se divide por dos, dos, dos es par, se divide por dos, uno. Independientemente de la cifra inicial, se llega a… ¡No!

¿A qué se llega? Al número 1.

En este enlace, puedes introducir el número que quieras y comprobar que, efectivamente, realizando las operaciones indicadas se llega a 1…

Por si acaso, he hecho una prueba con el famoso número 241543903 y, siguiendo la regla antes explicada, este calculador ha ido obteniendo los siguientes números:

241543903, 724631710, 362315855, 1086947566, 543473783, 1630421350, 815210675, 2445632026, 1222816013, 3668448040, 1834224020, 917112010, 458556005, 1375668016, 687834008, 343917004, 171958502, 85979251, 257937754, 128968877, 386906632, 193453316, 96726658, 48363329, 145089988, 72544994, 36272497, 108817492, 54408746, 27204373, 81613120, 40806560, 20403280, 10201640, 5100820, 2550410, 1275205, 3825616, 1912808, 956404, 478202, 239101, 717304, 358652, 179326, 89663, 268990, 134495, 403486, 201743, 605230, 302615, 907846, 453923, 1361770, 680885, 2042656, 1021328, 510664, 255332, 127666, 63833, 191500, 95750, 47875, 143626, 71813, 215440, 107720, 53860, 26930, 13465, 40396, 20198, 10099, 30298, 15149, 45448, 22724, 11362, 5681, 17044, 8522, 4261, 12784, 6392, 3196, 1598, 799, 2398, 1199, 3598, 1799, 5398, 2699, 8098, 4049, 12148, 6074, 3037, 9112, 4556, 2278, 1139, 3418, 1709, 5128, 2564, 1282, 641, 1924, 962, 481, 1444, 722, 361, 1084, 542, 271, 814, 407, 1222, 611, 1834, 917, 2752, 1376, 688, 344, 172, 86, 43, 130, 65, 196, 98, 49, 148, 74, 37, 112, 56, 28, 14, 7, 22, 11, 34, 17, 52, 26, 13, 40, 20, 10, 5, 16, 8, 4, 2 y 1.

¡Bien! Pasando por 109 números pares y 51 impares, hemos verificado lo que dice la conjetura de Kakutani con el número 241543903, un número cualquiera. ¿Será cierta la conjetura de Collatz? ¿O quizás alguien consiga encontrar un contraejemplo? El tiempo lo dirá…

Más información

-

In Memoriam: Shizuo Kakutani, noted mathematician and inventor, Yale Bulletin & Calendar 33 (1), 27 agosto 2004

-

John J. O’Connor y Edmund F. Robertson, Shizuo Kakutani, MacTutor History of Mathematics archive, Universidad de Saint Andrews

BONUS: Entre otras propiedades matemáticas, 108 es un número abundante (hablamos de este tipo de números en Sumas y sucesiones alícuotas), semiperfecto, tetranacci, hiperfactorial, refactorable o de Devlali. Además, es el número atómico del elemento hasio y la medida (en grados) de los ángulos internos de un pentágono regular. Y, por cierto, con una temperatura interna de 108 grados Fahrenheit (algo más de 42 grados centígrados), los órganos vitales del cuerpo humano comienzan a fallar por sobrecalentamiento…

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y colaboradora asidua en ZTFNews, el blog de la Facultad de Ciencia y Tecnología de esta universidad.

El artículo Shizuo Kakutani y sus teoremas se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Una conjetura sobre ciertos números en el ‘sistema Shadok’

- Incendios, los grafos de visibilidad y la conjetura de Collatz

- El teorema de Ducci

Polinizatzaileekin bueltaka: erleez gain

Irudia: Polinizatzailerik ezagunenak ezti-erleak badira ere, ez dira polinizatzaile bakarrak, ezta nagusiak ere; bestelako intsektuak, zenbait txori eta hainbat ornodun ere polinizazio lanak egiten dituzte. (Iturria: Andrew Mercer)

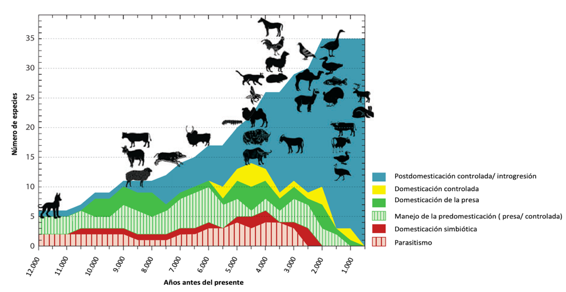

Polinizatzaileen neurketak egitea oso zaila da. Datuak eskasak dira espezie askorentzat eta neurketak eta metodologiak oso ezberdinak eta bateratzen zailak. Hala ere, zenbait tendentzia ikertu egin dira. Blog honetan bertan polinizatzaileen egoeraren inguruko artikulua argitaratu zen 2014. urtean.

Ugaztun eta txori polinizatzaileak beherako joera dute. Orokorrean polinizatzaile ornodunen %16.5 eta polinizatzaile ornogabeen %40 baino gehiago (datuak ezagunak diren kasuetan) desagertze arriskuan daude IPBES txostenaren arabera.

Erleei dagokienez, IUCN lista gorriaren arabera, erle espzieen %9 inguru daude arriskuan. Datuak, dena den, ez dira erabatekoak, zenbait espezieren inguruko datuen falta dela eta. Datu horien gorabeheraren arabera, mehatxupeko espezieen portzentaia %4ra jaitsi edo %60ra igo daiteke.

Eta ezti-erleak? Txosten berberaren arabera, gora doaz kudeatutako erlauntzei dagokionez, zenbait herrialdetan galerak izan badira ere. Europako kolonien inguruan egindako ikerketaren arabera, Erdialdeko Europan ezti-erle kopurua gutxitu da, baina Mediterraneo aldean igo. Ezti-erleen basa koloniak oso eskasak dira eta zenbait tokitan ez dira, Juan Carlos Pérez Hierroren esanetan.

Polinizatzaileen beherakada dago, beraz. Hala ere, 1961–2006 urteetako tendentziak aztertu dituen ikerketaren arabera, polinizatzaileen beherakadak ez du laboreen etekinean eraginik izan. Arazorik ez dago giza elikadurari dagokionez, orduan? Ezta gutxiago ere.

Polinizatzaileen menpeko laboreak goraAurrean esan bezala, giza elikadurarako erabiltzen dira laboreen %75ean baino gehiagotan dute eragina polinizatzaileek maila batean edo bestean eta bolumenari dagokionez, %35.

Laboreen mundu produkzioaren %5-8, 260-640 mila milioi euroko balioa duena, animali polinizazioari zuzenean esleitu dakiokeela estimatzen da. Kontuan izan behar da, hala ere, laboreen arabera polinizatzaileen garrantzia oso ezberdina dela eta, beraz, ekonomian duten pisua ere.

Are gehiago, globalki, gora egin du polinizatzaileen menpeko laboreen produkzioak. IPBES txostenean bildutako datuen arabera, %300 egin du gora azken 50 urteotan. Dependentzia horrek, polinizatzaile mota bakarraren erabilerari lotuta, krisia sortu lezake etorkizunean.

Izan ere, nekazaritza polinizazioari dagokionez, monokultibo bilakatu da ezti-erleen erabilera. Toki batetik bestera eramaten dira koloniak loratze sasoian. Eta nekazaritza (eta honi lotuta, zoruaren erabilera) da polinizatzaileen gainbeheraren kausetako bat.

Hainbat faktore, interakzioanIkerketek erakusten dute hainbat direla polinizatzaileei eragiten dieten faktoreak eta ez dute modu isolatuan eragiten. Faktore horietako batzuk ikertu izan dira:

- Zoruaren erabilera. Zoruaren erabilerak eragin zuzena du polinizatzaileengan. Adibide modura, nekazaritza intentsiboak eremu baten lore eta landareetan aldaketak sortzen ditu, bertako polinizatzaileen elikaduran eta habia egitean ondorioak izanik. Horretaz gain, monolaborantzak ere eragin zuzena du, landare dibertsitatearen galera dela eta, polinizatzaileen elikadura zailtzen baita. Lurra produktiboen eta ez produktiboen banaketak, gainera, habitaten galera eta degradazioa ere ekar ditzake. Lurraldearen ordenazioa egiterakoan polinizatzaileak ez direla kontuan hartzen azaltzen du Juan Carlos Pérez Hierrok.

- Ezti-erlearen gailentasuna. Apis mellifera koloniak mundu mailan mugitzen dira polinizazio lanak egin ditzaten. Tokiko polinizatzaileei eragiten die honek, elikagai murrizketagatik, alde batetik, eta zonaldekoak ez diren gaixotasunei esposizioagatik, bestetik.

- Klima aldaketa. Zenbait espezieren jokamoldean aldaketak eragin ditu klima aldaketak eta baita landareen distribuzioan, poilinizatzaileengan eragin zuzena izanik.

Aurrekoak ez dira faktore bakarrak, gehiago ere ikertu izan dira eta haien arteko interakzioa ere kontuan izatekoa da. Juan Carlos Pérez Hierroren ustetan “Hainbat kausa daude, baina bakar batean sintetizatu daitezke: gizakien interbentzio maila altua prozesu naturaletan”.

Nahiz eta datu falta handia egon, esan daiteke polinizatzaileen egoera ez dela ona oro har. Giza elikagaien produkzioan duten papera kontuan izanik eta, honekin batera, polinizatzaileekiko dependentzia duten laboreen produkzioaren gorakada, polinizatzaileen egoera sakonki ikertu eta eragiten dieten faktoreak identifikatzea garrantzitsu bilakatzen ari da.

Erreferentzia bibliografikoak:

- Ollerton, J. , Winfree, R. and Tarrant, S. (2011). How many flowering plants are pollinated by animals?. Oikos, 120 (3), 321-326, DOI: 10.1111/j.1600-0706.2010.18644.x

- Klein, Alexandra-Maria, et al., (2006). Importance of pollinators in changing landscapes for world crops. Proceedings of the Royal Society B: Biological Sciences, 274 (1608), DOI: http://doi.org/10.1098/rspb.2006.3721

- Wilson, Joseph S., Forister, Matthew L., Carril, Olivia (2017). Interest exceeds understanding in public support of bee conservation. Frontiers in Ecology and the Environment, 15(8), 460–466, DOI:10.1002/fee.1531

- Michener, Charles D. The Bees of The World. The Johns Hopkins University Press. Baltimore. 2007

- Watanabe, Myrna E. (1994). Pollination Worries Rise As Honey Bees Decline. Science, 265 (5176), 1170, DOI: 10.1126/science.265.5176.1170

- Potts, Simon G., et al. (2010). Declines of managed honey bees and beekeepers in Europe. Journal of Apicultural Research, 49 (1), 15-22, DOI: 10.3896/IBRA.1.49.1.02

- Potts, Simon G., et al. (2010). Global pollinator declines: trends, impacts and drivers. Trends in Ecoloby and Evolution, 25 (6), 345-353, DOI: https://doi.org/10.1016/j.tree.2010.01.007

- Garibaldi, Lucas A., et al. (2013). Wild Pollinators Enhance Fruit Set of Crops Regardless of Honey Bee Abundance. Science, 339 (6127), 1608-1611, DOI: 10.1126/science.1230200.

- Regan, E. C. et al. (2015), Global Trends in the Status of Bird and Mammal Pollinators. Conservation letters, 8, 397-403, DOI: 10.1111/conl.12162

- IPBES. The assessment report on pollinators, pollination and food production. Secretariat of the Intergovernmental Science-Policy Platform on

Biodiversity and Ecosystem Services. Bonn. 2016. - IUCN. European Red List of Bees. Publication Office of the European Union. Luxembourg. 2014

- Aizen, Marcelo A., et al. (2008). Long-Term Global Trends in Crop Yield and Production Reveal No Current Pollination Shortage but Increasing Pollinator Dependency. Current Biology, 18 (20), 1572-1575, DOI: https://doi.org/10.1016/j.cub.2008.08.066

- Potts, Simon G., et al. (2016). Safeguarding pollinators and their values to human well-being. Nature, 540, 220–229, DOI: 10.1038/nature20588

- Winfree, Rachael. (2008). Pollinator-Dependent Crops: An Increasingly Risky Business. Current Biology, 18 (20), R968-R969, DOI: https://doi.org/10.1016/j.cub.2008.09.010

The post Polinizatzaileekin bueltaka: erleez gain appeared first on Zientzia Kaiera.

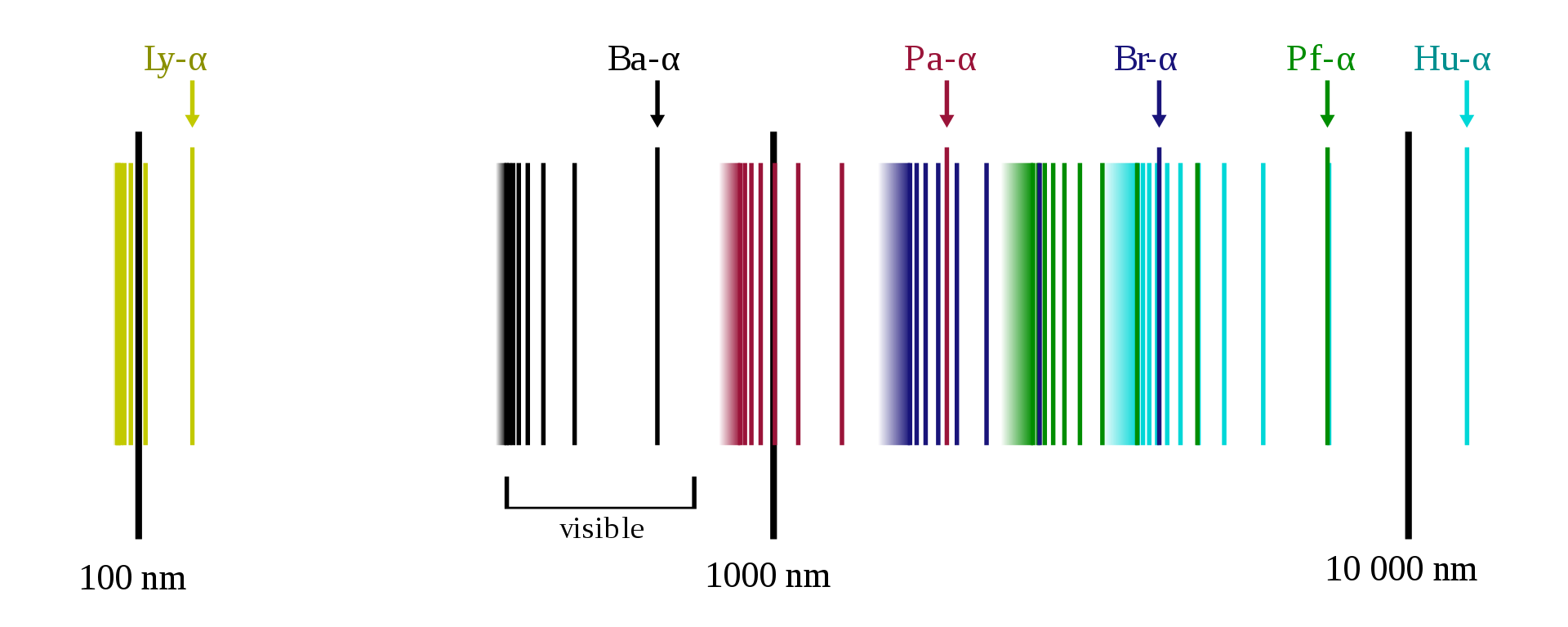

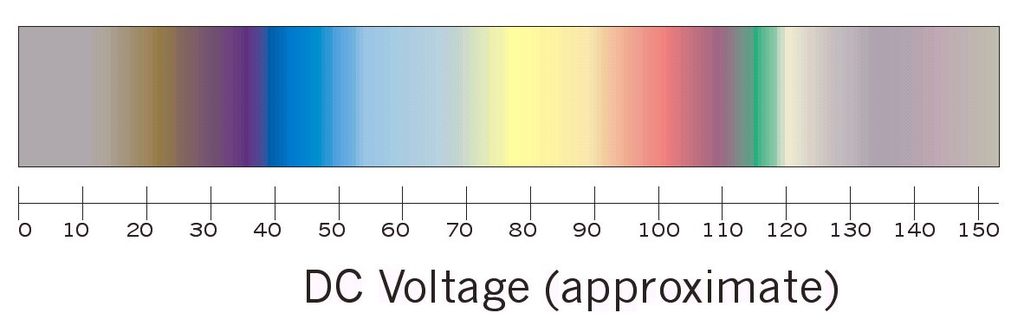

Las regularidades en el espectro del hidrógeno

Foto: Adam Kring / Unsplash

Foto: Adam Kring / UnsplashLas ideas de Balmer sobre el espectro del hidrógeno tuvieron un éxito enorme. Veámoslo.

Para usar la notación moderna, reescribimos la fórmula de Balmer λ = b [n2/(n2-22)] en una forma que nos será más útil:

1/λ = RH (1/22 – 1/n2)

En esta ecuación que, como decimos, puede derivarse de la anterior, RH es una constante, igual a 4 / b. Se llama constante de Rydberg para el hidrógeno, en honor del espectroscopista J.R. Rydberg. Continuando el trabajo de Balmer, Rydberg hizo un gran progreso en la búsqueda de varias series espectrales. La serie de líneas descritas por la fórmula de Balmer se llama la serie de Balmer. Balmer construyó su fórmula a partir de las longitudes de onda conocidas de solo cuatro líneas en la parte visible del espectro. Esta fórmula de Balmer predice correctamente cada una de estas cuatro líneas con una precisión considerable. La fórmula, sin embargo, parecía indicar que podrían existir muchas más líneas en la misma serie [1]. Además,

La sugerencia especulativa [2] de Balmer de reemplazar 22 por otros números ofrece las siguientes posibilidades:

1/λ = RH (1/12 – 1/n2)

1/λ = RH (1/32 – 1/n2)

1/λ = RH (1/42 – 1/n2)

…

Cada una de estas ecuaciones describe una posible serie de líneas de emisión. Todas estas series hipotéticas de líneas pueden resumirse en una fórmula general

1/λ = RH (1/nf2 – 1/ni2)

donde nf sería un número entero que es fijo para cada serie para la que se encuentren longitudes de onda (por ejemplo, nf = 2 para todas las líneas de la serie Balmer). Por otro lado ni representa enteros que toman los valores nf + 1, nf + 2, nf + 3,. . . para las sucesivas líneas individuales en una serie dada (las cuatro primeras líneas de la serie de Balmer, ni toma por tanto los valores 3, 4, 5, y 6) La constante RH debe tener el mismo valor para todas las series del hidrógeno.

Reiteremos que todo esto es pura especulación [2]. No hay nada que indique que deba existir ninguna otra serie, ninguna línea que se ajuste a la fórmula general, excepto la serie de Balmer observada experimentalmente, donde nf = 2. Pero resultó que, cuando la comunidad científica se puso a buscar estas líneas hipotéticas con buenos espectrómetros descubrió que, de hecho, ¡existen!

En 1908, F. Paschen encontró dos líneas del hidrógeno en el infrarrojo. Sus longitudes de onda se correspondían con notable precisión a la fórmula general estableciendo nf = 3 y ni = 4 y 5. Desde entonces, se han identificado muchas otras líneas en esta «serie de Paschen». Con técnicas y aparatos experimentales mejorados, se pudieron explorar nuevas regiones del espectro. Así, se fueron agregando gradualmente otras series a las series de Balmer y de Paschen. Las series del espectro del hidrógeno descubiertas son las siguientes (entre paréntesis año de descubrimiento):

Lyman (1906–1914) nf =1, ni = 2, 3, 4, . . . en el ultravioleta;

Balmer (1885) nf = 2, ni = 3, 4, 5, . . . en el ultravioleta-visible;

Paschen (1908) nf = 3, ni = 4, 5, 6, . . . en el infrarrojo;

Brackett (1922) nf = 4, ni = 5, 6, 7, . . . en el infrarrojo;

Pfund (1924) nf = 5, ni = 6, 7, 8, . . . en el infrarrojo;

Humphreys (1953) nf = 6, ni = 7, 8, 9, . . .en el infrarrojo.

Líneas espectrales del hidrógeno en escala logarítmica. Se señala la primera línea (α) de cada una de las series. Imagen: Wikimedia Commons

Líneas espectrales del hidrógeno en escala logarítmica. Se señala la primera línea (α) de cada una de las series. Imagen: Wikimedia CommonsBalmer también especuló con la idea de que su fórmula para el espectro del hidrógeno pudiera ser un patrón para encontrar relaciones en los espectros de otros gases. Esta sugerencia también dio fruto. La fórmula de Balmer en sí misma no funcionó directamente para describir espectros de gases distintos al hidrógeno. Pero sí inspiró fórmulas de forma matemática similar que describieron con éxito el orden en porciones de muchos espectros complejos [3].

Para sorpresa de muchos y desesperación de otros no se podía construir ningún modelo basado en la mecánica clásica y el electromagnetismo que explicara los espectros descritos por estas fórmulas.

Lo que ya hemos visto sobre la teoría cuántica sugería una línea de ataque. Obviamente, la emisión y absorción de luz de un átomo debe corresponder a una disminución y un aumento de la energía del átomo. Si los átomos de un elemento emiten luz de solo ciertas frecuencias, entonces la energía de los átomos debe poder cambiar solo en ciertas cantidades. Estos cambios de energía deben implicar la reorganización de las partes del átomo. Se hacía imprescindible cambiar radicalmente el enfoque a la hora de construir un modelo de átomo viable. Pero era necesario un ingrediente fundamental adicional antes de que se construyese un modelo atómico que pudiese tener éxito: el descubrimiento de que el átomo es, básicamente, espacio vacío.

Notas:

[1] De hecho, infinitas, ya que n = 3, 4, 5, 6, 7, 8,… ∞

[2] Y numerológica. Es por pura simetría matemática. Funciona porque funciona, pero recordemos que tras la sugerencia de Balmer no hay ninguna base física a priori.

[3] La constante de Rydberg RH también reapareció en estas fórmulas empíricas.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo Las regularidades en el espectro del hidrógeno se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Las líneas de Balmer

- El hidrógeno en el Universo (I): La emisión del hidrógeno neutro a 21 cm.

- La ley del gas ideal y la tercera ley de la termodinámica

Los límites del ferrocarril

Iván Rivera

Foto:Konstantin Planinski / Unsplash

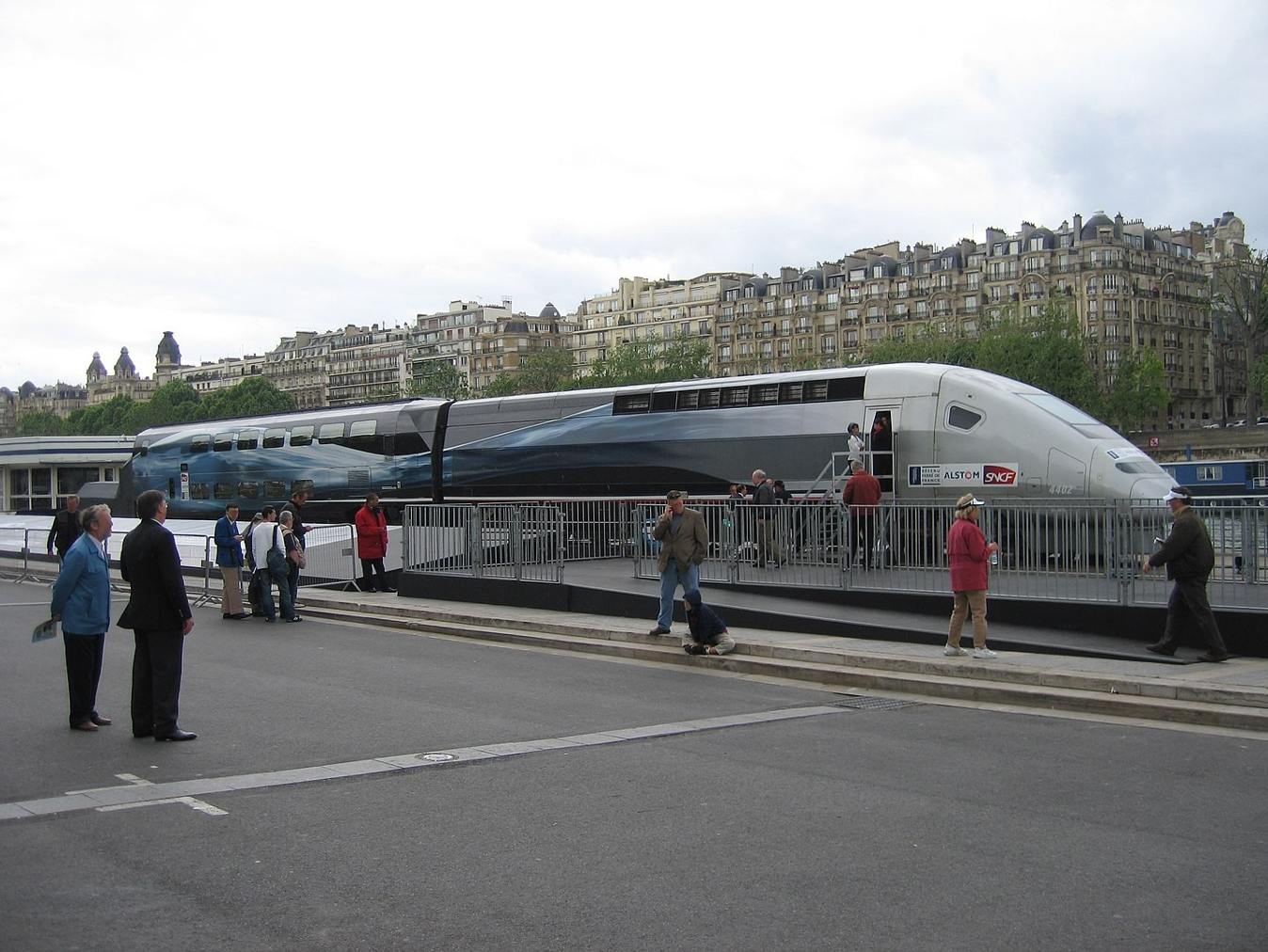

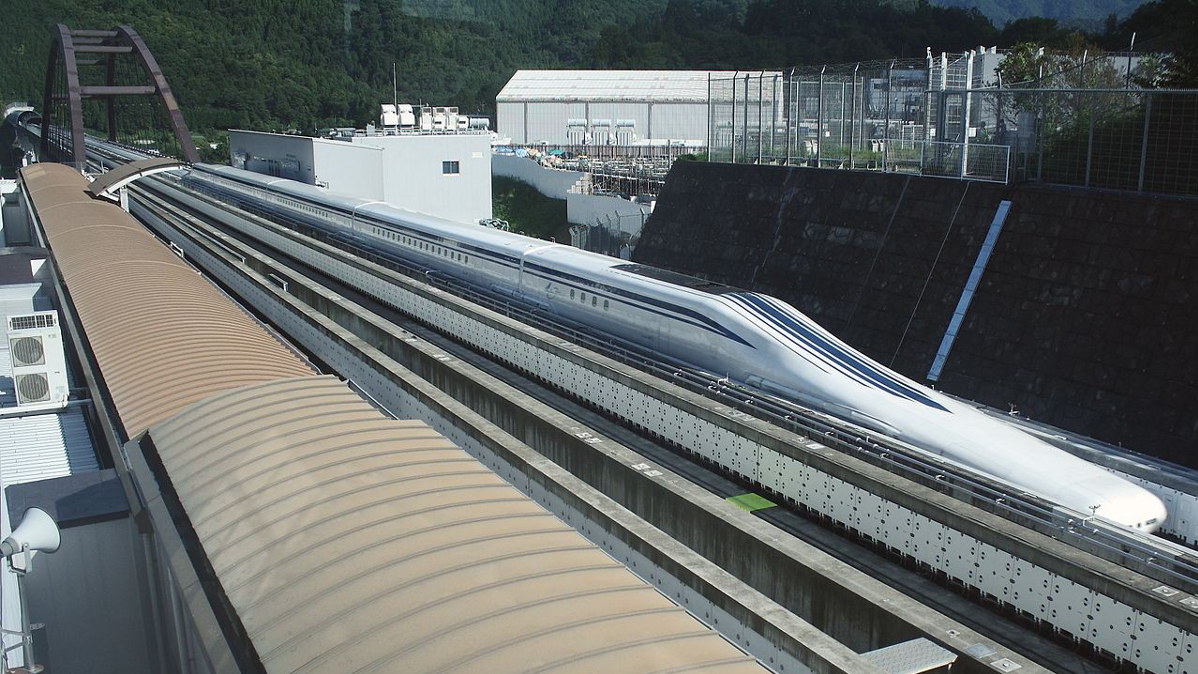

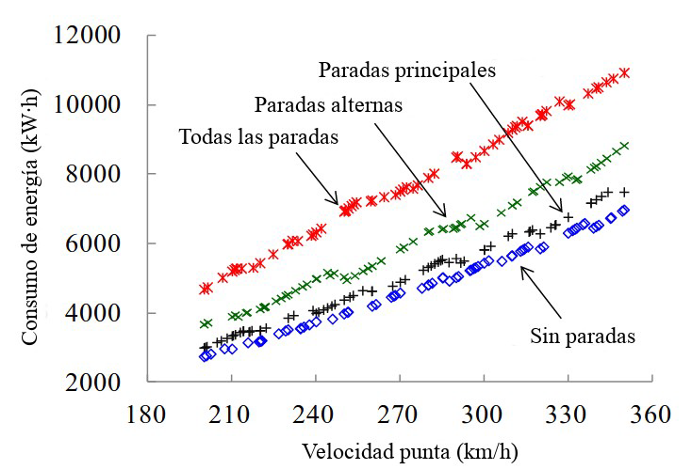

Foto:Konstantin Planinski / UnsplashYa han pasado doce años desde que se logró el récord del mundo de velocidad en ferrocarril. La que se dio en llamar «Operación V150» por la velocidad objetivo, 150 metros por segundo o 540 kilómetros por hora, ocupó desde enero de 2007 hasta abril del mismo año a un equipo formado por la operadora SNCF, el gestor de infraestructuras Réseau Ferré de France y el fabricante de material móvil Alstom. El 3 de abril, a las 13 horas, 13 minutos y 40 segundos, el TGV V150 construido para la ocasión por esta última empresa alcanzó los 574,8 km/h en el punto kilométrico 194 de la línea TGV-Est entre las estaciones de Prény y Champagne-Ardennes, cerca de la localidad de Éclaires —quizá en un giro involuntariamente poético para los ingenieros a cargo: éclaires significa en español «(tú) iluminas».

Con un gasto de 30 millones de euros, la Operación V150 no fue solo un ardid publicitario para cementar el prestigio nacional de una industria ante la dura competencia alemana y, cada vez más, china. Durante los múltiples recorridos de prueba en los que el anterior récord de 1990 (515,3 km/h) fue superado extraoficialmente en varias ocasiones, los ingenieros del proyecto monitorizaron en detalle el comportamiento del vehículo, la vía y la catenaria para determinar en cada caso sus límites operativos.

Más de una década después, ¿qué conclusiones pueden extraerse de este experimento para el ferrocarril? ¿Por qué la velocidad máxima de los trenes ha parecido estancarse en los 350 kilómetros por hora desde hace décadas? Para entenderlo, hagamos un repaso por el sistema ferroviario prestando especial atención a los factores susceptibles de limitar su rendimiento.

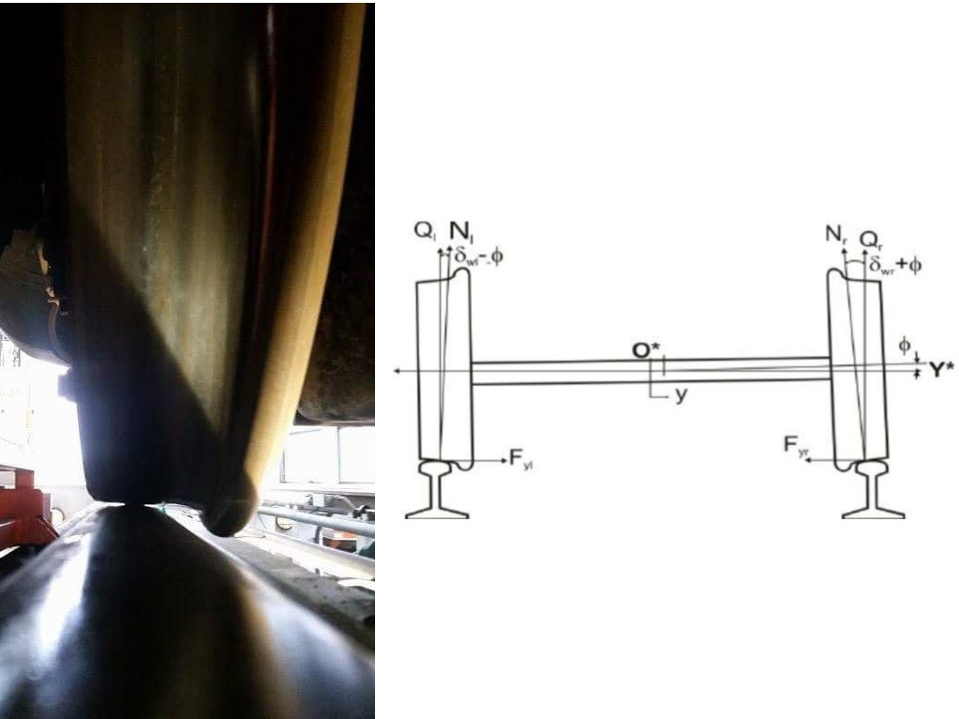

El contacto rueda-carril

El tren es un medio de transporte terrestre guiado, lo que significa que solo puede moverse a lo largo de una estructura —la vía— formada por raíles paralelos entre sí, mantenidos en su sitio mediante sujeciones a unas piezas usualmente de hormigón denominadas traviesas. La vía no está anclada a su plataforma: solo descansa sobre ella. Su estabilidad está asegurada por su propio peso. Las ruedas del tren, de acero como los raíles, tienen un perfil ligeramente cónico rematado por una pestaña por el lado interior que asegura que los ejes se mantengan centrados sobre la vía sin descarrilamientos [Casanueva, 2014]. El perfil de las ruedas garantiza el centrado durante la mayor parte de los trayectos apoyándose sobre la cabeza del raíl, mientras que las pestañas sujetan al tren en caso de desplazamientos laterales excesivos.

Imagen1. Rueda y carril. Foto: CAF.

Imagen1. Rueda y carril. Foto: CAF.

Cuando la vía no se bifurca, presenta una estructura geométrica formada por secuencias de rectas y arcos de circunferencia unidos entre sí mediante curvas de acuerdo para evitar discontinuidades en el radio de curvatura —infinito en una recta, finito en plena curva— y, por tanto, eliminando así posibles saltos en la aceleración radial experimentada por los trenes a lo largo de su trayecto. Para limitar aún más esta aceleración y tolerar radios de curvatura más pequeños, las vías van peraltadas: el plano de rodadura se inclina hacia el lado interior de la curva con un ángulo que depende de la velocidad esperada de los trenes y su peso por eje.

Sin duda, el contacto rueda-carril es uno de los grandes inventos de la humanidad a la hora de reducir la energía necesaria para transportar grandes cantidades de pasajeros y carga. La superficie de contacto por rueda sobre la cabeza del carril apenas es de 250 mm², garantizando unas fuerzas de rozamiento mínimas —el coeficiente de resistencia a la rodadura del acero sobre acero es, en el peor de los casos, 30 veces menor que el del caucho sobre asfalto.

Imagen 2. Contacto rueda-carril: detalle y diagrama. Fuente: TER Pays de la Loire / Anyakwo, Pislaru, Ball, & Gu, 2011.

Imagen 2. Contacto rueda-carril: detalle y diagrama. Fuente: TER Pays de la Loire / Anyakwo, Pislaru, Ball, & Gu, 2011.Sin embargo, en Física nunca se obtiene nada sin sacrificar otra cosa a cambio: la capacidad de mover centenares de toneladas con una fuerza de tracción moderada solo se obtiene a cambio de perder la capacidad de frenar en espacios cortos o de superar pendientes pronunciadas. Es totalmente intuitivo si pensamos en cómo se comporta un automóvil sobre asfalto frente a su respuesta sobre hielo. Si, además, reducimos la anchura de las ruedas y las fabricamos en un material de menor coeficiente de rozamiento («más liso»), no debería resultar extraño que un tren ligero de viajeros requiera algún centenar de metros para detenerse, mientras que un mercante pesado necesite uno o dos kilómetros de vías.

La aerodinámica

Tiempo atrás los trenes tenían testeros —la denominación en jerga ferroviaria del frontal— completamente rectangulares. La velocidad que alcanzaban no era suficiente para que los ingenieros debieran preocuparse por la resistencia que opusiera el aire al avance de un vehículo tan pesado. Sin embargo, el advenimiento de plantas motrices más capaces trajo consigo la preocupación por encontrar formas que permitieran «penetrar» el aire más fácilmente. Hay que buscar el origen de todo ello en la relativamente sencilla ecuación de la fuerza de arrastre aerodinámico, que establece que la resistencia al avance debida al aire es directamente proporcional al cuadrado de la velocidad [1].

Imagen 3. Locomotora de vapor Mallard en el National Railway Museum, York. Foto: PTG Dudva.

Imagen 3. Locomotora de vapor Mallard en el National Railway Museum, York. Foto: PTG Dudva.La lucha por reducir al mínimo el coeficiente de arrastre aerodinámico, en principio empírica y realizada en túneles de viento, y más adelante numérica y ejecutada mediante simulaciones llevadas a cabo en ordenadores de gran potencia de cálculo, tiene límites. Un carenado con un buen coeficiente puede mejorarse mediante faldones específicos para los pantógrafos, sistemas de enganche escamoteables o reduciendo la separación entre coches (vagones, una vez más en jerga ferroviaria). Sin embargo, es fácil ver que rápidamente es necesario llegar a compromisos con la mantenibilidad del sistema o su propia durabilidad. En particular, la separación entre coches debe ser la suficiente como para acomodar sus conexiones flexibles durante la inscripción del tren en las curvas. Cómo un tren formado por elementos fundamentalmente rígidos toma curvas con facilidad es materia para otro artículo.

El contacto pantógrafo-catenaria

La interfaz rueda-carril es la más evidente para quien no haya prestado demasiada atención a la disposición física del sistema ferroviario. Es, además, la única interfaz mecánica que presentan los trenes de propulsión diésel. Sin embargo, las plantas motrices diésel tienen limitaciones intrínsecas que no afectan a los trenes eléctricos y que se resumen en que el rendimiento de los motores de combustión interna tiene un límite impuesto por el segundo teorema de Carnot y la temperatura (fija) de la combustión de la mezcla diésel-aire. Ningún motor diésel presenta rendimientos superiores al 48%, por lo que disponer de más potencia —y a la postre más velocidad— es cuestión, únicamente, de aumentar el número de cilindros. Aumenta así también el consumo de combustible, que debe ser además transportado en depósitos específicos.

El conjunto de compromisos de ingeniería en los que se incurre deriva en que el récord mundial de velocidad de un tren con planta motriz diésel está fijado desde 1987 en 238 km/h, aunque no sin cierta polémica: el prototipo Talgo XXI (actualmente al servicio del gestor de infraestructuras Adif como tren laboratorio) alcanzó los 256,38 km/h entre Olmedo y Medina del Campo en 2002, aunque no se aceptó oficialmente el registro por la falta de una verificación independiente.

Imagen 4. Talgo XXI «Virgen del Pilar» en 2002. Foto: Photocapy

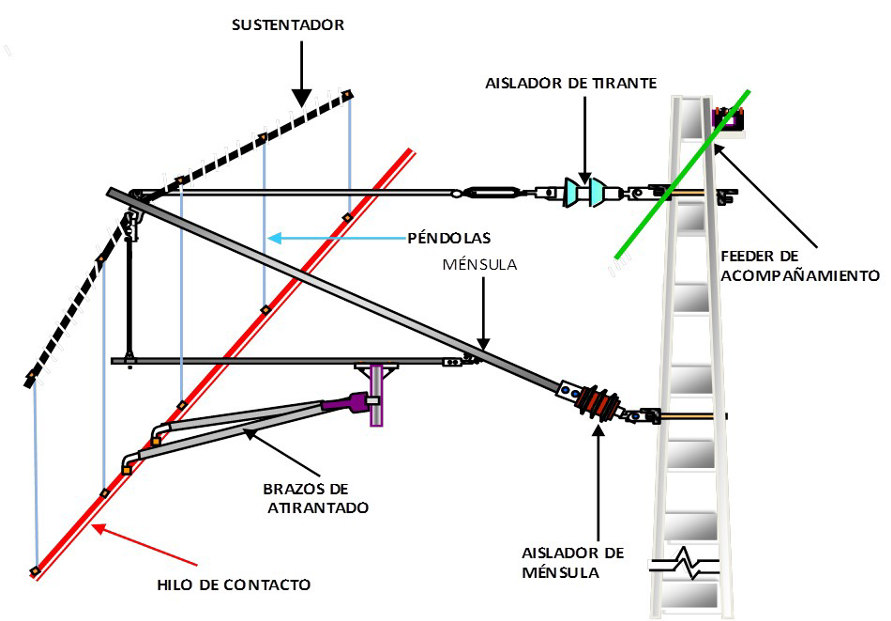

Imagen 4. Talgo XXI «Virgen del Pilar» en 2002. Foto: PhotocapyLos trenes eléctricos presentan una segunda interfaz mecánica. Al no transportar su propia fuente de energía, un tren eléctrico debe avanzar gracias a la corriente eléctrica que toma gracias a un contacto móvil con una estructura conductora ubicada sobre las vías. El contacto móvil se efectúa mediante el pantógrafo: un brazo articulado que mantiene una mesilla con una banda frotadora presionando contra el hilo de contacto, un hilo en aleación de cobre con plata con una resistencia muy baja al paso de la corriente, un coeficiente de rozamiento por fricción muy bajo y una alta resistencia al desgaste.

El hilo de contacto está sujeto —abusando un poco de la terminología— a dos tensiones. Por un lado, la tensión eléctrica que establece (dada la resistencia constante del metal empleado) la máxima corriente que puede solicitar el motor del tren. Por otro, la tensión mecánica que lo mantiene lo más horizontal posible, ya que la mejor calidad del contacto se obtendrá cuanto más regular sea. Naturalmente, el peso propio del hilo provoca una flecha: una diferencia de alturas entre los apoyos del sistema y el centro del vano. La flecha se reduce aumentando la tensión mecánica, que se consigue gracias a sistemas denominados de compensación automática: equipos compuestos por polipastos y contrapesos que mantienen constante la tensión mecánica del hilo de contacto ante los cambios de temperatura diarios y estacionales.

Imagen 5. Poleas del sistema de compensación automática de tensión en

Imagen 5. Poleas del sistema de compensación automática de tensión encatenaria de alta velocidad. Foto: Electrén, S.A.

Las fuerzas involucradas en el contacto pantógrafo-catenaria son despreciables a la hora de calcular la resistencia al avance de un tren, pero deben ser tenidas en cuenta para determinar la durabilidad de la propia catenaria. Al tratarse de una estructura ligera mantenida en tensión mecánica y atravesada por un flujo de corriente eléctrica, la catenaria puede resultar dañada tanto por causas mecánicas como eléctricas. Estos daños pueden ser nominales, provocando desgastes esperables en la estructura, o catastróficos, provocando cortes del hilo o enganchones en el pantógrafo.

La Operación V150

Los trabajos de la Operación V150 se desarrollaron en un doble sentido. Por un lado, se procedió a la construcción de una unidad laboratorio capaz de superar la velocidad de 150 m/s (540 km/h) —de ahí el nombre del proyecto, TGV V150 (Train à Grande Vitesse, tren de alta velocidad). Por el otro, se acondicionó un tramo de 94 kilómetros especialmente escogido de la línea TGV Est con una ligera pendiente descendiente uniforme y radios de curvatura suficientemente amplios para acomodar sin problemas el conjunto de pruebas a realizar. Las circulaciones del proyecto comenzaron en enero de 2007 y terminaron en abril, aumentando paulatinamente la velocidad. Se registraron un total de casi 1000 kilómetros a velocidades superiores a los 500 km/h.

La unidad V150 estaba formada por una inusual composición de dos cabezas motrices situadas entre tres coches remolque: dos unidades de doble cubierta y un coche cafetería central, especialmente construido para la ocasión y habilitado como laboratorio. Además, disponía de una serie de modificaciones especialmente concebidas para el intento de récord.

Imagen 6. Cabeza tractora y coche de la composición, expuestas en París tras la campaña del récord. Foto: Gonioul.

Imagen 6. Cabeza tractora y coche de la composición, expuestas en París tras la campaña del récord. Foto: Gonioul.La propulsión estaba garantizada por las dos cabezas motrices («locomotoras», traduciendo una vez más de la jerga profesional) y por dos bogies motores [2] articulados AGV montados en los extremos del coche cafetería. Los motores asíncronos de las cabezas habían sido potenciados un 56% por encima del valor habitual en su clase, hasta llegar a los 1950 kW. Los motores síncronos de imanes permanentes de los bogies fueron ajustados igualmente hasta alcanzar los 1000 kW (un 39% por encima de su potencia nominal). El conjunto podía desarrollar así una potencia total de 19,6 MW.

Se recurrió a un «viejo truco» empleado en las locomotoras de vapor para mejorar la velocidad a expensas del par motor —lo que afecta, fundamentalmente, a la capacidad de arranque: usar ruedas de un diámetro mayor. Se montaron ruedas de 1092 mm frente a las habituales de 920 mm. El ligero incremento de la altura del conjunto fue compensado, para mejorar sus prestaciones aerodinámicas, con mayores faldones en todo su contorno.

Además de éste, las modificaciones destinadas a enfrentar el flujo de aire a velocidades superiores a los 150 m/s fueron muy numerosas. Se sustituyó el carenado retráctil de dos piezas que protege el sistema de enganche automático de los testeros con una sola pieza continua. Se montó un parabrisas especial enrasado con la carrocería, y se desmontó el limpiaparabrisas. Toda la superficie inferior del conjunto fue panelada para reducir la resistencia aerodinámica y proteger los componentes expuestos al fenómeno de vuelo de balasto que producen las turbulencias propias de la circulación a altas velocidades.

Además, los pantógrafos de corriente continua que permiten la operación de las cabezas motrices en vías alimentadas de esta forma fueron retirados, y sus huecos panelados y enrasados. Las separaciones entre coches fueron protegidas con juntas flexibles superficiales. Incluso llegaron a diseñarse faldones específicos para los bogies, que finalmente no fueron utilizados durante la prueba del récord.

Las modificaciones de la infraestructura

El ferrocarril es un sistema de transporte en el que los vehículos y su infraestructura correspondiente están fuertemente acoplados. Por este motivo, era de esperar que la vía y la catenaria del programa V150 también sufrieran una serie de ajustes y modificaciones destinadas a garantizar un resultado final exitoso.