Cómo hacer un queso de pasta blanda y corteza tratada en casa

Comparándolos con los quesos duros, la fabricación de quesos de pasta blanda en sí es un proceso más sencillo. A cambio, su affinage puede ser más complejo y el trato a sus cortezas da lugar a múltiples variedades de quesos, dependiendo de las levaduras, mohos y bacterias que se incluyen y las técnicas que se utilizan.

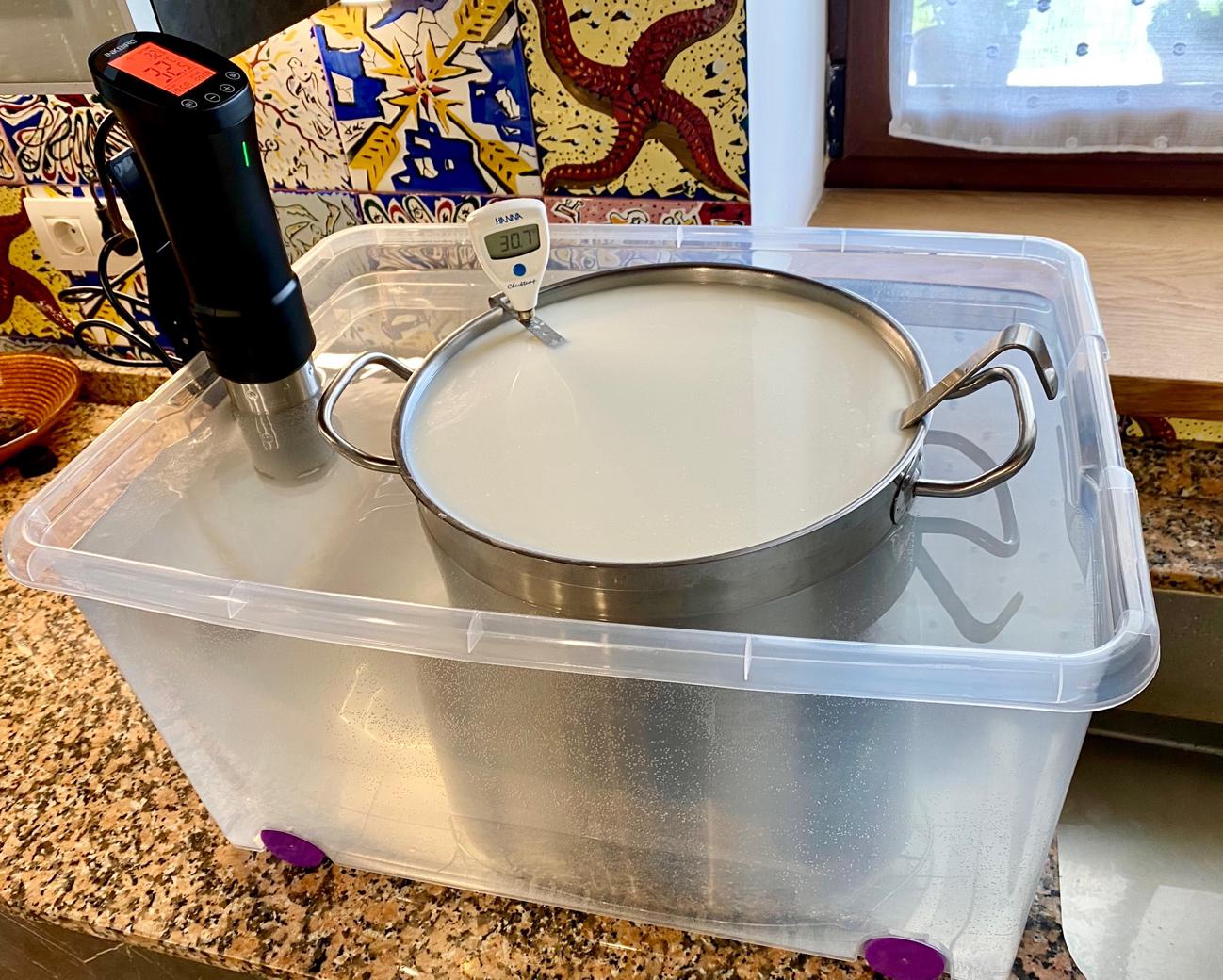

Templado de la leche al baño maría a 30.7ºC constantes, para efectuar la siembra. Foto: Victor Etxebarria

Templado de la leche al baño maría a 30.7ºC constantes, para efectuar la siembra. Foto: Victor Etxebarria

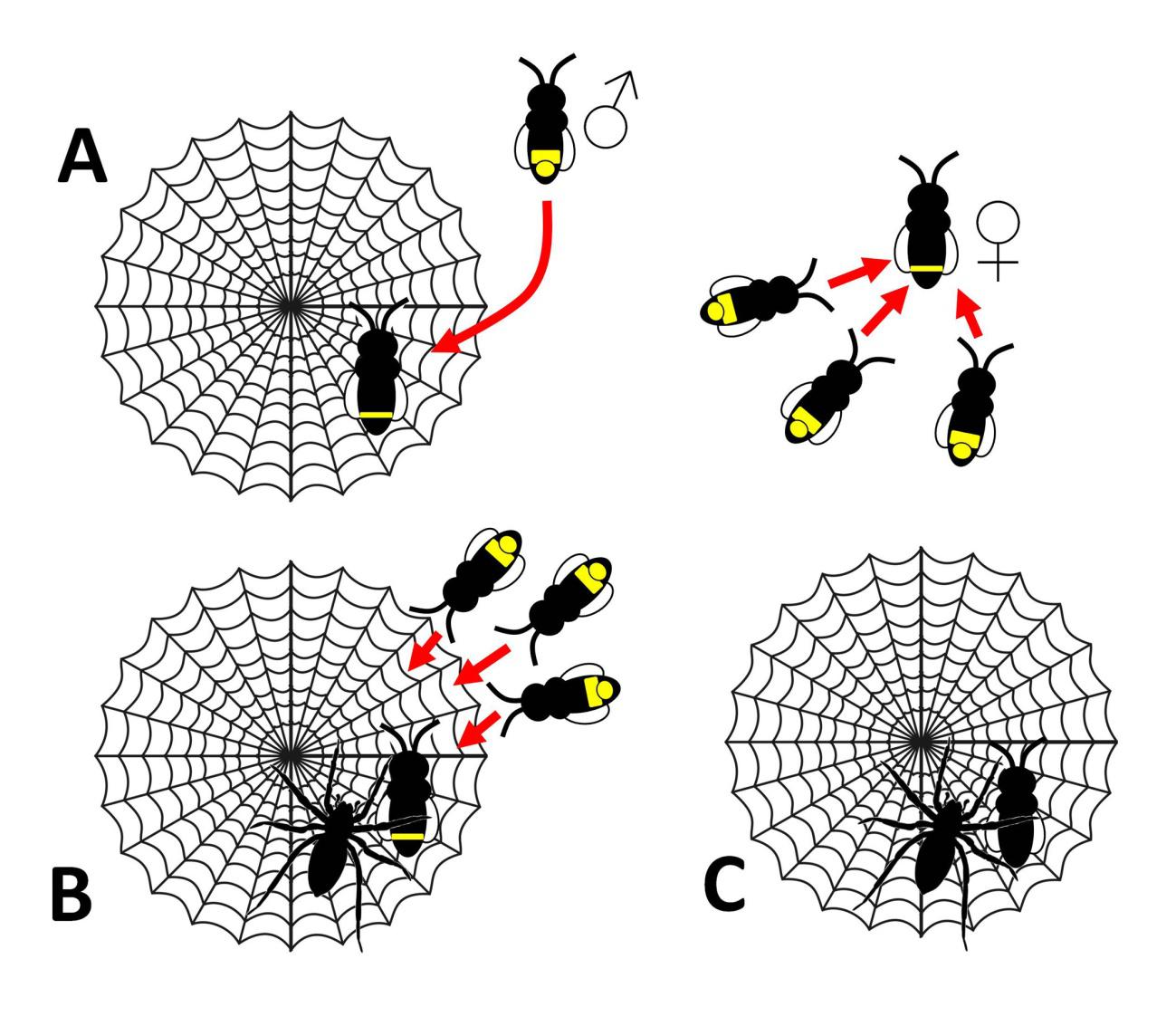

De la misma manera que comenzamos el proceso de fabricación de quesos duros, partimos del laboratorio perfectamente ordenado y limpio, y usamos el baño maría mostrado en la Figura 1 para colocar la leche a una temperatura cercana a los 30ºC, ideal para los Lactococcus mesófilos, que comienzan a consumir lactosa y acidificar la leche a pleno rendimiento. Para regular la acidificación, añadimos a la leche al menos Lactococcus lactis, cremoris y quizás diacetylactis, que son las lactobacterias más utilizadas en la fabricación de queso y las más fáciles de obtener en el mercado. La dosis aproximada es un gramo de fermento por cada 10 litros de leche.

Incorporamos ahora también los mohos y levaduras que usaremos para tratar la superficie de la corteza del queso. Uno de los casos más comunes es la adición de hongos Penecillium camemberti y Geotrichum candidum, utilizados en los conocidos quesos Brie o Camembert, entre muchos otros. Dependiendo del tipo de queso que queremos obtener, se pueden incluir en este caso otros hongos e incluso bacterias aerobias. Microorganismos muy empleados en este momento son Brevibacterium aurantiacum, Arthrobacter nicotianae y Debaryomyces hansenii. La posterior técnica del lavado de la corteza que a veces se lleva a cabo emplea típicamente estas bacterias y hongos.

Distribuimos la siembra completa en la leche templada con la espumadera y dejamos actuar a los microorganismos añadidos alrededor de una hora, lo cual nos debe permitir detectar un ligero descenso inicial del pH de la leche, primer indicador fácilmente medible de la actividad de los fermentos lácticos.

Una vez detectado el inicio de fermentación de la leche, es el momento de coagularla. Un paso adicional justo antes de ello es rectificar el balance químico de la leche añadiendo cloruro cálcico saturado en agua. Sobre todo, si se emplea leche procesada (homogeneizada o pasteurizada), esta sal de calcio es ingrediente imprescindible para garantizar una coagulación firme, ya que los iones de calcio Ca++ forman sólidos puentes entre moléculas de proteínas de la leche.

Preparada una dosis de 1ml de cloruro cálcico saturado en agua por cada 4l de leche, más un extra de 10-20 ml de agua no clorada, se añade esta mezcla a la leche y se distribuye con la espumadera. Ahora se trata de cuajar la leche mediante la quimosina o el cuajo natural. Estas peptidasas -en misma dosis que el cloruro cálcico- se distribuyen también por todo el volumen de la leche con la espumadora durante un minuto. Después se tapa y se deja todo en reposo absoluto durante 45 minutos.

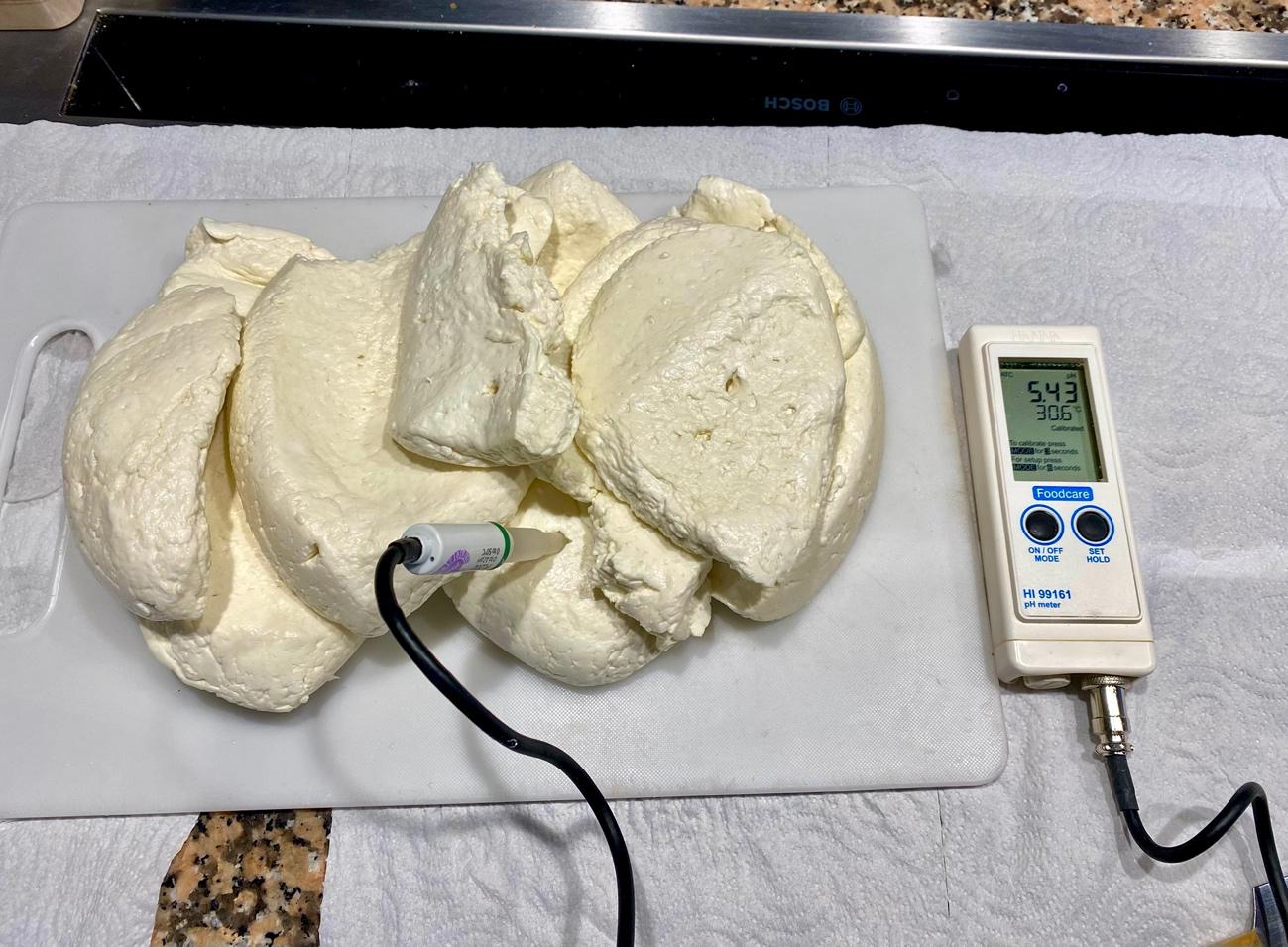

Como en todos los quesos, debemos probar la firmeza de la cuajada con la espátula. Si la coagulación es aún débil, se debe aumentar unos 10 minutos el tiempo. Obtenida la cuajada firme, la cortamos en grandes cubos de 2-3 cm de lado con la misma espátula. Dejamos reposar los cuajos unos 30 minutos y verificamos que el pH continúa descendiendo. Si el pH del suero es 6.4 o inferior, observamos que los Lactococcus están acidificando el queso a buen ritmo.

Removemos muy suavemente los cuajos con la espumadera durante 10 minutos, dejando al baño maría descender la temperatura lentamente por debajo de 30ºC. De esta forma los cuajos se van homogeneizando. Después de otro reposo de pocos minutos, podemos pasar ya los cuajos a los moldes. Si se quiere, puede retirarse directamente la parte superior del suero sobrante, aunque no es necesario.

Cuajos transvasados a moldes cilíndricos y separación del suero sobrante por gravedad. Foto: Victor Etxebarria

Cuajos transvasados a moldes cilíndricos y separación del suero sobrante por gravedad. Foto: Victor Etxebarria

El paso de la delicada cuajada a los moldes se realiza como se ilustra en la Figura 2. Se usan moldes cilíndricos ligeramente agujereados y sin tapa inferior ni superior. Para comenzar el proceso, se cubren las bases con rejillas de plástico aptas para la alimentación. Con cuidado y usando la espumadera llenamos los moldes hasta el borde. Observamos que, de esta forma, el suero va separándose por gravedad y los quesos van compactándose.

Una vez llenos los moldes, a intervalos de una o dos horas los volteamos cubiertos por rejillas y vamos así igualando la forma y la humedad de ambas caras de los quesos, a medida que se va escurriendo el suero sobrante por gravedad. En 24 horas los quesos resultan unos discos sólidos, compactos, ligeramente húmedos y elásticos. En este tiempo el pH habrá descendido hasta menos de 5 y la acidificación habrá terminado, puesto que las Lactococcus dejan de reproducirse en este ámbito ácido.

Los quesos pueden ahora salarse en seco, frotando sal común gruesa no yodada por todas sus superficies. La dosis de sal es 2% de la masa de cada queso que se sala. Se observa que la sal se adhiere fácilmente, se disuelve y se absorbe en pocos minutos. Los quesos están ya fabricados (pero no terminados).

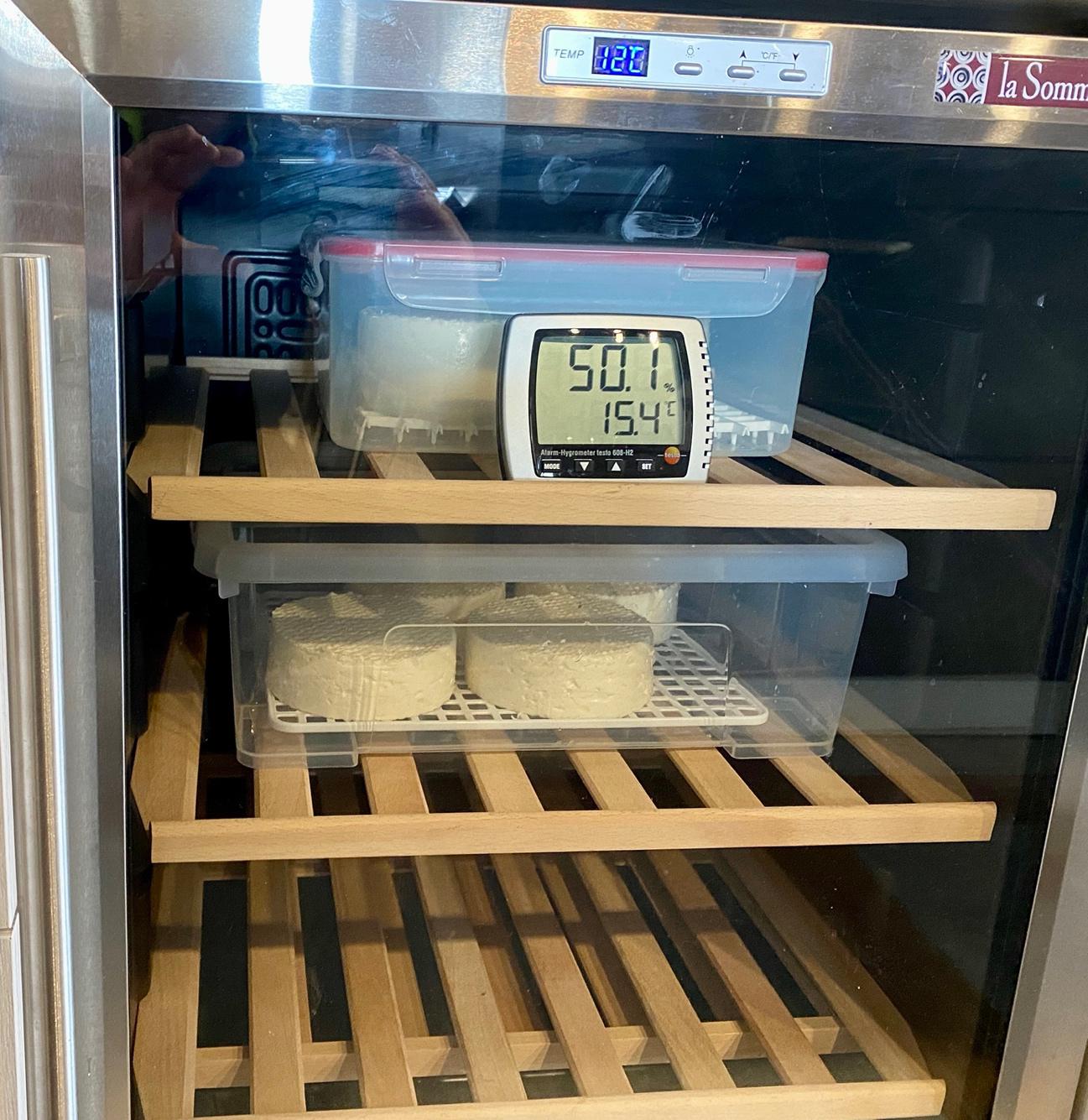

Inicio de la maduración de la corteza y de la masa de los quesos en vinoteca. Temperatura en torno a 15ºC y humedad superior al 90% en las cajas cerradas. Foto: Victor Etxebarria

Inicio de la maduración de la corteza y de la masa de los quesos en vinoteca. Temperatura en torno a 15ºC y humedad superior al 90% en las cajas cerradas. Foto: Victor Etxebarria

El siguiente paso es el afinado (affinage) de estos quesos de masa blanda. En primer lugar, los introducimos en cajas de plástico bien desinfectadas y usamos una rejilla plástica como base, para que cierta cantidad de suero que aún pueda separarse quede en el fondo de la caja. Tal y como se ilustra en la Figura 3, se introducen estas cajas en una cava o en una vinoteca a 15ºC. Esta cava puede emplearse simultáneamente para madurar quesos duros y para afinar la corteza de los quesos de masa blanda. La humedad del interior de las cajas de plástico cerradas es superior al 90%, pero no afecta al exterior.

Cada uno o dos días los quesos deben voltearse para garantizar su desarrollo uniforme. Dependiendo de los hongos y bacterias aerobias añadidas para afinar su corteza, en menos de dos semanas se comenzará a observar su desarrollo por toda la superficie del queso. Estos microorganismos no se desarrollan en el interior, sino solo en la corteza. Normalmente, con las manos desinfectadas abrimos las cajas, observamos la evolución de mohos y levaduras y volteamos los quesos.

Inspección visual, táctil y olfativa del desarrollo de las cortezas, volteo de los quesos y renovación de la atmósfera de las cajas. Foto: Victor Etxebarria

Inspección visual, táctil y olfativa del desarrollo de las cortezas, volteo de los quesos y renovación de la atmósfera de las cajas. Foto: Victor Etxebarria

En la Figura 4 se ilustra un proceso de supervisión del desarrollo de la corteza de quesos blandos. Los mohos se visualizan rápidamente, el tacto resbaladizo o pegajoso de las levaduras y el aroma generado por todos los microorganismos nos indican la evolución del afinado. El volteo uniformiza todas las superficies, y alrededor de tres o cuatro semanas la corteza debería haberse desarrollado por completo.

Una técnica especial para producir quesos de pasta blanda de fuerte sabor y aroma es el lavado de la corteza. Como decíamos, los simples quesos mohosos como el Brie o Camembert no necesitan lavado. Sin embargo, los quesos de fuerte aroma y sabor como Epoisses, Reblochon o Stinking Bishop basan sus características en el lavado de sus cortezas. Para ello se emplea una salmuera débil (5% de sal no yodada disuelta en agua no clorada) a la que se añaden los mismos microorganismos (mohos, levaduras y bacterias aerobias) que decidimos utilizar en el sembrado de la leche. Así, aunque los hongos pueden comenzar a aparecer en la superficie, el lavado refuerza el desarrollo de la corteza, incluyendo olorosos gases característicos producidos por las bacterias aerobias introducidas, al descomponer aminoácidos azufrados presentes en las proteínas de los quesos.

Técnica de lavado de la corteza para quesos de fuerte aroma y sabor. Foto: Victor Etxebarria

Técnica de lavado de la corteza para quesos de fuerte aroma y sabor. Foto: Victor Etxebarria

En la Figura 5 se muestra el proceso del lavado de la corteza. Se empapa un pañuelo limpio en la salmuera débil con los microorganismos elegidos y se lavan las cortezas. Ello -dos veces por semana- mantiene la corteza dando prioridad a las levaduras, mohos y bacterias aerobias deseadas. En la Figura 5, se utiliza un baño salino débil con Brevibacterium aurantiacum, Arthrobacter nicotianae, Debaryomyces hansenii y Geotrichum candidum. Este lavado produce un fuerte aroma (olor a pies, más interesante de lo que parece) cuando va desarrollándose.

El affinage por tanto incluye el tratamiento de las cortezas, proceso de la máxima importancia en el desarrollo de distintas variedades de quesos de masa blanda. Sea con lavado de corteza o sin ello, falta un último paso para un afinado completo de estos quesos. Dependiendo de la textura interior final que se desea para consumir el queso, la maduración puede durar varias semanas más.

El proceso de la afinación de la masa interior se produce mediante una serie de reacciones químicas muy interesantes. Una vez formada la corteza, los hongos metabolizan el ácido láctico generado (o su versión ionizada, el lactato) en dióxido de carbono y agua (en presencia de oxígeno). Esto aumenta el pH de la superficie. Cuando el lactato superficial se consume, el lactato interno comienza a moverse hacia la superficie y va consumiéndose también.

El aumento de pH hace que las proteínas del queso pierdan su punto isoeléctrico y dejan de ser hidrofóbicas (vuelven a ser cada vez más solubles en agua cuanto más se alejan de su punto isoeléctrico). Así, este pH de la superficie va haciendo más cremosa la masa interior del queso. Globalmente el pH de la superficie es cercano a 7, el interior inmediato es algo más ácido (6.5) y cremoso, y el núcleo central del queso puede ser más ácido (5.5) y sólido, si el afinado no ha durado el tiempo suficiente.

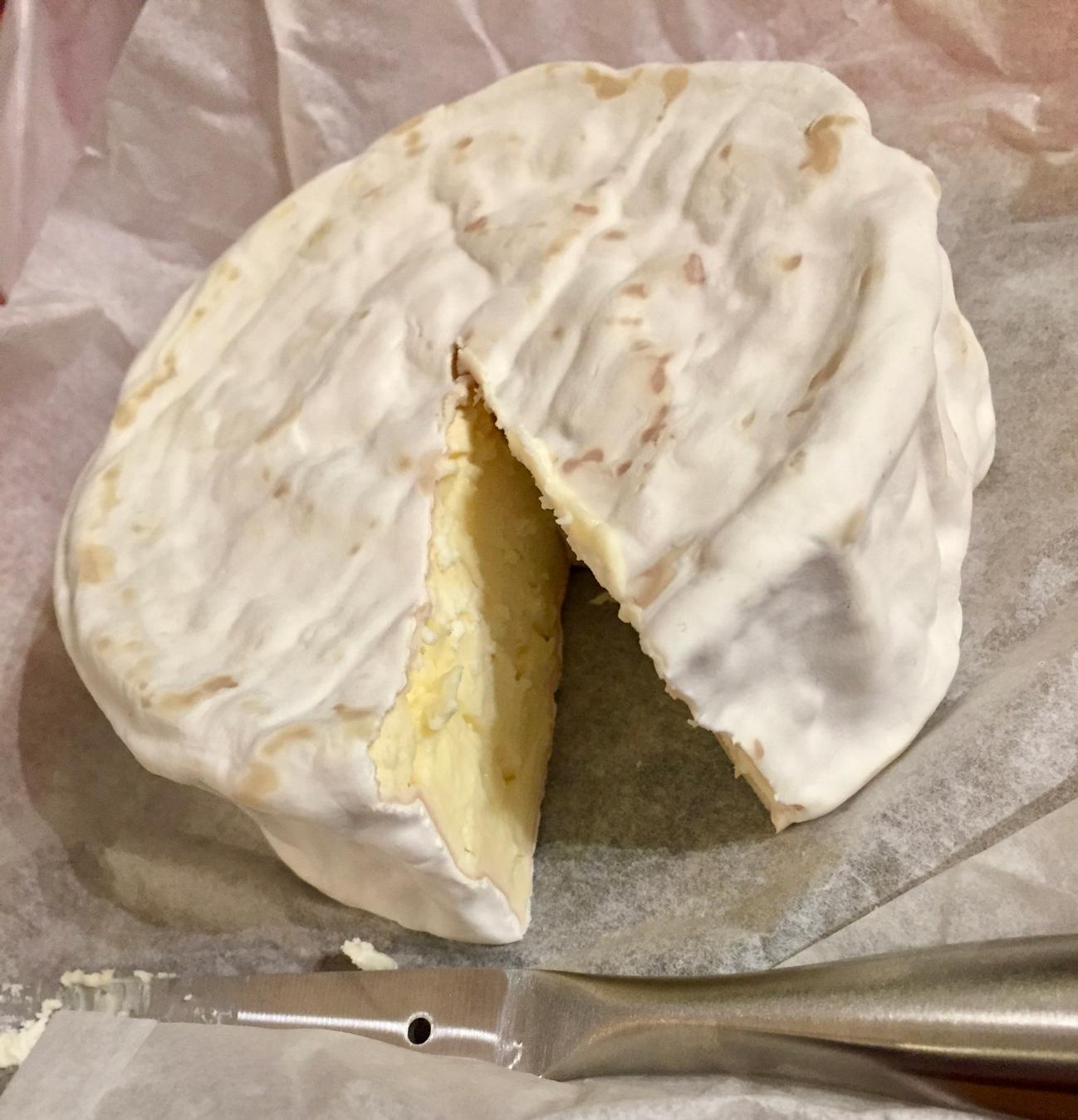

Queso tipo camembert semi-affiné (afinado corto) para sabor y aroma suave. Foto: Victor Etxebarria

Queso tipo camembert semi-affiné (afinado corto) para sabor y aroma suave. Foto: Victor Etxebarria

Dependiendo del nivel de afinado que queremos, este proceso de maduración interior puede durar típicamente entre dos y cinco semanas (siempre contando tras formar la corteza). Cuando es corto el afinado interior, como el mostrado en la Figura 6 de un camembert, el sabor y aroma que se obtiene no es tan fuerte y el interior es blando pero sólido. Esto puede llamarse un camembert semi-affiné que muchas personas prefieren.

Queso blando de cabra affiné à point (en su punto) para sabor y aroma excelentes. Foto: Victor Etxebarria

Queso blando de cabra affiné à point (en su punto) para sabor y aroma excelentes. Foto: Victor Etxebarria

Cuando el afinado es más largo, el sabor y aroma es más fuerte, como el mostrado en la Figura 7, en un queso de cabra con el interior más cremoso, en un afinado à point. La corteza y la masa cremosa amplifican los sabores y olores del queso y durante unos pocos días está en su mejor momento.

Los quesos de pasta blanda y corteza tratada pueden degustarse suaves, más fuertes -en su punto- o hay personas que prefieren mantener aún más tiempo la maduración en el frigorífico. Esto implica que los hongos descompongan los aminoácidos de las proteínas, generen amoniaco y por tanto ambiente aún más alcalino en el interior del queso. Esto puede dar lugar a un sabor extrafuerte, una textura casi líquida y un olor cuyo carácter quesero empieza a alterarse, al dominar el amoniaco. Esta situación es del gusto de amantes de sabores fuertes, pero pasado de este límite, el queso deja de ser comestible.

Sobre el autor: Victor Etxebarria Ecenarro es Catedrático de Ingeniería de Sistemas y Automática en la Universidad del País Vasco (UPV/EHU)

El artículo Cómo hacer un queso de pasta blanda y corteza tratada en casa se ha escrito en Cuaderno de Cultura Científica.

Estamos en Naukas Bilbao. Síguelo en directo

El evento de divulgación científica de referencia vuelve a Bilbao los días 20 y 21 de septiembre. Un año más la ciencia vuelve a subirse al escenario del Euskalduna Bilbao en una nueva edición de NAUKAS Bilbao en el que las breves charlas científicas llenas de humor volverán a ser las protagonistas.

A lo largo de la mañana y la tarde del viernes y el sábado, decenas de conferenciantes hablarán sobre los temas científicos más variados respetando siempre el formato NAUKAS: charlas breves (10 minutos por persona) y amenas. Este es el programa definitivo.

La entrada es libre hasta completar aforo y, además, puedes seguir el evento en streaming en el canal Kosmos de EITB.

El artículo Estamos en Naukas Bilbao. Síguelo en directo se ha escrito en Cuaderno de Cultura Científica.

El proyecto Orión y un señor de Murcia

A caballo entre la invención de la bomba atómica y el comienzo de la carrera espacial, el año 1946 contaba con los dos principales ingredientes que llevaron al matemático de origen polaco Stanislaw Ulam a imaginar uno de los métodos de propulsión de naves más… ¿originales? ―no sé ni cómo describirlo―de la historia: la propulsión nuclear de pulso. Y es que… ¿Qué podría salir mal si intentamos viajar por el espacio utilizando explosiones atómicas para desplazar nuestro vehículo? Es posible que todo, y, sin embargo, ese no fue el motivo por el que la idea que, de hecho, demostró no ser mala del todo, se descartó. Aún más: aunque en su momento se presentó como algo completamente innovador, ni siquiera lo era tanto. Esta es la historia del Proyecto Orión y del señor de Alhama de Murcia que ya pensó algo similar unos cincuenta años antes.

La idea de utilizar explosiones nucleares como modo de propulsión de naves estelares se le ocurrió al matemático polaco Stanislaw Ulam en 1946. Un año después de los ataques de Hiroshima y Nagasaki.

La idea de utilizar explosiones nucleares como modo de propulsión de naves estelares se le ocurrió al matemático polaco Stanislaw Ulam en 1946. Un año después de los ataques de Hiroshima y Nagasaki.Créditos: Los Alamos National Laboratory

Los cálculos preliminares de la idea de la propulsión nuclear a pulso a la que Ulam le había estado dando vueltas a lo largo de 1946 quedaron plasmados en un breve memorándum que escribió junto con Fred Reines al año siguiente, pero no quedó ahí la cosa. Años después, en 1955 ―antes del lanzamiento del Sputnik―, amplió esos cálculos y publicó con Cornelius Everett un documento mucho más detallado, On a method of propulsion of projectiles by means of external nuclear explosion, en el que se evidenciaba que aquella locura, podría no serlo tanto, y daban una descripción más pormenorizada de la idea:

El esquema propuesto en el presente informe implica el uso de una serie de reactores desechables (bombas de fisión) que se van expulsando y detonando a una distancia considerable del vehículo y que liberan la energía necesaria en un «motor» externo que consiste esencialmente en espacio vacío. La cuestión crítica sobre este método gira en torno a su capacidad para aprovechar las reservas reales de energía nuclear liberada a las temperaturas de la bomba sin destruir o derretir el vehículo.

Que la nave pudiera acabar destruida o las posibles consecuencias que la radiación resultante de las explosiones pudiera tener sobre los ocupantes del vehículo se planteaba más como una cuestión de ingeniería que de física. La ciencia, en principio, no ponía ninguna objeción a priori. En aquellos años en los que el espacio dejó de pertenecer al mundo de la fantasía y las historias de ciencia ficción para convertirse en una posibilidad,Stanislaw Ulam promovió incansablemente su idea, hasta que, tal vez apremiados por el éxito del Sputnik y la ventaja que el primer satélite artificial le dio a la URSS en la carrera espacial, ARPA ―la Agencia de Proyectos de Investigación Avanzados, hoy DARPA― decidió financiarlo con 999 750 $.

En junio de 1958, el Proyecto Orión empezó a pasar del papel a la práctica de la mano de los físicos Ted Taylor, de General Atomic, y Freeman Dyson, que se tomó un año sabático a instancias del primero en el Instituto de Estudios Avanzados de Princeton. Un año después, en 1959, se llevaban a cabo las primeras pruebas del diseño en la base militar de Point Loma (San Diego, California); eso sí, con explosivos convencionales. Y llegó a funcionar relativamente bien.

Tal fue así que uno de los prototipos se encuentra en el Museo Nacional del Aire y el Espacio, en Washington.

Prototipo de la nave del Proyecto Orión que se conserva en el Museo Nacional del Aire y el Espacio.

Prototipo de la nave del Proyecto Orión que se conserva en el Museo Nacional del Aire y el Espacio.Créditos: Gulf General Atomics Division, General Dynamics Corporation. Fuente.

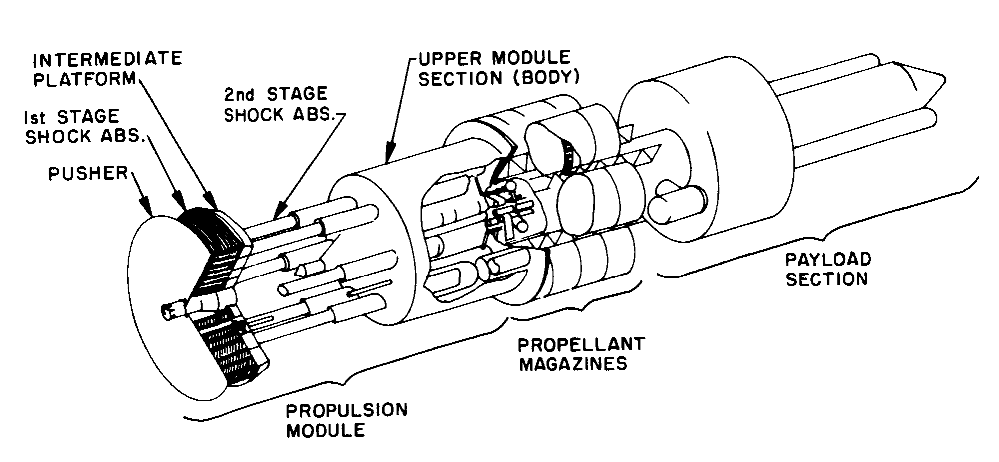

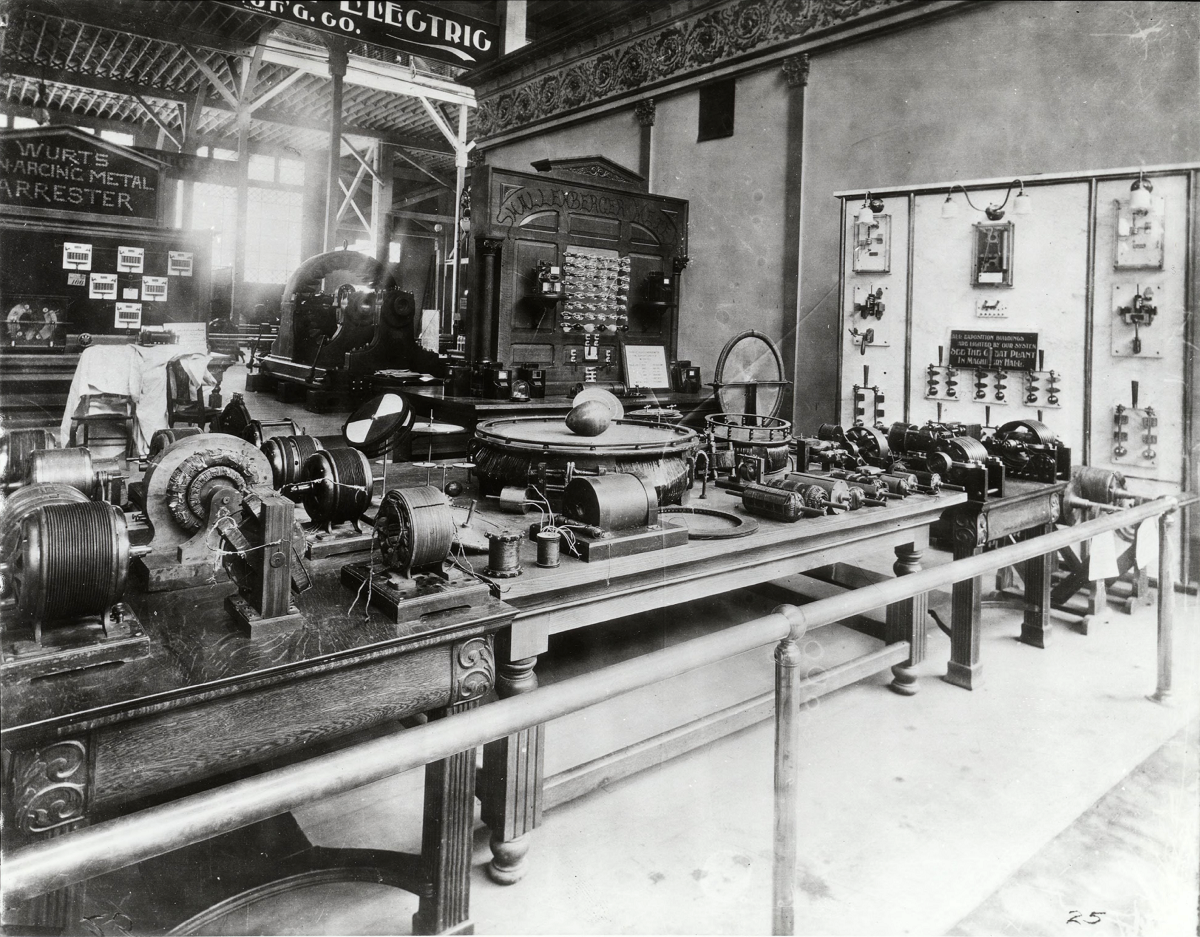

El sistema, a muy grandes rasgos, funcionaba así: las explosiones nucleares liberarían una gran cantidad de energía en forma de radiación y partículas que moverían un amortiguador de inercia que, a su vez, transmitiría el impulso a la nave ―recomiendo muchísimo este artículo de Daniel Marín donde explica de manera mucho más exhaustiva todos los detalles―.

Diseño de la NASA de un posible vehículo con propulsión nuclear de pulso. Créditos: Dominio Público/NASA

Diseño de la NASA de un posible vehículo con propulsión nuclear de pulso. Créditos: Dominio Público/NASA

¿Por qué terminó entonces el proyecto? Por varios motivos, pero, principalmente, debido al Tratado de Prohibición Parcial de Ensayos Nucleares en la Atmósfera, en el Espacio Exterior y Bajo el Agua que 113 países firmaron en 1963. ¿Cómo hubiera sido una nave que hubiera utilizado este sistema si se hubiera construido? Algunos la han imaginado. Aquí podemos ver la simulación de funcionamiento de una nave así:

No solo eso, las relaciones entre el Proyecto Orión y la literatura de ciencia ficción pueden encontrarse casi por todas partes. Muchos de los ideólogos y participantes, entre ellos el propio Stanislaw Ulam o Freeman Dyson, mencionaron en su momento las obras de Julio Verne o las aventuras de Buck Rogers como fuente de inspiración. Y, por supuesto, este método de propulsión apareció en las historias de Robert A. Heinlein, Arthur C. Clarke, Larry Niven y Jerry Pournelle, y, más recientemente, de Charles Stross o en la famosa trilogía de los Tres Cuerpos de Liu Cixin.

Bueno, todo esto está muy bien y ya se ha escrito mucho sobre ellos, pero… ¿Qué tiene que ver el Proyecto Orión con un señor de Murcia? Que, si bien cuando vivió dicho señor todavía quedaba mucho para el desarrollo de la energía atómica ―J. J. Thomson acababa de descubrir el electrón apenas en aquel momento―, tuvo la idea de utilizar explosivos para alimentar un motor ya a finales del siglo XIX.

A juzgar por esta caricatura que Joaquín Xaudaró le dedica en la revista Blanco y Negro en junio de 1898, Manuel Daza no fue un desconocido en su época. Créditos: Dominio Público/Joaquín Xaudaró

A juzgar por esta caricatura que Joaquín Xaudaró le dedica en la revista Blanco y Negro en junio de 1898, Manuel Daza no fue un desconocido en su época. Créditos: Dominio Público/Joaquín Xaudaró

Manuel Daza y Gómez fue un ingeniero e inventor español nacido en Alhama de Murcia en 1853 al que se le ocurrieron cosas tan locas como «el Toxpiro […], el fuego venenoso, la venganza española, una supuesta máquina infernal capaz de disparar proyectiles explosivos a gran distancia», según explica Alejandro Polanco en su blog. Entre esas locuras, existe una patente suya fechada en 1898 de un motor que utiliza principios muy similares, aunque utilizando pólvora como detonante de las bombas, a los del Proyecto Orión:

Componen este motor dos organismos esenciales, un generador, en el que se desarrolla la energía, y un receptor, donde con ella se obtiene un movimiento circular con las condiciones convenientes para su aplicación a obtener un trabajo cualquiera.

El generador figuras 1.ª y 2.ª es un cilindro de hierro o acero cerrado por una de sus bases y lleno de pólvora que detrás de él se comprime en la medida necesaria el tiempo que debe durar la combustión.

Y acompaña la descripción con los planos del dispositivo.

Existen más de una veintena de patentes a nombre de este ingeniero ya, en gran medida, olvidado, que nada tienen que envidiar a las de sus pares estadounidenses de la época. Entre ellas, se pueden encontrar, entre otros ingenios, generadores, pilas, limitadores de corriente, «un bastón encendedor eléctrico» ―no estoy segura de si esto es exactamente lo que parece, una especie de bastón-mechero―, motores de viento, bicicletas de madera, trituradores y hasta procesos de aprovechamiento de materiales que hoy podrían ayudar al tan necesario reciclaje. Y no fue el único que tuvo visiones innovadoras y disruptivas en aquella época en nuestro país.

Aunque estoy convencida de que muchos habían oído ya hablar del Proyecto Orión, seguramente muy pocos habían oído hablar de Manuel Daza. Sin embargo, lo cierto es que en España hubo, como él, muchos más ingenieros e inventores que, sin llamarse Thomas (Edison), Alexander (Graham Bell) o Charles (Babbage), y con nombres como Leonardo (Torres Quevedo), Elia (Garci-Lara Catalá) o Emilio (Herrera Linares), no tenían nada que envidiarles.

Agradecimiento:

Quiero dar las gracias a Alejandro Polanco Masa por su gran labor de investigación en todo lo referente a infinitud de inventos españoles olvidados, y por poner a mi disposición los documentos de la patente de Manuel Daza para poder escribir este artículo.

Bibliografía

Daza y Gómez, M. (1898). Motor Daza. N.º de patente ES22411. Ministerio de Fomento.

Dyson, G. (2003). Project Orion: the true story of the atomic spaceship. Holt paperbacks.

Everett, C. J. Y Ulam S. M (1955). On a method of propulsion of projectiles by means of external nuclear explosions. Part I. Los Alamos Scientific Laboratory of the University of California.

Marín, D. (14 de octubre de 2010). Orión: la nave imposible. Eureka.

Palao Poveda, G. y Sáiz González, J. P. (2004). Las patentes de invención de Manuel Daza. Revista de Estudios Yeclanos. Yakka, 14, 177-180.

Polanco Masa, A. (2024). 365 inventos made in Spain. Glyphos.

Polanco Masa, A. (7 de agosto de 2008). Manuel Daza y su arma secreta. Tecnología Obsoleta.

Sobre la autora: Gisela Baños es divulgadora de ciencia, tecnología y ciencia ficción.

El artículo El proyecto Orión y un señor de Murcia se ha escrito en Cuaderno de Cultura Científica.

La circunferencia de los nueve puntos

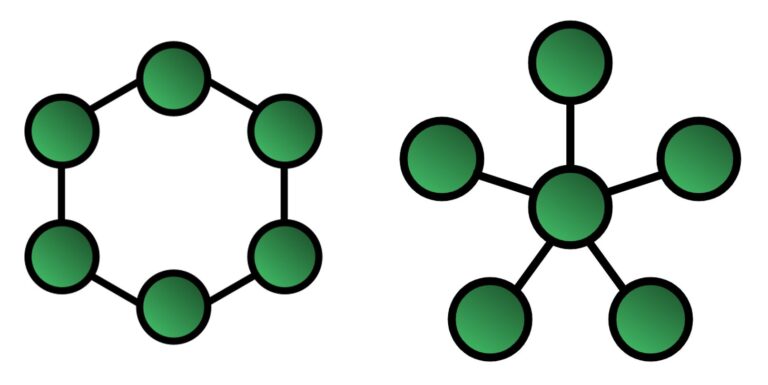

La entrada del Cuaderno de Cultura Científica titulada La recta de Euler estaba dedicada al resultado geométrico conocido como el teorema de la línea de Euler, que dice que tres de los puntos notables asociados a un triángulo cualquiera, el ortocentro, el circuncentro y el baricentro, se encuentran en una misma línea, que se conoce con el nombre de línea de Euler. Además, al final de la entrada se comentaba que, junto al ortocentro, el circuncentro y el baricentro de un triángulo, existen otros puntos definidos con relación al triángulo que también están en la recta de Euler, uno de ellos era el centro de la circunferencia de los nueve puntos. La entrada de hoy la vamos a dedicar precisamente a esta figura geométrica, la circunferencia de los nueve puntos.

Squared Rectangle and Euler Line / Rectángulo cuadrado y línea de Euler (1972), del dibujante e ilustrador infantil estadounidense Crockett Johnson (1906-1975). Imagen de la página web de The National Museum of American HistoryLa línea de Euler

Squared Rectangle and Euler Line / Rectángulo cuadrado y línea de Euler (1972), del dibujante e ilustrador infantil estadounidense Crockett Johnson (1906-1975). Imagen de la página web de The National Museum of American HistoryLa línea de Euler

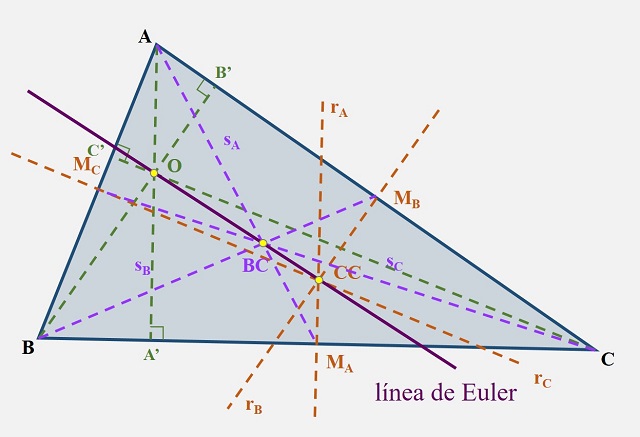

Antes de nada, vamos a recordar brevemente el teorema de la línea de Euler que, aunque no se necesita para explicar qué es la circunferencia de los nueve puntos, sí está relacionado con ella, como se ha comentado.

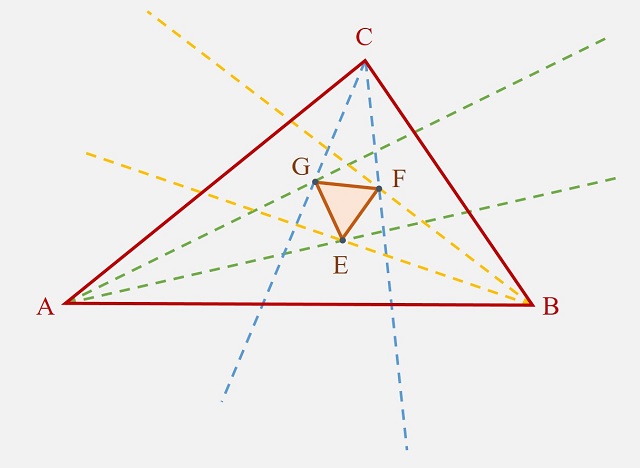

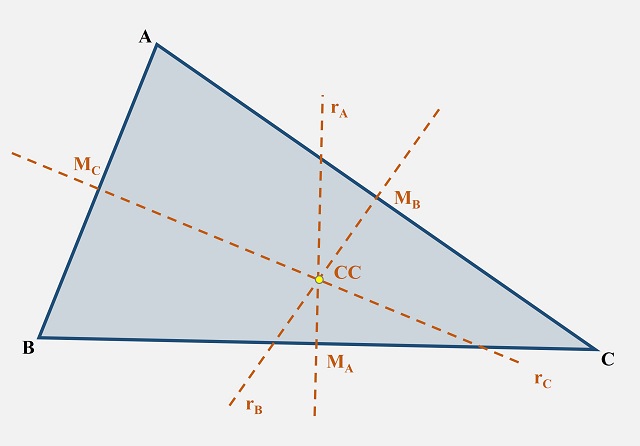

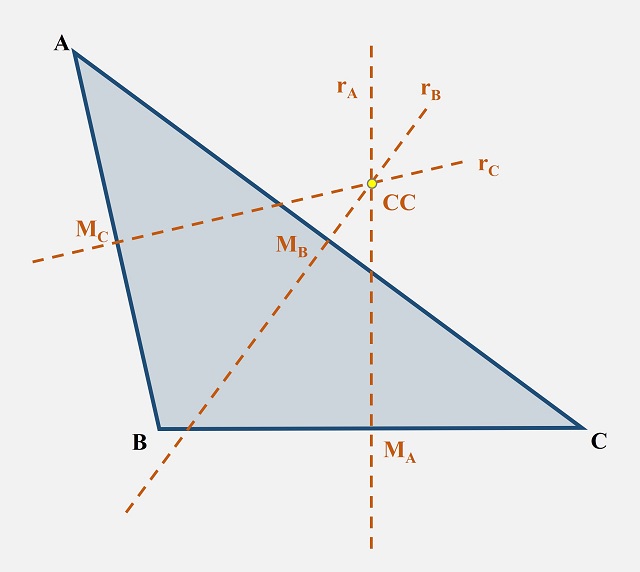

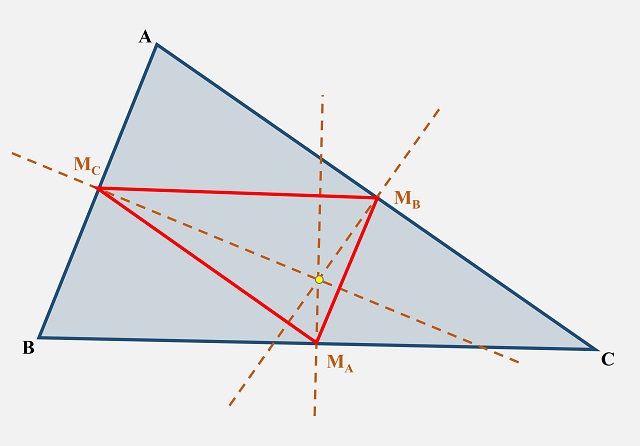

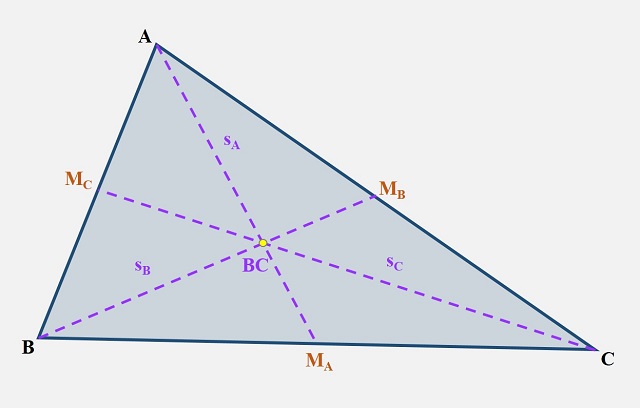

Dado un triángulo cualquiera, los tres puntos notables asociados al triángulo que se mencionan en el teorema de la línea de Euler son el ortocentro, el circuncentro y el baricentro. El ortocentro es el punto de intersección de las tres alturas del triángulo (o las rectas que las extienden), el circuncentro es el punto de intersección de las tres mediatrices (la mediatriz de un segmento es la recta perpendicular al mismo que pasa por su punto medio) de los lados del triángulo y el baricentro es el punto de intersección de las tres medianas (una mediana de un triángulo es el segmento de recta que pasa por un vértice y el punto medio del lado opuesto) del triángulo. Esos tres puntos del plano podrían no estar alineados, como ocurre en general para tres puntos cualesquiera, sin embargo, estos tres puntos sí van a estar sobre una misma línea recta, como afirma este teorema.

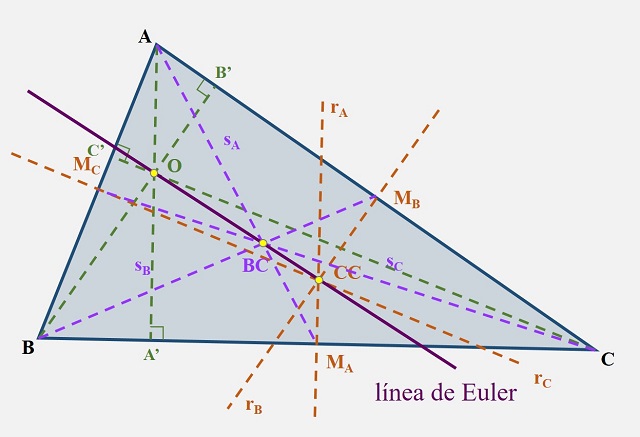

Teorema de la línea de Euler: Dado un triángulo cualquiera ABC, el ortocentro O, el circuncentro CC y el baricentro BC son colineales (a la recta que incluye a los tres puntos se la denomina línea de Euler). Además, la distancia del ortocentro O al baricentro BC es igual a dos veces la distancia del baricentro BC al circuncentro CC.

El ortocentro O, el circuncentro CC y el baricentro BC de un triángulo ABC están alineados y la recta que los contiene es la línea de Euler

El ortocentro O, el circuncentro CC y el baricentro BC de un triángulo ABC están alineados y la recta que los contiene es la línea de Euler

El matemático suizo Leonhard Euler (1707-1783), el matemático más prolífico de todos los tiempos, incluía este resultado en su artículo titulado Solutio facilis problematum quorundam geometricorum difficillimorum / Soluciones fáciles para algunos problemas geométricos difíciles y, que fue publicado en la revista Novi Commentarii academiae scientiarum Petropolitanae en 1767, aunque se presentó a la Academia de Ciencias de San Petersburgo en diciembre de 1763.

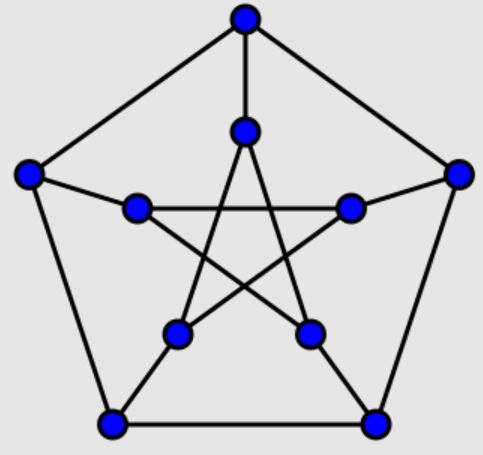

La circunferencia de los nueve puntosDado un triángulo cualquiera, vamos a considerar tres grupos de tres puntos, luego nueve puntos en total, definidos geométricamente en relación con el triángulo.

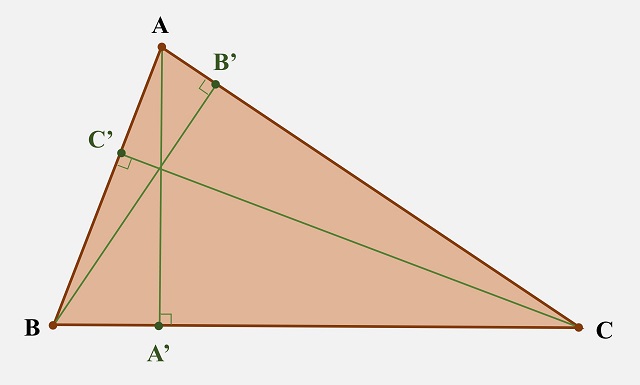

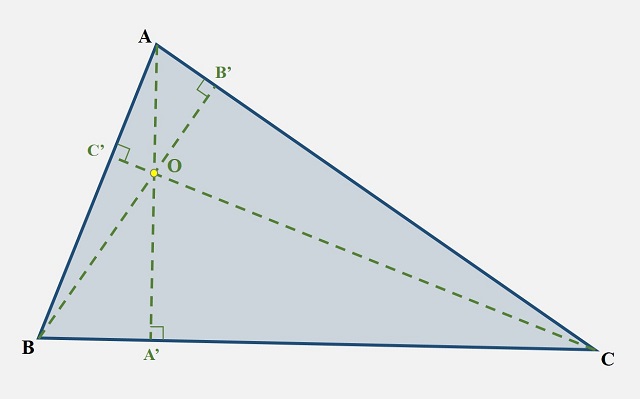

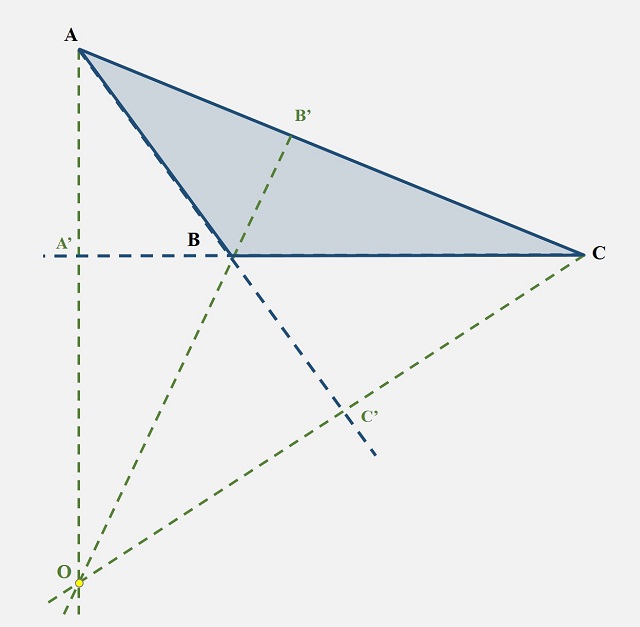

El primer grupo de tres puntos consiste en los pies de las tres alturas del triángulo. Por ejemplo, en la siguiente imagen tenemos un triángulo ABC cualquiera. Desde el vértice A se traza la recta que pasa por A y corta perpendicularmente al lado opuesto del triángulo (o a la recta que lo contiene), el lado BC, que es la altura del triángulo ABC desde el vértice A y se denota A’ al punto de corte, que es el pie de esa altura. Desde el punto B se traza la correspondiente altura, es decir, la recta que corta perpendicularmente al lado opuesto AC y se considera el punto de corte, B’, el pie de esta altura. Y desde C se traza también la altura y se denota por C’ el pie de la misma.

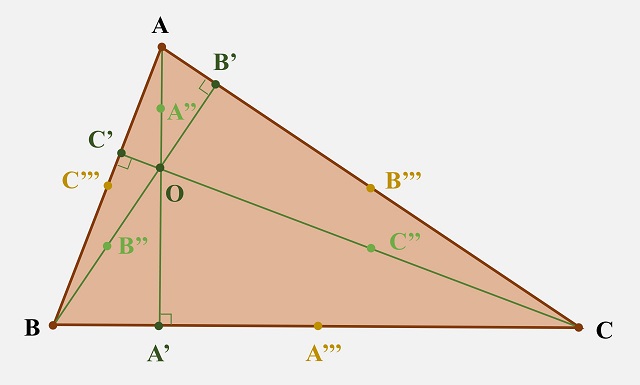

Un triángulo ABC cualquiera, sus alturas y los pies de las mismas A’, B’ y C’

Un triángulo ABC cualquiera, sus alturas y los pies de las mismas A’, B’ y C’

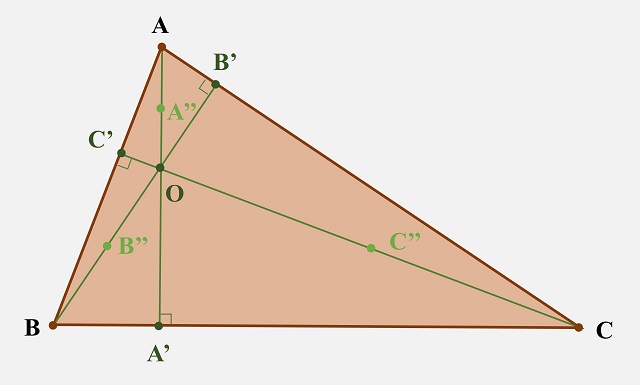

Ya tenemos el primer grupo de tres puntos, los pies de las tres alturas. Para considerar el siguiente grupo de tres puntos, vamos a tomar la intersección de las tres alturas (o de las rectas que las contienen), el ortocentro. Entonces, los puntos que nos interesan son los puntos medios de los segmentos que unen cada vértice con el ortocentro, que se denominan puntos de Euler. Si consideramos el triángulo ABC anterior, O es el ortocentro, los puntos de Euler son A’’, B’’ y C’’, que son los puntos medios de los segmentos OA’, OB’ y OC’.

Un triángulo ABC cualquiera, los pies de las alturas A’, B’ y C’, el ortocentro O y los puntos de Euler A’’, B’’ y C’’, que son los puntos medios de los segmentos OA’, OB’ y OC’

Un triángulo ABC cualquiera, los pies de las alturas A’, B’ y C’, el ortocentro O y los puntos de Euler A’’, B’’ y C’’, que son los puntos medios de los segmentos OA’, OB’ y OC’

El siguiente grupo de tres puntos son los puntos medios de los lados del triángulo. Si volvemos al triángulo ABC, el punto medio del segmento AB es C’’’, el punto medio del segmento BC es A’’’ y el punto medio del segmento CA es B’’’.

Nueve puntos destacados de un triángulo ABC: los pies de las alturas A’, B’ y C’, los puntos de Euler A’’, B’’ y C’’, y los puntos medios de los lados del triángulo A’’’, B’’’ y C’’’

Nueve puntos destacados de un triángulo ABC: los pies de las alturas A’, B’ y C’, los puntos de Euler A’’, B’’ y C’’, y los puntos medios de los lados del triángulo A’’’, B’’’ y C’’’

Ya están establecidos los tres grupos de tres puntos asociados a un triángulo y que aparecen en el teorema de la circunferencia de los nueve puntos, que enunciamos a continuación.

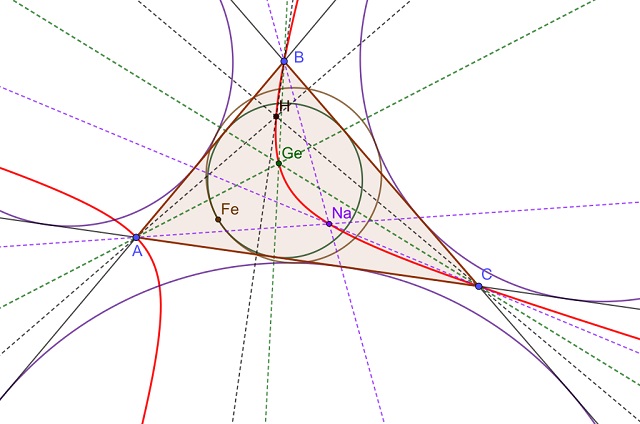

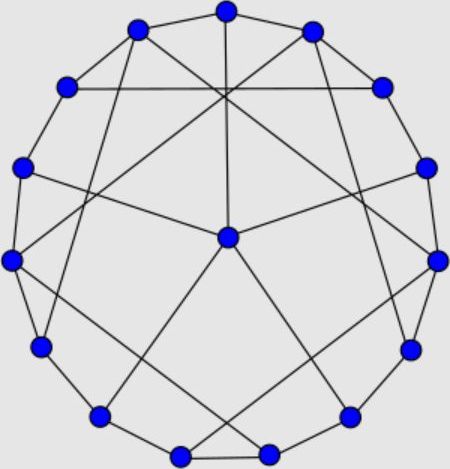

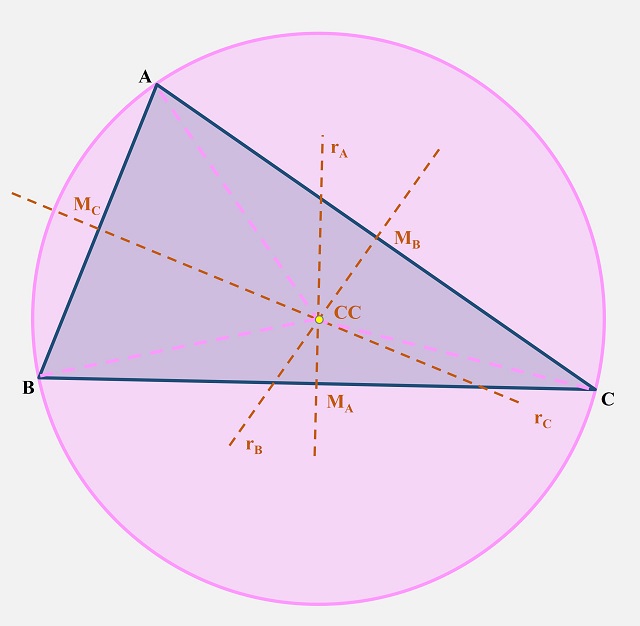

Teorema de la circunferencia de los nueve puntos: Dado un triángulo cualquiera ABC, los pies de las alturas del triángulo, los puntos de Euler y los puntos medios de los lados del triángulo están en una misma circunferencia, conocida como circunferencia de los nueve puntos.

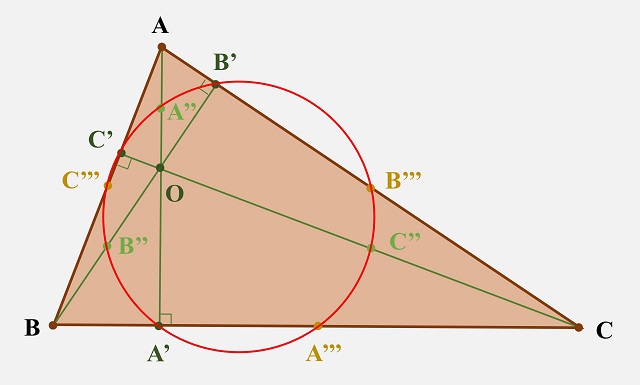

Los nueve puntos destacados del triángulo ABC, los pies de las alturas A’, B’ y C’, los puntos de Euler A’’, B’’ y C’’, y los puntos medios de los lados del triángulo A’’’, B’’’ y C’’’, están en una misma circunferencia (roja en la imagen)

Los nueve puntos destacados del triángulo ABC, los pies de las alturas A’, B’ y C’, los puntos de Euler A’’, B’’ y C’’, y los puntos medios de los lados del triángulo A’’’, B’’’ y C’’’, están en una misma circunferencia (roja en la imagen)La circunferencia de Feuerbach

Uno de los muchos nombres que recibe la circunferencia de los nueve puntos es circunferencia de Euler, puesto que según algunos autores ya era conocida por el matemático suizo, entre otros Heinrich Dorrie, autor del interesante libro 100 Great Problems of Elementary Mathematics: Their History and Solutions. Sin embargo, como explica el matemático John Sturgeon Mackay (1843-1904) en su artículo History of the nine-point circle / Historia de la circunferencia de los nueve puntos, no hay ninguna referencia a esta circunferencia en las obras de Euler:

El primer autor al que se ha atribuido el descubrimiento del círculo de nueve puntos es Euler, pero nadie ha dado nunca una referencia a ningún pasaje de los trabajos de Euler en el que se afirme, o se implique, la propiedad característica de esta circunferencia. La atribución a Euler es simplemente un error, y el origen del error puede, creo, explicarse.

Según Mackay, el error viene de un texto del matemático Eugène Charles Catalan (1814-1894), el libro Théorèmes et Problèmes Géométrie élémentaire, que en sus quinta y sexta ediciones atribuye el resultado a Euler, al malinterpretar dos artículos del matemático francés Olry Terquem (1782-1862) que tienen prácticamente el mismo título, lo que provoca la confusión. El primero titulado Considerations sur le triangle rectiligne, d’apres Euler / Consideraciones sobre el triángulo rectilíneo, según Euler (1842) y el segundo con el mismo título, salvo la expresión “según Euler”, y publicados además en el mismo número de la misma revista. Mientras que en el primero se recogían resultados de Euler, el segundo se dedicaba a resultados desarrollados por el propio Terquem y empezaba con el teorema de la circunferencia de los nueve puntos.

La primera vez que se menciona explícitamente la circunferencia de los nueve puntos es en un artículo publicado por el matemático, químico y militar francés Charles Julien Brianchon (1783-1864) y el matemático e ingeniero francés Jean-Victor Poncelet (1788-1867), en la revista Annales de Mathematiques, en 1821.

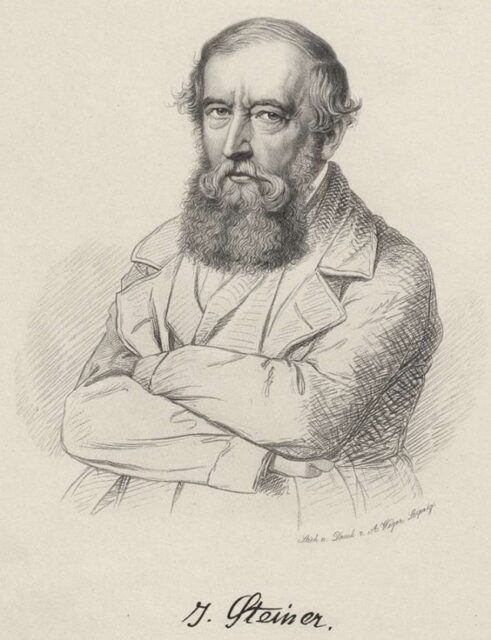

Dibujo del matemático alemán Karl Wilhelm Feuerbach

Dibujo del matemático alemán Karl Wilhelm Feuerbach

Un año después, el matemático alemán Karl Wilhelm Feuerbach (1800-1834) demostró la existencia de esta circunferencia, pero mencionando que pasa por seis puntos, los puntos medios de los lados del triángulo y los pies de las alturas (por este motivo en ocasiones se llama circunferencia de los seis puntos), en su pequeño libro Eigenschaften einiger merkwürdigen Punkte des geradlinigen Dreiecks und mehrerer durch sie bestimmten Linien und Figuren / Propiedades de algunos puntos peculiares del triángulo rectilíneo y de varias rectas y figuras determinadas por ellos (1822). Así mismo, demostró un resultado relacionado con esta circunferencia, que se conoce como teorema de Feuerbach y que presentamos más adelante. De manera que a la circunferencia de los nueve puntos se la suele conocer como circunferencia de Feuerbach, que es un nombre que se utiliza frecuentemente, y a su centro como centro de Feuerbach.

Además, el centro de Feuerbach, o centro de la circunferencia de los nueve puntos, se encuentra sobre la recta de Euler, que se presentó en la anterior entrada La recta de Euler.

El teorema de FeuerbachPor lo tanto, dado un triángulo cualquiera la circunferencia que pasa por los pies de las alturas, por los puntos de Euler y por los puntos medios de los lados recibe muchos nombres, desde circunferencia de Euler, que resulta ser confuso e incorrecto, hasta el más habitual, circunferencia de los nueve puntos, pasando por circunferencia de los seis puntos y circunferencia de Feuerbach, entre otros que ya comentaremos.

La existencia de la circunferencia de los seis puntos no fue lo único que demostró el matemático alemán, también probó, entre otros resultados relacionados con esta circunferencia, el conocido teorema de Feuerbach, que enunciamos a continuación.

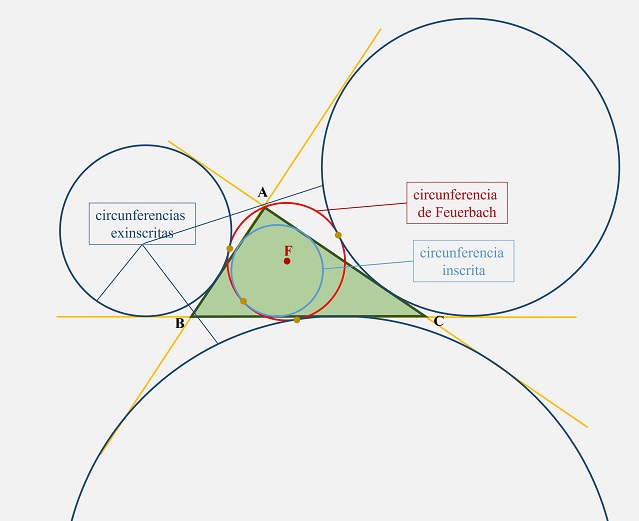

Teorema de Feuerbach: Dado un triángulo cualquiera ABC, la circunferencia de los seis puntos es tangente a las circunferencias inscrita y exinscritas del triángulo.

Dado un triángulo cualquiera ABC, la circunferencia de los seis puntos (en rojo en la imagen) es tangente a las circunferencias inscrita (azul claro) y exinscritas (azul oscuro) al triángulo

Dado un triángulo cualquiera ABC, la circunferencia de los seis puntos (en rojo en la imagen) es tangente a las circunferencias inscrita (azul claro) y exinscritas (azul oscuro) al triángulo

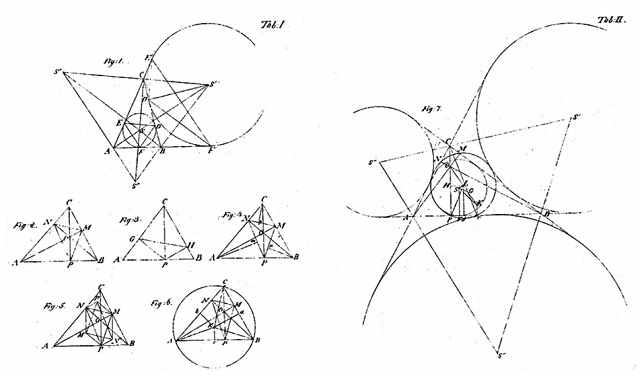

Como escribe el matemático estadounidense Howard H. Eves (1911-2004) en su clásico Mathematical circles / Círculos matemáticos (2003), “Los geómetras consideran universalmente que el llamado teorema de Feuerbach es sin duda uno de los teoremas más bellos de la geometría moderna del triángulo”. De hecho, después de Feuerbach muchos otros matemáticos demostraron este resultado o generalizaciones del mismo. Por ejemplo, el matemático británico Thomas S. Davies (1795-1851) en su artículo Symmetrical properties of plane triangles (1827), que ya añadía los puntos de Euler a los seis considerados por Feuerbach, el matemático suizo Jakob Steiner (1796-1863), que publicó algunos resultados generalizando el teorema de la circunferencia de los nueve puntos en el artículo Developpement dune serie de theoremes relatifs aux sections coniques (1828) y en el libro Die geometrischen Constructionen, ausgefuhrt mittelst der geraden Linie und eines festen Kreises (1833), en el cual demostraba que la circunferencia de los nueve puntos pasaba por tres puntos notables más, doce en total (motivo por el cual esta circunferencia se conoce también con el nombre de circunferencia de los doce puntos) o el matemático francés Olry Terquem, que es quien le pone nombre a la circunferencia, llamándola “circunferencia de los nueve puntos”, en su artículo de 1842, en el que da una nueva demostración analítica del teorema de Feuerbach.

Grabado de Jakob Steiner realizado por el grabador August Weger en 1881

Grabado de Jakob Steiner realizado por el grabador August Weger en 1881¿Qué fue de Feuerbach?

Vamos a terminar esta entrada del Cuaderno de Cultura Científica con la triste historia de Karl Feuerbach, el matemático que demostró de uno de los teoremas más hermosos de la geometría moderna, por el cual ha pasado a formar parte de la historia de las matemáticas, pero que no ha destacado por ninguna otra gran contribución. Por este motivo, el matemático Howard Eves, en Mathematical circles, se pregunta cuál es el motivo por el cual no ha producido más resultados matemáticos relevantes, qué fue de su vida y por qué murió tan joven, a la edad de 33 años (casi 34).

Ilustraciones al final del pequeño libro Propiedades de algunos puntos peculiares del triángulo rectilíneo y de varias rectas y figuras determinadas por ellos (1822), de Karl W. Feuerbach, en las que podemos apreciar una ilustración del conocido teorema de Feuerbach

Ilustraciones al final del pequeño libro Propiedades de algunos puntos peculiares del triángulo rectilíneo y de varias rectas y figuras determinadas por ellos (1822), de Karl W. Feuerbach, en las que podemos apreciar una ilustración del conocido teorema de FeuerbachKarl W. Feuerbach nació en la ciudad alemana de Jena el 30 de mayo de 1800. Su padre fue un famoso jurista y Karl fue el tercero de un total de once hermanos, entre ellos el filósofo Ludwig Feuerbach. Estudio en las universidades de Erlangen y Freiburg, doctorándose en esta última a la edad de 22 años. Entonces se convirtió en profesor en el Gymnasium (instituto de educación secundaria) de Erlangen. Fue entonces, en 1822, cuando publicó el pequeño libro que contenía el hermoso teorema al que hemos dedicado esta entrada.

En mayo de 1824, mientras se dirigía al Gymnasium, fue detenido. Karl, junto a otros diecinueve jóvenes, fue encarcelado en Munich, donde permanecieron incomunicados durante varios meses. Fueron detenidos por el carácter político de algunas de las actividades organizadas por una asociación a la que pertenecieron cuando eran estudiantes.

Parece ser que durante el encarcelamiento se obsesionó con la idea de que solo con su muerte podía conseguir que liberasen a sus compañeros, por lo que intentó suicidarse en dos ocasiones. La primera se cortó las venas de los pies, pero antes de morir desangrado fue descubierto y trasladado en estado inconsciente a un hospital. Mientras que en la segunda ocasión saltó por una ventana después de escaparse por un pasillo, pero la nieve que había en el exterior amortiguo la caída y no consiguió quitarse la vida, aunque quedó lisiado. Tras este incidente, Karl fue puesto en libertad condicional, bajo la custodia de un antiguo profesor amigo de la familia.

Uno de sus compañeros sí murió durante su encarcelamiento, pero nadie fue liberado. Permanecieron bajo arresto hasta que se celebró el juicio catorce meses después, cuando fueron declarados inocentes y puestos en libertad.

La hipérbola de Feuerbach, que es una hipérbola que pasa por el ortocentro y cuyo centro es el punto de tangencia entre la circunferencia de los nueve puntos y la circunferencia inscrita del triángulo

La hipérbola de Feuerbach, que es una hipérbola que pasa por el ortocentro y cuyo centro es el punto de tangencia entre la circunferencia de los nueve puntos y la circunferencia inscrita del triángulo

Tras salir de prisión volvería a trabajar de profesor, esta vez en el Gymnasium de Hof, pero al poco tiempo sufrió una crisis nerviosa y tuvo que dejar el centro. En 1828, recuperado ya de la crisis nerviosa volvió a la docencia en el Gymnasium de Erlangen, en el que ya había trabajado. Sin embargo, un día se presentó en clase con una espada y amenazó con decapitar a aquellos estudiantes que no resolvieran unas ecuaciones que había escrito en la pizarra. Después de este episodio fue obligado a jubilarse de forma permanente.

Como comenta Eves, poco a poco se fue alejando de la realidad, se dejó crecer el pelo, la barba y las uñas, y se redujo a un estado de mirada perdida y murmullos ininteligibles. Vivió seis años retirado en Erlangen, tras los cuales murió el 12 de marzo de 1834, a la edad de 33 años.

Nine Point Circle and Euler Line for an Acute Triangle / Circunferencia de los nueve puntos y línea de Euler para un triángulo agudo (2017), del profesor de matemáticas de secundaria jubilado Stephen Kenney. Lápiz de color sobre papel. Presentado en la exposición de arte del 2019 Joint Mathematics Meetings

Nine Point Circle and Euler Line for an Acute Triangle / Circunferencia de los nueve puntos y línea de Euler para un triángulo agudo (2017), del profesor de matemáticas de secundaria jubilado Stephen Kenney. Lápiz de color sobre papel. Presentado en la exposición de arte del 2019 Joint Mathematics MeetingsBibliografía

1.- David Wells, The Penguin Dictionary of Curious and Interesting Geometry, Penguin, 1991.

2.- Heinrich Dorrie, 100 Great Problems of Elementary Mathematics: Their History and Solutions, Dover, 1965.

3.- Howard Eves, A Survey of Geometry, Allyn and bacon, 1972.

4.- John Sturgeon Mackay, History of the nine-point circle,Proceedings of the Edinburgh Mathematical Society 11, pp. 19-61, 1892.

5.- Howard H. Eves, Mathematical Circles, The Mathematical Association of America (MAA), 2003.

Sobre el autor: Raúl Ibáñez es profesor del Departamento de Matemáticas de la UPV/EHU y colaborador de la Cátedra de Cultura Científica

El artículo La circunferencia de los nueve puntos se ha escrito en Cuaderno de Cultura Científica.

Buscando materia oscura con un observatorio de ondas gravitacionales

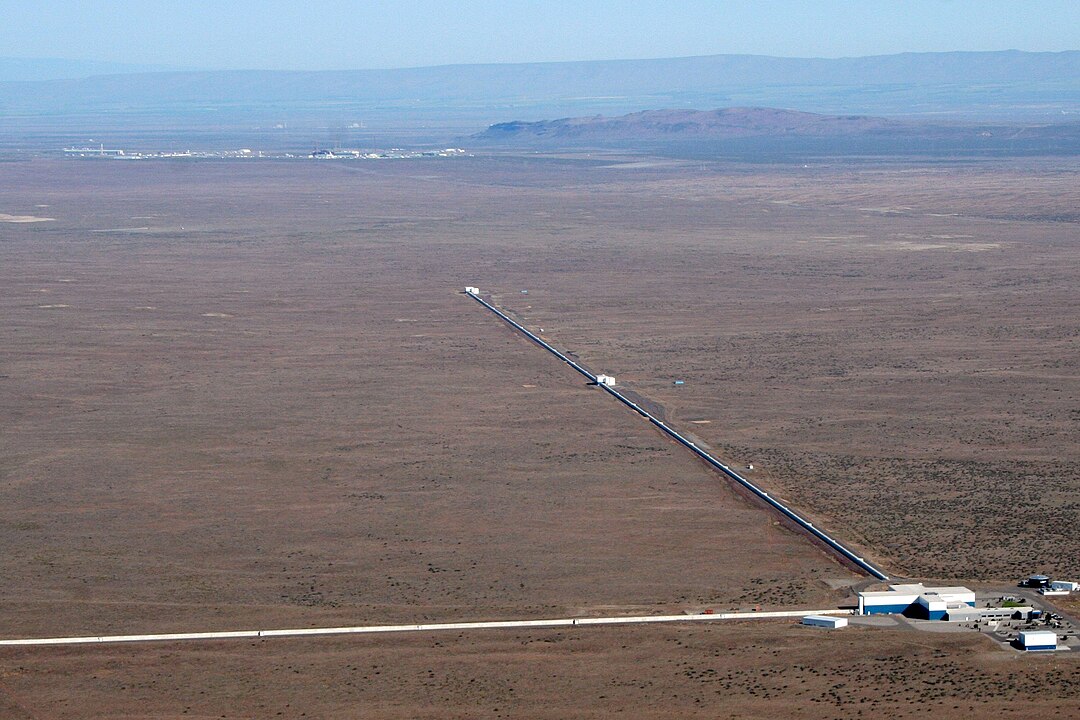

Instalaciones del observatorio LIGO en Hanford (estado de Washington). Fuente: LIGO Laboratory / Wikimedia Commons

Instalaciones del observatorio LIGO en Hanford (estado de Washington). Fuente: LIGO Laboratory / Wikimedia CommonsEn la actualidad, el consenso científico es que la mayor parte de la materia del universo es materia oscura compuesta de partículas exóticas invisibles desde la Tierra. Muchas predicciones del modelo convencional de la materia oscura fría coinciden con las observaciones, pero una de las discrepancias de la teoría es su incapacidad para describir con precisión la estructura de las galaxias enanas. En 2000 se propuso que si las partículas de materia oscura tuvieran una masa extremadamente pequeña, su naturaleza cuántica, ondulatoria por tanto, distribuiría automáticamente la masa en los centros de las galaxias enanas y el modelo se acercaría más a las observaciones. Según esta idea, denominada “materia oscura del campo escalar” (o, a veces, “materia oscura fría difusa”), dichas partículas formarían un gigantesco condensado de Bose-Einstein –un estado normalmente asociado con átomos ultrafríos en los laboratorios de física– dentro y alrededor de cada galaxia.

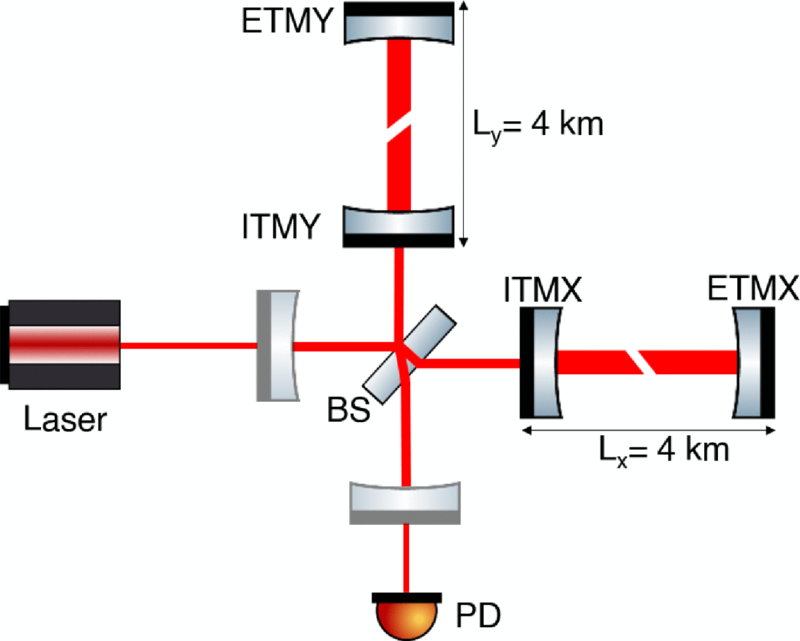

¿Cómo comprobar un modelo así? Usando observatorios como LIGO. LIGO y otros observatorios de ondas gravitacionales detectan las ondas gravitacionales a través de cambios minúsculos (tan pequeños como la millonésima parte del ancho de un núcleo atómico) en la longitud de los brazos del interferómetro, de un kilómetro de longitud.

Esquema del interferómetro de LIGO. El divisor de haz (beam splitter) está marcado como BS en el centro de la figura. Fuente: Göttel et al (2024).

Esquema del interferómetro de LIGO. El divisor de haz (beam splitter) está marcado como BS en el centro de la figura. Fuente: Göttel et al (2024).El modelo predice que la materia oscura del campo escalar debería causar oscilaciones en las constantes fundamentales, a saber, la masa del electrón y la constante de estructura fina. Dichas oscilaciones podrían hacer que la materia se encoja y se expanda a una velocidad que depende de la masa de la partícula del campo escalar. Los detectores de ondas gravitacionales podrían por ello ser sensibles a la materia oscura del campo escalar, ya que debería causar cambios de tamaño en el equipo del interferómetro. Un nuevo análisis de los datos de LIGO no encuentra señales de cambio de tamaño, lo que implica nuevas limitaciones para este modelo de materia oscura.

El equipo de investigadores ha buscado efectos de oscilación en los datos del tercer ciclo de observación de LIGO (2019-2020). No son los primeros en realizar una búsqueda de este tipo, pero su análisis da cuenta de una gama más amplia de efectos. Si bien toda la materia se vería influenciada por el campo escalar, la mayoría de los efectos se cancelarían en LIGO, excepto la señal del divisor de haz (beam splitter, BS en el centro de la figura). El divisor de haz se encuentra en el centro del detector y cualquier cambio en su tamaño cambiaría el patrón de interferencia del láser. Los investigadores no encuentran ninguna señal a una frecuencia de 10 Hz, lo que establece los límites más fuertes hasta ahora para la materia oscura del campo escalar con una masa de 10–13 eV/c2. Planean seguir buscando en futuros conjuntos de datos de LIGO y detectores de próxima generación.

Referencias:

Wayne Hu, Rennan Barkana, and Andrei Gruzinov (2000) Fuzzy Cold Dark Matter: The Wave Properties of Ultralight Particles Phys. Rev. Lett. doi: 10.1103/PhysRevLett.85.1158

Alexandre S. Göttel, Aldo Ejlli, Kanioar Karan, Sander M. Vermeulen, Lorenzo Aiello, Vivien Raymond, and Hartmut Grote (2024) Searching for Scalar Field Dark Matter with LIGO Phys. Rev. Lett. doi: 10.1103/PhysRevLett.133.101001

Michael Schirber (2024) Dark Matter Search in Gravitational-Wave Data Physics 17, s101

Para saber más:

Ondas gravitacionales en la materia oscura

Los púlsares imponen un nuevo límite a la materia oscura ultraligera

La materia oscura auto-interactuante y las curvas de rotación de las galaxias

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo Buscando materia oscura con un observatorio de ondas gravitacionales se ha escrito en Cuaderno de Cultura Científica.

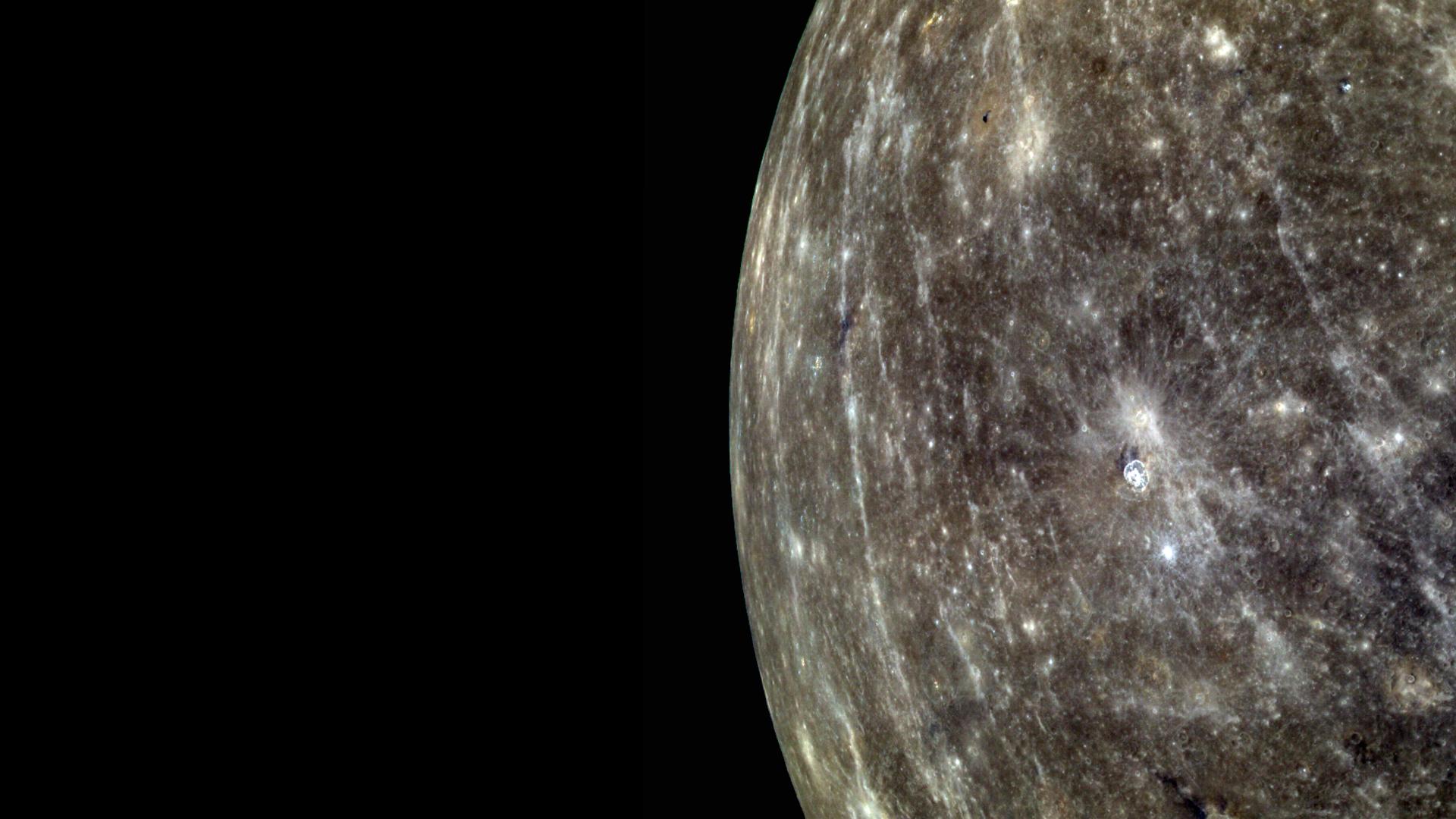

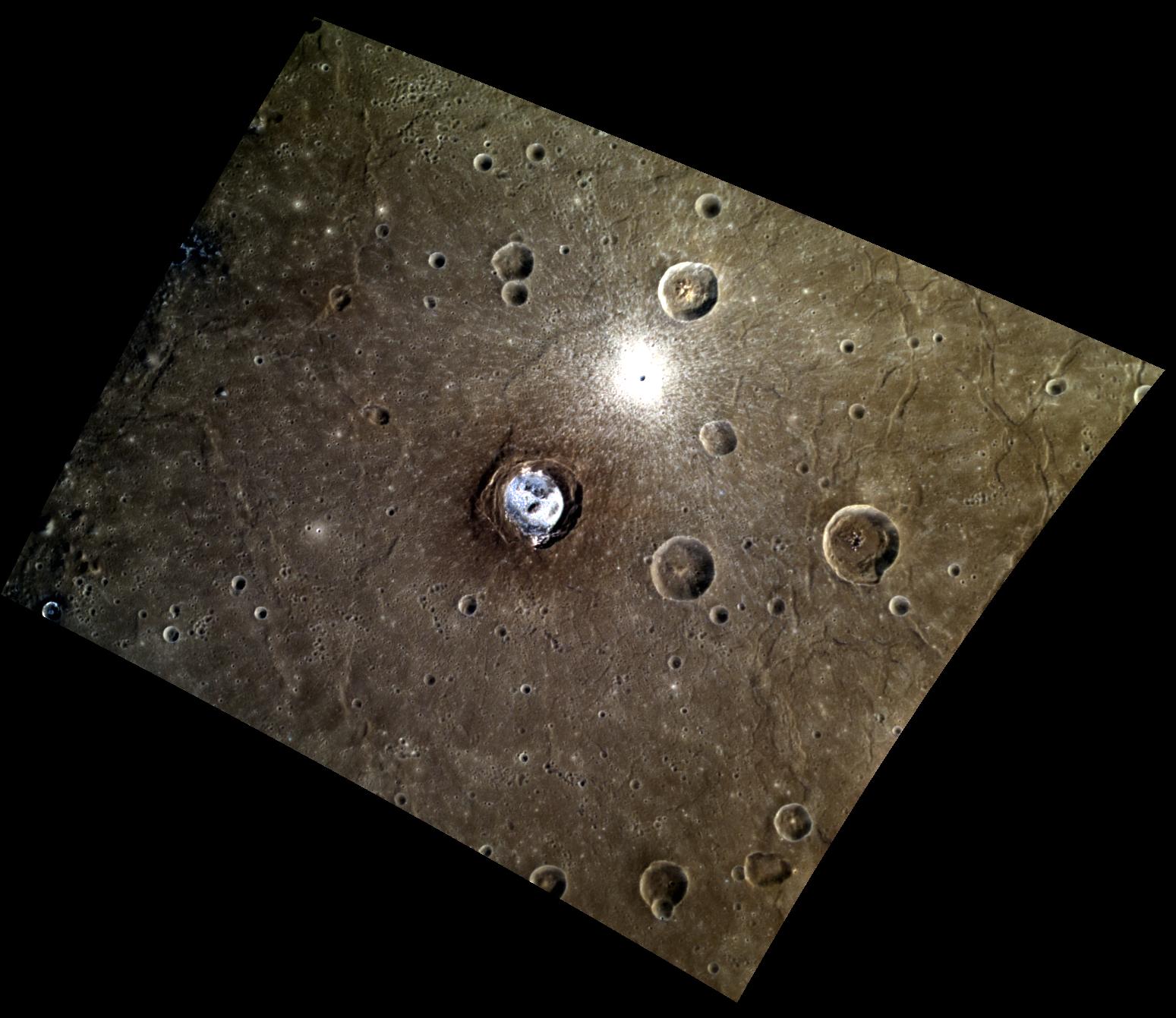

¿De dónde proceden los meteoritos de Marte?

De los más de 80.000 meteoritos que tenemos registrados hoy día en las bases de datos científicas, apenas tenemos contabilizados algo menos de 390 meteoritos cuya procedencia se pueda adscribir con cierto grado de certidumbre al planeta Marte. O lo que es lo mismo, los meteoritos marcianos apenas representan un 0.5% del total de meteoritos que hemos encontrado hasta la fecha.

Esto no quiere decir que estén incluidos todos los que se han podido localizar o hayan caído sobre nuestro planeta, sino que, y remarco esto, son los que de manera fehaciente hemos podido asignar al planeta rojo como su lugar procedencia. E incluso es probable que alguno que haya caído en el pasado todavía no se haya podido encontrar -especialmente si cayó en alguna zona remota o de difícil acceso- y aguarde a ser descubierto algún día.

A la vista de lo dicho en los párrafos anteriores, la pregunta que da título a este artículo puede parecer absurda, pero no lo es. Marte es un planeta “muy” grande -al menos si lo comparamos con la mayoría de asteroides de los que suelen proceder los meteoritos- y hay diferencias geológicas y geoquímicas sustanciales entre unas zonas y otras del planeta, por lo que estos se sitúan como una pieza fundamental para comprender la historia del planeta, como si estuviésemos completando una especie de complicado puzle en el que no solo tenemos que situar todas las piezas como si fuesen un mapa en dos dimensiones, sino que probablemente también representen momentos diferentes de la historia del planeta, añadiendo una tercera dimensión que puede complicar más la interpretación de estos meteoritos y el contexto geológico del que provienen.

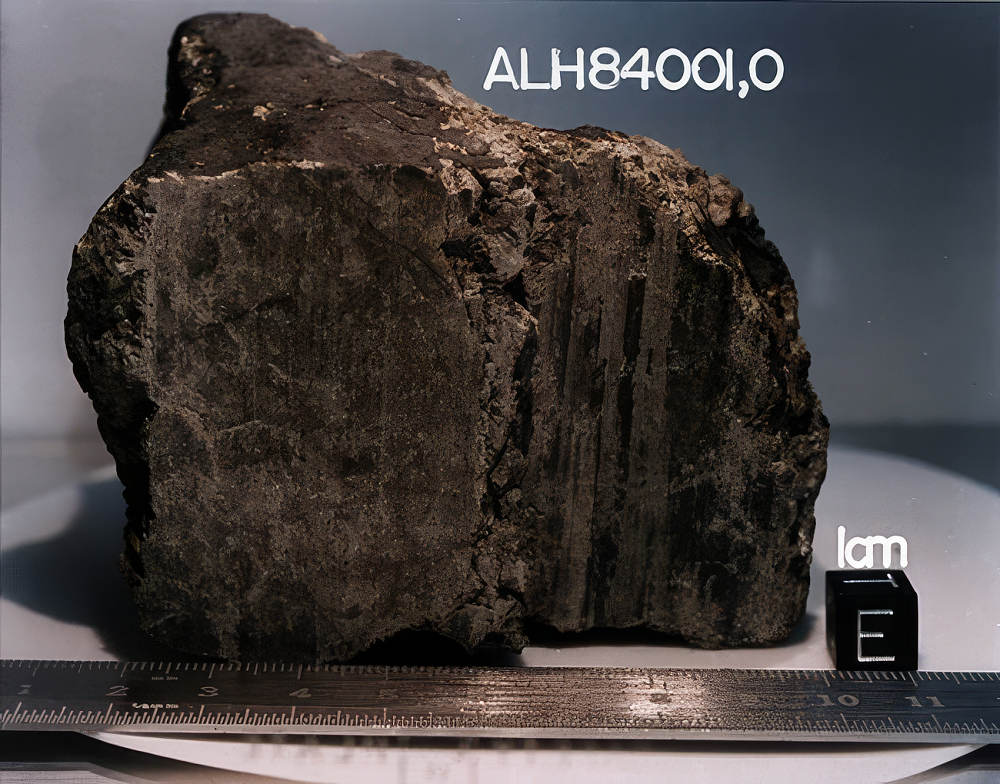

Imagen del archiconocido meteorito marciano ALH84001, encontrado en la Antártida en el año 1984. Cortesía de NASA/JSC/Universidad de Stanford.

Imagen del archiconocido meteorito marciano ALH84001, encontrado en la Antártida en el año 1984. Cortesía de NASA/JSC/Universidad de Stanford.¿Qué tipo de meteoritos hemos encontrado? Pues en su inmensa mayoría están compuestos por rocas ígneas, formadas por la solidificación de un magma en el interior del planeta o en su superficie y cuyos grupos principales son las Shergotitas -siendo estas a su vez la que da nombre al grupo más numeroso de meteoritos marcianos, formando un ~75% de los meteoritos que tenemos identificados-, las Nakhlitas, las Chasignitas (estos tres tipos forman el supergrupo SNC de meteoritos marcianos) y las ortopiroxenitas. Por cierto, dentro de este último grupo se encuentra el archiconocido meteorito ALH 84001, que saltó a la prensa a mediados de la década de los 90 por encontrarse unas formas en él que “recordaban” a posibles fósiles de bacterias y que generaron una gran controversia en el mundo científico.

Pero volvamos al asunto que hoy nos trae hasta aquí. Marte es un planeta complejo, cuya superficie ha estado marcada por erupciones volcánicas, la presencia de hielo y agua, la formación de cráteres de impacto y, por supuesto, la erosión, que continúa hoy en día. Estos procesos han marcado una evolución que puede provocar que, incluso meteoritos que provengan de una misma zona, puedan tener características diferentes, complicando mucho su interpretación y averiguar su verdadera procedencia.

Una nueva investigación publicada en Science Advances por Herd et al. (2024) podría suponer un importante cambio en nuestro conocimiento sobre la procedencia de los meteoritos marcianos que ya tenemos y los que vayamos a encontrar: Combinando los datos de modelos físicos de impacto, datos de teledetección -los que toman las sondas desde la órbita marciana- y las cronologías de los cráteres -las que nos permiten calcular la edad de la superficie de Marte- han podido identificar los posibles lugares de donde algunos de los meteoritos que tenemos en la Tierra fueron eyectados.

Otro punto interesante del estudio es como han interpretado los distintos aspectos observados en los minerales de los meteoritos y que aparecen como consecuencia de la inmensa energía del impacto. Gracias a este detalle los investigadores han podido estimar el tamaño de los cráteres de los que podrían provenir los meteoritos e incluso la profundidad de los materiales -dentro de la corteza del planeta- antes de ser expulsados, lo que ha ayudado a restringir los posibles cráteres de los que podrían proceder.

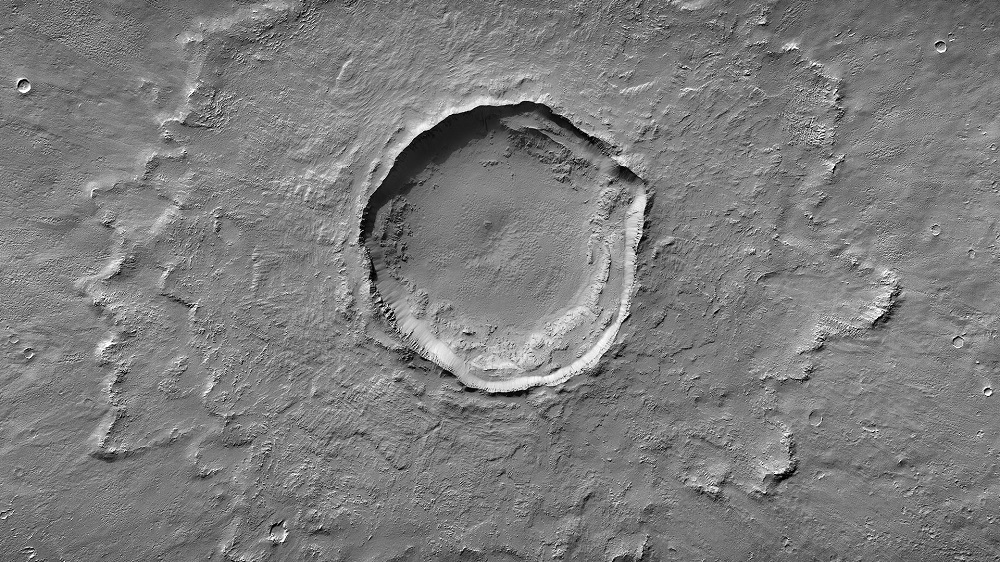

Aquí podemos ver uno de los posibles cráteres marcianos, en este caso el Corinto, que serían responsables de “enviarnos” meteoritos a nuestro planeta. Obsérvese la particular forma en “huevo frito” o cráter de tipo Rampart. Cortesía de NASA/JPL/ASU.

Aquí podemos ver uno de los posibles cráteres marcianos, en este caso el Corinto, que serían responsables de “enviarnos” meteoritos a nuestro planeta. Obsérvese la particular forma en “huevo frito” o cráter de tipo Rampart. Cortesía de NASA/JPL/ASU.Con estos datos han identificado unos cráteres concretos como fuente de algunos de los meteoritos marcianos. Entre los más destacables tenemos Chakpar, Domoni, Kotka, Tooting y Corinto. Este último, por cierto, es un cráter de “récord” ya que se estima que su formación dio lugar a unos 2000 millones de cráteres secundarios en Marte, es decir, cráteres formados por el impacto del material expulsado durante un evento de impacto.

Pero más allá de la procedencia, los autores hacen una serie de anotaciones muy interesantes sobre la geología de Marte: haciendo esta unión entre los meteoritos y sus cráteres “progenitores”, se puede intentar reconstruir la historia volcánica del planeta Marte, lo que nos permite conocer mejor manera los procesos que han transformado el planeta.

La mayor parte de cráteres de esta imagen -que prácticamente está salpicada por estos- son cráteres secundarios, formados por los materiales eyectados durante un impacto contra la superficie de Marte y que al caer a gran velocidad forman nuevos cráteres. Imagen cortesía de NASA/JPL/MSSS/UA.

La mayor parte de cráteres de esta imagen -que prácticamente está salpicada por estos- son cráteres secundarios, formados por los materiales eyectados durante un impacto contra la superficie de Marte y que al caer a gran velocidad forman nuevos cráteres. Imagen cortesía de NASA/JPL/MSSS/UA.De hecho, las diferencias composicionales en los meteoritos las interpretan de tal manera que el manto del planeta no tendría una composición o unas características homogéneas, sino que ha estado dividido en distintas “reservas” magmáticas que han contribuido de manera diferente a la historia volcánica del planeta y, por lo tanto, dando lugar a rocas ígneas diferentes.

Y pongo un ejemplo: Los meteoritos que procederían del cráter Corinto sugieren que el manto que hay debajo de Elysium Planitia estaba más enriquecido en elementos incompatibles -elementos que no entran fácilmente en la estructura de los minerales más comunes durante la cristalización de los magmas y que, por lo tanto, se tienden a concentrar en la fase fundida, formando minerales en rocas mucho más tardías– que el manto que existía bajo la región de Tharsis, mostrando la existencia de un manto en Marte con diferentes composiciones según la zona y por lo tanto dando lugar a fenómenos volcánicos diferenciados, al menos a nivel geoquímico.

Otro aspecto reseñable es el gran sesgo que existe en cuanto a los tipos de meteoritos marcianos que han llegado a nuestro planeta: la mayoría son relativamente jóvenes, con edades de unos pocos cientos de millones de años a unos pocos miles de millones de años, algo que provoca un fuerte contraste con la distribución de edades que conocemos de la superficie de Marte, y que en su mayoría es muy antigua. Este sesgo deja claro que solo con los meteoritos no podemos tener una imagen clara y representativa de la historia de Marte, sino quizás solo de determinados episodios.

Eso si, el estudio nos abre la puerta a que, de cara a futuras misiones, podamos escoger zonas de Marte de donde procedan estos meteoritos para poder confirmar que efectivamente vienen de ahí o incluso acercarnos a otras cuyos cráteres, por tamaño o características, podrían haber enviado meteoritos a nuestro planeta, pero que todavía no hayan sido identificados de una manera correcta o definitiva.

Y, por supuesto, de cara a futuras misiones de retorno de muestras, el hecho de que ya dispongamos de meteoritos de algunas de las zonas podría ayudarnos a escoger otras de las que no tengamos ninguna para poder completar, pieza a pieza, la historia del planeta rojo.

Referencias:

Christopher, et al. (2024) The Source Craters of the Martian Meteorites: Implications for the Igneous Evolution of Mars Science Advances doi: 10.1126/sciadv.adn2378

Sobre el autor: Nahúm Méndez Chazarra es geólogo planetario y divulgador científico.

El artículo ¿De dónde proceden los meteoritos de Marte? se ha escrito en Cuaderno de Cultura Científica.

Así puede la divulgación mejorar la educación en disciplinas STEM

La enseñanza en disciplinas de Ciencia, Tecnología, Ingeniería y Matemáticas (STEM, por sus siglas en inglés), presenta ciertos retos comunes debido a la alta complejidad de su cuerpo de conocimientos y a una elevada presencia de conceptos abstractos que dificultan el aprendizaje. Además, se ha documentado que existe una dificultad específica para establecer conexiones entre los conceptos aprendidos y los conocimientos previos en estas disciplinas; una realidad que se ve agravada por una tendencia a impartir las asignaturas como silos independientes, sin fortalecer sus interrelaciones y sin contextualizarlas en la imagen global de las disciplinas.

Esta situación predispone al alumnado a considerar que el estudio de disciplinas STEM implica una dificultad muy elevada; y esta percepción tiene una fuerte vinculación con las elevadas tasas de abandono y la escasez de vocaciones científicas.

Sin embargo, hay recursos que el profesorado puede tener en consideración para mitigar muchos de estos retos. Uno de ellos es la divulgación científica, particularmente en formato audiovisual.

Fuente: Freepik

Fuente: Freepik

Beneficios de los vídeos de divulgación

Los docentes pueden hacer uso del formato audiovisual en múltiples dinámicas de aula y con diversos propósitos.

Los vídeos pueden emplearse como recurso introductorio para fomentar el interés sobre un tema, que luego el docente amplíe con sus explicaciones. El uso de un formato atractivo, un ritmo ameno y un estilo comunicativo que capte la atención, puede ser particularmente beneficioso para que el alumnado se interese por el tema, y muestre una mayor predisposición a atender al docente y aprender al respecto.

Los vídeos también pueden utilizarse para profundizar en cuestiones complejas y abstractas, en las que la visualización pueda tener relevancia. Por ejemplo, conceptos matemáticos abstractos o fenómenos físicos como el electromagnetismo pueden beneficiarse de una visualización dinámica y tridimensional a través de animaciones insertadas en vídeos. De esta manera, el alumnado no tiene que imaginar un concepto que no conoce a partir de unos bocetos dibujados de manera estática en la pizarra, sino que puede directamente visualizar los conceptos de una manera más intuitiva.

Además, los vídeos pueden pausarse y reproducirse tantas veces como sea necesario, con lo que se pueden emplear también como material de repaso que fomente el aprendizaje autónomo. Además, son un potente aliado en la aplicación de metodologías activas de aprendizaje, como el aula invertida, en las que el alumnado puede familiarizarse con los contenidos en vídeo antes de las clases y después trabajar sobre ellos en el aula.

Sin embargo, no siempre es sencillo para el profesorado encontrar el tiempo, los recursos y las habilidades para crear sus propios vídeos. Es entonces cuando los vídeos de divulgación científica ampliamente disponibles en internet pueden convertirse en el mejor aliado. No solamente existe una gran variedad de vídeos sobre diversas temáticas STEM, sino que además su formato ha demostrado ser adecuado para este fin educativo. Normalmente los vídeos de divulgación disponen de animaciones y recursos visuales en los que se apoya la explicación, gozan de un ritmo adecuado y, además, la voz y estilo comunicativo suele ser cercano, dinámico, y optimizado para captar la atención.

El adecuado uso de este tipo de recursos tiene el potencial de aumentar la motivación e interés del alumnado por las disciplinas STEM, aumentar su rendimiento académico, y mejorar la retención conceptual a largo plazo y el aprendizaje profundo.

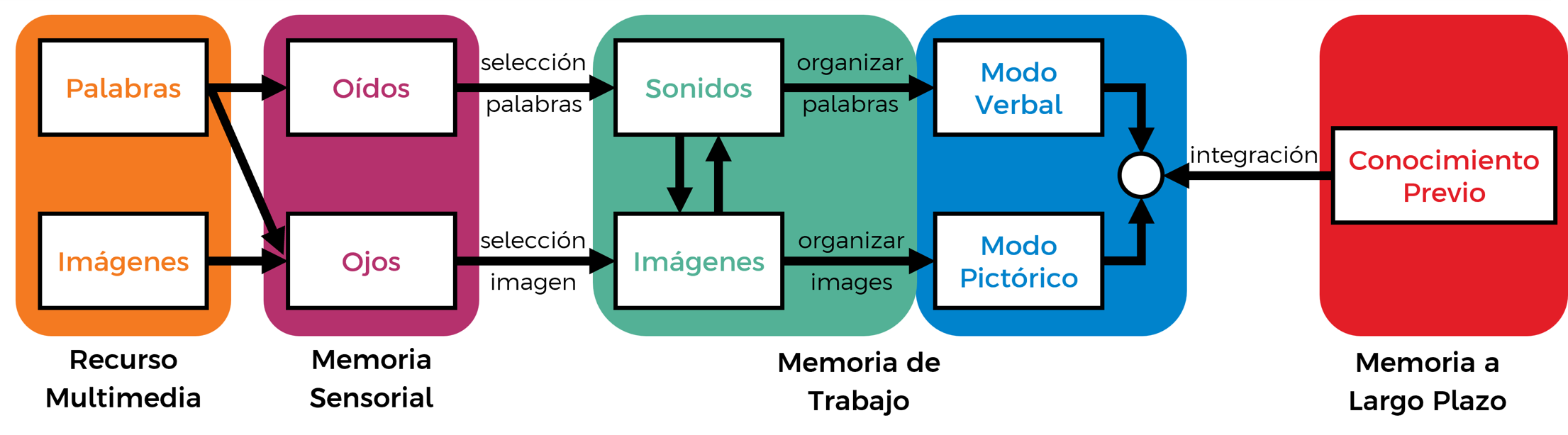

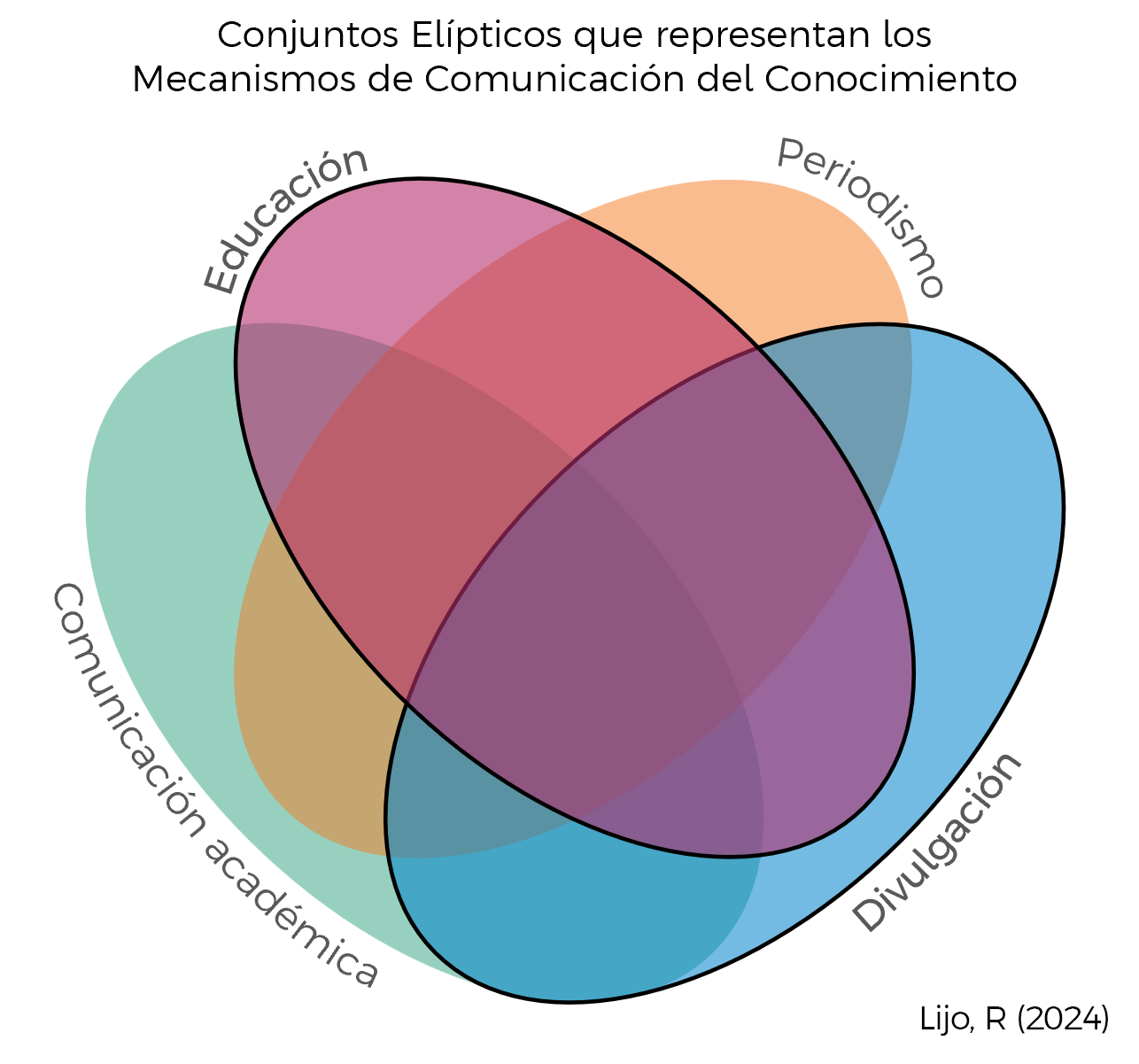

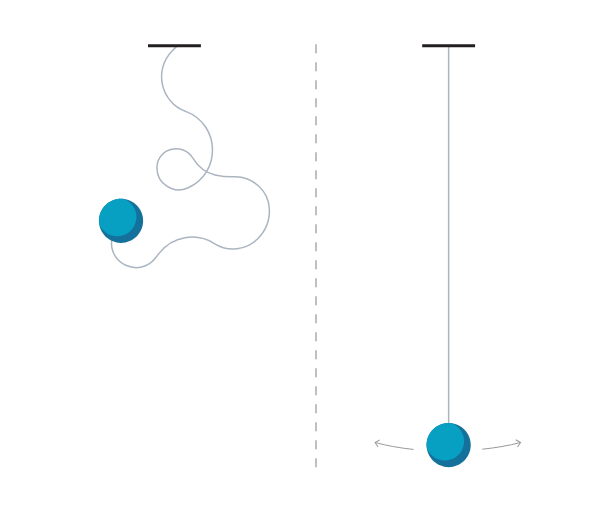

Doble canal: el poder de ver y escucharLa razón de ser de estos beneficios se explica muy bien mediante la Teoría Cognitiva del Aprendizaje Multimedia. Esta teoría se basa en tres principios fundamentales: la información podemos recibirla y procesarla en modo verbal o en modo visual (doble canal); tenemos una capacidad limitada para procesar una cantidad de información en un momento dado, condicionada por nuestra memoria de trabajo; y el aprendizaje efectivo debe ser activo, entendiendo por ello que debemos hacer un esfuerzo particular para integrar la nueva información en nuestro cuerpo de conocimientos previo.

Fuente: Ruben Lijo (2024). Implications of using dissemination videos as a didactic resource in STEM education. PhD Thesis, Universidad de La Laguna. Repositorio Institucional de la Universidad de La Laguna. Available at: https://riull.ull.es/xmlui/handle/915/38547

Fuente: Ruben Lijo (2024). Implications of using dissemination videos as a didactic resource in STEM education. PhD Thesis, Universidad de La Laguna. Repositorio Institucional de la Universidad de La Laguna. Available at: https://riull.ull.es/xmlui/handle/915/38547

Considerando lo anterior, podemos optimizar la capacidad de nuestra memoria de trabajo si recibimos información complementaria en nuestro modo verbal y visual, y precisamente es así como operan los vídeos. Mediante un adecuado balance de explicaciones en palabras y explicaciones visuales podemos mejorar mucho la capacidad de aprendizaje en un momento dado.

Así, mediante el aprovechamiento de este doble canal de recepción y procesado de la información, los vídeos de divulgación pueden ayudarnos en el proceso de aprendizaje. Esta optimización de la memoria de trabajo contribuye a una reducción en la carga cognitiva asociada a la dificultad para comprender los conceptos de la materia aprendida (llamada carga cognitiva intrínseca).

Estrategias para la integración de vídeosAdemás de lo anterior, los vídeos divulgativos pueden ofrecer más beneficios en el proceso de aprendizaje. Estos beneficios vendrán dados por las estrategias que empleemos en la integración de vídeos, y se relacionan con la reducción de otras cargas cognitivas: la carga cognitiva externa y la carga cognitiva relevante. Vamos a entenderlas por separado.

Por un lado, la carga cognitiva externa se relaciona con el contexto en el cual aprendemos. Un contexto de ruido o distracciones aumentará este tipo de carga cognitiva, por ejemplo. En el escenario reciente de aprendizaje remoto de emergencia por la pandemia del COVID-19, muchos estudiantes sufrieron un aumento de esta carga cognitiva debido a tener que adaptarse al estudio en casa y a la docencia online. Los vídeos pueden ser una buena herramienta para mitigar estos impactos, ya que pueden reproducirse tantas veces como sea necesario, adaptándose a los ritmos de aprendizaje individuales de cada estudiante. Los vídeos divulgativos también suelen emplear un ritmo y un lenguaje optimizados para la comprensión de la información y la captación de la atención, contribuyendo a minimizar las distracciones.

Por otro lado, la carga cognitiva relevante es aquella relacionada con nuestra capacidad para integrar la nueva información en la memoria a largo plazo, relacionándola con nuestro cuerpo de conocimientos previos. Una adecuada estrategia de integración de vídeos que se complementen unos a otros, y vayan escalando en nivel, podría ser adecuada para reforzar las interrelaciones entre los conceptos de la materia y la integración de la nueva información. Además, los vídeos que incluyen ejemplos prácticos y contextualizan sus contenidos en la imagen global de la disciplina son muy útiles para reducir este tipo de carga cognitiva.

Sígueme la Corriente: 8 años de divulgación y educación STEMEstos principios se han puesto en práctica en el canal de YouTube Sígueme la Corriente desde el año 2017, con resultados prometedores. Además, la posterior irrupción de la pandemia por el COVID-19 ocasionó una mayor demanda de vídeos compatibles con la enseñanza, y esto motivó una serie de estudios con los que optimizar el canal para un uso dual hacia la divulgación y la educación en ciencia y tecnología.

Fuente: Canal Sígueme la Corriente

Fuente: Canal Sígueme la Corriente

Esta optimización implica la alineación curricular de las temáticas planteadas en los vídeos, así como un incremento en el número de animaciones para favorecer el aprendizaje conceptual y una especial atención a la duración de los vídeos, mejorando la eficiencia de las explicaciones. Así, tendríamos vídeos puramente divulgativos como “¿Cómo se produce la energía en Matrix?” o “¿Qué le pasa a tu cuerpo cuando te electrocutas?”, y vídeos con propósito educativo como “¿Qué son los circuitos trifásicos?” o “¿Cómo crear electricidad con magnetismo?”.

Este estudio se dividió en tres fases: una primera fase preexperimental, una segunda fase con la integración del canal en entornos reales de aula, y la evaluación comparativa del uso de vídeos divulgativos y educativos a lo largo de seis años de operación del canal.

En la primera fase se evaluó la percepción de la audiencia sobre el valor educativo del canal cuando aún no se habían creado contenidos optimizados para su integración educativa. Se definieron una serie de parámetros para medir la adecuación de vídeos para propósitos docentes, relativos a los contenidos de los vídeos, la calidad de las explicaciones, la visualización de las explicaciones conceptuales y el formato de los vídeos. Mediante la participación de 912 personas, se pudo evidenciar una percepción positiva sobre dichas métricas, así como la existencia de un uso educativo del canal de un orden de magnitud similar al uso por entretenimiento (72.7% de los participantes, frente a 87.2%). Todo un éxito, considerando que el canal no tenía en ese entonces una finalidad educativa.

Con estos datos prometedores, se abordó la segunda fase de desarrollo del canal: la puesta en marcha de una nueva sección de contenidos con propósito dual divulgativo-educativo. En este contexto, mediante un acuerdo de colaboración con la Universitat Politècnica de Catalunya, se creó una serie de vídeos para el refuerzo conceptual de los principios del electromagnetismo y la trifásica. Estos vídeos formaron parte de un estudio en el que se evaluó su integración en el Grado en Ingeniería Eléctrica a lo largo de tres años: 2019, 2020 y 2021. Además, el contexto temporal permitió evaluar su impacto como herramienta mitigadora de los efectos negativos de la pandemia en el ámbito educativo.

Se evidenció cómo esta estrategia de aprendizaje basado en vídeos contribuyó a mitigar el impacto del aprendizaje remoto de emergencia. Su apoyo al aprendizaje conceptual ocasionó también una mejora en el rendimiento académico en exámenes de teoría, y también contribuyó significativamente al aumento de la motivación e interés por la asignatura.

Tras esta experiencia exitosa, el canal continuó generando vídeos con propósito dual hacia la divulgación y la educación en paralelo a su actividad divulgativa. En un último estudio se evaluó el rendimiento comparativo de ambos tipos de vídeos, demostrándose que los vídeos enfocados a uso dual superaron a los vídeos enfocados al entretenimiento en todas las métricas evaluadas: visualizaciones, retención de la audiencia, comentarios, likes, etc. Además, se observó una asociación significativa entre la duración de los vídeos y el tiempo de retención de la audiencia, siendo los vídeos con propósito educativo más sensibles a la duración.

Fuente: Ruben Lijo (2024). Implications of using dissemination videos as a didactic resource in STEM education. PhD Thesis, Universidad de La Laguna. Repositorio Institucional de la Universidad de La Laguna. Available at: https://riull.ull.es/xmlui/handle/915/38547

Fuente: Ruben Lijo (2024). Implications of using dissemination videos as a didactic resource in STEM education. PhD Thesis, Universidad de La Laguna. Repositorio Institucional de la Universidad de La Laguna. Available at: https://riull.ull.es/xmlui/handle/915/38547

Estos estudios demuestran el potencial de los vídeos divulgativos en el campo de la educación. Se trata de un camino bidireccional, mediante el cual educadores y creadores de contenidos pueden beneficiarse. Por una parte, los educadores pueden acceder a una mayor cantidad de recursos didácticos adecuados y con beneficios para su actividad docente. Por otra, los divulgadores pueden aludir con su actividad a un público objetivo mayor y a una finalidad social complementaria.

Referencias:

Ruben Lijo (2024). Implications of using dissemination videos as a didactic resource in STEM education. PhD Thesis, Universidad de La Laguna. Repositorio Institucional de la Universidad de La Laguna. Available at: https://riull.ull.es/xmlui/handle/915/38547

Ruben Lijo, Eduardo Quevedo, José Juan Castro and Ricard Horta (2022). Assessing Users’ Perception on the Current and Potential Educational Value of an Electrical Engineering YouTube Channel. In IEEE Access, vol. 10, pp. 8948-8959, doi: https://doi.org/10.1109/ACCESS.2021.3139305

Ruben Lijo, Eduardo Quevedo and José Juan Castro (2023). Qualitative Assessment of the Educational Use of an Electrical Engineering YouTube Channel. 2023 IEEE World Engineering Education Conference (EDUNINE), Bogota, Colombia, pp. 1-6, doi: https://doi.org/10.1109/EDUNINE57531.2023.10102890

Ruben Lijo, Eduardo Quevedo, José Juan Castro and Ricard Horta (2023). Impact of Electrical Engineering Didactic Videos During Emergency Remote Learning. In IEEE Access, vol. 11, pp. 19622-19634, doi: https://doi.org/10.1109/ACCESS.2023.3248299

Ruben Lijo, José Juan Castro, Eduardo Quevedo (2024). Comparing educational and dissemination videos in a STEM YouTube channel: A six-year data analysis. Heliyon, vol. 10 (3), doi: https://doi.org/10.1016/j.heliyon.2024.e24856

Sobre los autores: Rubén Lijó, Coordinador Global de Formación en Hitachi Energy, e Investigador Posdoctoral en el Instituto para el Desarrollo Tecnológico y la Innovación en Comunicaciones (IDeTIC) de la Universidad de Las Palmas de Gran Canaria; Eduardo Quevedo, Instituto Universitario de Microelectrónica Aplicada (IUMA) de la Universidad de Las Palmas de Gran Canaria; y José Juan Castro, Departamento de Psicología, Sociología y Trabajo Social en la Universidad de Las Palmas de Gran Canaria.

El artículo Así puede la divulgación mejorar la educación en disciplinas STEM se ha escrito en Cuaderno de Cultura Científica.

Día de pi 2024: Matemáticas, la flecha del tiempo y mentes artificiales y biológicas

El número Pi, representado por la letra griega π, es una de las constantes matemáticas más famosas e importantes que existen en el mundo. Este número irracional, que determina la relación entre la longitud de una circunferencia y su diámetro, concierne a múltiples disciplinas científicas como la física, la ingeniería y la geología, y tiene aplicaciones prácticas sorprendentes en nuestro día a día.

La fascinación que ha suscitado durante siglos es tal, que se viene estudiando desde hace más de 4.000 años e, incluso, cuenta con su propio día en el calendario: el 14 de marzo. Este evento internacional vino de la mano del físico estadounidense Larry Shaw, quien en 1988 lanzó la propuesta de celebrar esta efeméride. La forma en la que se escribe el 14 de marzo en inglés y euskera coincide con los tres primeros dígitos de la famosa constante matemática: 3-14 martxoaren 14 en euskara / 3-14 March, 14th en inglés. En los últimos años, la conmemoración del Día de Pi se ha ido extendiendo, hasta tal punto que el 26 de noviembre de 2019 la UNESCO proclamó el 14 de marzo Día Internacional de las Matemáticas.

Un año más, el Basque Center for applied Mathematics-BCAM y la Cátedra de Cultura Científica de la UPV/EHU nos sumamos a la celebración, organizando la quinta edición del evento BCAM NAUKAS, que se desarrolló a lo largo del 14 de marzo en el Bizkaia Aretoa de UPV/EHU.

Miguel Aguilera nos habla de los fenómenos emergentes en redes neuronales y qué papel desempeña la direccionalidad del tiempo en Matemáticas, la flecha del tiempo y mentes artificiales y biológicas.

Miguel Aguilera Lizarraga es investigador postdoctoral en el BCAM en el área de Biología Matemática y Computacional. Nacido en La Rioja, es becario Junior Leader de la Fundación la Caixa y trabaja donde confluyen los sistemas complejos, la neurociencia computacional, la vida artificial y la ciencia cognitiva. Su trabajo combina modelos y métodos de la física estadística fuera del equilibrio, la teoría de la información y la teoría de sistemas dinámicos, con el objetivo de estudiar la emergencia de comportamientos adaptativos y autónomos en diferentes niveles de sistemas biológicos.

Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Día de pi 2024: Matemáticas, la flecha del tiempo y mentes artificiales y biológicas se ha escrito en Cuaderno de Cultura Científica.

Escasez e incertidumbre: el desafío de freír un huevo en un mundo en conflicto

2022: la humanidad aún lidiaba con las secuelas de la pandemia y buscaba recuperar su ritmo habitual, pero un giro sacudió el escenario político internacional. Mientras que la preocupación por el virus de la covid-19 disminuía, un conflicto bélico emergía. Observábamos una conflagración en el este de Europa que nos hacía reflexionar sobre el rumbo geopolítico.

Este conflicto distante subrayó la interdependencia global al involucrar a la alimentación. Al ir a la tienda, nos encontrábamos con anuncios que nos pedían que limitáramos nuestras compras de aceite. Al unísono, los medios daban noticias sobre el desabastecimiento de aceites a nivel mundial. La razón: la guerra de Ucrania.

Mientras tanto, mi duda casi existencial era que cómo iba a poder freír huevos ahora. Había amenazas tangibles para mis desayunos. Mi fútil predicamento me llevó a pensamientos multivariables, haciéndome recordar inclusive los preceptos básicos de la fritura de un huevo.

Cuando freímos un huevo, el calor del aceite provoca una metamorfosis que lo convierte en una mezcla sólida y elástica. La transformación molecular durante la fritura de un huevo crea su textura y sabor característicos, haciéndolo un placer culinario. El aceite juega un papel vital aquí. El de girasol, por ejemplo, mantiene cierta estabilidad a altas temperaturas, lo cual es útil al momento de freír. Es esencial elegir aceites que conserven su estabilidad al menos hasta los 180 °C para evitar la producción de sustancias nocivas durante la fritura.

Los diferentes aceites tienen perfiles únicos de ácidos grasos que afectan su sabor, aroma, estabilidad y aplicaciones culinarias. Por ejemplo, el aceite de cacahuete es rico en ácido oleico y linoleico, mientras que el de girasol destaca por su contenido en ácido linoleico. Estas diferencias influyen en si son adecuados para freír, cocinar o aderezar.

Además, los ácidos grasos presentes tienen implicaciones para la salud cardiovascular y la gastronomía, con el ácido oleico asociado a beneficios cardiovasculares. La elección del aceite adecuado depende de las necesidades y preferencias culinarias.

La importancia global del aceiteLa escasez de aceite de cocina nos recuerda su importancia en la alimentación a nivel global. La falta de este elemento esencial para freír un huevo podría, aparentemente, tener repercusiones geopolíticas.

La dependencia de Ucrania en las exportaciones mundiales de aceites vegetales se hizo evidente. La escasez afectó a lugares que iban desde Vitoria-Gasteiz (España) a Machala (Ecuador) y mostró que el problema era serio. Ambos países se vieron afectados a pesar de las diferencias en la producción agrícola entre ambos. Por ejemplo, en España, el aceite de semilla de girasol es uno de los más consumidos, incluso en detrimento de su cultivo oleaginoso emblemático: la aceituna u oliva.

En Ecuador, uno de los principales productores de palma africana y donde el aceite de soja es uno de los más consumidos, observar desabastecimiento y encarecimiento de los aceites comestibles resultaba inverosímil. El precio del aceite de girasol se ha incrementado en este país, incluso sin haber un riesgo real de escasez, ya que Bolivia y Argentina son los principales proveedores de semillas de girasol en este caso.

La guerra en Ucrania reveló la vulnerabilidad de depender de un solo producto. Los conflictos en la región afectaron a la producción y el transporte de este aceite. Ucrania y Rusia tenían una ventaja competitiva significativa, pero el conflicto complicó la situación. La dependencia de Ucrania como proveedor clave destacó la vulnerabilidad de la cadena de suministro mundial. Ante esto, es vital considerar el uso de materias primas locales alternativas para garantizar un suministro alimentario resiliente.

La fritura no es solamente un acto culinario, sino que además es un indicador de los desafíos y las complejidades del mundo en el que vivimos. La guerra en Ucrania demostró la fragilidad de la cadena de suministro de aceites y la vulnerabilidad de muchos países ante la dependencia de un solo producto.

La importancia de buscar alternativasEn lugares donde el aceite de girasol no era un actor principal en el sector de los aceites, las señales de escasez y especulación generaron dudas. Aunque algunos países podrían ser autosuficientes en cuanto a cultivos oleaginosos, deben superar ciertas ventajas competitivas para garantizar un suministro estable. La guerra en Ucrania expuso las debilidades de depender de un solo proveedor y resaltó la necesidad de diversificar las fuentes de suministro y promover la producción local de materias primas.

Ante la adversidad se presentan oportunidades para promover el cultivo y uso ulterior de otras materias primas viables y sostenibles, por ejemplo, el cacahuete, el frijol lupino y la quinoa.

Mientras reflexionamos sobre estas complejidades geopolíticas y económicas, les invito a intentar pasar por alto la incertidumbre con un aliciente momentáneo. Qué mejor que un huevo frito, ahora un símbolo cotidiano y silencioso de la importancia de la resiliencia y la adaptabilidad en tiempos de cambio, para degustar de las bondades que, a veces, la cotidianidad hace que demos por sentadas.![]()

Sobre el autor: Fabián Patricio Cuenca Mayorga es personal investigador del Departamento de Farmacia y Ciencias de los alimentos de la Universidad del País Vasco / Euskal Herriko Unibertsitatea

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo Escasez e incertidumbre: el desafío de freír un huevo en un mundo en conflicto se ha escrito en Cuaderno de Cultura Científica.

Las rocas también tienen pasaporte

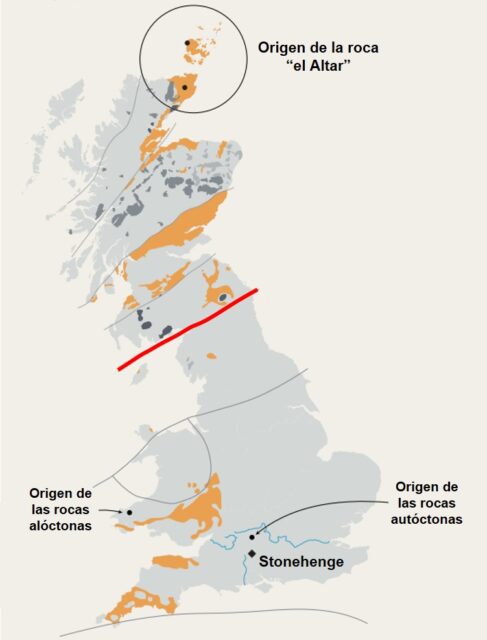

Recientemente se ha publicado un artículo en la revista Nature en el que se propone un nuevo lugar de origen para una roca que forma parte del yacimiento megalítico Stonehenge llamada “el Altar”, situándolo a más de 750 kilómetros del mismo. Este descubrimiento ha abierto una acalorada discusión arqueológica sobre el posible proceso del transporte de este bloque rocoso de más de seis toneladas de peso hace miles de años. Pero lo que ha pasado más desapercibida es la importancia de la Geología en este estudio, ya que sin ella habría sido imposible llevarlo a cabo.

Yacimiento megalítico de Stonehenge, situado en el Condado de Wiltshire, Inglaterra. Foto: Diego Delso / Wikimedia Commons