Adiós a la canica azul: La Tierra se está oscureciendo y no son buenas noticias

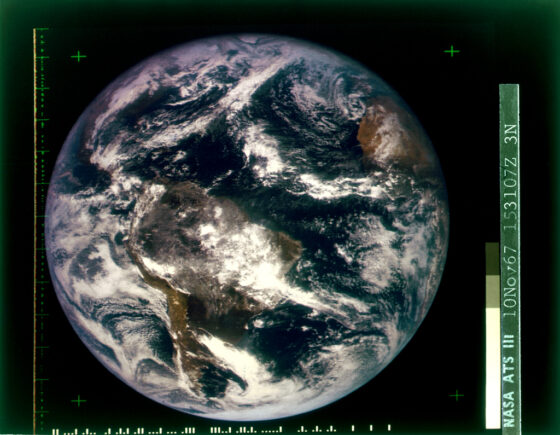

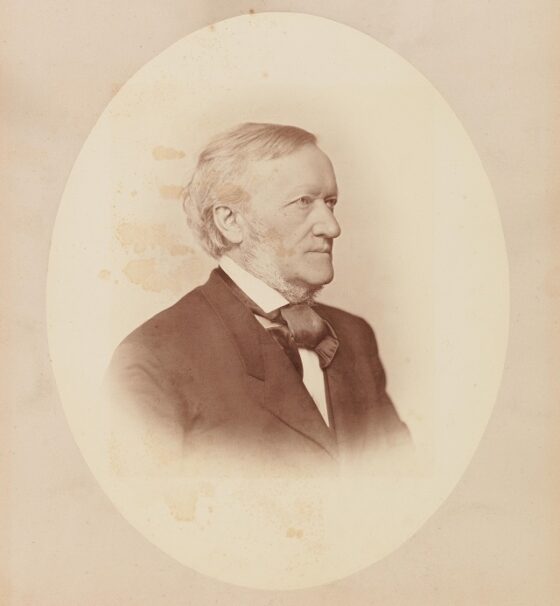

La Tierra vista por la misión lunar Apolo 17 en 1972. Foto: NASA / Dominio Público

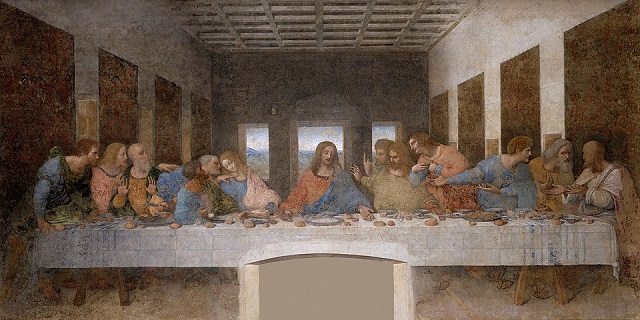

La Tierra vista por la misión lunar Apolo 17 en 1972. Foto: NASA / Dominio PúblicoEl 7 de diciembre de 1972, a las 12:33 a. m, el colosal cohete Saturno V despegaba desde el actual Centro espacial Kennedy rumbo a la Luna. Se trataba de la última misión del programa Apolo y en ella viajaba la última tripulación que pisaría la Luna hasta nuestros días. Apenas cinco horas después del lanzamiento los astronautas Eugene Cernan, Ronald Evans y Harrison Schmitt se encontraban ya a casi 30.000 kilómetros de nuestro planeta cuando decidieron mirar por la ventanilla y observar la Tierra desde la distancia. La fotografía que tomaron en aquel momento se conoce popularmente como «la canica azul» y pronto se convirtió en un icono de los movimientos medioambientales de los setenta inspirando la idea de que debemos cuidar nuestro único y frágil hogar en el inmenso cosmos.

Era la primera vez que un ser humano captaba una imagen de la Tierra de manera completa, nítida y sin sombras. La fotografía original, tomada por la tripulación desde el Módulo de Mando y Servicio (CSM), mostraba el Polo Sur en la parte superior de la imagen pero posteriormente fue girada para cumplir con las expectativas y convenciones de orientación con el norte en su lugar. También fue única al captar la Antártida y casi todo su casquete polar, así como la costa de África, tanto en el Atlántico como en el Índico e incluso el potente ciclón de Tamil Nadu que, apenas unos días antes, había provocado fuertes vientos e inundaciones en la India.

Pero, además de las características físicas y geográficas de la fotografía, más allá de su simbología y trascendencia o de las incontables tecnologías que fueron necesarias para poder tomar una fotografía así desde el espacio, la célebre «Blue Marble» fue posible gracias al albedo de nuestro planeta. Ya sea un pequeño punto azul pálido o una canica brillante en el oscuro vacío del espacio, nuestra querida Tierra es visible desde el espacio porque refleja la luz… aunque según los todos estudios y datos satelitales de las últimas décadas, cada vez menos.

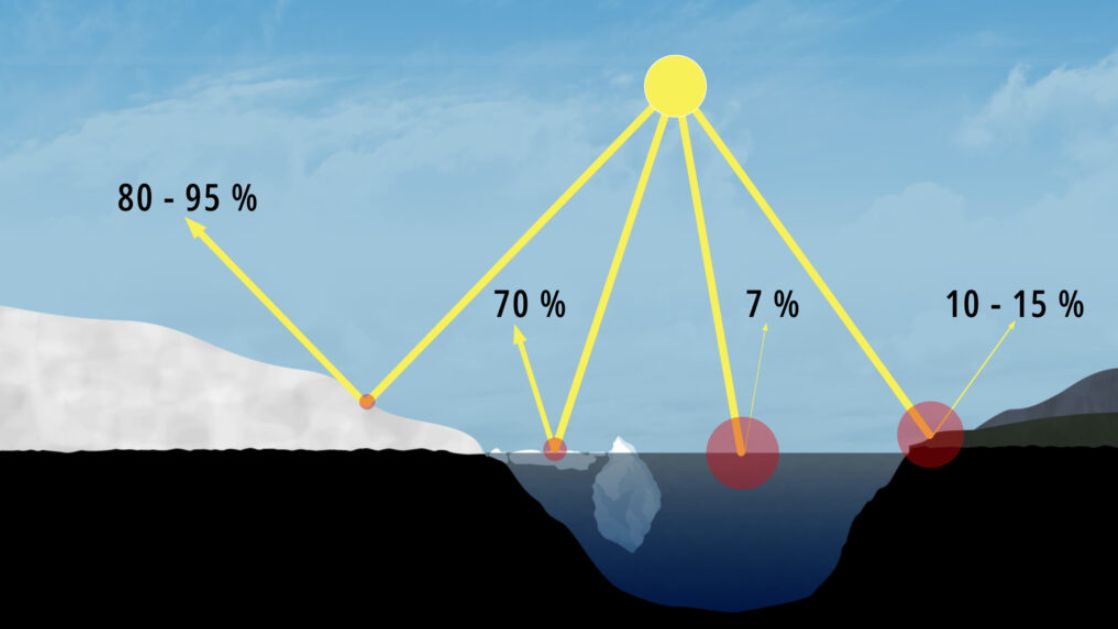

El albedo es un concepto científico que expresa el porcentaje de luz solar que refleja una superficie. La nieve, por ejemplo, puede tener un albedo de hasta un 0,9, es decir puede reflejar hasta el 90 % de la luz solar que incide sobre ella. Por otro lado, «el océano abierto puede tener un albedo inferior a 0,1, lo que significa que absorbe más del 90 % de la luz solar incidente y reflejando menos del 10 %».

El albedo es un concepto científico que expresa el porcentaje de luz solar que refleja una superficie. La nieve, por ejemplo, puede tener un albedo de hasta un 0,9, es decir puede reflejar hasta el 90 % de la luz solar que incide sobre ella. Por otro lado, «el océano abierto puede tener un albedo inferior a 0,1, lo que significa que absorbe más del 90 % de la luz solar incidente y reflejando menos del 10 %».El albedo es un concepto científico que expresa el porcentaje de luz solar que refleja una superficie. La nieve, por ejemplo, puede tener un albedo de hasta un 0,9, es decir puede reflejar hasta el 90 % de la luz solar que incide sobre ella. Por otro lado, «el océano abierto puede tener un albedo inferior a 0,1, lo que significa que absorbe más del 90 % de la luz solar incidente y reflejando menos del 10 %».

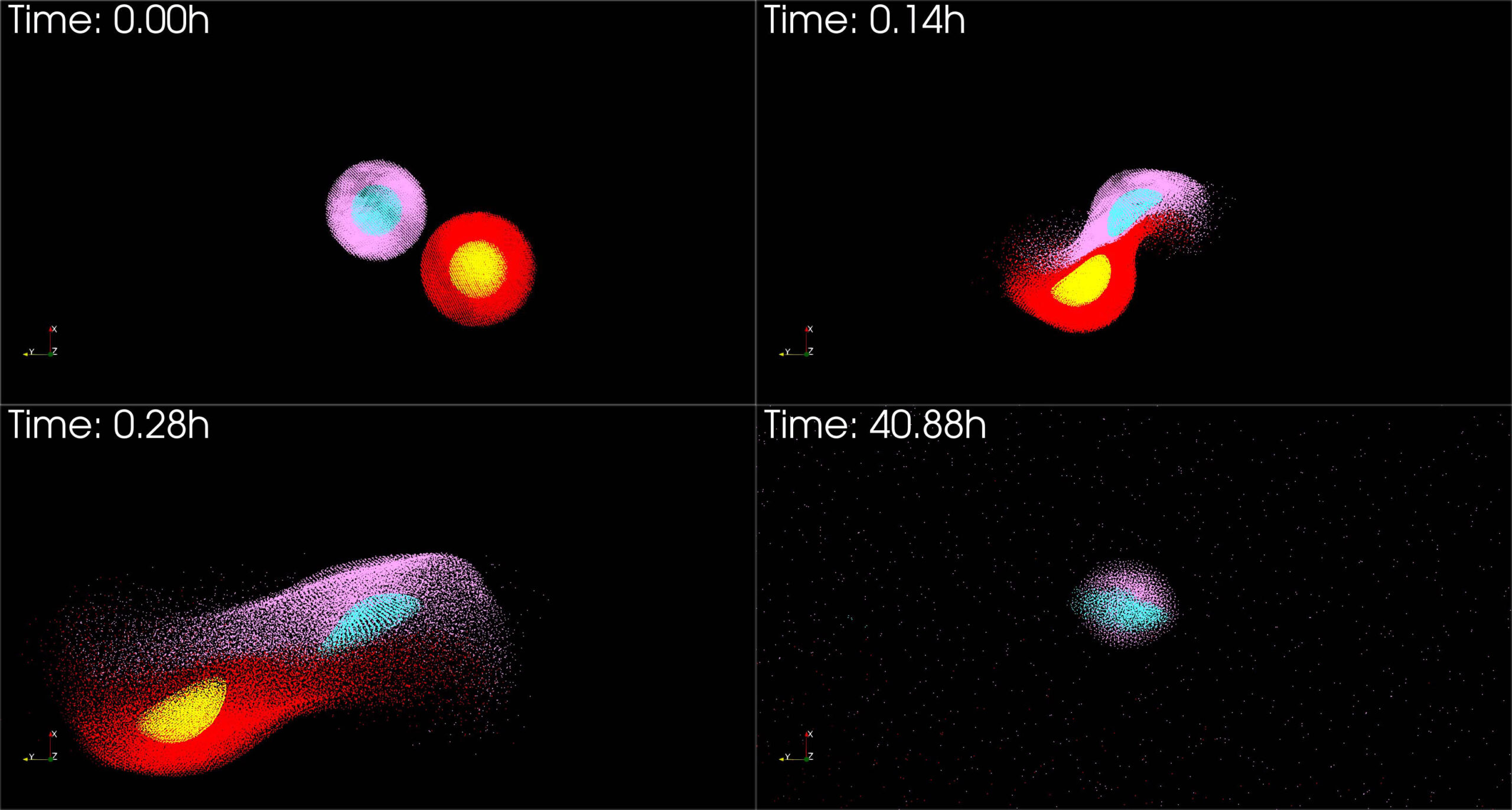

Un nuevo estudio, publicado hace unas semanas en Proceedings of the National Academy of Sciences (PNAS), vuelve a confirmar que nuestro planeta está perdiendo albedo y, desde hace décadas, es un cuerpo cada vez más y más oscuro. Los autores, encabezados por el investigador Norman Loeb, pertenecen al departamento de Ciencias de la radiación de NASA y han utilizado datos de tres satélites diferentes que miden «la luz solar incidente frente a la radiación de onda larga saliente, es decir, la cantidad de radiación reflejada de vuelta al espacio».

Los datos proceden del programa CERES, un acrónimo cuyas siglas se corresponden con «Sistema de Nubes y Energía Radiante de la Tierra» y que cuenta en la actualidad con una red de satélites que miden el balance de radiación terrestre (BRT). Desde el año 2000, CERES ha estado registrando cuánta luz solar absorbe nuestro planeta así como la cantidad de radiación infrarroja que escapa de vuelta al espacio. El equipo de Loeb utilizó estas mediciones para analizar el balance energético de nuestro planeta en los últimos 24 años (2001-2024) y, posteriormente, combinó estos datos con otras fuentes de información como cámaras espectrales de alta resolución, mapas de nieve y nubes, y modelos climáticos por computadora para llegar a una conclusión esperada: la Tierra lleva décadas oscureciéndose.

Un sistema desequilibrado en el Hemisferio NorteEl trabajo publicado no solo ha utilizado los datos satelitales del programa CERES para confirmar el paulatino oscurecimiento de la Tierra sino que además, y puede ser su mayor aportación, incluye un descubrimiento con importantes repercusiones: El Hemisferio Norte se está oscureciendo más rápido que el Sur.

Según las mediciones del estudio, el Hemisferio Norte «absorbe aproximadamente 0.34 vatios más de energía solar por metro cuadrado por década que el Hemisferio Sur», una diferencia que parece menos pero que, teniendo en cuenta toda la superficie del planeta, supone una «cantidad enorme», explica Loeb en Eos.org.

Hasta ahora se pensaba que la Tierra absorbía y reflejaba la energía procedente del Sol de manera balanceada y que no había una diferencia significativa entre ambos hemisferios, sin embargo este nuevo estudio descarta esa hipótesis y apunta a un desequilibrio notable entre hemisferios en el que el Norte está absorbiendo un plus energía y, por tanto, se oscurece más.

¿Por qué el Hemisferio Norte se oscurece más?El trabajo publicado también expone los motivos de este desequilibrio e indica tres factores fundamentales. El primero, quizá el más obvio, es el deshielo. En el Hemisferio Norte la nieve y el hielo, especialmente en el Ártico, se están derritiendo a un ritmo más acelerado y eso reduce el albedo exponiendo la tierra y el océano que hay debajo.

El segundo aspecto a tener en cuenta son las regulaciones medioambientales que, en los últimos años, han logrado disminuir la contaminación en lugares como China, Estados Unidos y Europa, lo que significa que «hay menos aerosoles en el aire para reflejar la luz solar. En el Hemisferio Sur ocurre lo contrario».

Y en tercer lugar, los autores mencionan el vapor de agua. «Debido a que el Norte se está calentando más rápido, también retiene más vapor de agua, un gas de efecto invernadero que no refleja la luz solar sino que la absorbe. Esa es otra razón por la que el Hemisferio Norte está absorbiendo más calor».

Pero todavía quedan incógnitas que resolver en este panorama y factores de los cuales aún desconocemos su influencia, como por ejemplo la cobertura de nubes. Otro de los hallazgos interesantes de este estudio es que, en los últimos 20 años, la cobertura de nubes no ha cambiado significativamente a pesar de la asimetría Norte-Sur. «Debería verse más reflexión por parte de las nubes en el Hemisferio Norte (en comparación con el Sur), pero no la vemos», concluye Loeb.

En definitiva, el nuevo estudio publicado por NASA nos muestra que nuestro planeta está absorbiendo cada vez más radiación, reflejando menos luz y calentándose de manera acelerada, sin olvidar que el Hemisferio Norte lo hace más rápido que el Sur.

Si los astronautas del Apolo 17 mirasen en nuestros tiempos por la ventana de su módulo, la fotografía de nuestra «Canica Azul» sería hoy algo menos brillante y más oscura, un punto azul cada vez más pálido…

Referencias científicas y más información:

Loeb, Norman G., et al. (2025) Emerging Hemispheric Asymmetry of Earth’s Radiation Proceedings of the National Academy of Sciences doi:10.1073/pnas.2511595122.

Larissa G. Capella (2025) «New Satellite Data Reveal a Shift in Earth’s Once-Balanced Energy System» Eos.org

Margherita Bassi (2025) «Earth Is Getting Dimmer—and the Northern Hemisphere Is Losing Brightness Faster Than Scientists Expected» Smithsonian Magazine (2025)

Ryan Green (2025) «Earth Is Getting Darker, Which Could Accelerate Global Warming» Scientific American

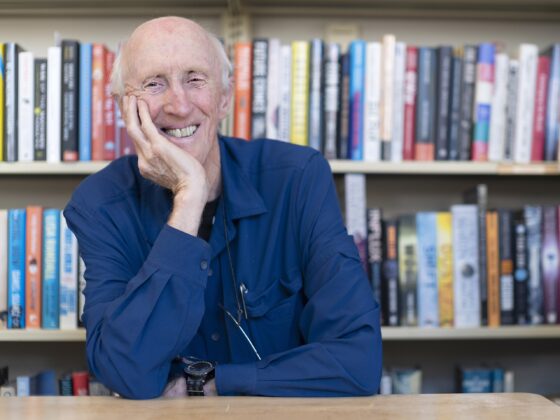

Sobre el autor: Javier «Irreductible» Peláez es escritor y comunicador científico. Autor de «500 Años de Frío» (2019) y «Planeta Océano» (2022). Es ganador de tres premios Bitácoras, un premio Prisma a la mejor web de divulgación científica y un Premio Ondas al mejor programa de radio digital.

El artículo Adiós a la canica azul: La Tierra se está oscureciendo y no son buenas noticias se ha escrito en Cuaderno de Cultura Científica.

CRISPR-CAS9 y las terapias génicas

CRISPR-Cas9 ha transformado la biología: una herramienta de edición genética que permite cortar y pegar ADN con una precisión revolucionaria.

Los vídeos “Hitos científicos del siglo XXI” muestran los mayores descubrimientos y avances científicos de las últimas décadas. Se han emitido como una sección del programa de divulgación científica de RTVE Órbita Laika, en colaboración con la Cátedra de Cultura Científica de la Universidad del País Vasco.

Ficha técnica:

Producción ejecutiva: Blanca Baena

Guion: José Antonio Pérez Ledo

Dirección: Aitor Gutierrez

Grafismo: Cristina Serrano

Música: Israel Santamaría

Producción: Olatz Vitorica

Doblaje: K 2000

Locución: José Antonio Pérez Ledo

El artículo CRISPR-CAS9 y las terapias génicas se ha escrito en Cuaderno de Cultura Científica.

Cuidando nuestra salud oral protegemos el cerebro

Cuando pensamos en salud oral, solemos imaginar dientes blancos y encías firmes. Pero mantener una buena higiene bucal va mucho más allá de una cuestión estética: puede influir directamente en la salud de todo nuestro organismo.

Foto: Marcos Ramírez / Unsplash

Foto: Marcos Ramírez / UnsplashPorque lo que ocurre en la boca no se queda en la boca. Las bacterias que se acumulan en los dientes y encías pueden viajar por el cuerpo y tener consecuencias en órganos tan distintos como el corazón o el cerebro.

Una mala salud oral no solo favorece la aparición de caries, la pérdida de dientes o la inflamación de encías (gingivitis): también puede agravar enfermedades crónicas como la diabetes, aumentar el riesgo de ciertos tipos de cáncer e incluso contribuir al desarrollo de enfermedades cardiovasculares, cerebrales y neurodegenerativas.

En concreto, se ha observado que las personas que padecen periodontitis –una inflamación crónica de las encías causada por la acumulación de placa bacteriana– presentan más posibilidades de desarrollar complicaciones en otras partes del cuerpo. Los datos son claros: un paciente con periodontitis no tratada tiene 2,5 veces más riesgo de sufrir un ictus y casi 3 veces más de probabilidades de padecer una enfermedad cardíaca en comparación con quienes mantienen una buena salud bucodental.

Además, la inflamación crónica asociada con la periodontitis también podría contribuir al deterioro cognitivo, como ocurre en el alzhéimer.

Alzhéimer: el olvido que lo cambia todoEl alzhéimer es la causa más frecuente de demencia neurodegenerativa. A nivel mundial, más de 57 millones de personas viven con demencia, de las cuales entre el 60 % y el 70 % padecen alzhéimer. En España, afecta a unas 800 000 personas, y se estima que su prevalencia se duplicará en los próximos 20 años.

Aunque aún no conocemos su causa exacta, sí sabemos que influyen tanto la genética como factores ambientales, incluido nuestro estilo de vida. Y es aquí donde aparece una conexión inesperada: el cuidado de las encías podría desempeñar un papel protector frente al deterioro cognitivo.

Bacterias, seres invisibles que dejan huellaLa boca alberga unas 770 especies de microorganismos que componen la microbiota oral. En equilibrio, esta comunidad bacteriana cumple funciones beneficiosas. Pero cuando la higiene es deficiente o existen factores que alteran ese equilibrio, las bacterias patógenas se multiplican, favoreciendo la aparición de enfermedades como la enfermedad periodontal.

La gingivitis, la forma más leve, afecta hasta al 90 % de la población y puede revertirse con una correcta higiene. Sin embargo, si progresa, puede convertirse en periodontitis, una afección crónica, inflamatoria e irreversible con consecuencias que van mucho más allá de la pérdida de dientes.

Las bacterias implicadas, especialmente Porphyromonas gingivalis, y las moléculas inflamatorias que el sistema inmunitario libera al intentar combatirlas pueden viajar por la sangre y alcanzar órganos distantes, como el cerebro. Allí pueden contribuir a procesos inflamatorios y al desarrollo o progresión de enfermedades neurodegenerativas como el alzhéimer.

De hecho, varios estudios recientes refuerzan la hipótesis de esa conexión. En modelos animales, la exposición prolongada a toxinas de bacterias como Porphyromonas gingivalis ha inducido neuroinflamación, acumulación de proteína beta-amiloide y deterioro de la memoria, tres características típicas del alzhéimer.

En humanos, también se ha hallado evidencia sorprendente: la cantidad de bacterias orales en el tejido cerebral de personas fallecidas con esa patología es hasta siete veces mayor que en quienes no padecían la enfermedad.

Cepillarse: una rutina que podría proteger nuestra menteAsí pues, dedicar apenas 10 minutos al día a la higiene oral es una inversión para la salud futura. Cada vez que olvidamos cepillarnos, las bacterias se multiplican y pueden acabar en otras partes del cuerpo con efectos imprevisibles.

Cepillarse los dientes, usar hilo dental y acudir regularmente al dentista no solo cuida la sonrisa: también puede ayudar a proteger el corazón, el cerebro y, posiblemente, la memoria. El alzhéimer borra recuerdos, pero hay algo que conviene no olvidar: cuidar de nuestra boca es cuidar de nuestra mente.![]()

Sobre las autoras: Teresa Morera Herreras, Profesora agregada del Departamento de Farmacología, EHU; Ane Murueta-Goyena, Profesora Adjunta del Departamento de Neurociencia, EHU; y Unai Fernández Martín, Investigador predoctoral, EHU

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo Cuidando nuestra salud oral protegemos el cerebro se ha escrito en Cuaderno de Cultura Científica.

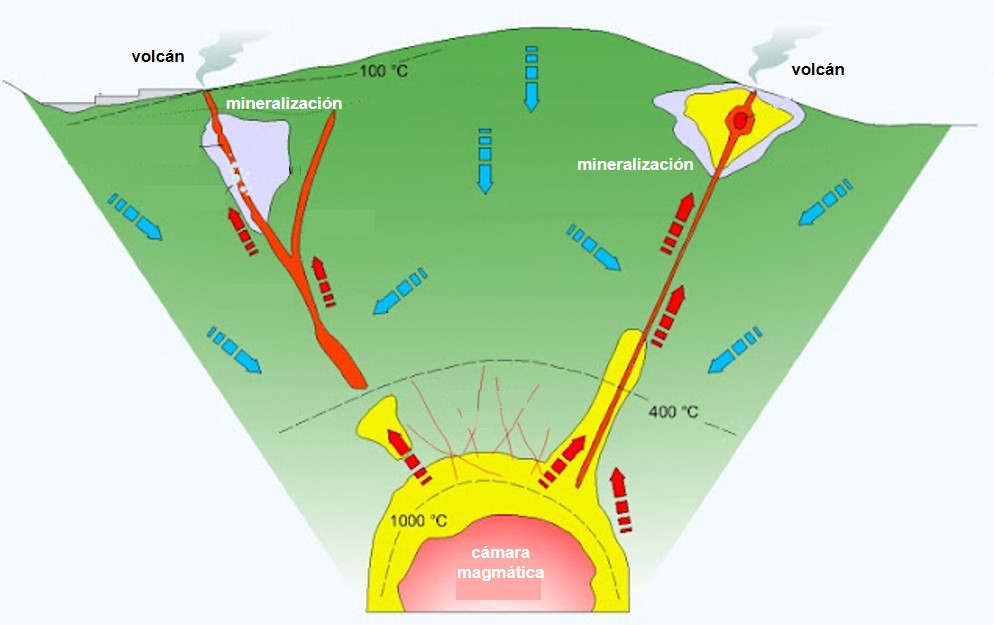

La Geología por la que pasean las ánimas

En estas fechas, aparte del maratón de películas de terror de la noche de Halloween, me encanta rememorar una fantástica historia convertida en auténtica leyenda por la pluma de Gustavo Adolfo Bécquer, y en una preciosa canción por el grupo español de folk metal Saurom, «El Monte de las Ánimas».

Esta historia nos relata que, en esa zona, siglos atrás tuvo lugar una cruenta batalla entre caballeros templarios y nobles castellanos, cuyas almas no encontraron descanso, por lo que sus espíritus vagan errantes en la Noche de Todos los Santos (que, según la versión de Bécquer, no es la noche del 31 de octubre, sino la que va del 1 al 2 de noviembre) para llevarse consigo a toda aquella persona que ose pasar por allí en ese oscuro momento. Cosa que descubre Beatriz de manera atroz al perder a Alonso tras hacerle regresar al monte por la noche. Pero, ¿sobre qué materiales geológicos caminan esos fantasmas?

Detalle de las rocas que forman el Monte de las Ánimas (Soria). Imagen de Google Street View a la altura de la antigua Área de Descanso de la N-234 (Soria Sur) a las afueras de la ciudad, tomada de Google Maps.

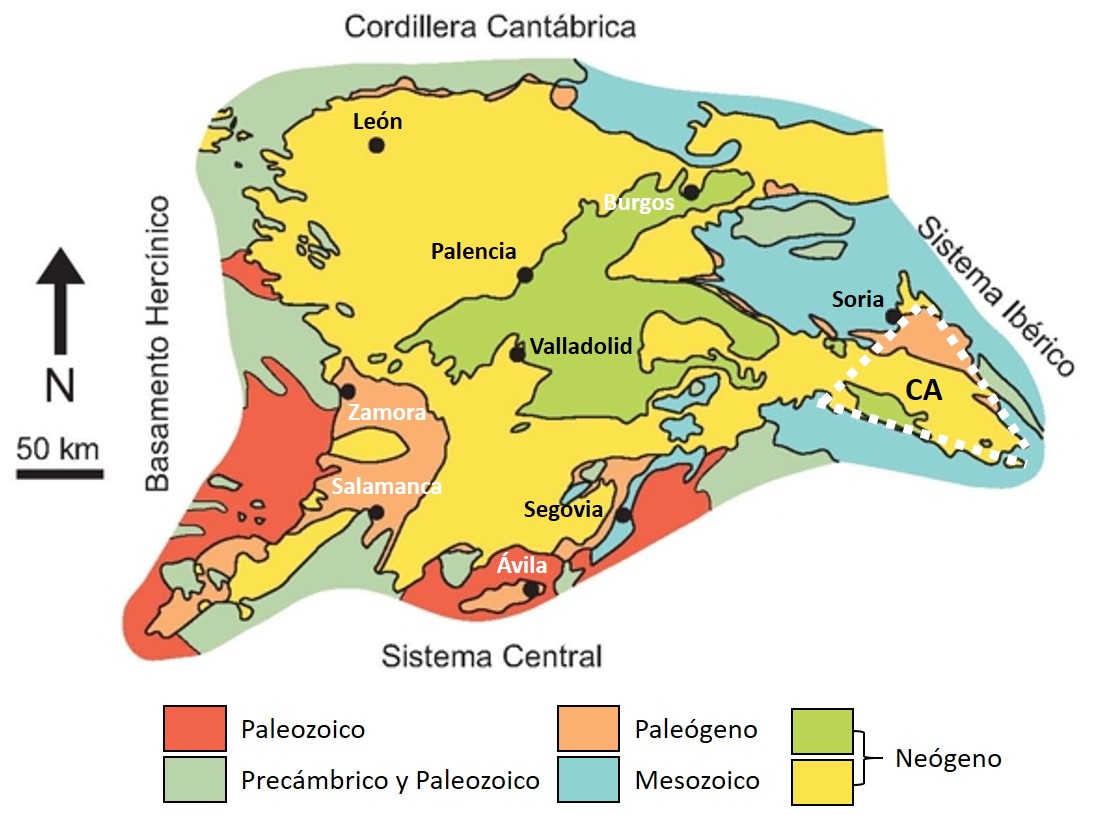

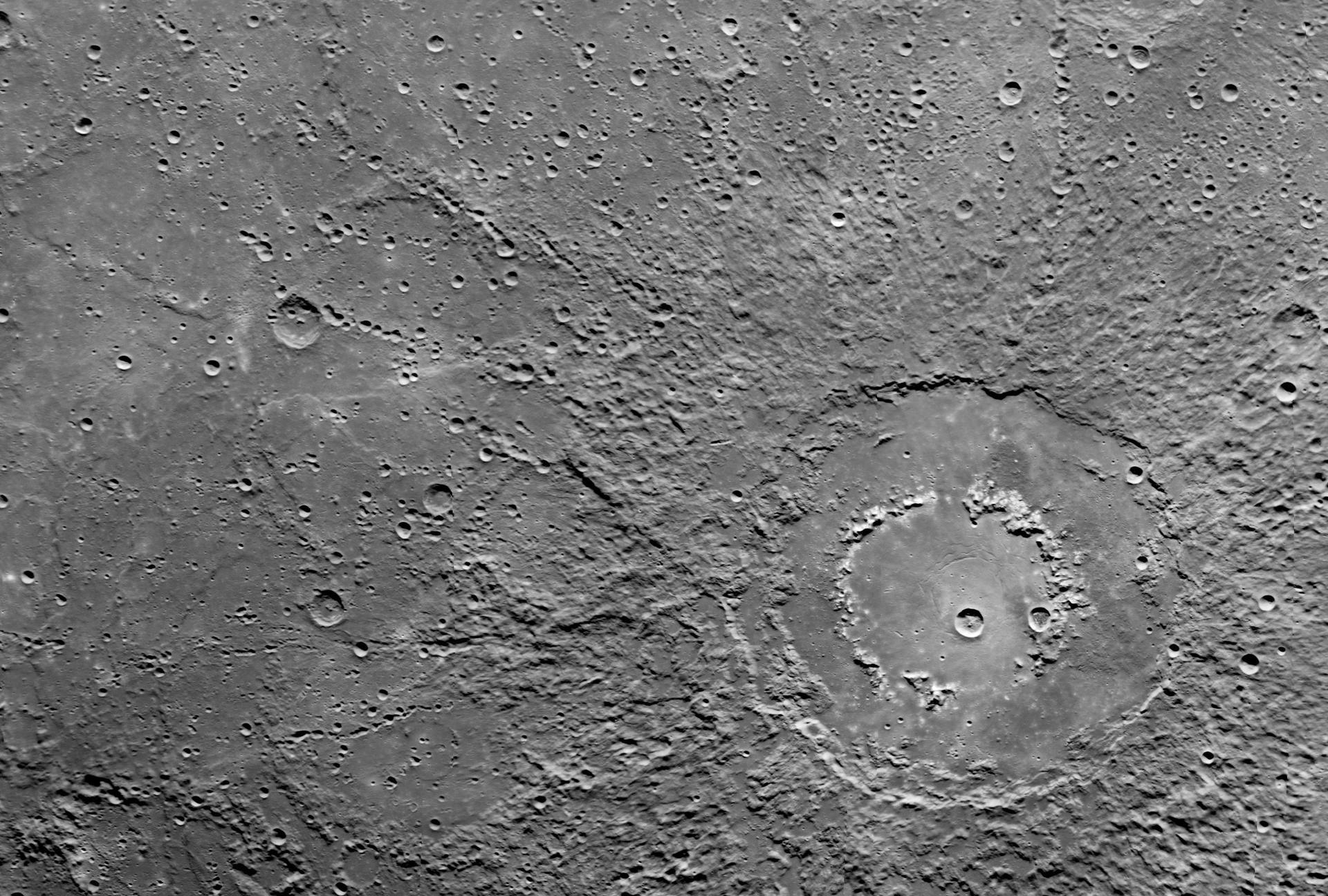

Detalle de las rocas que forman el Monte de las Ánimas (Soria). Imagen de Google Street View a la altura de la antigua Área de Descanso de la N-234 (Soria Sur) a las afueras de la ciudad, tomada de Google Maps.Si abandonamos las leyendas y nos vamos a la realidad, el monte de las Ánimas es una pequeña elevación del terreno situada a las afueras de la ciudad de Soria. Geológicamente hablando, esta zona forma parte de la denominada Cuenca de Almazán, que representa el límite oriental de la Cuenca del Duero, que abarca gran parte de la actual comunidad autónoma de Castilla y León. Y que también tiene una apasionante historia geológica.

Todo comenzó hace unos 80 millones de años, cuando la placa Ibérica chocó contra la placa Europea. Este proceso tectónico fue muy intenso en esta zona desde hace algo más de 60 millones de años hasta hace unos 40 millones de años, provocando la formación de tres grandes cadenas montañosas: el Sistema Ibérico al este, el Sistema Central al sur y la Cordillera Cantábrica al norte. El alzamiento de estas montañas dejó una zona deprimida en el centro, como si fuese una especie de cubeta, que es lo que en Geología denominamos cuenca sedimentaria.

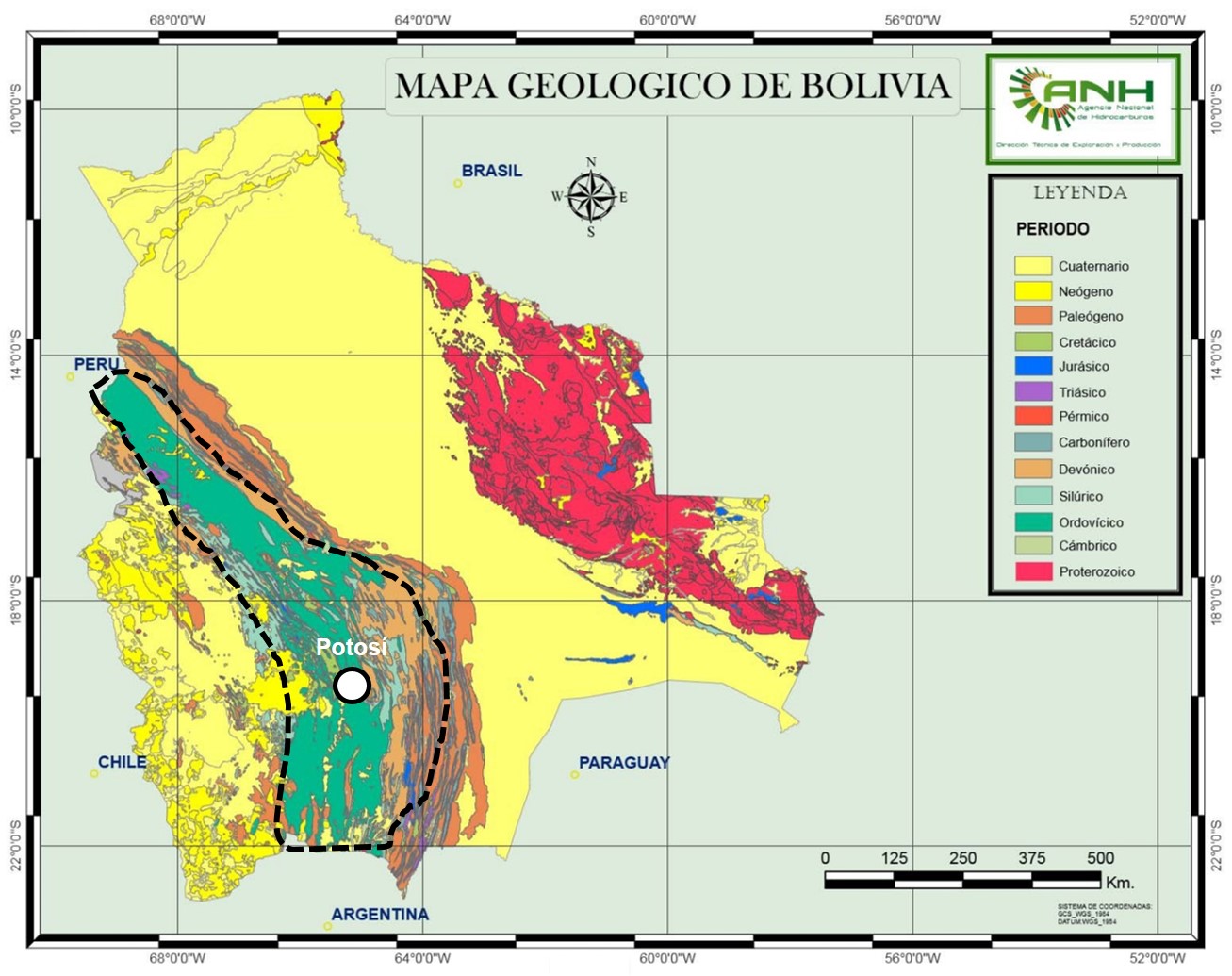

Mapa geológico simplificado de la Cuenca del Duero, donde se remarca la localización de la Cuenca de Almazán (CA). Imagen modificada de Sastre Merlín, A., Montamarta Prieto, G., de Miguel Vela, F., Vicente Lapuente, R., Alejandre Alcalde, V. y Acosta Molinero, J.A. (2025) Deza: un balcón sobre la cuenca de Almazán. Guía del Geolodía 25 Soria, 8 pp.

Mapa geológico simplificado de la Cuenca del Duero, donde se remarca la localización de la Cuenca de Almazán (CA). Imagen modificada de Sastre Merlín, A., Montamarta Prieto, G., de Miguel Vela, F., Vicente Lapuente, R., Alejandre Alcalde, V. y Acosta Molinero, J.A. (2025) Deza: un balcón sobre la cuenca de Almazán. Guía del Geolodía 25 Soria, 8 pp.La principal característica de estas cuencas sedimentarias continentales rodeadas por elevaciones montañosas es que actúan como si fuesen unas bañeras, recibiendo el agua y los materiales (barro, arena y fragmentos de rocas) transportados por los ríos y arroyos que bajan por sus laderas. Y la Cuenca de Almazán no se quedó atrás, acumulando estos aportes montañosos durante más de 20 millones de años.

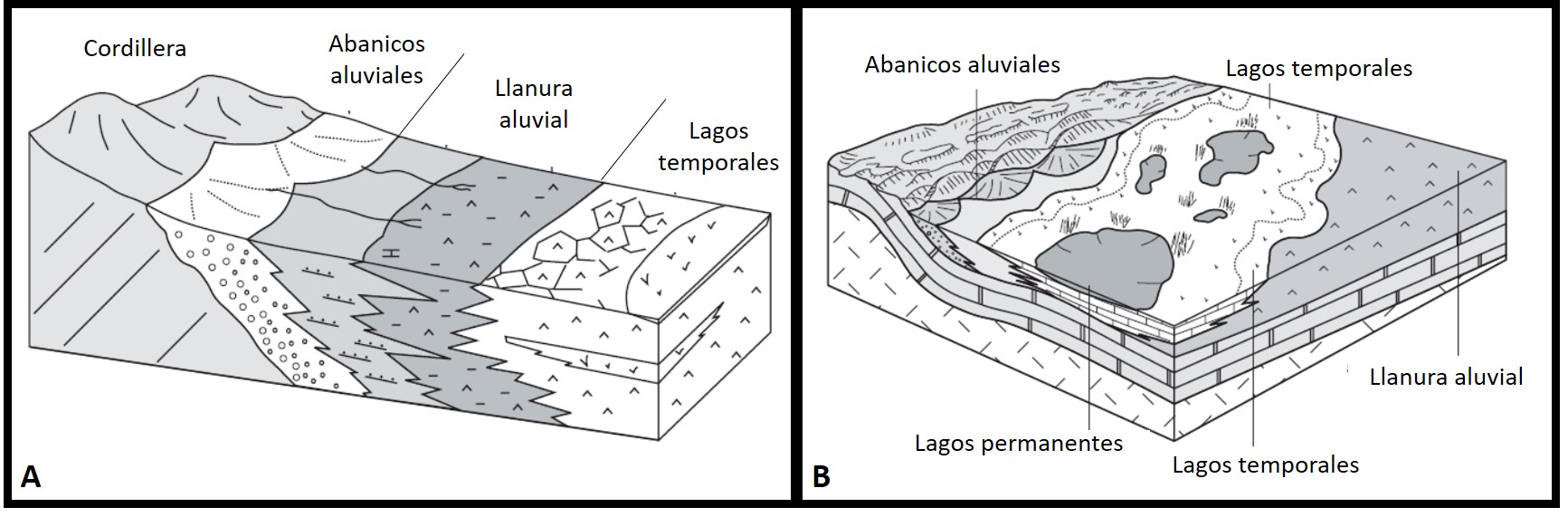

Esto provocó la formación de diferentes medios ambientes según nos alejamos de las montañas, debido a la energía que tenía el agua para poder arrastrar los materiales geológicos. Aquí es donde entran la física de fluidos y, sobre todo, la gravedad. Cuando un arroyo o riachuelo caía por la ladera de la montaña tenía una gran energía, lo que le permitía arrastrar grandes fragmentos de rocas, granos de arena de diferente tamaño y mucho barro. Pero, al llegar al pie de la ladera, cuando la pendiente disminuye, ya no tenía tanta energía, por lo que depositaba los materiales más grandes y pesados en el margen de su cauce, arrastrando sólo los sedimentos más finos hasta, finalmente, únicamente poder circular el agua casi limpia. De esta forma, junto a las laderas de las montañas se acumulaban rocas y arena de grano grueso mezcladas con barro, en unas estructuras llamadas abanicos aluviales, porque nos recuerdan a un abanico abierto si las miramos desde arriba. A su lado se formarían unas llanuras aluviales con arena más fina y arcilla y, al final, nos encontraríamos con lagos carbonatados poco profundos que, en muchas ocasiones, serían temporales.

Con el tiempo, estos sedimentos se convirtieron en diferentes tipos de rocas que, desde el pie de las laderas hasta las zonas centrales de la cuenca, serían: conglomerados y areniscas de grano grueso en los antiguos abanicos aluviales; areniscas de grano medio-fino y lutitas en las llanuras aluviales; y margas y calizas en los lagos carbonatados.

A) Zonación ambiental de una cuenca sedimentaria continental desde la cordillera hasta la zona central de la misma; y B) detalle de los ambientes sedimentarios formados en la Cuenca de Almazán. Imágenes modificadas de Huerta, P. (2006) El Paleógeno de la cuenca de Almazán. Tesis Doctoral. Universidad de Salamanca. Memoria (339 pp.), Anexo 1 y Anexo 2.

A) Zonación ambiental de una cuenca sedimentaria continental desde la cordillera hasta la zona central de la misma; y B) detalle de los ambientes sedimentarios formados en la Cuenca de Almazán. Imágenes modificadas de Huerta, P. (2006) El Paleógeno de la cuenca de Almazán. Tesis Doctoral. Universidad de Salamanca. Memoria (339 pp.), Anexo 1 y Anexo 2.Pero la historia no terminó aquí. En los últimos millones de años, el Duero fue capaz de abrirse camino hasta su desembocadura en el océano Atlántico. Siguiendo con el símil, fue como si le quitásemos el tapón a las bañeras que eran la Cuenca del Duero y su pequeño apéndice, la Cuenca de Almazán. Así, los lagos efímeros se desecaron y los arroyos y riachuelos que surgían de las montañas se convirtieron en afluentes del propio Duero, transformándose en los principales agentes de la última fase de esta historia: la erosión. Esta agua que antes depositaba sedimentos, desde entonces está robando lo que una vez poseyó, arrasando con las rocas formadas en esta zona. Pero no a todas les afecta por igual: las más resistentes, como los conglomerados, las areniscas de grano más grueso y las calizas, resisten mejor la erosión; mientras que las rocas más débiles, como las lutitas o las margas, son arrastradas sin compasión.

Entonces, ¿qué ha pasado con el Monte de las Ánimas? Pues se trata de antiguos abanicos aluviales que transportaban agua, cantos, arena y barro procedentes de las montañas situadas justo al norte de Soria. Hoy en día, esas rocas soportan el embate del agua de lluvia resistiéndose a la erosión con mayor ahínco que los materiales que tiene a su lado, por lo que permanece en pie como una pequeña elevación que vigila la ciudad.

Así que, volviendo a la pregunta del inicio, los templarios y caballeros castellanos que visiten nuestro mundo en la noche de difuntos, caminarán sobre conglomerados, areniscas y arcillas de hace unos 20 millones de años. Pero si queréis ir a comprobarlo, os recomiendo que esperéis a que sea de día, por si acaso. Y recordad ataos bien al hombro la banda de color azul, no vaya a ser que la perdáis durante vuestro paseo…

Agradecimientos:

Quiero dar las gracias a mi colega Jone Mendicoa por darme la idea para este artículo después de una interesante conversación sobre literatura y música camino a un concierto.

Sobre la autora: Blanca María Martínez es doctora en geología, investigadora de la Sociedad de Ciencias Aranzadi y colaboradora externa del departamento de Geología de la Facultad de Ciencia y Tecnología de la EHU

El artículo La Geología por la que pasean las ánimas se ha escrito en Cuaderno de Cultura Científica.

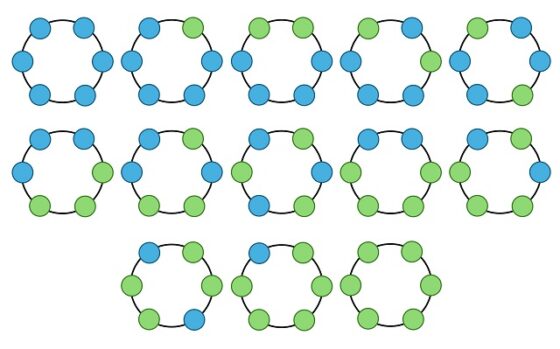

Una apuesta engañosa

A Julene, como buena bilbaína, le encanta hacer apuestas.

Está en clase de geografía, un tanto aburrida, escuchando al profesor López que está explicando el funcionamiento de las redes hidrográficas terrestres. Para intentar vencer la apatía, propone a su compañero de pupitre, Mikel, apostar sobre los números que va a mencionar el docente a lo largo de su lección. Así, Julene invita a Mikel a apostar diez euros en un juego que tratará sobre los siguientes nueve números que mencionará el profesor, números que hacen referencia a longitudes (en kilómetros) de ríos u otras corrientes fluviales.

Fuente: FreepikJulene propone las reglas del juego a Mikel

Fuente: FreepikJulene propone las reglas del juego a Mikel

Julene comenta los términos de la apuesta a Mikel:

Te propongo tener en cuenta únicamente la primera cifra significativa de las longitudes de los cursos de agua que mencione el profesor. Yo me quedaré con el conjunto de las tres primeras cifras A = {1, 2, 3} y tú con el conjunto de las otras seis cifras B = {4, 5, 6, 7, 8, 9}. Ganará, y recibirá los diez euros del otro, quien tenga en su conjunto la primera cifra que haya aparecido con mayor frecuencia en la lección.

Para aclarar su propuesta, Julene continúa argumentando para convencer a Mikel de que está siendo generosa con él:

Si las nueve longitudes mencionadas son, por ejemplo, 243 km, 876 km, 1222 km, 92 km, 4330 km, 982 km, 3445 km, 2122 km y 832 km (cuyos primeros dígitos son 2, 8, 1, 9, 4, 9, 3, 2 y 8), tú ganarías porque en el anterior listado de primeros dígitos hay cinco números del conjunto B, el tuyo, y sólo cuatro del conjunto A, el mío.

Julene es una jugadora astuta y, con su propuesta de juego y el ejemplo que hábilmente ha expuesto, ha conseguido que Mikel crea que es sencillo para él ganar los diez euros de la apuesta. Al fin y al cabo, el conjunto que le corresponde (el conjunto B) tiene seis dígitos y el de Julene (el conjunto A) solo posee tres. Así que, convencido de que tiene muchas posibilidades de ganar los diez euros, Mikel acepta el juego de Julene.

Pero se equivoca; de hecho, Julene tiene una mayor probabilidad de ganar. ¿Cómo puede ser esto cierto?

Con las reglas de Julene, a Mikel no le conviene jugarEfectivamente, Julene ha conseguido embaucar a Mikel; con sus reglas, ella sabe que tiene bastantes probabilidades de quedarse con los diez euros de su compañero.

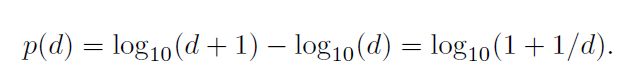

La explicación de la ventaja de Julene en este juego tiene que ver con la llamada ley de Benford (o ley del primer dígito) que se refiere a una distribución de frecuencia estadística observada empíricamente en muchas fuentes de datos numéricos (como en el caso de la medida de la longitud de ríos). Esta ley dice que la cifra 1 aparece en primera posición con mucha mayor frecuencia que el resto de los números. Además, según crece el primer dígito, es menos probable que se encuentre en la primera posición.

La ley de Benford establece que la probabilidad de que un número obtenido de un determinado dato comience con el dígito d es de:

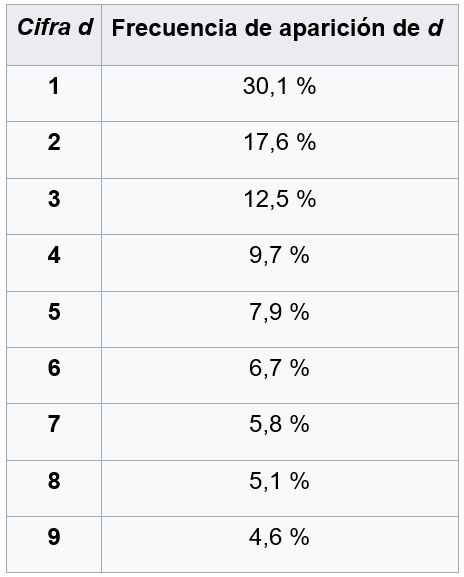

En la práctica, la frecuencia de aparición de cada número es de:

Si la apuesta consistiera en jugar con un único número, Julene ganaría con una probabilidad de a = p(1) + p(2) + p(3) = 0,602 (0,301 + 0,176 + 0,125 = 0,602). Por lo tanto, Mikel ganaría con una probabilidad de b = 1 – a = 0,398.

Pero la apuesta tiene en cuenta nueve números, no solo uno. Así, la probabilidad de que Julene gane es la probabilidad de que, entre los nueve números que mencionará el profesor durante su clase, haya al menos cinco (cinco, seis, siete, ocho o nueve números) pertenecientes al conjunto A = {1, 2, 3}. Dicho de otro modo, de los números significativos mencionados por el docente, como mucho cuatro pertenecerán al conjunto B = {4, 5, 6, 7, 8, 9} asignado a Mikel, que perdería así la apuesta.

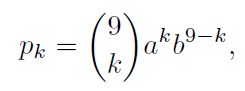

La probabilidad de que haya k números de A = {1, 2, 3} entre los nueve números utilizados por el profesor (probabilidad de k éxitos en una repetición de 9 experimentos) es de:

que involucra un coeficiente binomial (cantidad de subconjuntos de k elementos escogidos de un conjunto de 9 elementos).

Así, la probabilidad de que Julene gane es de:

Tras hacer las operaciones indicadas en la anterior fórmula, el resultado es de 0,738. Así, Mikel tiene pocas probabilidades de ganar (1 – 0,738 = 0,262), y muchas de perder los diez euros de la apuesta… ¡Su compañera Julene “se la ha jugado”!

Nota

Adaptado de: Jean-Paul Delahaye, Rubrique des paradoxes précédents : La longueur des fleuves, Accromath 20.2 été-automne 2025

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y editora de Mujeres con Ciencia

El artículo Una apuesta engañosa se ha escrito en Cuaderno de Cultura Científica.

La teoría de juegos de cómo los algoritmos pueden hacer subir los precios

Estudios recientes revelan que incluso los algoritmos de fijación de precios más simples pueden encarecer las cosas.

Un artículo de Ben Brubaker. Historia original reimpresa con permiso de Quanta Magazine, una publicación editorialmente independiente respaldada por la Fundación Simons.

Ilustración: Nash Weerasekera / Quanta Magazine

Ilustración: Nash Weerasekera / Quanta MagazineImagina un pueblo con dos comerciantes de utensilios. Los clientes prefieren el utensilio más barato, así que los comerciantes compiten fijando precios bajos. Descontentos con sus escasas ganancias, se reúnen una noche en una taberna llena de humo para discutir un plan secreto: si suben los precios juntos en lugar de competir, ambos podrían ganar más. Pero ese tipo de acuerdo intencionado sobre precios, llamado colusión, lleva más de un siglo prohibido. Los comerciantes deciden no arriesgarse y todo el mundo sigue disfrutando de utensilios baratos.

Durante más de un siglo, la legislación estadounidense ha seguido este esquema básico: prohibir esos tratos a puerta cerrada y con ello preservar unos precios justos. Hoy no es tan sencillo. En amplios sectores de la economía los vendedores dependen cada vez más de programas informáticos llamados algoritmos de aprendizaje, que ajustan los precios de forma iterada en función de nuevos datos sobre el mercado. A menudo son mucho más simples que los algoritmos de “aprendizaje profundo” que impulsa la inteligencia artificial moderna, pero aun así pueden comportarse de formas inesperadas.

Entonces, ¿cómo pueden los reguladores garantizar que los algoritmos fijan precios justos? Su enfoque tradicional no servirá, porque se basa en encontrar una colusión explícita. “Los algoritmos desde luego no se están tomando copas juntos”, apunta Aaron Roth, científico informático de la Universidad de Pennsylvania.

Sin embargo, un artículo muy citado de 2019 mostró que los algoritmos podían aprender a coludir de forma tácita, incluso cuando no estaban programados para ello. Un equipo de investigadores enfrentó dos copias de un algoritmo de aprendizaje simple en un mercado simulado y les dejó explorar distintas estrategias para aumentar sus beneficios. Con el tiempo, cada algoritmo aprendió por ensayo y error a castigar cuando el otro bajaba los precios: respondía reduciendo su propio precio en una cuantía enorme y desproporcionada. El resultado final fue precios elevados, sostenidos por la amenaza mutua de una guerra de precios.

Aaron Roth sospecha que los problemas de la fijación de precios algorítmica podrían no tener una solución sencilla. «La conclusión de nuestro estudio es que resulta difícil determinar qué descartar», afirma. Foto cortesía de Aaron Roth

Aaron Roth sospecha que los problemas de la fijación de precios algorítmica podrían no tener una solución sencilla. «La conclusión de nuestro estudio es que resulta difícil determinar qué descartar», afirma. Foto cortesía de Aaron RothLas amenazas implícitas como esta también están en la base de muchos casos de colusión humana. Así que, si quieres garantizar precios justos, ¿por qué no exigir que los vendedores utilicen algoritmos incapaces de hacer amenazas?

En un trabajo reciente, Roth y otros cuatro científicos informáticos mostraron por qué eso puede no ser suficiente. Probaron que incluso algoritmos aparentemente benignos que optimizan su propio beneficio pueden a veces dar lugar a resultados perjudiciales para los compradores. “Aun así puedes obtener precios altos de maneras que, desde fuera, parecen razonables”, explica Natalie Collina, estudiante de posgrado que trabaja con Roth y coautora del nuevo estudio.

No todos los investigadores coinciden en las implicaciones del hallazgo —mucho depende de cómo se defina “razonable”—. Pero la investigación revela lo sutiles que pueden ser las cuestiones sobre fijación algorítmica de precios y lo difícil que puede resultar regularlas.

“Sin alguna sospecha de amenaza o de un acuerdo, es muy difícil que un regulador pueda entrar y decir: ‘Estos precios no parecen correctos’”, afirma Mallesh Pai, economista de la Universidad Rice. “Por eso creo que este artículo es importante.”

Sin arrepentimiento

El trabajo reciente estudia la fijación algorítmica de precios desde la óptica de la teoría de juegos, un campo interdisciplinar en la frontera entre la economía y la informática que analiza las matemáticas de las competiciones estratégicas. Es una forma de explorar los errores de los algoritmos de precios en un entorno controlado.

“Lo que intentamos hacer es crear colusión en el laboratorio”, explica Joseph Harrington, economista de la Universidad de Pennsylvania que escribió un influyente artículo de revisión sobre la regulación de la colusión algorítmica y que no ha participado en la nueva investigación. “Una vez que lo hacemos, queremos averiguar cómo destruir esa colusión.”

Natalie Collina y sus colegas han descubierto que los precios altos pueden surgir de maneras inesperadas. Foto: Nandan Tumu

Natalie Collina y sus colegas han descubierto que los precios altos pueden surgir de maneras inesperadas. Foto: Nandan TumuPara entender las ideas clave conviene empezar con el simple juego de piedra-papel-tijera. Un algoritmo de aprendizaje, en este contexto, puede ser cualquier estrategia que un jugador use para elegir una jugada en cada ronda basándose en los datos de rondas anteriores. Los jugadores pueden probar distintas estrategias a lo largo del juego. Pero si juegan bien, acabarán convergiendo a un estado que los teóricos de juegos llaman equilibrio. En equilibrio, la estrategia de cada jugador es la mejor respuesta posible a la estrategia del otro, por lo que ninguno tiene incentivo a cambiar.

En piedra-papel-tijera, la estrategia ideal es sencilla: hay que jugar una jugada aleatoria cada ronda, escogiendo las tres posibilidades con la misma frecuencia. Los algoritmos de aprendizaje destacan cuando un jugador adopta un enfoque distinto. En ese caso, elegir jugadas en función de rondas anteriores puede ayudar al otro jugador a ganar más a menudo que si jugara al azar.

Supón, por ejemplo, que tras muchas rondas detectas que tu oponente —un geólogo— eligió piedra más del 50% de las veces. Si hubieras jugado papel cada ronda, habrías ganado más. Los teóricos de juegos se refieren a esta dolorosa constatación como arrepentimiento.

Los investigadores han diseñado algoritmos de aprendizaje sencillos que garantizan siempre que acabarás con arrepentimiento cero. Algoritmos de aprendizaje algo más sofisticados, llamados algoritmos “sin arrepentimiento por intercambio” (no-swap-regret), también garantizan que cualquiera que sea la acción de tu oponente, no podrías haberlo hecho mejor sustituyendo todas las ocurrencias de una jugada por otra (por ejemplo, jugando papel cada vez que en realidad jugaste tijera). En 2000, teóricos de juegos demostraron que, si enfrentas dos algoritmos sin arrepentimiento por intercambio en cualquier juego, acabarán en un tipo específico de equilibrio —uno que sería el equilibrio óptimo si solo jugaran una única ronda. Esa propiedad es atractiva porque los juegos de una sola ronda son mucho más simples que los de varias rondas. En particular porque las amenazas no funcionan ya que los jugadores no pueden ejecutarlas.

En un artículo de 2024, Jason Hartline, informático de la Universidad Northwestern, y dos estudiantes de posgrado tradujeron los resultados clásicos de 2000 a un modelo de mercado competitivo, donde los jugadores pueden fijar precios nuevos cada ronda. En ese contexto, los resultados implicaban que dos algoritmos sin arrepentimiento por intercambio se acabarían encontrando en precios competitivos cuando alcanzaran el equilibrio. La colusión sería imposible.

Sin embargo, los algoritmos sin arrepentimiento por intercambio no son las únicas estrategias de fijación de precios en los mercados en línea. ¿Qué ocurre cuando un algoritmo sin arrepentimiento por intercambio se enfrenta a un oponente distinto que también parece benigno?

El precio está equivocado

Según los teóricos de juegos, la mejor estrategia para jugar contra un algoritmo sin arrepentimiento por intercambio es simple: empieza con una probabilidad concreta para cada posible acción y, luego, en cada ronda elige una sola acción al azar, sin importar lo que haga tu oponente. La asignación ideal de probabilidades para este enfoque “no reactivo” depende del juego específico.

En el verano de 2024, Collina y su colega Eshwar Arunachaleswaran se propusieron encontrar esas probabilidades óptimas para un juego de fijación de precios entre dos jugadores. Hallaron que la mejor estrategia asignaba probabilidades sorprendentemente altas a precios muy elevados, junto con probabilidades menores distribuidas en una amplia gama de precios bajos. Si juegas contra un algoritmo sin arrepentimiento por intercambio, esta extraña estrategia maximizará tu beneficio. “Para mí fue una sorpresa total”, cuenta Arunachaleswaran.

Eshwar Arunachaleswaran y Collina obtuvieron su resultado al explorar las mejores respuestas a algoritmos de precios bien definidos. Foto: Paritosh Verma

Eshwar Arunachaleswaran y Collina obtuvieron su resultado al explorar las mejores respuestas a algoritmos de precios bien definidos. Foto: Paritosh VermaLas estrategias no reactivas parecen superficialmente inocuas. No pueden transmitir amenazas, porque no reaccionan a las jugadas del rival en absoluto. Pero pueden inducir a los algoritmos de aprendizaje a subir sus precios, y luego aprovecharse ocasionalmente vendiendo más barato que el competidor.

Al principio, Collina y Arunachaleswaran pensaron que este escenario artificial no sería relevante en el mundo real. Seguro que el jugador que usara el algoritmo sin arrepentimiento por intercambio cambiaría a otro algoritmo en cuanto se diera cuenta de que su competidor estaba obteniendo beneficios a su costa.

Pero al profundizar y al discutirlo con Roth y otros dos colegas, se dieron cuenta de que su intuición era errónea. Los dos jugadores en su escenario ya estaban en un estado de equilibrio. Sus beneficios eran casi iguales, y ambos eran tan altos como podían ser siempre que ninguno cambiara de algoritmo. Ninguno tenía incentivo a cambiar de estrategia, así que los compradores se quedarían atrapados con precios altos. Además, las probabilidades precisas no eran tan importantes. Muchas elecciones distintas conducían a precios elevados cuando se enfrentaban a un algoritmo sin arrepentimiento por intercambio. Es un resultado que cabría esperar de una colusión, pero sin que se viera ningún comportamiento colusorio.

Conviene ser tonto

¿Y qué pueden hacer los reguladores? Roth admite que no tiene respuesta. No tendría sentido prohibir los algoritmos sin arrepentimiento por intercambio: si todos usaran uno, los precios caerían. Pero una simple estrategia no reactiva podría ser una elección natural para un vendedor en un mercado en línea como Amazon, aunque conlleve el riesgo de arrepentimiento.

“Una forma de tener arrepentimiento es simplemente ser un poco tonto”, afirma Roth. “Históricamente, eso no ha sido ilegal.”

Para Hartline, el problema de la colusión algorítmica tiene una solución simple: prohibir todos los algoritmos de fijación de precios excepto los algoritmos sin arrepentimiento por intercambio que los teóricos de juegos han venido recomendando. Puede haber formas prácticas de hacerlo: en su trabajo de 2024, Hartline y sus colegas idearon un método para comprobar si un algoritmo tiene la propiedad de sin arrepentimiento por intercambio sin mirar su código.

Hartline reconoció que su solución preferida no evitaría todos los malos resultados cuando algoritmos sin arrepentimiento por intercambio compitieran con humanos. Pero sostiene que escenarios como el del trabajo de Roth no son casos de colusión algorítmica.

“La colusión es algo de doble vía”, dijo. “Fundamentalmente debe ser posible que un único jugador haga algo para no coludir.”

Sea como fuere, el nuevo trabajo deja muchas preguntas abiertas sobre cómo puede fallar la fijación de precios algorítmica en el mundo real.

“Aún no entendemos ni de lejos todo lo que quisiéramos”, dico Pai. “Es una cuestión importante para nuestro tiempo.”

El artículo original, The Game Theory of How Algorithms Can Drive Up Prices, se publicó el 22 de octubre de 2025 en Quanta Magazine.

Traducido por César Tomé López

El artículo La teoría de juegos de cómo los algoritmos pueden hacer subir los precios se ha escrito en Cuaderno de Cultura Científica.

Atracción (electroestática) fatal

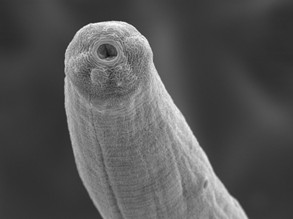

En una entrega anterior de esta sección describíamos la curiosa estrategia del nematodo Caenorhabditis elegans para dispersarse en el medio. Estos pequeños gusanos forman torres para salvar espacios y, eventualmente, adherirse a insectos que los transporten a otros lugares. Parecía difícil superar esto, pero otro nematodo, Steinernema carpocapsae (Figura 1), acaba de proporcionarnos un caso aún más sorprendente. Con una longitud máxima de medio milímetro, este minúsculo gusano es capaz de saltar a una distancia superior a veinte veces su longitud corporal, con una velocidad inicial de 1.5 m/s, y adherirse a un insecto al que matará y consumirá. Si a esto le añadimos que rara vez falla en su objetivo, nos tenemos que preguntar cómo un animal, tan limitado en lo sensorial como en lo motor, tiene tanta puntería. Y la respuesta, totalmente inesperada, radica en la electroestática.

Figura 1. El nematodo Steinernema carpocapsae, individuo juvenil en fase infectiva. De Lu et al. (2017), doi: 10.1371/journal.ppat.1006302, CC BY 4.0.

Figura 1. El nematodo Steinernema carpocapsae, individuo juvenil en fase infectiva. De Lu et al. (2017), doi: 10.1371/journal.ppat.1006302, CC BY 4.0.La electricidad estática está presente en muchos fenómenos biológicos. Los insectos voladores, por ejemplo, suelen cargarse positivamente por el roce con partículas presentes en el aire. De esta forma se facilita la recolección de polen por abejas, mariposas o colibrís. Eso sí, la carga eléctrica positiva de los insectos voladores aumenta su riesgo de enredarse en telarañas. La electricidad estática también está implicada en el vuelo de arañas, en ocasiones a cientos de kilómetros de distancia. Los filamentos de seda emitidos por estas arañas y cargados negativamente son atraídos por cargas eléctricas positivas en la atmósfera, como podemos ver en este vídeo.

Volvamos a S. carpocapsae. Este nematodo ha sido comercializado debido a su utilidad en la lucha biológica contra plagas de insectos. Cincuenta millones de gusanos pueden adquirirse en el mercado fitosanitario por unos 20 euros. A pesar de su pequeño tamaño, S. carpocapsae mata rápidamente (en 24-48 horas) a los insectos a los que ataca. Esta letalidad se debe a dos factores. Por un lado, transporta en su intestino bacterias simbióticas del género Photorhabdus o Xenorhabdus. Cuando el gusano penetra en su víctima, las bacterias son liberadas y proliferan rápidamente, produciendo toxinas y enzimas que degradan los tejidos del insecto. Al mismo tiempo, el nematodo produce otras sustancias tóxicas y supresoras del sistema inmune del insecto, que no puede defenderse de la infección bacteriana. Para completar el trabajo, las bacterias también segregan antibióticos que evitan la competencia de otras bacterias.

A estas alturas el insecto ha sido ya atacado por otros nematodos de la misma especie, que pasan de un estadio juvenil (el único de vida libre) a adultos de ambos sexos. Se aparean, ponen huevos y mantienen el ciclo hasta que el insecto ha sido completamente consumido. En ese momento los juveniles vuelven a asociarse con las bacterias (que solo pueden vivir en simbiosis con S. carpocapsae) y abandonan el cadáver para buscar otra víctima.

La pregunta que nos hacíamos al principio es, ¿cómo este pequeño gusano es capaz de saltar y adherirse a un insecto volador con precisión? La sorprendente respuesta acaba de aparecer en un artículo publicado en PNAS por investigadores estadounidenses. Es el propio insecto el que atrae al nematodo a causa de su carga eléctrica positiva, como vemos en este video.

Los experimentos se realizaron con moscas del vinagre conectadas a un filamento de cobre para proporcionarles carga eléctrica positiva (Figura 2A-C). De acuerdo con las medidas tomadas en insectos voladores, estas cargas suelen estar entre 10 y 200 picoculombios (pC), lo que equivale a voltajes entre 50 y 1000 voltios. En todos los experimentos, los nematodos saltarines aterrizaron sobre el insecto. Lo mismo sucedió cuando el insecto fue reemplazado por una bola metálica con la misma carga eléctrica.

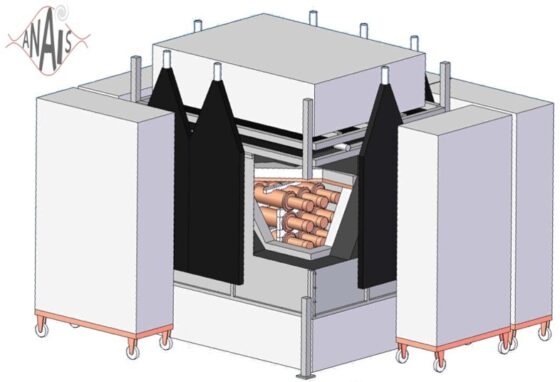

Figura 2. A: Trayectoria del nematodo Steinernema carpocapsae. Tras el salto es atraído hacia la mosca, cargada positivamente. B: El nematodo se dobla como un resorte antes de saltar. C: Trayectoria registrada en 19 individuos, partiendo de dos alturas diferentes. Todos ellos impactan contra el insecto, independientemente de la dirección del salto. Los colores indican la velocidad en m/s. D: Modelo numérico basado en las observaciones anteriores (velocidad y dirección), pero asignando carga neutra a los gusanos. Solo en un caso se logra el contacto con el insecto. Los colores indican diferentes voltajes para la mosca, entre 100 y 700 V. E: Carga del nematodo por inducción. El insecto cargado positivamente polariza al gusano atrayendo cargas negativas. El sustrato actúa como toma de tierra y proporciona electrones que neutralizan las cargas positivas. Cuando el nematodo salta, su carga es negativa y es atraído hacia el insecto. Fuente: Ran et al. (2025), cita completa en referencias, CC BY 4.0.

Figura 2. A: Trayectoria del nematodo Steinernema carpocapsae. Tras el salto es atraído hacia la mosca, cargada positivamente. B: El nematodo se dobla como un resorte antes de saltar. C: Trayectoria registrada en 19 individuos, partiendo de dos alturas diferentes. Todos ellos impactan contra el insecto, independientemente de la dirección del salto. Los colores indican la velocidad en m/s. D: Modelo numérico basado en las observaciones anteriores (velocidad y dirección), pero asignando carga neutra a los gusanos. Solo en un caso se logra el contacto con el insecto. Los colores indican diferentes voltajes para la mosca, entre 100 y 700 V. E: Carga del nematodo por inducción. El insecto cargado positivamente polariza al gusano atrayendo cargas negativas. El sustrato actúa como toma de tierra y proporciona electrones que neutralizan las cargas positivas. Cuando el nematodo salta, su carga es negativa y es atraído hacia el insecto. Fuente: Ran et al. (2025), cita completa en referencias, CC BY 4.0.Para que la atracción electrostática sea eficaz, el nematodo debe tener carga eléctrica negativa, y los modelos numéricos mostraron que, en efecto, esta carga está alrededor de 0.1 pC. ¿Cómo se genera esta carga? La hipótesis más probable es que se deba a la inducción (Figura 2E). Cuando el insecto cargado positivamente se acerca, atrae cargas negativas del extremo más próximo del nematodo, con lo que el extremo contrario se carga positivamente. Ese extremo está en contacto con el sustrato, que actúa como toma de tierra y proporciona electrones que cancelan las cargas positivas. Por eso, todo el gusano, cuando salta hacia su objetivo, tiene carga negativa y es atraído hacia su víctima.

La pequeñísima carga negativa adquirida por inducción es esencial. De acuerdo con los modelos numéricos, cuando se simularon las trayectorias y las velocidades de los saltos, pero se asignó una carga nula a los gusanos, solo uno de los 19 intentos terminó con éxito (Figura 2D).

Resulta paradójico que la misma carga positiva que resulta útil, por ejemplo, para la recogida de polen, pueda ser fatal al atraer a nematodos parásitos. En cualquier caso, este descubrimiento ilustra la importancia de comprender mejor los fenómenos eléctricos en las interacciones animales.

Referencias

Ran, R., Burton, J.C., Kumar, S. et al. (2025). Electrostatics facilitate midair host attachment in parasitic jumping nematodes, Proc. Natl. Acad. Sci. U.S.A. doi: 10.1073/pnas.2503555122.

Sobre el autor: Ramón Muñoz-Chápuli Oriol es Catedrático de Biología Animal (jubilado) de la Universidad de Málaga.

El artículo Atracción (electroestática) fatal se ha escrito en Cuaderno de Cultura Científica.

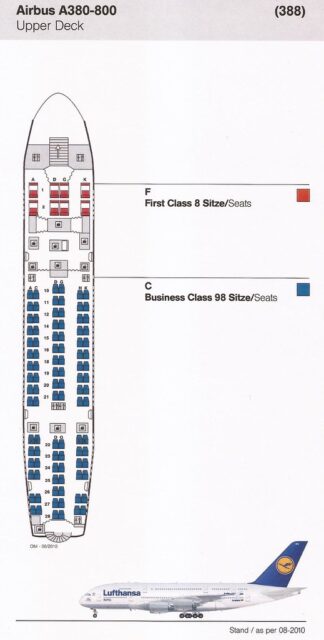

Nuestros ojos saben lo que hicimos el último verano

Foto: Eugene Golovesov en Unsplash

Foto: Eugene Golovesov en Unsplash

La miopía avanza de forma imparable en todo el mundo. Según la Organización Mundial de la Salud, para 2050 la mitad de la población mundial será miope. No se trata solo de llevar gafas: cuando esa afección visual progresa mucho, aumenta el riesgo de desprendimiento de retina, glaucoma o ceguera irreversible.

En España, por ejemplo, la ceguera miópica es la primera causa de afiliación a la ONCE. La pregunta es inevitable: ¿qué podemos hacer para frenar la epidemia?

Una “caja negra” de la exposición al solLa respuesta podría estar, literalmente, en nuestros ojos. Más en concreto, en un curioso fenómeno llamado autofluorescencia ultravioleta conjuntival (CUVAF por su denominación en inglés), que funciona como una especie de “caja negra” de la exposición solar que ha recibido cada persona.

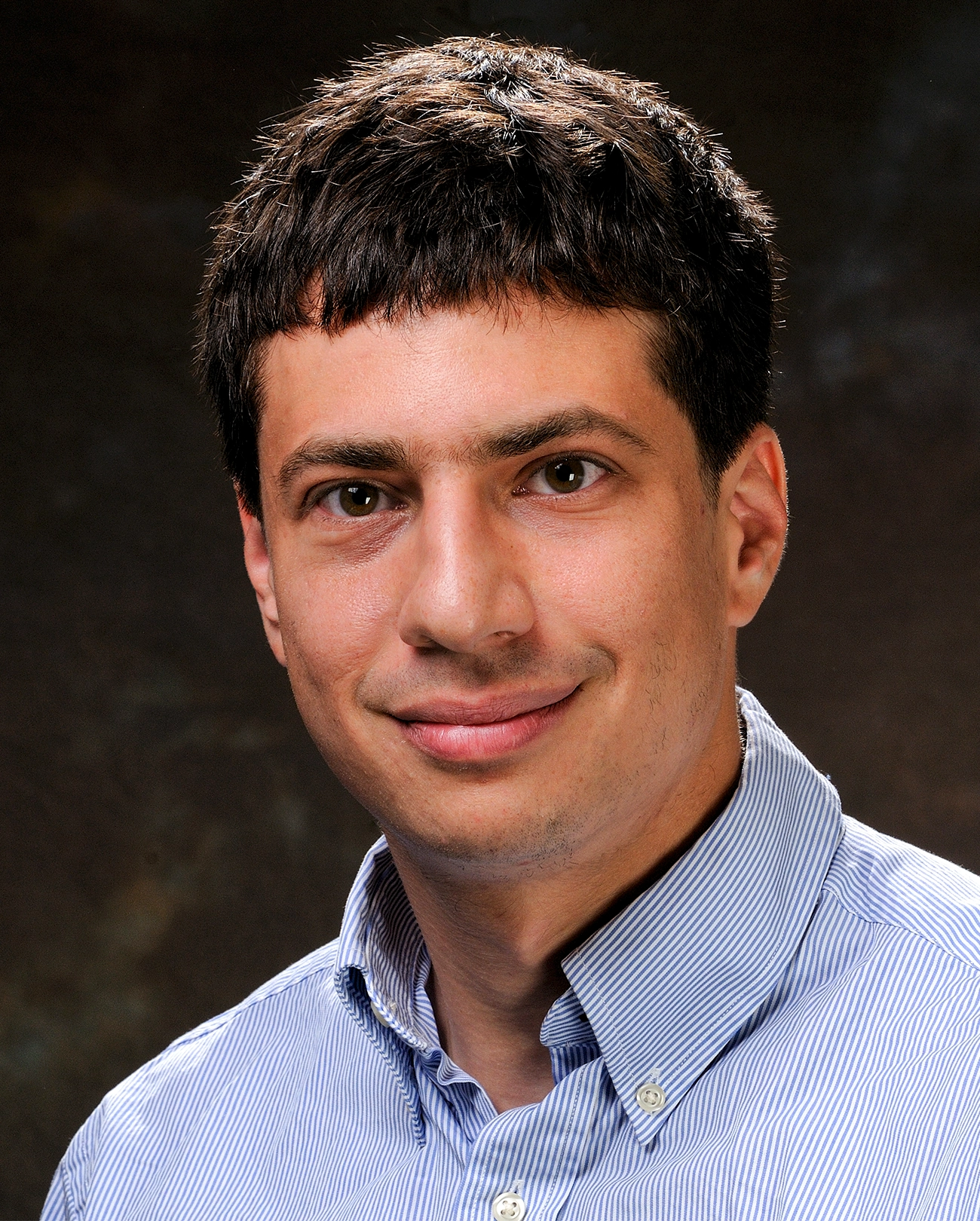

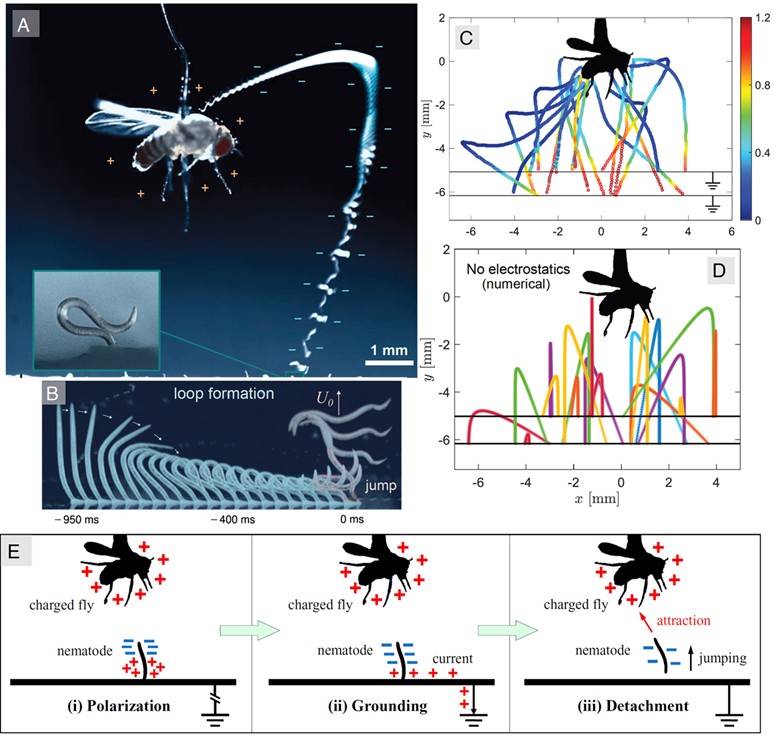

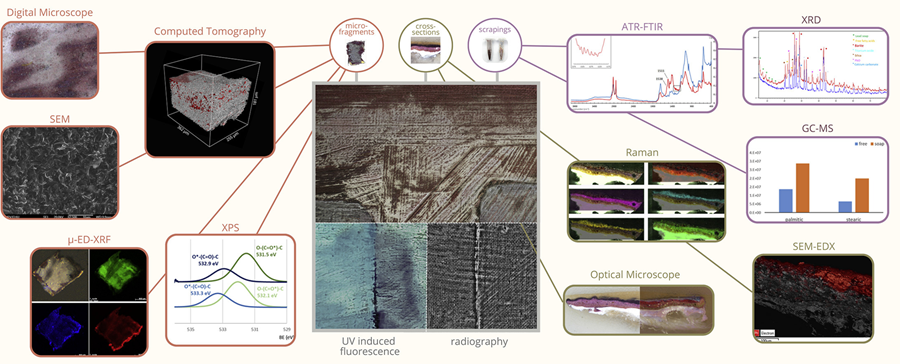

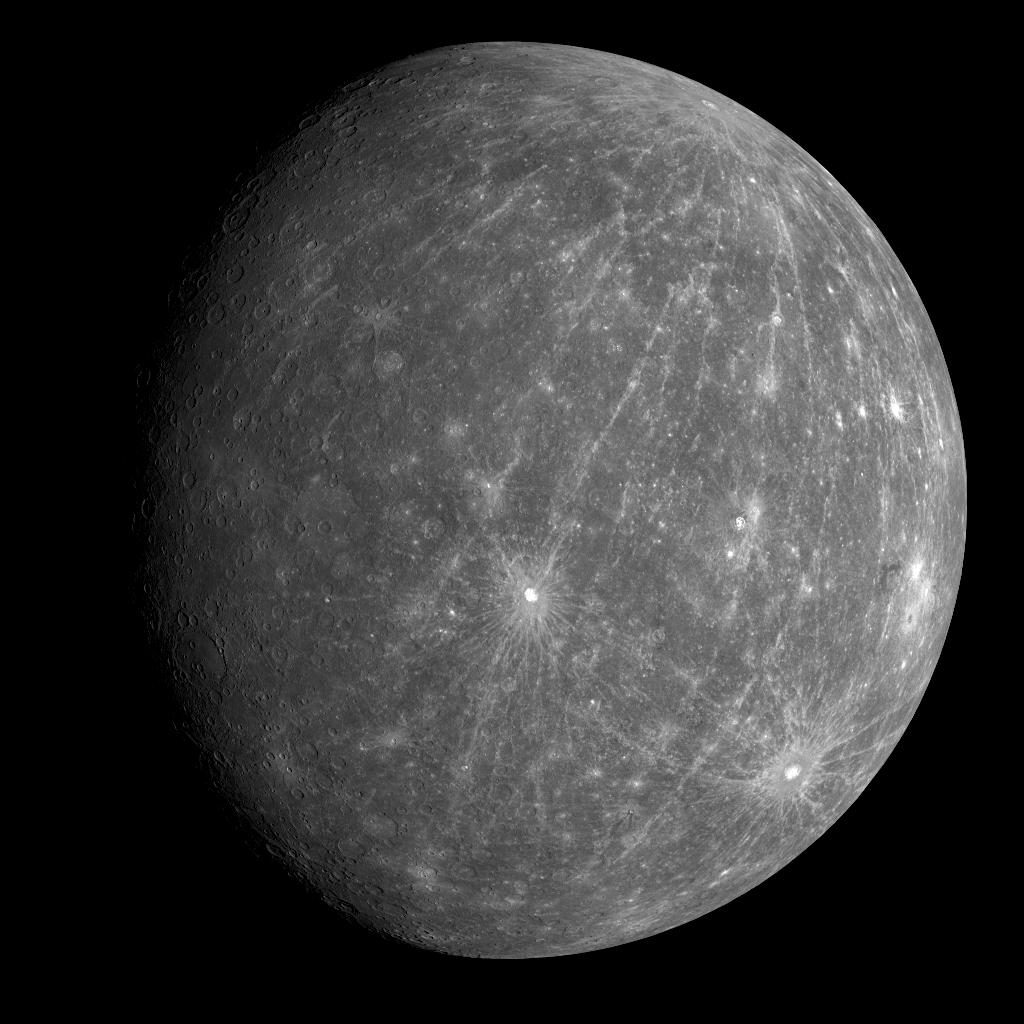

(A) Demostración ‘in vivo’ del enfoque corneal de la luz periférica proveniente del lado temporal del ojo hacia el limbo y la conjuntiva nasal, con una intensidad luminosa mayor en comparación con el lado temporal. (B) Representación óptica del efecto de enfoque de la luz periférica que provoca la concentración de los rayos incidentes, al atravesar la cámara anterior, sobre la superficie límbico-conjuntival contralateral del ojo. (C) Representación de un caso CUVAF negativo (sin área de hiperautofluorescencia conjuntival). (D–E) Fotografías CUVAF negativas tomadas bajo luz ultravioleta (D) (longitud de onda máxima de 365 nm) y (E) una fotografía tomada con el modo BAF del Heidelberg Spectralis HRA+OCT (longitud de onda máxima de 488 nm). (F) Representación de un caso CUVAF positivo (muestra un área de hiperautofluorescencia que absorbe a 360 nm y emite en el espectro visible). (G–H) Fotografías CUVAF positivas en una imagen a color tomada bajo luz ultravioleta (G) y (H) con el Heidelberg Spectralis HRA+OCT.

(A) Demostración ‘in vivo’ del enfoque corneal de la luz periférica proveniente del lado temporal del ojo hacia el limbo y la conjuntiva nasal, con una intensidad luminosa mayor en comparación con el lado temporal. (B) Representación óptica del efecto de enfoque de la luz periférica que provoca la concentración de los rayos incidentes, al atravesar la cámara anterior, sobre la superficie límbico-conjuntival contralateral del ojo. (C) Representación de un caso CUVAF negativo (sin área de hiperautofluorescencia conjuntival). (D–E) Fotografías CUVAF negativas tomadas bajo luz ultravioleta (D) (longitud de onda máxima de 365 nm) y (E) una fotografía tomada con el modo BAF del Heidelberg Spectralis HRA+OCT (longitud de onda máxima de 488 nm). (F) Representación de un caso CUVAF positivo (muestra un área de hiperautofluorescencia que absorbe a 360 nm y emite en el espectro visible). (G–H) Fotografías CUVAF positivas en una imagen a color tomada bajo luz ultravioleta (G) y (H) con el Heidelberg Spectralis HRA+OCT.El CUVAF es un área de autofluorescencia en la conjuntiva (la parte blanca del ojo) que aparece cuando se ilumina con luz ultravioleta. Entonces, el ojo muestra manchas brillantes que delatan cuánto tiempo hemos pasado bajo la luz del sol.

Aunque esas manchas no son visibles a simple vista, quedan registradas de forma objetiva. Así, el CUVAF se ha convertido en un biomarcador fiable para saber cuántas horas al aire libre ha acumulado una persona a lo largo de su vida reciente.

Los científicos llevan años sospechando que la falta de luz natural es una de las grandes culpables del aumento de la miopía. Los niños que pasan más tiempo en interiores –ya sea frente al móvil, la tableta o los libros– tienen más riesgo de desarrollarla.

¿Por qué? La hipótesis más aceptada es que la luz solar estimula la liberación del neurotransmisor dopamina en la retina, y esa dopamina actúa como freno natural para que el ojo no crezca en exceso (además de controlar ciclos circadianos, hormonas, etc).

Otra posible causa es que cuando estamos en la calle miramos principalmente de lejos, de forma relajada y sin forzar los músculos de la acomodación (necesarios para ver de cerca), lo cual evita el crecimiento excesivo del ojo. Porque cuando esto último ocurre, la imagen no se enfoca nítidamente en la retina y aparece la miopía.

De los cuestionarios a la “memoria ocular”Hasta hace poco, los investigadores solo podían medir el tiempo que pasan los niños al aire libre preguntando a los padres o a los propios menores. Pero esos cuestionarios tienen muchas limitaciones: ¿quién recuerda con exactitud cuántas horas estuvo en el parque hace un mes?

El CUVAF resuelve este problema. Funciona como un registro objetivo de la exposición solar, independiente de la memoria o la percepción. Si un niño presenta poco CUVAF, significa que pasa poco tiempo en exteriores y, por tanto, que tiene más riesgo de ser miope.

Lo que dicen los estudiosVarios trabajos internacionales confirman su utilidad. Así, un metaanálisis con más de 3 600 personas de distintos países encontró que los miopes pasaban menos tiempo al aire libre y tenían áreas de CUVAF significativamente más pequeñas que los no miopes. Y en la Universidad de Navarra, un estudio con estudiantes de Medicina y de Ciencias Ambientales mostró que los segundos, que pasan más horas en el exterior por su carrera, tenían más CUVAF y la mitad de riesgo de desarrollar miopía.

Para conocer las repercusiones de este biomarcador en la edad infantil –la etapa más sensible para el crecimiento excesivo del ojo–, se llevó a cabo una investigación en más de 260 niños de entre 6 y 17 años. Los autores comprobaron que los miopes, efectivamente, pasaban menos tiempo al aire libre y presentaban menos CUVAF. Además, si el área de autofluorescencia de la conjuntiva era grande en relación a la edad, los menores estaban protegidos hasta 2,5 veces frente a la miopía y hasta 5 veces frente a la miopía alta.

Este hallazgo podría confirmarse en un estudio, actualmente en revisión, con más de 2 600 niños de la Comunidad de Madrid.

Imaginemos cómo podría usarse dicha información en la práctica clínica. En una revisión ocular, el oftalmólogo toma una imagen del CUVAF. Si el resultado muestra un área reducida, podría dar el siguiente consejo:

“Su hijo necesita al menos una o dos horas de juego al aire libre cada día. El mejor tratamiento ahora mismo es la luz natural, gratuita y sin efectos secundarios”.

En el futuro, las consultas de oftalmología podrían incorporar esa prueba rutinaria igual que hoy se mide la tensión ocular o el fondo de ojo.

No es solo cosa de niñosAunque la prevención en la infancia es clave, el CUVAF también puede ser útil en adultos jóvenes. Durante la universidad o los primeros años laborales, la miopía puede seguir progresando. Medir el CUVAF en esta etapa permite detectar a quienes mantienen un estilo de vida demasiado “de puertas adentro” y orientar cambios sencillos: salir a pasear, practicar deporte al aire libre, exponerse a la luz natural cada día.

Hay una metáfora muy bonita que usan algunos investigadores: el verano se borra de nuestra piel, pero permanece en nuestros ojos. Aunque la piel pierda el bronceado, el ojo conserva la huella del sol a través del CUVAF. Y esa huella no es un simple recuerdo: es una pista directa sobre nuestra futura salud visual.

Porque la miopía no es inevitable: aunque los genes juegan un papel, el ambiente es decisivo. Y entre los factores ambientales, el tiempo al aire libre es el más importante y modificable.![]()

Sobre el autor: Sergio Recalde Maestre es Director científico del laboratorio de oftalmología experimental de la Universidad de Navarra

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo Nuestros ojos saben lo que hicimos el último verano se ha escrito en Cuaderno de Cultura Científica.

Un termómetro para medir la cuanticidad

El flujo de calor “anómalo”, que a primera vista parece violar la segunda ley de la termodinámica, ofrece a los físicos una forma de detectar el entrelazamiento cuántico sin destruirlo.

Un artículo de Philip Ball. Historia original reimpresa con permiso de Quanta Magazine, una publicación editorialmente independiente respaldada por la Fundación Simons.

Una variante moderna del demonio de Maxwell puede actuar como una especie de catalizador, impulsando un flujo de calor de objetos cuánticos fríos a calientes. Ilustración: Daniel García / Quanta Magazine

Una variante moderna del demonio de Maxwell puede actuar como una especie de catalizador, impulsando un flujo de calor de objetos cuánticos fríos a calientes. Ilustración: Daniel García / Quanta Magazine

Si hay una ley de la física que parece fácil de comprender, esa es la segunda ley de la termodinámica: el calor fluye espontáneamente de los cuerpos más calientes hacia los más fríos. Pero ahora, de forma suave y casi casual, Alexssandre de Oliveira Jr. acaba de mostrarme que, en realidad, no la entendía del todo.

«Toma esta taza de café caliente y esta jarra de leche fría», dijo el físico brasileño mientras estábamos sentados en una cafetería de Copenhague. «Ponlas en contacto y, efectivamente, el calor fluirá del objeto caliente al frío, tal como el científico alemán Rudolf Clausius formuló oficialmente en 1850». Sin embargo, en algunos casos —explicó de Oliveira— los físicos han descubierto que las leyes de la mecánica cuántica pueden hacer que el flujo de calor ocurra en sentido contrario: del frío al caliente.

Esto no significa realmente que la segunda ley falle, añadió mientras su café se enfriaba con tranquilidad. Lo que sucede es que la expresión de Clausius es el límite clásico de una formulación más completa, exigida por la física cuántica.

Los físicos empezaron a apreciar la sutileza de esta situación hace más de dos décadas y, desde entonces, han estado explorando la versión cuántica de la segunda ley. Ahora, de Oliveira, investigador posdoctoral en la Universidad Técnica de Dinamarca, y sus colegas han demostrado que el tipo de “flujo de calor anómalo” que se da a escala cuántica podría tener una aplicación tan práctica como ingeniosa.

Según afirman, puede servir como un método sencillo para detectar la cuanticidad —por ejemplo, para saber si un objeto está en una superposición cuántica de varios estados observables posibles, o si dos objetos están entrelazados (es decir, sus estados son interdependientes)— sin destruir esos delicados fenómenos cuánticos. Una herramienta diagnóstica así podría usarse para verificar que un ordenador cuántico está utilizando realmente recursos cuánticos al realizar sus cálculos. Incluso podría ayudar a detectar aspectos cuánticos de la fuerza de la gravedad, uno de los grandes objetivos de la física moderna.

Según los investigadores, basta con conectar un sistema cuántico a un segundo sistema capaz de almacenar información sobre él, y a un sumidero térmico (un cuerpo capaz de absorber mucha energía). Con esta disposición, se puede aumentar la transferencia de calor al sumidero más allá de lo que permitirían las leyes clásicas. Midiendo simplemente lo caliente que está el sumidero se podría detectar la presencia de superposición o entrelazamiento en el sistema cuántico.

Más allá de las posibles aplicaciones prácticas, la investigación pone de manifiesto un nuevo aspecto de una profunda verdad sobre la termodinámica: la forma en que el calor y la energía se transforman y se desplazan en los sistemas físicos está íntimamente ligada a la información —a lo que se sabe o puede saberse sobre dichos sistemas—. En este caso, “pagamos” el flujo de calor anómalo sacrificando información almacenada sobre el sistema cuántico.

«Me encanta la idea de que las magnitudes termodinámicas puedan señalar fenómenos cuánticos», afirma la física Nicole Yunger Halpern, de la Universidad de Maryland. «El tema es fundamental y profundo».

El conocimiento es poder

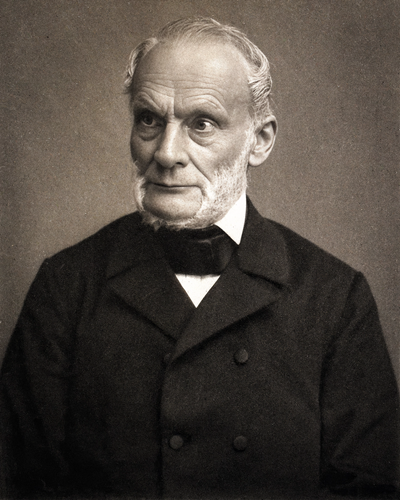

«Es imposible que una máquina autónoma, sin la ayuda de ningún agente externo, transmita calor de un cuerpo a otro a una temperatura más alta», escribió Rudolf Clausius (en alemán) en 1850. Fue la primera expresión de la segunda ley de la termodinámica. Foto: Theo Schafgans/Dominio público

«Es imposible que una máquina autónoma, sin la ayuda de ningún agente externo, transmita calor de un cuerpo a otro a una temperatura más alta», escribió Rudolf Clausius (en alemán) en 1850. Fue la primera expresión de la segunda ley de la termodinámica. Foto: Theo Schafgans/Dominio públicoLa conexión entre la segunda ley de la termodinámica y la información fue explorada por primera vez en el siglo XIX por el físico escocés James Clerk Maxwell. Para su consternación, la segunda ley de Clausius parecía implicar que los focos de calor acabarían disipándose por todo el universo hasta que desapareciesen todas las diferencias de temperatura. En ese proceso, la entropía total del universo —en términos simples, una medida de su desorden y falta de estructura— aumentaría inexorablemente. Maxwell comprendió que esa tendencia acabaría eliminando toda posibilidad de aprovechar los flujos de calor para realizar trabajo útil, y que el universo alcanzaría un equilibrio estéril, dominado por un zumbido térmico uniforme: la llamada “muerte térmica”. Esa perspectiva ya era bastante inquietante por sí misma, pero resultaba especialmente inaceptable para el devoto cristiano Maxwell. En una carta a su amigo Peter Guthrie Tait en 1867, afirmó haber encontrado una manera de “abrir un agujero” en la segunda ley.

Imaginó un diminuto ser (más tarde apodado demonio) capaz de ver el movimiento de las moléculas individuales de un gas. El gas llenaría una caja dividida en dos compartimentos por una pared con una trampilla. Abriendo y cerrando la trampilla selectivamente, el demonio podría separar las moléculas que se mueven más rápido en un lado y las más lentas en el otro, creando así un gas caliente y otro frío, respectivamente. Al actuar según la información obtenida sobre el movimiento molecular, el demonio reduciría la entropía del gas, generando un gradiente de temperatura con el que podría realizarse trabajo mecánico, como empujar un pistón.

Los científicos estaban seguros de que el demonio de Maxwell no podía violar realmente la segunda ley, pero se tardó casi un siglo en comprender por qué. La respuesta es que la información que el demonio recoge y almacena sobre los movimientos moleculares acabaría llenando su memoria finita. Para seguir funcionando, tendría que borrar y reiniciar esa memoria. El físico Rolf Landauer demostró en 1961 que ese borrado consume energía y genera entropía —más entropía de la que el demonio reduce mediante su selección—. El análisis de Landauer estableció una equivalencia entre información y entropía, lo que implica que la información misma puede actuar como un recurso termodinámico: puede transformarse en trabajo. Los físicos demostraron experimentalmente esta conversión de información en energía en 2010.

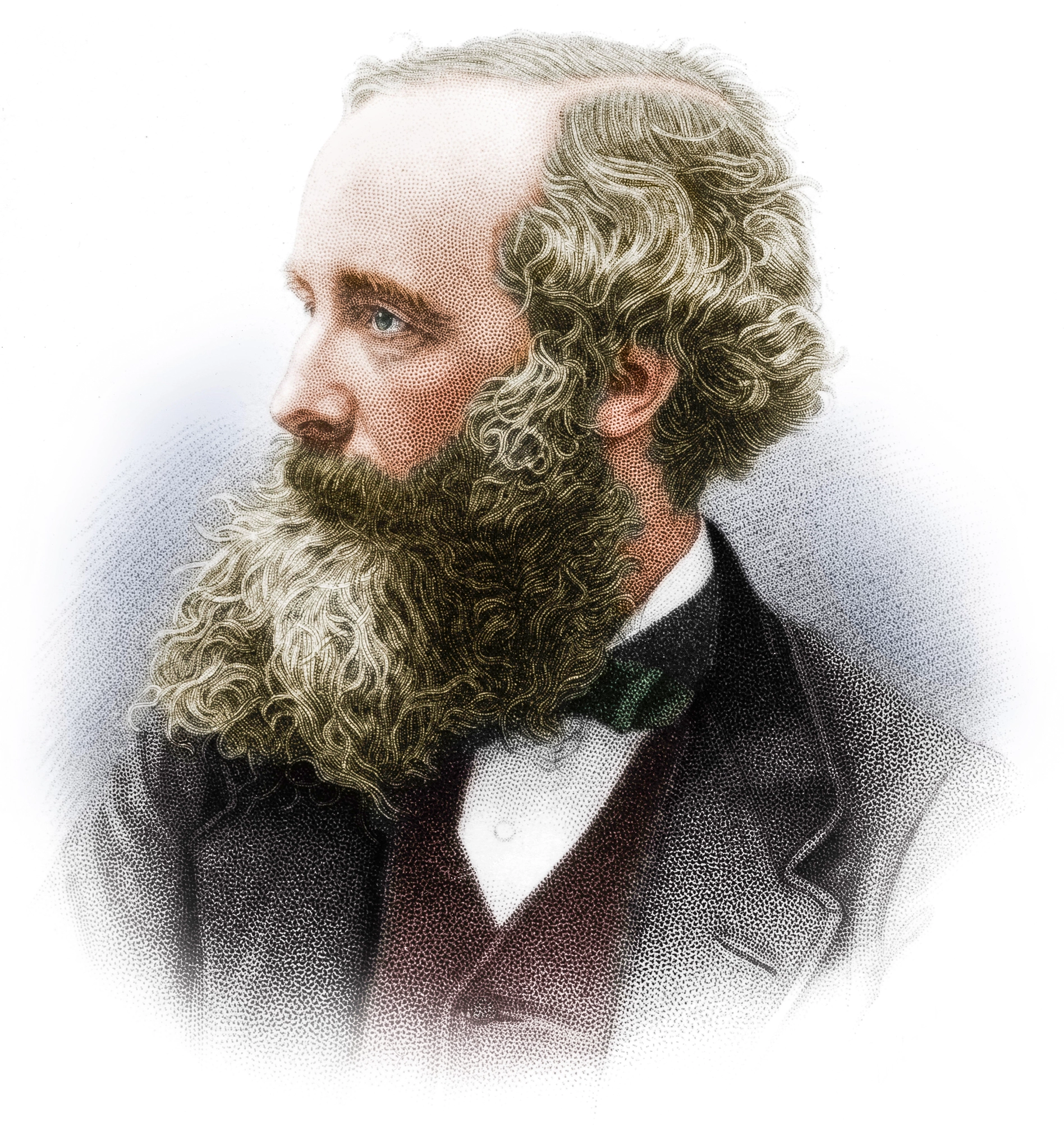

Incómodo con la segunda ley de la termodinámica, el físico escocés James Clerk Maxwell inventó un experimento mental sobre un demonio omnisciente que aún hoy nos brinda nuevas perspectivas. Imagen: The Print Collector/Heritage Images

Incómodo con la segunda ley de la termodinámica, el físico escocés James Clerk Maxwell inventó un experimento mental sobre un demonio omnisciente que aún hoy nos brinda nuevas perspectivas. Imagen: The Print Collector/Heritage ImagesPero los fenómenos cuánticos permiten procesar información de formas que la física clásica no permite —esa es, de hecho, la base de tecnologías como la computación cuántica y la criptografía cuántica—. Y por eso la teoría cuántica altera la versión convencional de la segunda ley.

Aprovechando las correlaciones

Los objetos cuánticos entrelazados comparten información mutua: están correlacionados, de modo que podemos conocer propiedades de uno observando el otro. Eso, por sí mismo, no es tan extraño; si observas uno de un par de guantes y ves que es el izquierdo, sabes que el otro es el derecho. Pero un par de partículas cuánticas entrelazadas difiere de los guantes en un aspecto esencial: mientras que la lateralidad de los guantes está fijada antes de mirar, en las partículas no es así, según la mecánica cuántica. Antes de medirlas, no está decidido qué valor de una propiedad observable tiene cada partícula del par entrelazado. En ese momento solo conocemos las probabilidades de las posibles combinaciones de valores (por ejemplo, 50 % izquierda-derecha y 50 % derecha-izquierda). Solo cuando medimos el estado de una partícula esas posibilidades se resuelven en un resultado concreto. En ese proceso de medición, el entrelazamiento se destruye.

Si las moléculas de un gas están entrelazadas de esta manera un demonio de Maxwell puede manipularlas con más eficacia que si todas se movieran independientemente. Si el demonio sabe, por ejemplo, que cada molécula rápida que ve venir está correlacionada de tal modo que otra rápida la seguirá al instante, no necesita observar la segunda partícula antes de abrir la trampilla para dejarla pasar. El coste termodinámico de (temporalmente) desafiar la segunda ley se reduce.

En 2004, los teóricos cuánticos Časlav Brukner, de la Universidad de Viena, y Vlatko Vedral, entonces en el Imperial College de Londres, señalaron que esto significa que las mediciones termodinámicas macroscópicas pueden utilizarse como un “testigo” para revelar la presencia de entrelazamiento cuántico entre partículas. Bajo ciertas condiciones, mostraron que la capacidad calorífica de un sistema o su respuesta a un campo magnético aplicado debería llevar la huella del entrelazamiento, si este existe.

De manera similar, otros físicos calcularon que se puede extraer más trabajo de un cuerpo caliente cuando hay entrelazamiento cuántico en el sistema que cuando es puramente clásico.

Y en 2008, el físico Hossein Partovi, de la Universidad Estatal de California, identificó una consecuencia particularmente llamativa del modo en que el entrelazamiento cuántico puede cuestionar las intuiciones derivadas de la termodinámica clásica. Descubrió que la presencia de entrelazamiento puede incluso invertir el flujo espontáneo de calor de un objeto caliente a uno frío, aparentemente subvirtiendo la segunda ley.

Esa inversión es una forma especial de refrigeración, explica Yunger Halpern. Y, como ocurre siempre con la refrigeración, no es gratuita (y por tanto no viola realmente la segunda ley). Clásicamente, refrigerar un objeto requiere trabajo: hay que bombear el calor en dirección contraria consumiendo combustible, compensando así la entropía perdida al enfriar el cuerpo frío y calentar el caliente. Pero en el caso cuántico —sigue Yunger Halpern—, en lugar de quemar combustible para lograr la refrigeración, «se queman las correlaciones». Es decir, a medida que avanza el flujo de calor anómalo, el entrelazamiento se destruye: las partículas que inicialmente tenían propiedades correlacionadas se vuelven independientes. «Podemos usar las correlaciones como un recurso para empujar el calor en dirección opuesta», añade.

Vlatko Vedral es uno de los creadores de la idea de utilizar mediciones termodinámicas como «testigo» para revelar la presencia de entrelazamiento cuántico entre partículas. foto: Cortesía de Vlatko Vedral

Vlatko Vedral es uno de los creadores de la idea de utilizar mediciones termodinámicas como «testigo» para revelar la presencia de entrelazamiento cuántico entre partículas. foto: Cortesía de Vlatko VedralDe hecho, el “combustible” aquí es la información misma: concretamente, la información mutua de los cuerpos calientes y fríos entrelazados.

Dos años más tarde, David Jennings y Terry Rudolph, del Imperial College de Londres, aclararon lo que sucede. Mostraron cómo puede reformularse la segunda ley de la termodinámica para incluir el caso en que existe información mutua, y calcularon los límites sobre cuánto puede modificarse —e incluso invertirse— el flujo de calor clásico mediante el consumo de correlaciones cuánticas.

El demonio sabe de cuanticidad

Cuando entran en juego los efectos cuánticos la segunda ley deja de ser tan sencilla. Pero ¿podemos hacer algo útil con la forma en que la física cuántica flexibiliza los límites de las leyes termodinámicas? Esa es una de las metas de la disciplina llamada termodinámica cuántica, en la que algunos investigadores buscan fabricar motores cuánticos más eficientes que los clásicos o baterías cuánticas que se carguen más rápidamente.

Patryk Lipka-Bartosik, del Centro de Física Teórica de la Academia Polaca de Ciencias, ha buscado aplicaciones prácticas en la dirección contraria: usar la termodinámica como herramienta para explorar la física cuántica. El año pasado, él y sus colaboradores vieron cómo materializar la idea de Brukner y Vedral (2004) de utilizar propiedades termodinámicas como testigo del entrelazamiento cuántico. Su esquema involucra sistemas cuánticos calientes y fríos correlacionados entre sí, y un tercer sistema que media el flujo de calor entre ambos. Podemos pensar en este tercer sistema como en un demonio de Maxwell, solo que ahora posee una “memoria cuántica” que puede estar entrelazada con los sistemas que manipula. Al estar entrelazados con la memoria del demonio, los sistemas caliente y frío quedan efectivamente vinculados, de modo que el demonio puede inferir información de uno a partir de las propiedades del otro.

Patryk Lipka-Bartosik ha explorado cómo utilizar mediciones termodinámicas para detectar efectos cuánticos. Foto: Alicja Lipka-Bartosik

Patryk Lipka-Bartosik ha explorado cómo utilizar mediciones termodinámicas para detectar efectos cuánticos. Foto: Alicja Lipka-BartosikUn demonio cuántico así puede actuar como un tipo de catalizador, facilitando la transferencia de calor al aprovechar correlaciones que de otro modo serían inaccesibles. Es decir, al estar entrelazado con los objetos caliente y frío, el demonio puede detectar y explotar todas sus correlaciones de manera sistemática. Y, de nuevo como un catalizador, este tercer sistema vuelve a su estado original una vez completado el intercambio de calor entre los objetos. De esta forma, el proceso puede potenciar el flujo de calor anómalo más allá de lo que sería posible sin dicho catalizador.

El artículo publicado este año por de Oliveira, junto con Lipka-Bartosik y Jonatan Bohr Brask, de la Universidad Técnica de Dinamarca, utiliza algunas de estas mismas ideas, pero con una diferencia crucial que convierte el sistema en una especie de termómetro para medir la cuanticidad. En el trabajo anterior, la memoria cuántica —el demonio— interactuaba con un par de sistemas cuánticos correlacionados, uno caliente y otro frío. Pero en este nuevo trabajo se coloca entre un sistema cuántico (por ejemplo, una red de bits cuánticos, o qubits, entrelazados en un ordenador cuántico) y un sumidero térmico sencillo con el que el sistema cuántico no está directamente entrelazado.

Como la memoria está entrelazada tanto con el sistema cuántico como con el sumidero, puede de nuevo catalizar un flujo de calor entre ellos más allá de lo posible clásicamente. En ese proceso, el entrelazamiento dentro del sistema cuántico se convierte en calor adicional que fluye hacia el sumidero. Así, medir la energía almacenada en el sumidero (equivalente a leer su “temperatura”) revela la presencia de entrelazamiento en el sistema cuántico. Pero, dado que el sistema y el sumidero no están entrelazados entre sí, la medición no afecta al estado del sistema cuántico. Este recurso elude la conocida dificultad de que las mediciones destruyen la cuanticidad. «Si intentaras simplemente medir el sistema [cuántico] directamente, destruirías su entrelazamiento antes incluso de que el proceso se desarrollara», explica de Oliveira.

Los físicos Alexssandre de Oliveira Jr. (izquierda) y Jonatan Bohr Brask (derecha) colaboraron con Patryk Lipka-Bartosik en un nuevo esquema para detectar la cuántica sin destruirla. Foto: Jonas Schou Neergaard-Nielsen

Los físicos Alexssandre de Oliveira Jr. (izquierda) y Jonatan Bohr Brask (derecha) colaboraron con Patryk Lipka-Bartosik en un nuevo esquema para detectar la cuántica sin destruirla. Foto: Jonas Schou Neergaard-NielsenEl nuevo esquema tiene la ventaja de ser simple y general, señala Vedral, ahora en la Universidad de Oxford. «Estos protocolos de verificación son muy importantes», dice: cada vez que una empresa de computación cuántica anuncia un nuevo dispositivo, siempre surge la cuestión de cómo —o si— saben realmente que el entrelazamiento entre los qubits está contribuyendo al cálculo. Un sumidero térmico podría actuar como detector de tales fenómenos cuánticos simplemente a través de su cambio de energía. Para implementar la idea, podría designarse un qubit como la memoria cuyo estado revele el de otros qubits, y luego acoplar ese qubit de memoria a un conjunto de partículas que funcionen como sumidero, cuya energía se pueda medir. (Vedral añade una salvedad: es necesario tener un control muy preciso del sistema para asegurarse de que no haya otras fuentes de flujo de calor que contaminen las mediciones. Además, el método no detectará todos los estados entrelazados.)

De Oliveira cree que ya existe un sistema adecuado para poner a prueba su idea experimentalmente. Él y sus colegas están en conversaciones con el grupo de investigación de Roberto Serra en la Universidad Federal del ABC, en São Paulo (Brasil). En 2016, Serra y sus colaboradores utilizaron las orientaciones magnéticas, o espines, de los átomos de carbono e hidrógeno en moléculas de cloroformo como bits cuánticos entre los que podían transferir calor.

Usando este montaje, dice de Oliveira, debería ser posible aprovechar un comportamiento cuántico —en este caso la coherencia, es decir, que las propiedades de dos o más espines evolucionan en fase entre sí— para modificar el flujo de calor entre los átomos. La coherencia de los qubits es esencial para la computación cuántica, así que poder verificarla detectando un intercambio de calor anómalo sería muy útil.

Las implicaciones podrían ser aún mayores. Varios grupos de investigación intentan diseñar experimentos para determinar si la gravedad es una fuerza cuántica, al igual que las otras tres fuerzas fundamentales. Algunos de estos esfuerzos consisten en buscar entrelazamiento cuántico entre dos objetos generado únicamente por su atracción gravitatoria mutua. Tal vez los investigadores puedan explorar ese entrelazamiento inducido por la gravedad mediante simples mediciones termodinámicas sobre los objetos, verificando así (o no) que la gravedad está realmente cuantizada.

Para estudiar una de las cuestiones más profundas de la física —concluye Vedral—, «¿no sería maravilloso poder hacerlo con algo tan sencillo y macroscópico como esto?».

El artículo original, A Thermometer for Measuring Quantumness, se publicó el 1 de octubre de 2025 en Quanta Magazine. Cuaderno de Cultura Científica tiene un acuerdo de distribución en castellano con Quanta Magazine.

Traducido por César Tomé López

El artículo Un termómetro para medir la cuanticidad se ha escrito en Cuaderno de Cultura Científica.

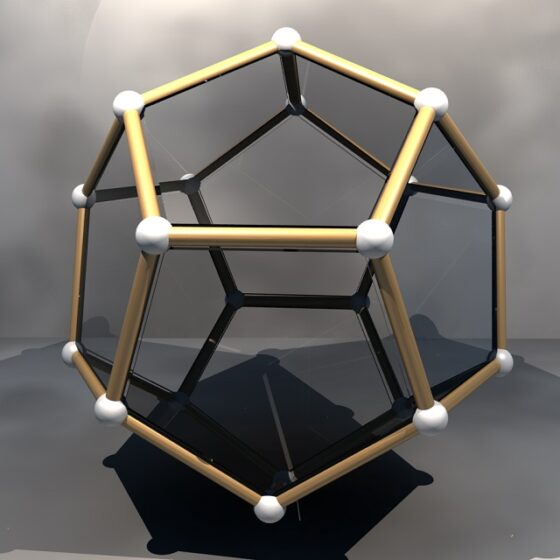

Rarezas quiméricas: dientes fuera de la boca con funciones sexuales

El Diccionario de la lengua española define “quimérico” como fabuloso, fingido o imaginado sin fundamento, pero aquí nos referimos a una sorprendente peculiaridad recién descubierta en las quimeras u holocéfalos, un pequeño grupo de peces marinos. Los machos de estos peces son el único caso conocido de formación de dientes fuera de la cavidad bucal, unos dientes que usan para sujetar a la hembra durante la cópula.

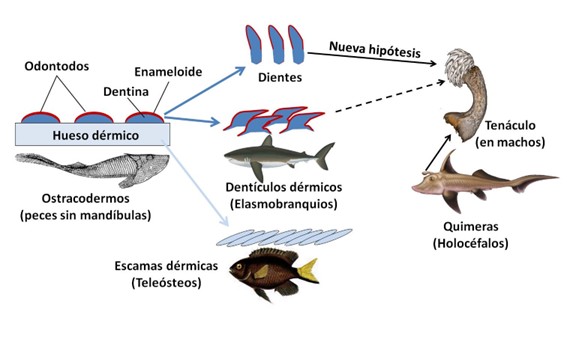

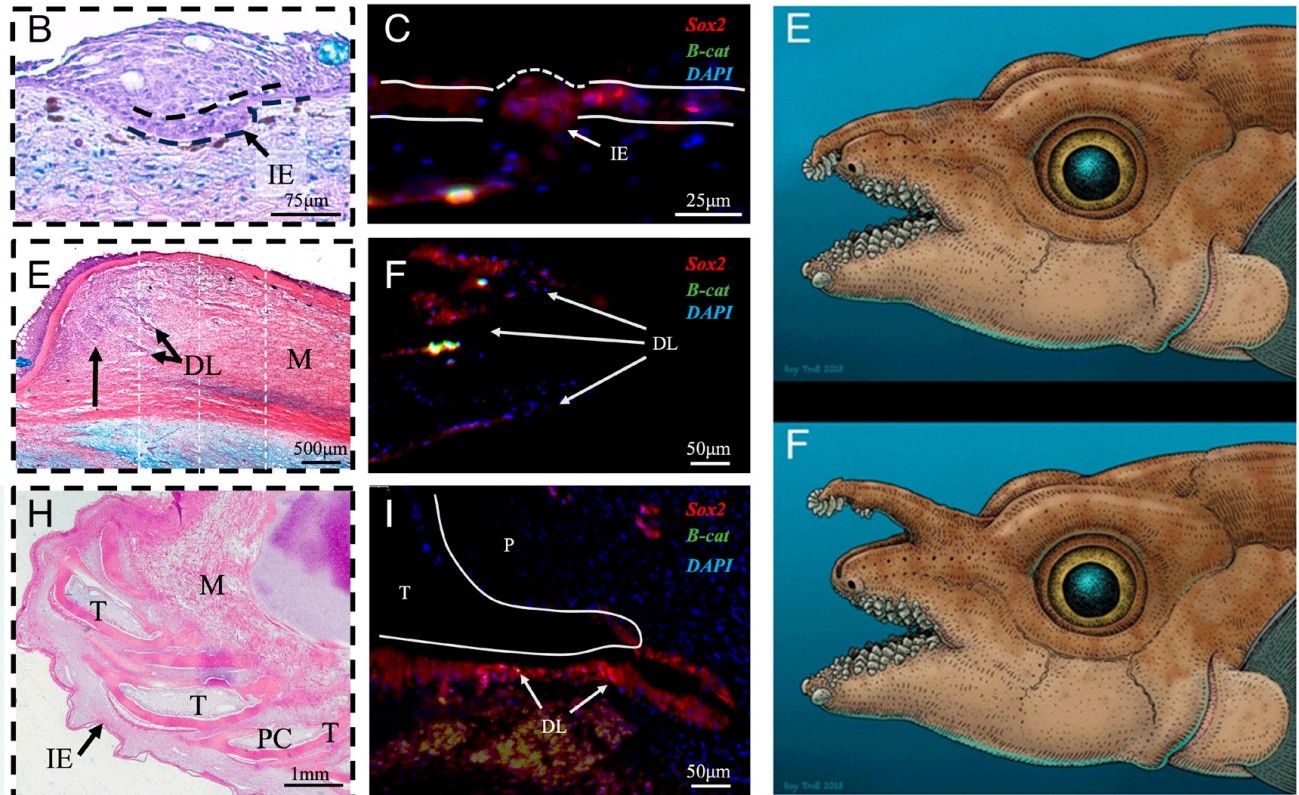

Vayamos por orden y comencemos por tratar el origen de los dientes en los vertebrados. Los primeros vertebrados aparecieron en el Cámbrico, hace unos 520 millones de años. Carecían de mandíbulas y su cuerpo era blando y vulnerable, pero muy pronto adquirieron una especie de caparazón de hueso dérmico (peces ostracodermos). Este caparazón está cubierto por unos pequeños tubérculos constituidos por dentina (una forma compacta de hueso) y recubiertos por un tipo de esmalte (enameloide). Son los llamados “odontodos” (Figura 1). Cuando los peces desarrollaron mandíbulas a partir del esqueleto branquial, hace unos 420-430 millones de años, aprovecharon los odontodos para fijarlos a las mandíbulas y formar los dientes[1].

Figura 1. Los odontodos del caparazón de los peces ostracodermos son el origen evolutivo tanto de los dentículos dérmicos de los elasmobranquios como de los dientes. En cambio, las escamas de los teleósteos derivan del hueso dérmico de dicho caparazón. Se pensaba que las espinas del tenáculo de las quimeras derivaban de los dentículos dérmicos (flecha discontinua), pero un nuevo estudio sugiere que se originaron a partir de dientes. Se han utilizado imágenes de Damouraptor, Gasmasque y Cohen et al. (2025), cita completa en referencias, con licencia CC BY 4.0.

Figura 1. Los odontodos del caparazón de los peces ostracodermos son el origen evolutivo tanto de los dentículos dérmicos de los elasmobranquios como de los dientes. En cambio, las escamas de los teleósteos derivan del hueso dérmico de dicho caparazón. Se pensaba que las espinas del tenáculo de las quimeras derivaban de los dentículos dérmicos (flecha discontinua), pero un nuevo estudio sugiere que se originaron a partir de dientes. Se han utilizado imágenes de Damouraptor, Gasmasque y Cohen et al. (2025), cita completa en referencias, con licencia CC BY 4.0.Los peces armados de mandíbulas y dentadura aumentaron de tamaño y llegaron a ser los predadores dominantes durante el periodo Devónico. Paralelamente, el caparazón óseo defensivo disminuyó su importancia, dando lugar a las escamas de los peces (Figura 1). En el grupo de los condrictios (elasmobranquios -es decir, tiburones y rayas- y quimeras) estas escamas retienen la composición de los odontodos primitivos, formados por dentina y un recubrimiento muy duro similar al esmalte dentario. Por eso, el cuerpo de los elasmobranquios actuales está cubierto de dentículos dérmicos derivados de los odontodos. En las quimeras, cuyo linaje se separó muy pronto del de los elasmobranquios, la mayor parte de la piel los ha perdido pero se mantienen en los apéndices copuladores.

Las quimeras forman un grupo muy reducido de peces marinos, alrededor de 50 especies de aguas profundas. A diferencia de tiburones y rayas no tienen dientes individuales, ya que se sueldan formando placas dentarias. Sí comparten con elasmobranquios la fecundación interna, y los machos disponen de una serie de apéndices copuladores en la región pélvica para sujetar a la hembra. Además, los machos tienen un curiosísimo apéndice, el tenáculo, situado entre los ojos, y dotado de unas fuertes espinas (Figura 2). Todo parece indicar que su función es también ayudar en la cópula y se consideraba que sus espinas eran dentículos dérmicos modificados, como los de los apéndices pélvicos.